【Tidy库文本处理】:字符串操作与数据清洗的艺术

发布时间: 2024-10-14 04:46:13 阅读量: 30 订阅数: 29

GetData_Tidy:获取和清理数据课程项目

# 1. Tidy库概览与字符串操作基础

在数据分析和文本处理的世界里,Tidy库已经成为一种强大的工具,它提供了一系列的函数和方法,用于简化和加速数据清洗的过程。本章我们将对Tidy库进行概览,并探讨其在字符串操作中的基础知识。

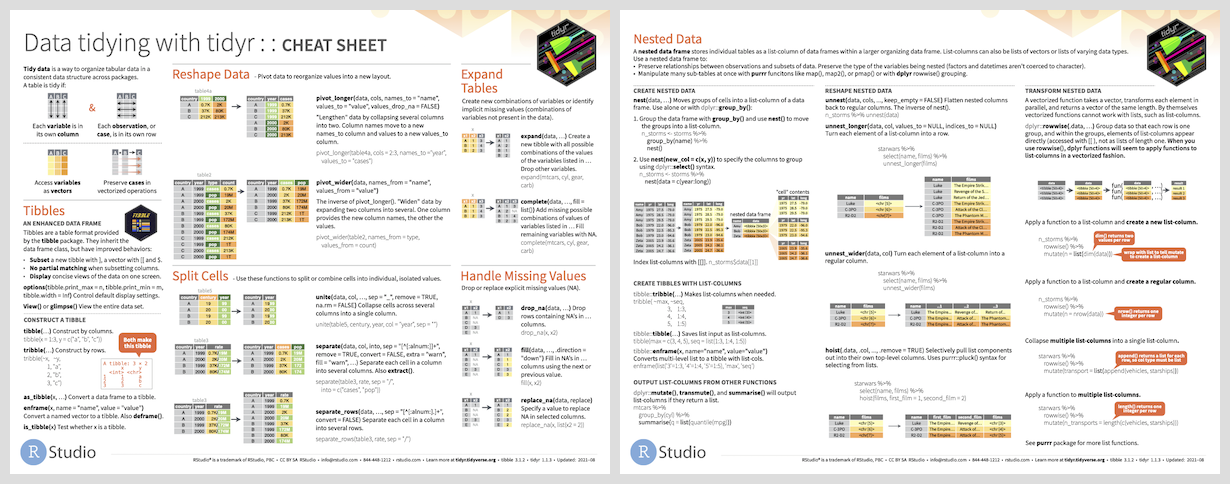

## 1.1 Tidy库简介

Tidy库是R语言中一个用于数据整理和清洗的工具包,它遵循“tidy”数据原则,即每个变量为一列,每个观测为一行,每个表为一个独立的数据框。这使得数据清洗工作更加直观和易于理解。

## 1.2 字符串操作基础

字符串操作是数据清洗中的基础工作,Tidy库中的`stringr`包提供了丰富的字符串操作函数。例如,`str_detect()`可以检测字符串中是否存在特定的模式,`str_replace()`可以替换字符串中的特定部分。

### 示例代码

```r

library(stringr)

# 检测字符串

str_detect("Hello, World!", "World")

# 替换字符串

str_replace("Hello, World!", "World", "R")

```

通过上述代码,我们可以看到如何使用Tidy库中的函数来检测和替换字符串,这只是Tidy库强大功能的一个简单示例。在后续章节中,我们将深入探讨更多高级的文本清洗技术。

# 2. Tidy库中的文本清洗技术

Tidy库是数据科学领域中的一款强大工具,它提供了丰富的文本处理功能,可以帮助我们从原始文本数据中提取有价值的信息。本章节我们将深入探讨Tidy库中的文本清洗技术,包括基于模式匹配的清洗、基于分词的清洗以及基于文本格式转换的清洗。

## 2.1 基于模式匹配的文本清洗

### 2.1.1 正则表达式在文本清洗中的应用

正则表达式是文本处理中的强大工具,它允许我们定义复杂的字符串匹配模式。在Tidy库中,正则表达式可以用来识别和替换特定的文本模式,从而实现文本清洗的目的。

例如,假设我们有以下文本数据:

```r

text <- c("The quick brown fox jumps over the lazy dog",

"Lorem ipsum dolor sit amet, consectetur adipiscing elit")

```

如果我们想要替换掉所有的元音字母,可以使用以下正则表达式:

```r

library(stringr)

text <- str_replace_all(text, pattern = "[aeiouAEIOU]", replacement = "")

```

这段代码将会输出所有元音字母被替换为空的结果。

### 2.1.2 Tidy库的文本替换与提取

除了正则表达式的直接应用,Tidy库还提供了更多高级的文本替换和提取功能。例如,我们可以使用`str_extract`函数来提取文本中符合正则表达式的部分。

```r

# 提取所有的数字

numbers <- str_extract(text, pattern = "\\d+")

```

此外,`str_replace`函数可以用来替换文本中的特定模式:

```r

# 替换所有的逗号

text <- str_replace(text, pattern = ",", replacement = " ")

```

### 2.1.3 代码逻辑的逐行解读分析

在上面的代码块中,我们使用了`str_replace_all`函数来替换文本中的所有元音字母。这个函数的第一个参数是我们的文本向量`text`,第二个参数是我们的模式`pattern = "[aeiouAEIOU]"`,表示匹配所有的大小写元音字母,第三个参数是`replacement`,它指定了替换内容,这里我们使用空字符串`""`作为替换值。

在第二个代码块中,我们使用了`str_extract`函数来提取文本中的数字。正则表达式`"\\d+"`定义了一个匹配一个或多个数字的模式。

在第三个代码块中,我们使用了`str_replace`函数来替换文本中的逗号。这里的模式是一个简单的逗号`","`,而替换内容是一个空格`" "`。

## 2.2 基于分词的文本清洗

### 2.2.1 分词技术简介

分词是文本处理中的一个重要步骤,它涉及到将连续的文本分割成有意义的片段,通常是为了进一步分析。在英语中,这通常意味着将句子分割成单词。在其他语言中,分词可能更复杂,因为单词之间没有空格。

Tidy库提供了`str_split`函数来实现分词功能。例如:

```r

# 分词

words <- str_split(text, pattern = " ")

```

### 2.2.2 Tidy库的分词与重组

分词后的文本可以进一步清洗和重组。例如,我们可以将单词转换成小写,并去除重复的单词。

```r

# 转换为小写并去重

unique_words <- unique(tolower(words))

```

重组则涉及到将分词后的文本重新组合成句子或其他结构。Tidy库提供了`str_c`函数来实现这一点:

```r

# 重组

new_text <- str_c(unique_words, collapse = " ")

```

### 2.2.3 代码逻辑的逐行解读分析

在上面的代码块中,我们首先使用了`str_split`函数来将文本分割成单词。这个函数的第一个参数是我们的文本向量`text`,第二个参数是我们的分隔符`pattern = " "`,它指定了空格作为分词的分隔符。

在第二个代码块中,我们使用了`tolower`函数将所有单词转换成小写,然后使用`unique`函数去除重复的单词。

在第三个代码块中,我们使用了`str_c`函数将去重后的单词重新组合成一个字符串。`collapse = " "`参数指定了单词之间的连接符为一个空格。

## 2.3 基于文本格式转换的清洗

### 2.3.1 文本格式的识别与转换

文本数据通常包含多种格式,如日期、时间、数字等。Tidy库提供了强大的工具来识别和转换这些格式。例如,我们可以使用`str_detect`函数来检测特定格式的文本。

```r

# 检测日期格式

dates <- str_detect(text, pattern = "\\d{4}-\\d{2}-\\d{2}")

```

### 2.3.2 Tidy库的格式化输出

转换文本格式通常涉及到将文本转换成特定的数据类型,如日期或时间。Tidy库提供了`parse_date`等函数来实现这一点。

```r

# 解析日期

parsed_dates <- parse_date(dates, format = "%Y-%m-%d")

```

### 2.3.3 代码逻辑的逐行解读分析

在上面的代码块中,我们使用了`str_detect`函数来检测文本中的日期格式。正则表达式`"\\d{4}-\\d{2}-\\d{2}"`定义了一个匹配格式为`YYYY-MM-DD`的日期模式。

在第二个代码块中,我们使用了`parse_date`函数来将检测到的文本转换为日期类型。`format = "%Y-%m-%d"`参数指定了输入文本的日期格式。

通过本章节的介绍,我们已经了解了Tidy库中基于模式匹配、分词以及格式转换的文本清洗技术。这些技术为我们提供了强大的工具来处理和分析文本数据,是数据科学实践中不可或缺的一部分。在下一章中,我们将进一步探讨Tidy库在数据清洗中的实践应用,包括数据清洗流程的构建、不同类型数据的清洗以及异常处理策略。

# 3. Tidy库在数据清洗中的实践应用

在本章节中,我们将深入探讨Tidy库在实际数据清洗任务中的应用。我们会通过构建数据清洗流程、处理不同类型数据的清洗技巧,以及如何进行异常处理等方面来展示Tidy库的

0

0