【Tidy库扩展应用】:TensorFlow和PyTorch集成,打造智能数据管道

发布时间: 2024-10-14 04:40:53 阅读量: 17 订阅数: 26

# 1. Tidy库基础和数据管道概念

在本章中,我们将首先了解Tidy库的基础知识,包括它的功能、设计哲学以及如何安装和配置。随后,我们将深入探讨数据管道的概念,这是现代数据科学和机器学习项目中的核心概念。数据管道不仅涉及数据的收集和处理,还包括数据的清洗、转换和加载(ETL),这些步骤对于后续的模型训练至关重要。

## 1.1 Tidy库的基础知识

Tidy库提供了一系列简洁、高效的函数,用于处理和分析数据。它的设计哲学是"整洁数据"(tidy data),这意味着数据应当以一种能够方便进行分析的格式来组织。Tidy库的安装和配置相对简单,通常可以通过R语言的包管理器轻松完成。

```r

# 安装Tidy库

install.packages("tidyverse")

```

## 1.2 数据管道的概念

数据管道是一系列数据处理步骤的集合,这些步骤从数据收集开始,到数据清洗、转换、分析,再到数据展示或模型训练。在Tidy库中,管道操作符(%>%)是构建数据管道的关键。它允许我们将一个函数的输出直接传递给下一个函数,从而形成一个连贯的数据处理流程。

```r

# 使用管道操作符构建数据管道

library(tidyverse)

iris %>%

filter(Species == "setosa") %>%

group_by(Species) %>%

summarise(mean(Sepal.Length))

```

以上代码展示了如何使用管道操作符筛选特定种类的鸢尾花数据集,并计算其萼片长度的平均值。这只是Tidy库数据管道功能的一个简单示例,实际上它可以处理更复杂的数据处理任务。在接下来的章节中,我们将进一步探讨如何将Tidy库与TensorFlow和PyTorch等机器学习库集成,以及如何构建智能数据管道。

# 2. Tidy库与TensorFlow集成

## 2.1 TensorFlow的基础介绍

### 2.1.1 TensorFlow的安装和配置

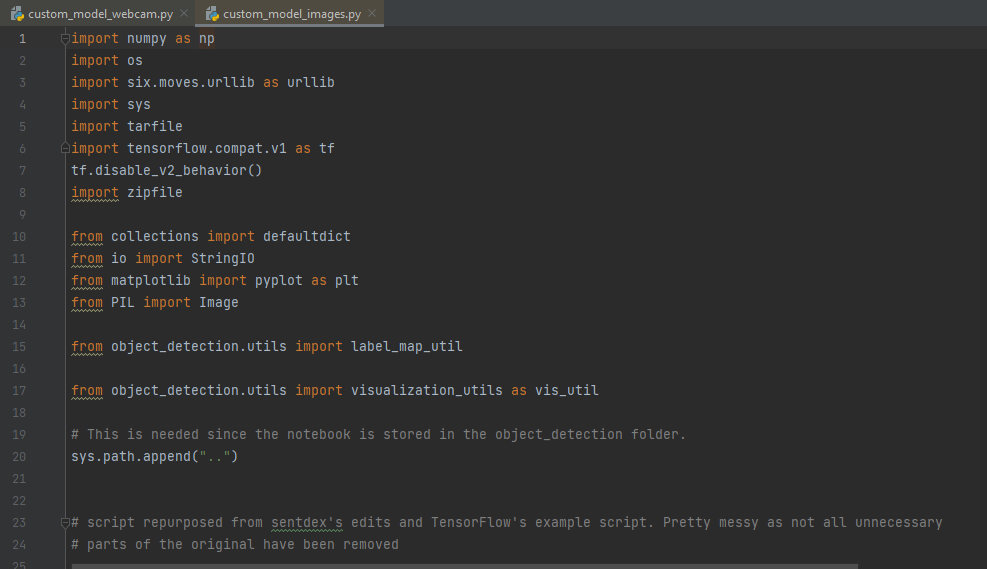

在本章节中,我们将介绍TensorFlow的安装和配置过程。TensorFlow是由Google开发的开源机器学习库,广泛应用于各种深度学习模型的构建和训练。为了确保TensorFlow能够顺利运行,我们需要对其进行适当的安装和配置。

首先,我们需要安装Python环境。TensorFlow支持Python 3.6及以上版本,因此请确保你的系统中已经安装了对应版本的Python。接下来,我们可以通过Python的包管理器pip来安装TensorFlow。打开终端或命令提示符,输入以下命令:

```bash

pip install tensorflow

```

如果你希望安装特定版本的TensorFlow,例如版本2.0,可以使用以下命令:

```bash

pip install tensorflow==2.0

```

此外,为了优化性能,还可以通过GPU版本的TensorFlow。如果你的计算机拥有NVIDIA的CUDA兼容GPU,并且安装了相应的cuDNN库,可以通过以下命令安装GPU版本的TensorFlow:

```bash

pip install tensorflow-gpu

```

安装完成后,我们可以通过编写简单的Python代码来验证TensorFlow是否安装成功:

```python

import tensorflow as tf

print(tf.__version__)

```

如果安装正确,上述代码将打印出TensorFlow的版本号。

### 2.1.2 TensorFlow的基本操作和API

通过本章节的介绍,我们将深入了解TensorFlow的基本操作和API。TensorFlow提供了丰富的API来构建和训练深度学习模型。在开始之前,我们需要了解一些TensorFlow的基本概念,包括张量(Tensor)、计算图(Graph)和会话(Session)。

张量是TensorFlow中用于表示数据的多维数组。张量的阶(Rank)表示张量的维度,例如标量(0阶)、向量(1阶)、矩阵(2阶)等。以下是一个创建标量张量的示例代码:

```python

import tensorflow as tf

# 创建一个标量张量

scalar = tf.constant(3)

```

计算图是TensorFlow的核心概念之一,它由节点(操作)和边(张量)组成。计算图定义了操作之间的关系以及如何计算这些操作。以下是一个简单的计算图示例:

```python

import tensorflow as tf

# 创建两个常量张量

a = tf.constant(2)

b = tf.constant(3)

# 创建一个计算图节点,执行加法操作

c = tf.add(a, b)

# 创建一个会话

session = ***pat.v1.Session()

# 运行计算图

result = session.run(c)

# 打印结果

print(result)

```

在上面的代码中,我们创建了一个包含加法操作的计算图,并通过会话运行它来获取结果。会话是用于执行计算图的操作和访问张量值的环境。

TensorFlow提供了多种API来构建模型,包括Keras API、Estimator API等。Keras API提供了高层的神经网络API,使得构建和训练深度学习模型更加简单和直观。以下是一个使用Keras API构建和训练模型的示例:

```python

import tensorflow as tf

from tensorflow import keras

from tensorflow.keras import layers

# 构建一个简单的序贯模型

model = keras.Sequential([

layers.Dense(64, activation='relu'),

layers.Dense(10, activation='softmax')

])

# 编译模型

***pile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 使用训练数据和标签拟合模型

model.fit(x_train, y_train, epochs=5)

```

在上述代码中,我们构建了一个包含两个全连接层的序贯模型,并使用训练数据进行编译和拟合。

## 2.2 Tidy库与TensorFlow的数据处理

### 2.2.1 Tidy库的数据管道功能

Tidy库是一个强大的数据处理库,它提供了一系列函数来处理和转换数据。在本章节中,我们将介绍Tidy库与TensorFlow集成时的数据管道功能。

Tidy库的数据管道功能可以帮助我们轻松地将数据从原始格式转换为TensorFlow可以使用的格式。例如,我们可以使用Tidy库读取CSV文件中的数据,然后将数据转换为张量格式,以便TensorFlow进行处理。

以下是使用Tidy库读取CSV文件并转换为张量的示例代码:

```python

import tidy

# 使用Tidy库读取CSV文件

df = tidy.read_csv('data.csv')

# 使用Tidy库的API对数据进行预处理

# 假设我们有一个名为'target'的列需要转换为张量

tensor = tidy.tensor(df['target'])

# 将张量转换为TensorFlow的张量格式

import tensorflow as tf

tf_tensor = tf.convert_to_tensor(tensor)

```

在上述代码中,我们首先使用Tidy库读取CSV文件中的数据,并将其存储在DataFrame对象中。然后,我们使用Tidy库的API对数据进行预处理,例如转换为张量。最后,我们使用TensorFlow的API将Tidy库的张量转换为TensorFlow的张量格式。

### 2.2.2 Tidy库与TensorFlow的集成方式

Tidy库与TensorFlow的集成可以通过多种方式实现。在本章节中,我们将介绍两种常见的集成方式。

第一种集成方式是直接使用Tidy库的数据处理功能来处理和转换数据,然后将处理后的数据传递给TensorFlow模型进行训练和预测。这种方式简单直观,适用于大多数情况。

以下是使用Tidy库和TensorFlow集成的示例代码:

```python

import tidy

import tensorflow as tf

# 使用Tidy库读取CSV文件

df = tidy.read_csv('data.csv')

# 使用Tidy库的API对数据进行预处理

# 假设我们有一个名为'features'的列需要转换为张量

features_tensor = tidy.tensor(df['features'])

# 将张量转换为TensorFlow的张量格式

tf_features_tensor = tf.convert_to_tensor(features_tensor)

# 定义TensorFlow模型

model = tf.keras.Sequential([

tf.keras.layers.Dense(64, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 编译模型

***pile(optimizer='adam',

loss='sparse_categorical_crossentropy',

metrics=['accuracy'])

# 使用处理后的数据拟合模型

model.fit(tf_features_tensor, labels)

```

在上述代码中,我们使用Tidy库读取CSV文件,并使用Tidy库的API对数据进行预处理。然后,我们将处理后的数据转换为TensorFlow的张量格式,并使用TensorFlow模型进行训练。

第二种集成方式是将Tidy库的数据处理功能封装为TensorFlow的自定义层或模型。这种方式可以更好地利用TensorFlow的API和优化功能,适用于需要高度集成的场景。

以下是将Tidy库的数据处理功能封装为TensorFlow自定义层的示例代码:

```python

import tidy

import tensorflow as tf

class TidyDataLayer(tf.keras.layers.Layer):

def __init__(self):

super(TidyDataLayer, self).__init__()

def call(self, in

```

0

0