Python数据清洗的艺术:Tidy库入门到精通(10大技巧+案例分析)

发布时间: 2024-10-14 04:18:32 阅读量: 75 订阅数: 36

# 1. Tidy库概述

## 1.1 Tidy库简介

Tidy库是一个强大的数据处理工具,它提供了一系列用于数据操作、清洗和转换的函数。其设计灵感来源于“整洁数据”原则,旨在帮助用户高效地处理数据。

## 1.2 Tidy库的设计哲学

该库遵循“整洁数据”原则,即每个变量构成一列,每个观察值构成一行,每个表只包含一种类型的数据。这种设计理念简化了数据分析流程,使得数据操作更加直观和一致。

## 1.3 Tidy库的适用场景

Tidy库适用于多种数据分析场景,包括但不限于数据探索、数据准备、数据清洗、数据转换和数据聚合。它为数据科学家提供了一套全面的工具,以满足从数据预处理到最终分析的各个阶段的需求。

# 2. Tidy库核心功能详解

## 2.1 数据框(DataFrames)的操作

### 2.1.1 数据框的基本操作

在本章节中,我们将探讨Tidy库中的数据框(DataFrames)操作。数据框是R语言中一种用于存储表格数据的基础数据结构,它类似于SQL数据库中的表或Python中的Pandas DataFrame。Tidy库中的数据框操作功能强大,可以进行数据的增删改查等基本操作。

#### 基本创建与查看

首先,我们可以使用`read.csv()`、`read.table()`等函数从文件中读取数据创建数据框。例如:

```r

# 读取CSV文件

df <- read.csv("data.csv")

```

对于已有的数据框,我们可以使用`head()`、`tail()`函数查看数据的前几行或后几行:

```r

# 查看前5行数据

head(df, 5)

# 查看后5行数据

tail(df, 5)

```

#### 数据框的子集操作

我们可以使用`[]`索引操作符对数据框进行子集操作。例如:

```r

# 选择特定列

df[, c("column1", "column2")]

# 选择特定行

df[1:5, ]

```

### 2.1.2 数据框的高级操作

#### 数据筛选

数据筛选是数据框操作中常用的功能,我们可以使用`subset()`函数或者`dplyr`包中的`filter()`函数进行数据的筛选。例如:

```r

# 使用subset函数

subset(df, column1 > 10)

# 使用dplyr的filter函数

library(dplyr)

df %>% filter(column1 > 10)

```

#### 数据排序

数据排序可以使用`order()`函数或者`dplyr`包中的`arrange()`函数。例如:

```r

# 使用order函数

df[order(df$column1), ]

# 使用dplyr的arrange函数

df %>% arrange(column1)

```

#### 数据汇总

数据汇总可以使用`aggregate()`函数或者`dplyr`包中的`summarise()`函数。例如:

```r

# 使用aggregate函数

aggregate(column2 ~ column1, df, mean)

# 使用dplyr的summarise函数

df %>% group_by(column1) %>% summarise(mean(column2))

```

在本章节中,我们介绍了数据框的基本和高级操作,这些操作是数据处理和分析的基础。接下来,我们将深入探讨数据清洗的基础知识。

## 2.2 数据清洗的基础

### 2.2.1 数据清洗的概念

数据清洗是指在数据分析过程中,对原始数据进行检查、修正、整理的过程,以确保数据的质量和准确性。数据清洗通常包括以下几个方面:

- **数据格式统一**:确保所有数据遵循相同的格式,例如日期格式、数字格式等。

- **数据去重**:删除重复的记录,避免分析时产生偏差。

- **数据填充与删除**:处理缺失值,可以是填充缺失值,也可以是删除缺失值过多的记录。

- **异常值处理**:识别和处理异常值,提高数据的可靠性。

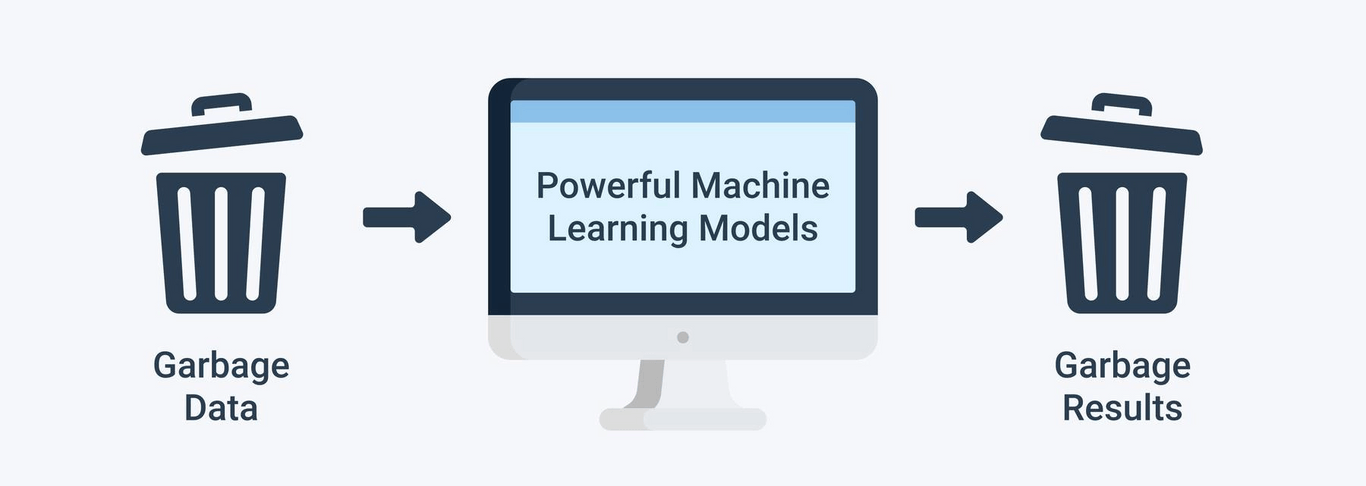

### 2.2.2 数据清洗的重要性

在数据分析中,数据清洗的重要性不言而喻。高质量的数据是得出准确分析结果的前提。例如,数据中的重复、缺失或异常值都可能导致分析结果的偏差。因此,数据清洗是确保数据分析质量的关键步骤。

#### 数据清洗的步骤

数据清洗的步骤通常包括:

1. **数据导入**:将数据从外部源导入到数据分析环境。

2. **初步探索**:对数据进行初步的探索性分析,了解数据的基本情况。

3. **数据识别**:识别数据中的缺失值、重复值、异常值等。

4. **数据处理**:根据识别的问题进行相应的处理,如填充缺失值、删除重复记录等。

5. **结果验证**:验证数据清洗的结果是否符合预期。

在本章节中,我们介绍了数据清洗的概念和重要性,并概述了数据清洗的基本步骤。接下来,我们将探讨数据分组与聚合的概念和方法。

# 3. Tidy库数据处理技巧

## 3.1 数据转换技巧

### 3.1.1 数据类型转换

在数据处理的过程中,数据类型转换是基础且重要的一步。不同的数据类型会影响到后续的数据分析和处理。例如,数值型数据和分类型数据在进行统计分析时,所使用的函数和方法可能会有所不同。

在Tidy库中,数据类型转换主要通过`mutate()`函数来实现。`mutate()`函数可以创建新列,也可以用来修改或转换现有列的数据类型。

```r

library(tidyverse)

# 示例:将字符型数据转换为数值型

df <- tibble(

a = c("1", "2", "3"),

b = c("4", "5", "6")

)

df <- df %>%

mutate(a = as.numeric(a),

b = as.numeric(b))

```

在这个例子中,我们首先创建了一个包含字符型数据的tibble数据框`df`。然后通过`mutate()`函数和`as.numeric()`函数,将字符型数据转换为数值型数据。

### 3.1.2 数据格式转换

除了数据类型转换,数据格式转换也是数据处理中的常见需求。例如,有时候我们需要将数据从宽格式转换为长格式,或者反过来,以便于分析。

Tidy库提供了`pivot_longer()`和`pivot_wider()`函数来实现这种转换。`pivot_longer()`函数将宽格式数据转换为长格式数据,而`pivot_wider()`函数则将长格式数据转换为宽格式数据。

```r

# 示例:将宽格式数据转换为长格式

df_wide <- tibble(

id = c(1, 2, 3),

a = c(4, 5, 6),

b = c(7, 8, 9)

)

df_long <- df_wide %>%

pivot_longer(cols = -id, names_to = "var", values_to = "value")

# 示例:将长格式数据转换为宽格式

df_wider <- df_long %>%

pivot_wider(names_from = var, values_from = value)

```

在这个例子中,我们首先创建了一个宽格式的tibble数据框`df_wide`,然后使用`pivot_longer()`函数将其转换为长格式的`df_long`。接着,我们使用`pivot_wider()`函数将长格式的`df_long`转换回宽格式的`df_wider`。

通过这些数据转换技巧,我们可以更灵活地处理和分析数据,满足各种数据分析需求。在接下来的章节中,我们将继续深入探讨如何处理缺失值和数据过滤与选择等数据处理技巧。

## 3.2 缺失值处理

### 3.2.1 缺失值识别

缺失值是数据分析中常见的问题,它们可能会对分析结果产生重大影响。因此,正确识别和处理缺失值是非常重要的。

在R语言中,缺失值通常用`NA`表示。在使用Tidy库进行数据处理时,我们可以使用`is.na()`函数来识别数据框中的缺失值。

```r

# 示例:识别缺失值

df <- tibble(

a = c(1, 2, NA, 4),

b = c(NA, 5, 6, 7)

)

df %>%

mutate(

a_is_na = is.na(a),

b_is_na = is.na(b)

)

```

在这个例子中,我们创建了一个包含缺失值的数据框`df`,然后使用`mutate()`函数和`is.na()`函数来创建两个新列,分别表示列`a`和列`b`中的缺失值情况。

### 3.2.2 缺失值填充与删除

识别出缺失值之后,下一步就是决定如何处理这些缺失值。常见的处理方法包括填充缺失值或删除含有缺失值的行或列。

在Tidy库中,我们可以使用`replace_na()`函数来填充缺失值,使用`drop_na()`函数来删除含有缺失值的行。

```r

# 示例:填充缺失值

df <- tibble(

a = c(1, 2, NA, 4),

b = c(NA, 5, 6, 7)

)

df <- df %>%

mutate(a = replace_na(a, 0))

# 示例:删除含有缺失值的行

df <- df %>%

drop_na()

```

在这个例子中,我们首先创建了一个包含缺失值的数据框`df`,然后使用`mutate()`函数和`replace_na()`函数将列`a`中的缺失值替换为0。接着,我们使用`drop_na()`函数删除了含有缺失值的行。

通过缺失值处理技巧的学习,我们可以更好地掌握如何处理数据中的缺失值,确保数据分析的准确性和可靠性。在下一节中,我们将讨论数据过滤与选择的技巧,这对于进一步的数据清洗至关重要。

# 4. Tidy库高级应用

### 4.1 数据合并与重塑

在数据分析过程中,我们经常需要合并多个数据集以获得更全面的信息,或者重塑数据结构以便于分析。Tidy库提供了多种方法来实现数据的合并与重塑,这些技术对于处理复杂的数据集尤其重要。

#### 4.1.1 数据合并的概念和方法

数据合并是将两个或多个数据集中的行组合在一起,基于一个或多个共同的键值。在R语言中,`dplyr`包提供了`bind_rows`和`bind_cols`函数来进行行合并和列合并。此外,`merge`函数也经常用于基于键值的合并。

```r

# 示例代码:使用bind_rows合并数据集

library(dplyr)

# 创建两个数据集

df1 <- tibble(id = 1:3, value = c("A", "B", "C"))

df2 <- tibble(id = 2:4, value = c("D", "E", "F"))

# 使用bind_rows合并数据集

df_combined <- bind_rows(df1, df2)

```

#### 4.1.2 数据重塑的技术

数据重塑通常指的是将数据从宽格式转换为长格式,或者从长格式转换为宽格式。`tidyr`包中的`pivot_longer`和`pivot_wider`函数可以实现这一功能。

```r

# 示例代码:使用pivot_longer将数据集转换为长格式

library(tidyr)

# 创建宽格式数据集

df_wide <- tibble(id = 1:3, x = c(10, 20, 30), y = c(15, 25, 35))

# 使用pivot_longer转换为长格式

df_long <- pivot_longer(df_wide, cols = -id)

```

在上述代码中,我们首先创建了一个宽格式的数据集`df_wide`,然后使用`pivot_longer`函数将其转换为长格式`df_long`。这个过程中,`cols = -id`参数指定了除了`id`列以外的所有列都需要被转换。

### 4.2 字符串处理

字符串处理是数据清洗中的一项重要技能。Tidy库提供了多种函数来处理字符串,如`str_detect`、`str_extract`、`str_replace`等。

#### 4.2.1 字符串操作的基本方法

字符串操作通常包括检测、提取和替换等操作。以下是一个使用`str_extract`提取字符串中数字的例子。

```r

# 示例代码:使用str_extract提取字符串中的数字

library(stringr)

# 创建包含字符串的数据集

df <- tibble(text = c("item1", "item20", "item300"))

# 使用str_extract提取数字

df$numbers <- str_extract(df$text, "\\d+")

```

#### 4.2.2 正则表达式在字符串处理中的应用

正则表达式是一种强大的文本处理工具,它允许我们在字符串中进行复杂的模式匹配。以下是一个使用正则表达式匹配电子邮件地址的例子。

```r

# 示例代码:使用正则表达式匹配电子邮件地址

library(stringr)

# 创建包含文本的数据集

df <- tibble(emails = c("***", "invalidemail", "***"))

# 使用正则表达式匹配电子邮件地址

df$isValidEmail <- str_detect(df$emails, "\\b[A-Za-z0-9._%+-]+@[A-Za-z0-9.-]+\\.[A-Z|a-z]{2,}\\b")

```

### 4.3 时间序列数据处理

时间序列数据在金融、经济学、气象学等领域非常常见。Tidy库中的`tsibble`包专门用于处理时间序列数据。

#### 4.3.1 时间序列数据的特点

时间序列数据具有时间依赖性、周期性等特征。在进行数据分析时,我们需要考虑这些特性。

#### 4.3.2 时间序列数据的处理技巧

在处理时间序列数据时,我们可能需要进行插值、平滑、季节性调整等操作。以下是使用`tsibble`和`feasts`包进行时间序列分析的一个简单示例。

```r

# 示例代码:使用tsibble和feasts进行时间序列分析

library(tsibble)

library(feasts)

# 创建时间序列数据集

ts_data <- tsibble(

index = date,

data = tibble(

date = seq(as.Date("2020-01-01"), by = "month", length.out = 12),

value = rnorm(12)

)

)

# 使用feasts包进行时间序列分析

ts_data %>%

autoplot(value) +

ggtitle("Time Series Plot")

```

在上述代码中,我们首先创建了一个包含日期和随机数的时间序列数据集`ts_data`。然后,使用`feasts`包的`autoplot`函数绘制了时间序列图。

通过本章节的介绍,我们可以看到Tidy库在数据合并与重塑、字符串处理以及时间序列数据处理方面的强大功能。这些技术不仅能够帮助我们更有效地处理数据,还能够让我们在数据分析中发现更多的洞察。下一章节,我们将深入探讨Tidy库在数据清洗中的具体应用和技巧。

# 5. Tidy库实战案例分析

## 5.1 数据清洗项目概述

### 5.1.1 项目背景和目的

在数据分析和数据科学的实际工作中,数据清洗是至关重要的一步。高质量的数据是确保分析结果可靠性和准确性的基础。Tidy库作为R语言中一个强大的数据处理工具,其应用在数据清洗项目中尤为重要。本案例分析将围绕一个虚构的零售业务数据集,通过Tidy库进行数据清洗,旨在提升数据质量,为后续的数据分析和决策支持提供坚实的基础。

### 5.1.2 数据清洗前的准备

在进行数据清洗之前,我们需要对数据集进行初步的探索,以了解数据的结构和内容。这通常包括以下几个步骤:

1. **数据导入**:首先,我们需要将数据从CSV或数据库中导入到R环境中。例如,使用`read_csv`函数导入数据。

```R

library(tidyverse)

dataset <- read_csv("path/to/dataset.csv")

```

2. **初步探索**:通过`str`和`summary`函数,我们可以了解数据的基本结构和统计信息。

```R

str(dataset)

summary(dataset)

```

3. **识别问题**:检查数据集中的缺失值、异常值、重复数据等问题。

## 5.2 数据清洗实践步骤

### 5.2.1 数据导入和初步探索

假设我们的数据集包含以下列:`customer_id`, `purchase_date`, `product_id`, `quantity`, `unit_price`, `total_price`。导入数据并进行初步探索后,我们可能发现:

- `quantity`和`total_price`列中存在负数,这在实际销售数据中是不合理的。

- `product_id`列中有些值缺失,可能是数据录入错误。

- `purchase_date`列中的日期格式不统一,需要统一格式以便进行时间序列分析。

### 5.2.2 核心数据清洗流程

为了处理上述问题,我们可以使用Tidy库中的多个函数进行数据清洗:

1. **处理负数值**:我们可以使用`filter`函数来过滤掉`quantity`和`total_price`小于0的行。

```R

dataset <- dataset %>%

filter(quantity >= 0 & total_price >= 0)

```

2. **处理缺失值**:对于`product_id`的缺失值,我们可以根据其他列的信息进行填充或删除。

```R

dataset <- dataset %>%

mutate(product_id = ifelse(is.na(product_id), "Unknown", product_id))

```

3. **统一日期格式**:使用`mutate`和`parse_date_time`函数来转换`purchase_date`列的日期格式。

```R

dataset <- dataset %>%

mutate(purchase_date = parse_date_time(purchase_date, orders = "mdy"))

```

## 5.3 数据清洗结果分析与应用

### 5.3.1 数据清洗效果评估

数据清洗后的数据集应该没有明显的错误和异常。我们可以再次使用`summary`函数来评估数据清洗的效果。

```R

summary(dataset)

```

### 5.3.2 清洗后的数据分析及应用案例

数据清洗后,我们可以进行进一步的数据分析,例如:

1. **销售趋势分析**:使用`ggplot2`绘制销售趋势图。

```R

library(ggplot2)

dataset %>%

group_by(month = floor_date(purchase_date, "month")) %>%

summarise(total_sales = sum(total_price)) %>%

ggplot(aes(month, total_sales)) +

geom_line() +

labs(title = "Monthly Sales Trend")

```

2. **客户购买行为分析**:分析客户的购买频次和金额。

```R

dataset %>%

group_by(customer_id) %>%

summarise(total_purchase = sum(total_price)) %>%

arrange(desc(total_purchase))

```

通过这些步骤,我们可以确保数据集的质量,并为进一步的数据分析和商业决策提供支持。

0

0