模型诊断必修课:逻辑回归的残差分析与影响点检测

发布时间: 2024-11-20 08:31:18 阅读量: 36 订阅数: 37

SAS多元线性回归分析与残差分析实验结果和数据集

# 1. 逻辑回归概述与基础理论

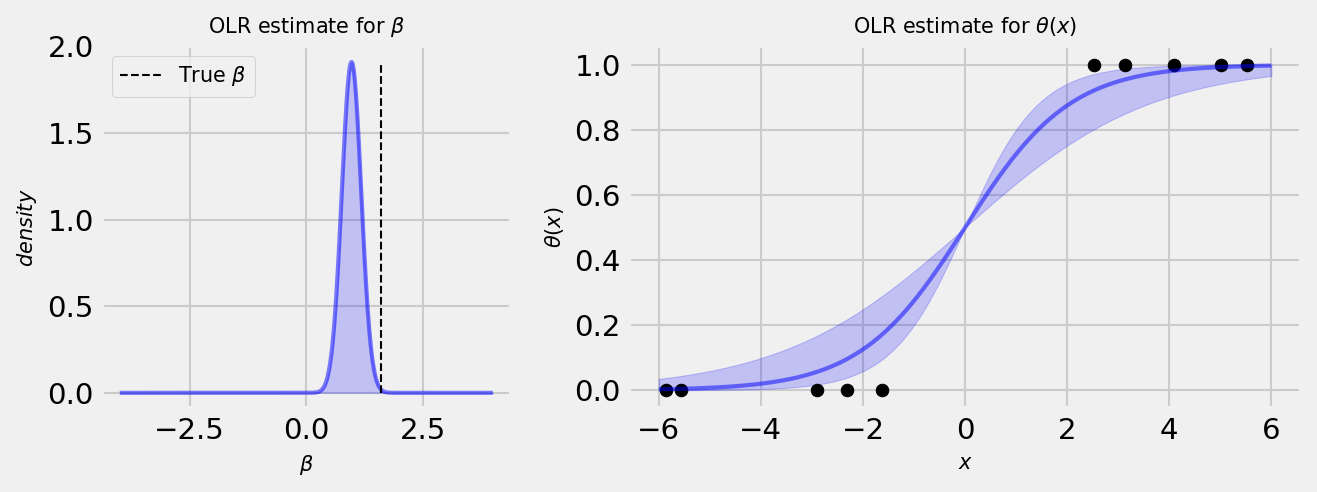

逻辑回归是一种广泛应用于分类问题的统计技术,尤其在二分类问题中表现出色。它通过使用逻辑函数估计事件发生的概率,从而将结果转换为二元输出。虽然名为回归,但逻辑回归实际上是一种分类算法,其名称源于它的基础函数——逻辑函数(也称为sigmoid函数)。

逻辑回归模型的核心在于其线性预测器,该预测器的输出通过逻辑函数映射到[0,1]区间内,使得其可以用来表示概率。逻辑函数的数学表达为:

```math

P(Y=1|X) = \frac{1}{1 + e^{-(\beta_0 + \beta_1X_1 + ... + \beta_nX_n)}}

```

其中,$P(Y=1|X)$是给定输入特征集$X$时,目标变量$Y$取值为1的概率,$\beta_0, \beta_1, ..., \beta_n$是模型参数。

为了更好地理解逻辑回归,本章将介绍该模型的历史背景、基本假设、损失函数(尤其是似然函数)、以及如何通过最大化似然函数来估计模型参数。随后,本章还将讨论逻辑回归模型的优缺点,为读者构建坚实的理论基础。

# 2. 逻辑回归模型的残差分析

### 2.1 残差的定义与重要性

#### 2.1.1 残差的基本概念

残差是统计学中的一个基础概念,表示实际观测值与模型预测值之间的差异。在逻辑回归模型中,残差可以帮助我们了解模型的预测性能和潜在问题。具体到逻辑回归,残差通常是通过实际二分类结果(0或1)与模型预测的概率值之间的差异来计算。如果残差较大,可能意味着模型对相关数据点的预测不够准确,这提示我们需要进一步检查这些数据点或对模型进行调整。

#### 2.1.2 残差在模型评估中的作用

残差分析是评估回归模型性能的重要工具。通过分析残差,我们可以发现模型是否满足线性回归的基本假设,比如残差的独立性、同方差性和正态性。在逻辑回归中,尽管残差的解释略有不同,它们仍然是诊断模型是否正确拟合数据的关键。特别是,通过对残差的深入分析,可以揭示数据中的非线性模式、异常值、或潜在的高杠杆点,从而对模型进行改进。

### 2.2 残差分析的方法论

#### 2.2.1 分类问题中的残差分析

对于二分类逻辑回归模型,残差的计算和分析略有不同。残差的计算公式可以表示为:

```python

residuals = Y - P

```

其中,`Y` 是实际的二分类结果(0或1),`P` 是模型预测的概率。在 Python 中可以使用如下的代码片段:

```python

import numpy as np

# 假设 y 实际观测值和 p 模型预测概率已经得到

y = np.array([1, 0, 1, ...])

p = np.array([0.9, 0.2, 0.8, ...])

residuals = y - p

```

#### 2.2.2 残差图的解读与应用

残差图是展示残差与预测值或某个变量之间关系的图表。在残差图中,理想的分布是随机的,没有明显的模式。如果残差图显示了一定的模式,比如曲线形状,这可能表示模型存在某种形式的偏差。

使用 Python 的 matplotlib 库,我们可以这样创建残差图:

```python

import matplotlib.pyplot as plt

plt.scatter(p, residuals)

plt.axhline(y=0, color='r', linestyle='--')

plt.xlabel('Predicted probabilities')

plt.ylabel('Residuals')

plt.title('Residual plot')

plt.show()

```

#### 2.2.3 残差正态性检验

检验残差是否符合正态分布是模型诊断的一个重要步骤。正态性检验可以使用 Shapiro-Wilk 测试或者通过绘制 Q-Q 图(Quantile-Quantile Plot)来直观判断。在 Python 中,可以使用 `scipy.stats` 模块中的 `shapiro` 函数来执行 Shapiro-Wilk 测试:

```python

from scipy.stats import shapiro

stat, p_value = shapiro(residuals)

print('Statistics=%.3f, p-value=%.3f' % (stat, p_value))

```

如果 p-value 值低于某个显著性水平(比如0.05),则拒绝正态性的原假设,认为残差分布不是正态的。

### 2.3 残差分析的实践操作

#### 2.3.1 使用统计软件进行残差分析

在统计软件(例如 SPSS 或 R)中,通常提供了可视化工具来分析残差。例如,在 R 语言中,可以通过 `plot` 函数直接对回归模型的残差进行分析:

```r

plot(model, which=1)

```

#### 2.3.2 Python/R中残差分析的实现

在 Python/R 中,可以使用 `statsmodels` 库来拟合逻辑回归模型并分析残差:

```python

import statsmodels.api as sm

# 假设 `X` 是特征变量,`y` 是二分类结果

X = ... # 特征矩阵

logit_model = sm.Logit(y, sm.add_constant(X))

result = logit_model.fit()

# 获取残差和拟合值

fitted_values = result.predict(sm.add_constant(X))

residuals = y - fitted_values

# 绘制残差图

plt.scatter(fitted_values, residuals)

plt.axhline(y=0, color='r', linestyle='--')

plt.xlabel('Fitted Values')

plt.ylabel('Residuals')

plt.title('Residual Plot for Logistic Regression')

plt.show()

```

通过对残差的深入分析,我们可以对模型的预测能力有一个更为直观的理解,并根据分析结果调整模型以提高其准确性。残差分析不仅是模型诊断的重要组成部分,也是模型优化的重要依据。

# 3. 逻辑回归中的影响点检测

在逻辑回归分析中,影响点是指在数据集中对模型参数估计产生不成比例影响的观测点。这些数据点可能会扭曲回归分析的结果,从而导致模型表现不佳或者产生误导性的结论。因此,及时识别和处理这些影响点是保证逻辑回归模型准确性和稳定性的关键步骤。

## 3.1 影响点的识别理论

### 3.1.1 影响点的定义与特征

影响点通常表现为某些观测值在数据集中的一个或多个特征上与其它数据点显著不同。它们可能因为异常的值或者极端组合的变量值而导致模型的回归系数和统计检验显著变化。识别影响点首先需要理解其特征,包括:

- **杠杆值(Leverage)**: 表示观测点在模型输入空间中的位置。高杠杆值表明数据点在输入空间中距离其他点较远。

- **Cook's距离**: 结合了残差大小和杠杆值,测量一个或多个观测值对回归参数估计的影响。

- **标准化残差**: 用来识别数据点是否偏离模型预测的响应变量值。

### 3.1.2 影响点对模型的影响机制

影响点可能导致以下几种模型失真:

- **参数估计偏差**: 影响点可以使得逻辑回归模型参数的估计产生偏差,从而影响模型的解释能力。

- **模型假设违反**: 影响点可能违反了逻辑回归模型的重要假设,如独立性、线性关系或变量的正态性等。

- **预测不准确**: 当模型被影

0

0