【Hadoop集群数据流处理】:解析XML文件的关键角色

发布时间: 2024-10-26 21:09:52 阅读量: 3 订阅数: 6

# 1. Hadoop集群数据流处理概述

在大数据处理的领域中,Hadoop集群提供了一个可扩展、高可靠的计算框架,它允许系统管理员和数据工程师高效地处理海量数据集。数据流处理是这一框架的核心功能之一,涉及从数据源获取数据,执行转换操作,并将其输出到目的地。本章将概述Hadoop集群数据流处理的基本概念、组件及其在现代数据处理中的重要性。

## 1.1 Hadoop集群的基本功能

Hadoop集群是由一系列计算机节点组成的分布式系统,这些节点可以被配置为执行存储和计算任务。它能够处理结构化、半结构化和非结构化数据,而且随着数据量的增加,系统可以通过简单地增加节点来扩展其处理能力。数据流处理主要依赖于Hadoop的核心组件,即Hadoop分布式文件系统(HDFS)和MapReduce计算模型。

## 1.2 数据流处理在Hadoop中的实现

数据流处理通过MapReduce模型实现,该模型将处理任务分为两个主要阶段:Map阶段和Reduce阶段。在Map阶段,输入数据被转换成键值对;然后这些键值对被分发到Reduce阶段,进行汇总和处理。对于数据流处理,这一过程可以被看作是实时的或批量的,取决于数据到达的速度和处理的频率。

## 1.3 Hadoop集群数据流处理的挑战与优化

尽管Hadoop是一个强大的数据处理平台,但它在处理实时数据流时面临着一些挑战,例如延迟问题和资源优化。为了解决这些问题,Hadoop社区开发了新的工具和算法来优化集群性能,例如YARN资源管理器和HDFS快照功能。这些改进有助于提高数据处理的速度和效率,同时降低了处理大规模数据流的复杂性。

通过以上内容,我们为Hadoop集群数据流处理领域奠定了基础,并为进一步深入探讨Hadoop生态系统与XML文件处理的关联打下了坚实的基础。

# 2. Hadoop生态系统与XML文件

### 2.1 Hadoop生态系统简介

#### 2.1.1 Hadoop的核心组件

Hadoop的核心组件包括HDFS(Hadoop Distributed File System)、MapReduce以及YARN(Yet Another Resource Negotiator)。HDFS负责存储大数据,提供高吞吐量的数据访问;MapReduce是Hadoop的核心编程模型,用于处理和生成大数据集;YARN则负责资源管理和作业调度。

这些组件共同作用,支持了大规模数据的分布式处理和计算。Hadoop的可扩展性、高容错性和成本效益是其在大数据领域广受欢迎的主要原因。

#### 2.1.2 Hadoop与大数据的关系

Hadoop是大数据分析的基石之一,它为存储和处理PB级别的数据提供了可能。在大数据的背景下,Hadoop生态系统组件可以通过横向扩展,应对数据量激增的挑战。Hadoop的分布式架构,加上其处理非结构化数据的能力,使其成为了处理大数据问题不可或缺的工具。

### 2.2 XML文件在数据处理中的地位

#### 2.2.1 XML文件结构和特点

XML(Extensible Markup Language)是一种标记语言,用于存储和传输数据。它的自描述性质使得XML文件可以广泛应用于数据交换。XML文件由元素(elements)、属性(attributes)和实体(entities)组成,支持嵌套结构,可以很好地表现树状或层次数据。

XML的可读性和结构化特点使得它在各种应用场景中都大有用武之地,尤其是在需要描述复杂数据关系的情况下。

#### 2.2.2 XML与大数据处理的相关性

随着大数据时代的到来,XML作为数据交换格式的使用越来越多。在进行大数据处理时,XML数据往往需要被转换为更适合大规模处理的格式,如JSON或者二进制格式。然而,由于某些遗留系统和特定行业标准的原因,XML仍然作为一种重要的数据交换格式存在。

在Hadoop生态系统中,将XML数据有效地集成和处理,是很多数据工程实践的重要环节。利用Hadoop的相关组件,可以实现高效且可扩展的XML数据处理。

在接下来的章节中,我们将深入探讨如何在Hadoop集群中集成和优化XML文件的处理,以及实际案例中的应用。我们将分析不同XML解析技术的优劣,并通过实践案例展示如何使用Hadoop处理XML数据流。

# 3. XML文件解析技术与Hadoop的集成

## 3.1 XML解析技术基础

### 3.1.1 DOM解析法

DOM(文档对象模型)解析是一种将XML文档加载成树状结构的方法,每一个节点代表文档的一部分。DOM解析法在解析整个XML文件之后,可以进行随机访问和修改,但它需要将整个文档加载到内存中,这在处理大型文件时可能会导致性能问题。

```xml

<!-- 示例的XML数据 -->

<books>

<book>

<title>Learning XML</title>

<author>Erik T. Ray</author>

<year>2003</year>

</book>

<!-- 更多的book节点 -->

</books>

```

在Java中使用DOM解析器:

```java

import org.w3c.dom.Document;

import javax.xml.parsers.DocumentBuilder;

import javax.xml.parsers.DocumentBuilderFactory;

DocumentBuilderFactory factory = DocumentBuilderFactory.newInstance();

DocumentBuilder builder = factory.newDocumentBuilder();

Document doc = builder.parse("books.xml");

// 通过DOM操作节点

NodeList books = doc.getElementsByTagName("book");

for (int i = 0; i < books.getLength(); i++) {

Node book = books.item(i);

// 读取节点信息

}

```

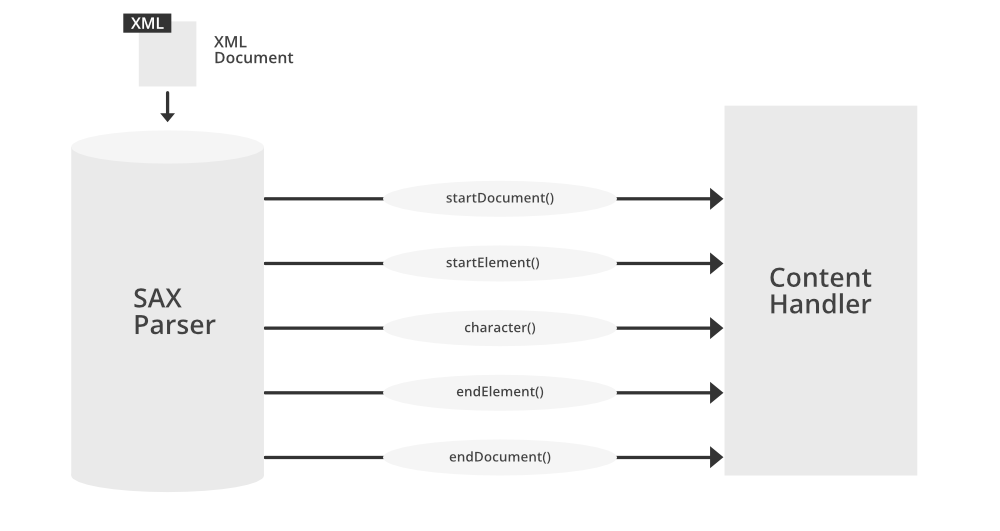

### 3.1.2 SAX解析法

SAX(简单API用于XML)是一种基于事件的解析方式。与DOM不同,SAX不需要将XML文件全部加载到内存,而是按顺序读取XML文件的内容并触发一系列事件。这对于大型文件来说是一种内存效率更高的处理方式。

SAX解析器的使用示例:

```java

import org.xml.sax.helpers.DefaultHandler;

import org.xml.sax.*;

class MyHandler extends DefaultHandler {

public void startElement(String uri, String localName, String qName, Attributes attributes) throws SAXException {

// 开始解析节点

}

public void endElement(String uri, String localName, String qName) throws SAXException {

// 结束解析节点

}

// 其他必要的重写方法

}

// 创建SAX解析器

SAXParserFactory factory = SAXParserFactory.newInstance();

SAXParser saxParser = factory.newSAXParser();

saxParser.parse("books.xml", new MyHandler());

```

### 3.1.3 StAX解析法

StAX(XML流API)是另一种基于事件的解析技术,但与SAX不同的是,StAX是可拉取的,允许开发者控制解析过程。用户可以编写代码来读取下一个事件,从而实现更细粒度的控制。

StAX解析器使用示例:

```java

import javax.xml.stream.*;

XMLOutputFactory factory = XMLOutputFactory.newFactory();

XMLStreamReader reader = factory.createXMLStreamReader(new FileInputStream("books.xml"));

// 循环读取事件,直到文档结束

while (reader.hasNext()) {

int event = reader.next();

switch (event) {

case XMLStreamReader.START_ELEMENT:

// 处理开始标签

break;

case XMLStreamReader.END_ELEMENT:

// 处理结束标签

break;

// 其他事件处理

}

}

reader.close();

```

## 3.2 Hadoop中的XML解析工具

### 3.2.1 Hadoop XML解析器的选择

在Hadoop中处理XML文件,需要选择合适的解析器以适应大数据处理的需求。根据数据量和处理要求的不同,通常选择StAX解析器,因为它提供了较高的灵活性和较低的内存占用。然而,根据特定场景,也可能会选择其他解析方法。

选择解析器时需要考虑的因素包括:

- 文件大小:对于大型文件,应优先考虑低内存占用的解析器。

- 处理速度:在需要快速处理的情况下,解析器的效率显得尤为重要。

- 可扩展性:在集群环境下,解析器需要能够有效地在多节点上进行分布式处理。

### 3.2.2 集成XML解析器到Hadoop MapReduce作业

为了在Hadoop MapReduce作业中使用XML解析器,需要编写自定义的Mapper或Reducer类,这些类将集成相应的XML解析逻辑。在Mapper类中,可以对输入的XML数据流进行解析和处理,然后将结果传递给Reducer进行进一步处理。

以下是一个使用StAX解析XML数据流的基本MapReduce作业示例:

```java

public class XMLMapReduceExample {

public static class XMLMapper extends Mapper<NullWritable, Text, Text, IntWritable> {

private Text word = new Text();

private IntWritable count = new IntWritable(1);

public void map(NullWritable key, Text value, Context context) throws IOException, InterruptedException {

```

0

0