知识图谱构建手册:NLP中的构建与应用策略

发布时间: 2024-09-03 14:19:23 阅读量: 124 订阅数: 49

# 1. 知识图谱基础概念与架构

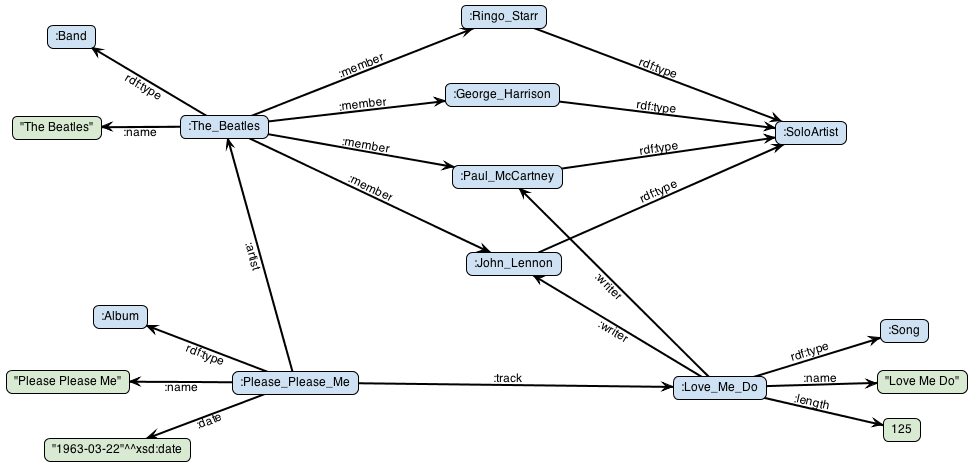

知识图谱是近年来人工智能领域发展起来的一种创新技术,它能够把大量结构化和非结构化的信息,转化为网络状的知识结构。本章节将为大家解读知识图谱的基础概念,它的核心组成部分,以及一个典型知识图谱系统的架构设计。

首先,**知识图谱基础概念**。知识图谱是采用图的结构存储实体(包括人物、地点、事件等)及其关系的语义网络。它通过实体之间的关联,描绘了现实世界中各实体的相互作用和关联关系。

接下来是**知识图谱的核心组成部分**。一个知识图谱一般由三个主要部分构成:实体(Entity)、关系(Relationship)以及属性(Attribute)。实体代表图谱中的“点”,关系代表实体间的“边”,而属性是实体的附加信息。

最后是**知识图谱的典型架构**。一般来说,知识图谱的架构可以分为四层:数据层、知识表示层、知识存储层和应用层。数据层负责数据的采集和预处理,知识表示层将处理后的数据转化为图谱形式,知识存储层负责存储和管理知识图谱,应用层则是图谱实际应用和展示的层面。

```

+----------------+ +-------------------+ +---------------------+

| | | | | |

| 数据层 +---->+ 知识表示层 +---->+ 知识存储层 |

| | | | | |

+----------------+ +-------------------+ +---------------------+

|

|

v

+------------------+

| |

| 应用层 |

| |

+------------------+

```

在理解了知识图谱的基础概念和架构后,我们将进一步深入到知识图谱在自然语言处理中的角色,以及构建知识图谱的理论方法和实践应用。

# 2. 自然语言处理在知识图谱中的角色

自然语言处理(NLP)是人工智能领域的一个重要分支,它的目标是使计算机能够理解、解释和生成人类语言。在知识图谱的构建过程中,NLP发挥着至关重要的作用,因为它能够处理和分析大量的文本数据,从而从中提取出有价值的信息来构建和丰富知识图谱。

### 2.1 NLP与知识抽取

知识抽取是构建知识图谱的基础,它的目的是从非结构化的文本数据中提取出结构化的信息,例如实体、属性、关系等。NLP通过其丰富的算法和技术,可以帮助我们完成这一任务。

#### 2.1.1 NLP在实体识别中的应用

实体识别(Entity Recognition)是识别文本中的专有名词或概念并将其分类为预定义类别(如人名、地点、组织等)的过程。NLP中的命名实体识别(NER)技术能够自动化地从文本中识别这些实体。

```python

# 示例代码:使用spaCy进行命名实体识别

import spacy

# 加载模型

nlp = spacy.load("en_core_web_sm")

# 处理文本

doc = nlp("Apple is looking at buying U.K. startup for $1 billion")

# 打印实体和标签

for ent in doc.ents:

print(ent.text, ent.label_)

# 输出可能是:

# Apple ORG

# U.K. GPE

# $1 billion MONEY

```

在上述代码中,我们使用了spaCy库来识别和分类文本中的实体。每个实体都有对应的标签,如组织(ORG)、地名(GPE)和货币金额(MONEY)。

#### 2.1.2 NLP在关系抽取中的应用

关系抽取(Relation Extraction)是确定文本中实体间的关系,如“X is the founder of Y”。NLP提供了多种方法来识别和提取这些关系。

```python

# 示例代码:使用spaCy进行关系抽取

import spacy

# 加载模型

nlp = spacy.load("en_core_web_sm")

# 处理文本

doc = nlp("Apple is looking at buying U.K. startup for $1 billion")

# 假设我们已识别出实体"Apple"和"U.K. startup"

apple = doc[0]

startup = doc[4]

# 通过依赖解析找到两者之间的关系

for token in doc:

if token.dep_ == "nsubj" and token.head == startup:

print(f"The subject of '{startup.text}' is '{token.text}'.")

# 输出可能是:

# The subject of 'startup' is 'Apple'.

```

这段代码展示了如何通过分析文本的语法依赖关系来识别实体间潜在的关系。

### 2.2 语义分析与知识图谱的丰富

NLP不仅能够帮助我们从文本中提取基本的结构化信息,还能够进行更深层次的语义分析,从而丰富知识图谱的内容。

#### 2.2.1 词义消歧

词义消歧(Word Sense Disambiguation, WSD)是一个处理同义词或短语中不同含义的技术。这对于确保知识图谱中实体的准确性和一致性至关重要。

```python

# 示例代码:使用NLTK进行词义消歧

import nltk

from nltk.corpus import wordnet

# 获取词义的相似度

synsets = wordnet.synsets("bank")

# 遍历词义

for synset in synsets:

print(f"Synset: {synset.name()} - Definition: {synset.definition()}")

# 输出可能包含不同含义的"bank":

# Synset: bank.n.01 - Definition: sloping land (especially the slope beside a body of water)

# Synset: bank.n.02 - Definition: an arrangement of similar objects in a row or in tiers

```

上述Python代码使用了NLTK库和WordNet资源来进行词义消歧。词net提供了多种词义的定义,有助于理解上下文中单词的准确含义。

#### 2.2.2 知识推理

知识推理(Knowledge Reasoning)是知识图谱中用来发现隐含信息的过程。NLP可以借助自然语言逻辑和世界知识库进行知识推理,增强知识图谱的深度和覆盖范围。

```python

# 示例代码:使用Prolog进行简单知识推理

% 知识图谱的逻辑描述

% person(john).

% person(mary).

% parent(john, mary).

% 推理规则

% grandparent(X, Y) :- parent(X, Z), parent(Z, Y).

% 查询

% ?- grandparent(john, mary).

% false.

% 知识更新

% assertz(parent(mary, susan)).

% 再次查询

% ?- grandparent(john, susan).

% true.

```

上述代码使用了Prolog逻辑编程语言来表达知识和推理规则。通过逻辑规则,我们可以发现约翰是苏珊的祖父母,即使这一信息并未直接给出。

### 小结

自然语言处理在知识图谱构建中扮演了不可替代的角色。通过实体识别、关系抽取、语义分析和知识推理等技术,NLP可以帮助我们从大量的文本数据中提取结构化信息,从而构建起丰富、准确的知识图谱。随着NLP技术的不断进步,它的应用将更加广泛和深入,进一步推动知识图谱的发展和创新。

# 3. 构建知识图谱的理论方法

### 3.1 实体识别与分类

#### 3.1.1 实体识别的方法论

实体识别(Named Entity Recognition, NER)是构建知识图谱的关键步骤之一,其目的是从文本中识别出具有特定意义的实体,如人名、地名、组织机构名等。在方法论上,实体识别通常遵循以下步骤:

1. **文本预处理**:包括分词、词性标注、句法分析等。这一阶段主要是为了将文本分解成可管理的片段,便于后续处理。

2. **特征提取**:基于统计和机器学习的方法,提取文本片段的特征,例如上下文信息、实体词典、词形、词性等。

3. **模型选择与训练**:根据不同的需求选择合适的模型(例如条件随机场CRF、深度学习模型等),并在标注好的训练数据上训练模型。

4. **实体识别**:利用训练好的模型识别新的文本中的实体。

5. **后处理**:包括实体归一化、实体消歧等,提升识别的准确性和一致性。

**代码示例**(使用Python的`nltk`库进行词性标注):

```python

import nltk

from nltk import pos_tag

from nltk.tokenize import word_tokenize

```

0

0