神经网络在语音识别中的应用:从声波到文字的5个突破

发布时间: 2024-07-15 04:27:48 阅读量: 213 订阅数: 40

语音识别:原理与应用-课件pdf_202101.rar

# 1. 语音识别的基本原理**

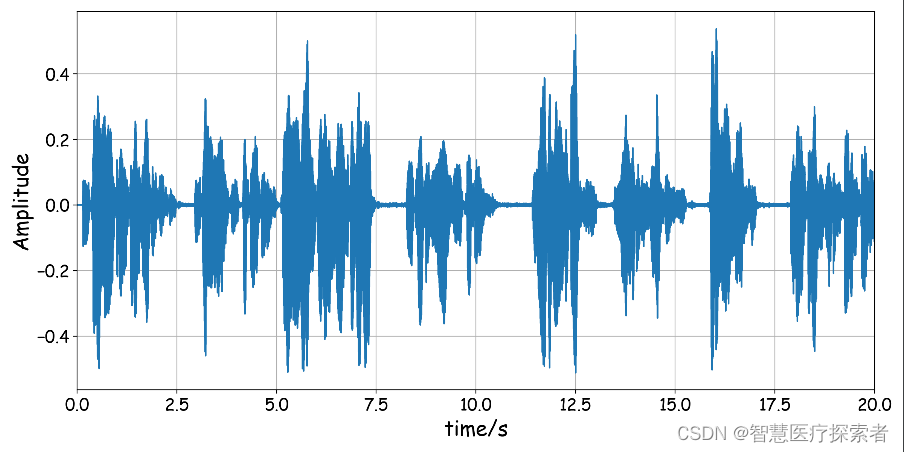

语音识别是一项将人类语音转化为文本的过程,其基本原理是将声波信号转换为数字信号,并通过机器学习算法识别语音中的模式和特征。

语音信号由一系列声波组成,这些声波具有不同的频率和振幅。语音识别系统首先将这些声波数字化,然后提取特征,如梅尔频率倒谱系数 (MFCC) 和线性预测编码 (LPC)。这些特征可以描述语音信号的声学特性,如音高、响度和共振峰。

提取特征后,语音识别系统使用机器学习算法,如隐马尔可夫模型 (HMM) 或神经网络,对这些特征进行分类。这些算法可以学习语音中不同声音和单词之间的模式,并预测最有可能的文本转录。

# 2. 神经网络在语音识别中的应用

### 2.1 神经网络的结构和工作原理

神经网络是一种受生物神经元启发的机器学习算法。它由多个层级的神经元组成,每个神经元接收来自前一层神经元的输入,并通过激活函数输出一个值。

神经网络的结构通常分为输入层、隐藏层和输出层。输入层接收原始数据,隐藏层负责特征提取和模式识别,输出层生成最终预测。

神经网络的工作原理如下:

1. **前向传播:**输入数据通过网络层层传递,每个神经元根据权重和偏差计算输出。

2. **误差计算:**网络输出与真实标签之间的误差被计算出来。

3. **反向传播:**误差通过网络层层反向传播,更新每个神经元的权重和偏差,以最小化误差。

4. **训练:**网络反复进行前向传播和反向传播,直到达到预期的准确率。

### 2.2 卷积神经网络在语音特征提取中的应用

卷积神经网络(CNN)是一种专门用于处理网格状数据的神经网络,如图像和语音信号。在语音识别中,CNN用于从语音波形中提取特征。

CNN由卷积层、池化层和全连接层组成。卷积层使用卷积核在输入数据上滑动,提取局部特征。池化层通过对局部区域内的值进行最大值或平均值操作,减少特征图的尺寸。全连接层将提取的特征映射到输出标签。

### 代码块:CNN在语音特征提取中的应用

```python

import tensorflow as tf

# 定义卷积神经网络模型

model = tf.keras.Sequential([

tf.keras.layers.Conv2D(32, (3, 3), activation='relu', input_shape=(100, 100, 1)),

tf.keras.layers.MaxPooling2D((2, 2)),

tf.keras.layers.Conv2D(64, (3, 3), activation='relu'),

tf.keras.layers.MaxPooling2D((2, 2)),

tf.keras.layers.Flatten(),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dense(10, activation='softmax')

])

# 训练模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

model.fit(x_train, y_train, epochs=10)

```

**代码逻辑分析:**

* 第一行导入TensorFlow库。

* 第二行定义卷积神经网络模型。模型由两层卷积层、两层池化层、一层展平层和两层全连接层组成。

* 第三行编译模型,指定优化器、损失函数和评估指标。

* 第四行训练模型,指定训练数据和训练轮数。

### 2.3 循环神经网络在语音序列建模中的应用

循环神经网络(RNN)是一种专门用于处理序列数据的递归神经网络。在语音识别中,RNN用于对语音序列进行建模,捕捉其时序依赖性。

RNN的结构由重复的循环单元组成,每个单元接收来自前一个单元的隐藏状态和当前输入,并输出一个新的隐藏状态和输出。

### 代码块:RNN在语音序列建模中的应用

```python

import tensorflow as tf

# 定义循环神经网络模型

model = tf.keras.Sequential([

tf.keras.layers.LSTM(128, return_sequences=True),

tf.keras.layers.LSTM(128),

tf.keras.layers.Dense(10, activation='softmax')

])

# 训练模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

model.fit(x_train, y_train, epochs=10)

```

**代码逻辑分析:**

* 第一行导入TensorFlow库。

* 第二行定义循环神经网络模型。模型由两层LSTM层和一层全连接层组成。

* 第三行编译模型,指定优化器、损失函数和评估指标。

* 第四行训练模型,指定训练数据和训练轮数。

# 3.1 数据收集和预处理

#### 数据收集

语音识别系统的构建需要大量高质量的数据。这些数据通常来自以下来源:

- **自然语音语料库:**包含真实世界中的人类语音样本。

- **合成语音语料库:**使用文本到语音合成器生成的人工语音样本。

- **转录语音语料库:**包含已转录的语音样本,可用于训练语言模型。

#### 数据预处理

收集到的原始语音数据需要进行预处理,以提高模型训练的效率和准确性。预处理步骤包括:

-

0

0