【scikit-learn聚类分析】:掌握K-means与层次聚类,对比分析2大算法

发布时间: 2024-09-30 07:20:13 阅读量: 35 订阅数: 31

# 1. scikit-learn聚类分析概述

## 简介

在数据分析的聚类分析领域中,scikit-learn库作为Python中最受欢迎的机器学习工具之一,提供了简单而强大的API,能够实现各种聚类算法。聚类算法作为一种无监督学习方法,其核心目的是将相似的数据点聚集在一起,形成有意义的分组或类别。

## 聚类分析的重要性

聚类分析在众多领域内有广泛的应用,比如市场细分、社交网络分析、图像分割以及组织大型文档集合等。通过将数据集中的样本划分为几个类别,我们可以更好地理解数据的内部结构,挖掘出隐藏在数据中的模式。

## scikit-learn在聚类中的应用

scikit-learn不仅支持传统的聚类算法如K-means和层次聚类,还提供了高级功能,例如自动选择最佳聚类数量的方法和在大数据环境下优化的聚类算法。在本章中,我们将从scikit-learn的基础用法开始,为接下来深入探讨K-means和层次聚类算法打下坚实的基础。

# 2. K-means聚类算法

### 2.1 K-means算法原理

#### 2.1.1 算法的基本概念和步骤

K-means是一种广泛使用的聚类算法,它将数据集划分为K个簇。算法的基本思想是:首先随机选择K个数据点作为初始簇中心,然后将每个数据点分配到最近的簇中心,接着重新计算每个簇的中心,这个过程重复进行,直到簇中心不再变化或达到预设的迭代次数。

该算法包含以下几个步骤:

1. 确定聚类数K。

2. 随机选择K个数据点作为初始簇中心。

3. 将数据点分配到最近的簇中心。

4. 计算每个簇的新中心。

5. 重复步骤3和步骤4,直到满足停止条件。

#### 2.1.2 算法的数学模型和优化目标

K-means算法的优化目标是使得簇内的点与簇中心的距离之和最小化,该目标函数可以定义为:

\[ J = \sum_{i=1}^{K}\sum_{x \in C_i} ||x - \mu_i||^2 \]

其中,\( J \)是目标函数,\( K \)是簇的数量,\( C_i \)是第\( i \)个簇的所有数据点的集合,\( x \)是数据点,\( \mu_i \)是第\( i \)个簇的中心。

下面是一个简单的Python代码示例,展示如何使用scikit-learn库来实现K-means算法:

```python

from sklearn.cluster import KMeans

from sklearn.datasets import make_blobs

# 生成数据集

X, _ = make_blobs(n_samples=300, centers=4, cluster_std=0.60, random_state=0)

# 实例化KMeans对象

kmeans = KMeans(n_clusters=4)

# 拟合数据

kmeans.fit(X)

# 获取聚类结果

labels = kmeans.labels_

print(f"聚类结果的标签: {labels}")

```

在上述代码中,首先生成了一个带有四个簇的数据集,然后创建了一个`KMeans`对象,并指定了簇的数量为4。接着,使用`.fit()`方法拟合数据,并通过`.labels_`属性获取了每个数据点的聚类标签。

### 2.2 K-means算法的实践应用

#### 2.2.1 使用scikit-learn实现K-means

scikit-learn库提供了一个简单而高效的方式来实现K-means算法。在实践中,我们通常会使用该库来处理数据预处理、参数设置、模型训练和预测等。

下面是一个使用scikit-learn进行K-means聚类的完整示例:

```python

import numpy as np

from sklearn.cluster import KMeans

import matplotlib.pyplot as plt

# 生成一些二维数据

X = np.random.rand(100, 2)

# 实例化KMeans对象并设置簇的数量为3

kmeans = KMeans(n_clusters=3)

# 拟合数据

kmeans.fit(X)

# 预测每个数据点的簇标签

labels = kmeans.predict(X)

# 绘制聚类结果

plt.scatter(X[:, 0], X[:, 1], c=labels, cmap='viridis', marker='o')

plt.title('K-means Clustering')

plt.show()

```

在这段代码中,我们首先创建了一个随机的二维数据集`X`。然后使用`KMeans`类指定了簇的数量为3并拟合数据。最后,我们使用`.predict()`方法来获取每个数据点的簇标签,并使用`matplotlib`将结果可视化。

#### 2.2.2 K-means算法参数调优

K-means算法具有几个关键参数需要调优,以适应不同的数据集和需求:

- **n_clusters**: 簇的数量,通常需要根据问题的上下文和领域知识来确定。

- **init**: 簇中心的初始化方法,可以选择'k-means++'(默认)或其他方法。

- **n_init**: 运行算法的次数,每次使用不同的随机中心初始化,最后选择最佳的聚类结果。

- **max_iter**: 每次运行算法的最大迭代次数。

- **tol**: 迭代停止条件,如果中心的变化量小于tol,则停止迭代。

调整这些参数,我们可以使用网格搜索(GridSearchCV)等方法,通过交叉验证来找到最佳参数组合。

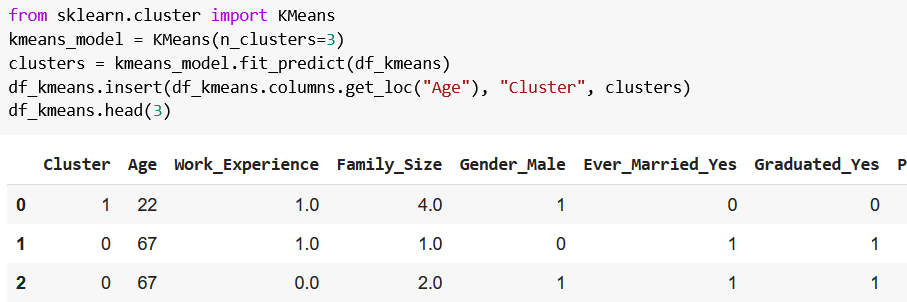

#### 2.2.3 K-means算法在实际数据集上的应用案例

下面我们通过一个实际的数据集来展示K-means聚类的应用。假设我们有一个零售商店客户数据集,我们想要根据客户的购买行为将他们分为几个群体。

```python

from sklearn.datasets import load_iris

from sklearn.preprocessing import StandardScaler

# 加载Iris数据集

iris = load_iris()

X = iris.data

# 数据标准化

scaler = StandardScaler()

X_scaled = scaler.fit_transform(X)

# 应用K-means算法

kmeans = KMeans(n_clusters=3, random_state=0)

kmeans.fit(X_scaled)

# 输出聚类结果

print(f"聚类中心: \n{kmeans.cluster_centers_}")

# 将聚类标签与原始标签比较

original_labels = iris.target

print(f"聚类标签与原始标签的对应情况: \n{kmeans.labels_ == original_labels}")

```

在这个示例中,我们使用了Iris植物数据集,并且首先进行了数据标准化处理,以避免特征尺度差异对聚类结果造成影响。然后应用K-means算法并输出了聚类中心以及聚类标签与原始标签的对应情况。

### 2.3 K-means算法的优缺点分析

#### 2.3.1 算法的时间复杂度和空间复杂度

K-means算法的时间复杂度主要取决于数据点数量`n`、簇的数量`k`、特征的数量`d`以及迭代次数`t`。大致为`O(nkt)`。由于算法需要存储所有的数据点和簇中心,空间复杂度为`O(n*d + k*d)`。

#### 2.3.2 算法的适用场景和局限性

K-means算法非常适用于大数据集,并且对于数据的形状没有严格的假设,对于球状的簇效果较好。然而,它也有一些局限性:

- 需要预先指定簇的数量,而实际中这可能是一个未知数。

- 对于具有复杂形状的簇或者不规则分布的数据效果不佳。

- 对离群点敏感,可能会导致性能下降。

- 结果可能受到初始簇中心选择的影响,得到局部最优解。

通过本章节的介绍,我们可以了解到K-means聚类算法的理论基础、实践应用及优缺点。在下一章中,我们将介绍层次聚类算法,探索另一种重要的聚类方法。

# 3. 层次聚类算法

## 3.1 层次聚类算法原理

层次聚类算法是一种通过构建数据的层次结构来实现聚类的方法,该算法不需要预先指定聚类的数量,能够产生一个聚类树状图(Dendrogram),为数据分析者提供丰富的信息。

### 3.1.1 算法的聚合策略和距离度量

聚合策略主要分为自底向上(凝聚)和自顶向下(分裂)两种。

**凝聚方法**(Agglomerative):

从每个数据点作为一个

0

0