聚类分析在客户细分策略中的应用:实战技巧与案例分享

发布时间: 2024-09-07 13:20:52 阅读量: 159 订阅数: 76

# 1. 聚类分析与客户细分策略基础

聚类分析,作为无监督学习的一种重要形式,在客户细分领域发挥着至关重要的作用。本章将从聚类分析的基本概念出发,帮助读者理解其定义与目标,同时探讨其在客户细分中的具体应用。

## 1.1 聚类分析的定义与目标

聚类分析(Cluster Analysis),是一种数据挖掘技术,旨在将大量数据根据其内在的相似性划分为多个聚类(Cluster)。每个聚类内的数据项具有较高的相似度,而与其他聚类的数据项则有较大差异性。聚类的目标是发现数据内在的分布模式,或用来作为其他分析步骤的预处理步骤,例如,用于客户细分的场景中,聚类可以帮助企业更好地了解客户群体的特征和需求。

## 1.2 聚类分析在客户细分中的作用

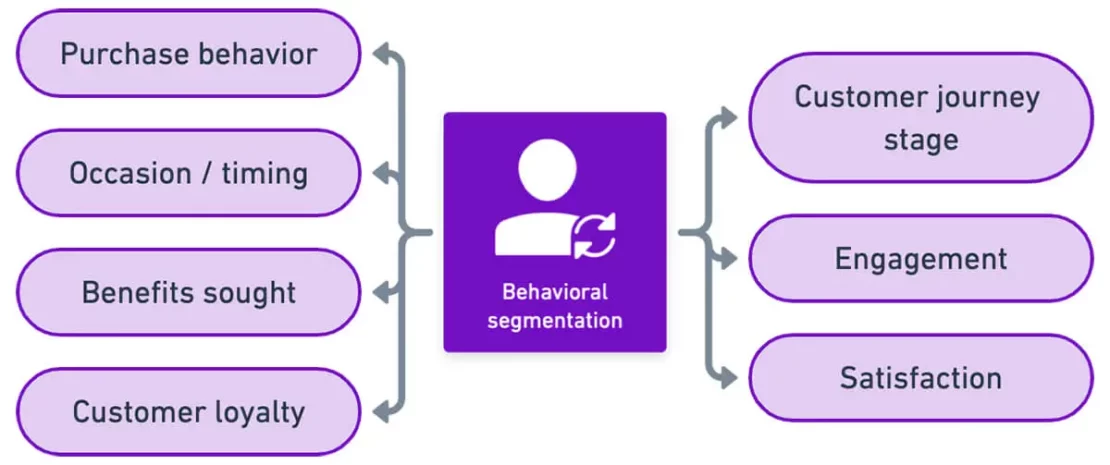

在客户细分策略中,企业可以利用聚类分析技术对客户进行有效分类。通过分析客户的购买历史、行为习惯、偏好等信息,聚类算法能够揭示出客户群体的多样性和潜在的细分市场。这样,企业便能够更有针对性地制定营销策略,如个性化推广、产品设计优化和库存管理等,从而提升客户满意度,增强市场竞争力。

# 2. 聚类分析的理论与算法

### 2.1 聚类分析的基本概念

#### 2.1.1 聚类分析的定义与目标

聚类分析是一种将个体或对象划分为多个类别或组群的统计学方法,目的是使得同一类别中的对象具有较高的相似性,而不同类别间的对象差异较大。这种技术广泛应用于数据挖掘、模式识别、市场细分、图像分析等领域。

聚类算法通常不依赖于预先定义的类标签,因此它属于无监督学习的范畴。聚类的最终目标是使得划分出的每个类群内的成员相似度最大,而类群间的相似度最小,从而可以揭示数据内在的结构或者用于后续的分析工作。

#### 2.1.2 聚类分析在客户细分中的作用

在客户关系管理中,聚类分析扮演了至关重要的角色。企业可以通过聚类分析将客户群体分为几个特征相似的细分市场。这有助于企业针对不同群体制定更有针对性的营销策略,优化资源分配,提高客户满意度和忠诚度。

聚类分析能够帮助企业识别出潜在的细分市场,发现新的商机,并且对市场变化做出快速反应。通过对客户细分的持续监控和调整,企业可以更好地满足客户需求,实现差异化竞争。

### 2.2 常用聚类算法介绍

#### 2.2.1 K-means聚类算法

K-means是一种广泛使用的聚类算法,它的核心思想是将数据点划分到K个簇中,使得每个数据点属于离它最近的均值(即簇中心)对应的簇。算法通过迭代优化的方式,交替进行数据点的簇分配和簇中心的更新,直至收敛。

K-means算法的关键在于选择合适的簇数K。如果K太小,可能导致簇内的数据点差异较大;如果K太大,可能会导致过度拟合,产生过多细小且没有实际意义的簇。

```python

# Python 示例代码:K-means算法

from sklearn.cluster import KMeans

import numpy as np

# 创建一些模拟数据

X = np.array([[1, 2], [1, 4], [1, 0],

[10, 2], [10, 4], [10, 0]])

# 使用K-means算法进行聚类

kmeans = KMeans(n_clusters=2, random_state=0).fit(X)

# 输出聚类中心和每个点的标签

print(kmeans.cluster_centers_)

print(kmeans.labels_)

```

#### 2.2.2 层次聚类算法

层次聚类算法通过计算数据点之间的距离或相似度,逐步合并或分裂数据点,构建出一个聚类的树状图(dendrogram)。树状图反映了数据点或已有簇之间的层次关系。

层次聚类的一个显著优点是不需要预先指定簇的数量,可以通过查看树状图的截断水平来确定合适的簇数。然而,层次聚类算法的计算复杂度较高,对于大数据集来说可能不适用。

```python

# Python 示例代码:层次聚类

from sklearn.cluster import AgglomerativeClustering

import matplotlib.pyplot as plt

# 创建一些模拟数据

X = np.array([[1, 2], [1, 4], [1, 0],

[10, 2], [10, 4], [10, 0]])

# 使用层次聚类算法进行聚类

cluster = AgglomerativeClustering(n_clusters=2)

cluster.fit_predict(X)

# 绘制聚类结果

plt.scatter(X[:, 0], X[:, 1], c=cluster.labels_, cmap='rainbow')

plt.title('Hierarchical Clustering Dendrogram')

plt.show()

```

#### 2.2.3 密度聚类算法DBSCAN

DBSCAN(Density-Based Spatial Clustering of Applications with Noise)是一种基于密度的空间聚类算法,其核心思想是将具有足够高密度的区域划分为簇,并能在带有噪声的空间数据库中发现任意形状的聚类。

DBSCAN算法的主要参数包括ε(邻域半径)和MinPts(形成密集区域所需的最小点数)。它能够处理大规模的数据集,并且对噪声点不敏感,这使得它在许多实际应用中非常有吸引力。

```python

# Python 示例代码:DBSCAN算法

from sklearn.cluster import DBSCAN

from sklearn.datasets import make_moons

import matplotlib.pyplot as plt

# 创建一些模拟的月牙形数据

X, _ = make_moons(n_samples=300, noise=0.05, random_state=42)

# 使用DBSCAN算法进行聚类

dbscan = DBSCAN(eps=0.2, min_samples=5).fit(X)

# 输出聚类结果

print(dbscan.labels_)

# 绘制聚类结果

plt.scatter(X[:, 0], X[:, 1], c=dbscan.labels_, cmap='rainbow')

plt.title('DBSCAN Clustering')

plt.show()

```

### 2.3 算法选择与评估标准

#### 2.3.1 算法选择的依据和原则

选择合适的聚类算法依赖于数据的特性、业务需求以及算法本身的优缺点。例如,K-means算法适合于划分球形簇,而层次聚类适合于小数据集,DBSCAN适合于发现任意形状的簇。

选择算法时,还需要考虑算法的可扩展性、计算效率和聚类效果。在实际应用中,往往需要对多种算法进行比较,根据实际效果来选择最优方案。

#### 2.3.2 聚类效果的评估指标

聚类效果的评估指标包括轮廓系数、戴维森堡丁指数(DBI)、Calinski-Harabasz指数等。这些指标从不同的角度来评价聚类结果的质量。

- 轮廓系数结合了聚类的紧凑度和分离度,其值越接近1表示聚类效果越好。

- DBI衡量的是簇内距离与簇间距离的比值,其值越小表示聚类效果越好。

- Calinski-Harabasz指数则衡量的是聚类间和聚类内的方差比,其值越大表示聚类效果越好。

在实践中,需要根据具体问题和数据特性选择合适的评估指标,或者综合多个指标来决定最终的聚类算法。

在聚类分析的理论与算法章节中,我们深入探讨了聚类分析的基本概念和常用算法,为后续深入实践操作技巧和案例分析奠定了坚实的理论基础。随着数据科学和机器学习的不断进步,聚类分析作为一种基础且广泛应用的技术,在客户细分以及其他领域中将继续扮演着重要的角色。

# 3. 聚类分析实践操作技巧

在聚类分析中,实践操作技巧是将理论转化为实际应用的关键。正确处理数据、优化算法参数以及对聚类结果进行深入解读,可以极大地提升客户细分的精度和效率。本章将详细介绍这些实践操作技巧,以帮助读者有效地在客户细分策略中应用聚类分析。

## 3.1 数据预处理方法

### 3.1.1 缺失值处理

在客户数据中,缺失值是常见的问题,它可能由于数据录入错误或信息收集不完整导致。缺失值会影响聚类分析的准确性,因此必须进行处理。常用的方法包括:

- **删除含有缺失值的记录**:如果数据集足够大,删除含有缺失值的记录可能是一个简单有效的选择。

- **填充缺失值**:使用统计方法,如平均数、中位数或者众数来填充缺失值。

- **使用算法处理缺失值**:比如基于模型的插补(Model-based Imputation)。

例如,使用Py

0

0