并行化快速排序:在大数据环境下如何提升排序效率?

发布时间: 2024-09-13 14:17:34 阅读量: 96 订阅数: 30

# 1. 并行排序算法基础与快速排序简介

快速排序是一种高效的排序算法,由C. A. R. Hoare在1960年提出。它采用了分而治之的策略,通过一个轴点元素将数组分为两部分,一部分包含小于轴点的元素,另一部分包含大于轴点的元素,然后递归地排序两个子数组。快速排序的平均时间复杂度为O(n log n),空间复杂度为O(log n)。

快速排序在实际应用中非常广泛,特别是在数据量较大的情况下,其优异的性能使其成为许多开发者排序的首选。然而,快速排序的性能在最坏情况下会退化到O(n^2),因此,对算法的优化和改进,例如引入随机化和三数取中法等技术,可以在一定程度上避免这种情况的发生。

随着多核处理器的普及,传统的快速排序算法也需要并行化以充分利用现代硬件的多核计算能力。在下一章中,我们将深入探讨并行快速排序的理论基础,分析大数据环境下对排序算法的新要求,并介绍并行处理的基本原理。

# 2. 并行快速排序的理论基础

## 2.1 大数据与并行处理的概念

### 2.1.1 大数据对排序算法的要求

在当今信息爆炸的时代,大数据的规模和复杂性日益增加。大数据环境下的排序算法面临着诸多挑战,如数据量巨大、数据结构多样化、数据实时性和时效性的要求增高,以及对排序算法的计算效率和内存消耗有着严苛的要求。

大数据对排序算法的要求主要体现在:

- **效率性**:在大数据量下,排序算法应具有较高的计算效率,能在合理的时间内完成排序操作。

- **可扩展性**:算法应能处理比内存大得多的数据量,要求算法具备良好的外部排序能力。

- **鲁棒性**:在数据质量和数据完整性有波动的条件下,算法仍能保持稳定的排序性能。

- **资源使用优化**:在满足效率和准确性的前提下,最小化内存和计算资源的使用。

### 2.1.2 并行处理的基本原理

并行处理是大数据处理的一个核心概念,它通过同时利用多个计算资源(如处理器、核心或节点)来处理数据,从而提高整体的计算性能和效率。

并行处理的基本原理包括:

- **任务分解**:将大数据处理任务拆分成多个可以并行执行的小任务。

- **资源分配**:将计算资源合理分配给各个并行任务,以实现高效计算。

- **负载均衡**:确保所有并行任务的工作负载相对平衡,避免部分任务过载或闲置。

- **数据依赖管理**:处理好各个任务间的数据依赖关系,确保数据一致性。

- **同步和通信**:协调并行任务间的执行顺序和数据交换。

## 2.2 快速排序算法分析

### 2.2.1 快速排序的工作原理

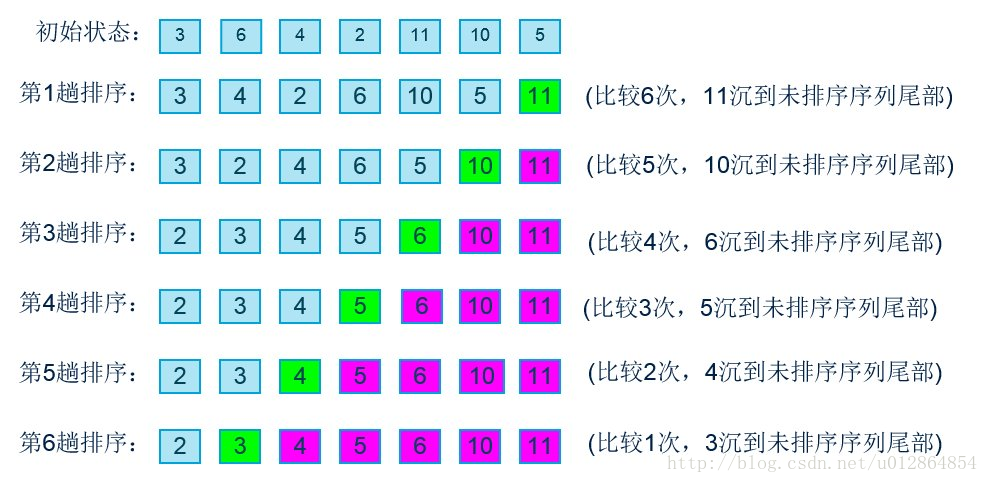

快速排序(Quick Sort)是一种高效的排序算法,它采用分治法(Divide and Conquer)策略来对序列进行排序。快速排序的核心思想是:

1. **选择基准值(Pivot)**:在待排序列中选取一个元素作为基准。

2. **分区操作(Partitioning)**:重新排列序列,所有比基准值小的元素摆放在基准前面,而所有比基准值大的元素摆在基准后面。这一步完成后,基准就处于数列的中间位置。

3. **递归排序子序列**:递归地对基准前后的子序列进行快速排序。

### 2.2.2 快速排序的时间复杂度和空间复杂度

快速排序在平均情况下的时间复杂度为O(n log n),其中n是序列长度。这是因为它每次将问题规模减少为原来的一半,然后递归地处理子问题。

然而,在最坏的情况下,如果每次分区操作都只能将序列分成两个极端的部分(例如每次选择的基准值都是最小或最大的元素),时间复杂度会退化为O(n^2)。为避免这种情况,通常采用随机化基准选择的策略。

空间复杂度方面,快速排序在原地排序的版本中,不需要额外的存储空间,因此空间复杂度为O(log n),主要由递归函数的栈空间决定。而如果采用非原地排序(如使用链表),空间复杂度可以达到O(n)。

## 2.3 并行快速排序的理论优势

### 2.3.1 并行快速排序的适用场景

并行快速排序适用于数据规模庞大,且能被有效分解成多个子任务进行并行处理的场景。以下是一些典型的适用场景:

- **大规模数据集**:对于需要排序的大量数据,尤其是可以在多个处理器之间分配的数据集。

- **实时数据处理**:在要求低延迟的环境中,如金融市场的交易数据排序。

- **分布式系统**:在分布式环境中,节点可以独立执行排序任务,而后聚合结果。

### 2.3.2 并行快速排序与传统快速排序的对比

并行快速排序与传统快速排序相比,最大的优势在于其能利用多核或分布式计算环境来加速排序过程。与传统快速排序相比,有以下几个显著的差异:

- **加速比**:并行快速排序可以显著减少排序所需时间,尤其是当数据量非常大时。

- **可扩展性**:并行快速排序更容易扩展到更大的数据集和更多的处理器。

- **资源需求**:并行快速排序需要更多的同步和通信资源,但这通常可以通过有效的设计得到平衡。

- **复杂性**:并行快速排序的实现通常比传统快速排序复杂,需要考虑并发控制和数据依赖管理问题。

通过这些对比,可以清楚地看到并行快速排序在处理大数据和需要高性能计算场景时的优势。然而,这也意味着它需要更细致的设计和实现,以实现真正的性能提升。

# 3. 并行快速排序的实现机制

并行快速排序的实现机制是将传统快速排序算法的核心步骤进行并行化处理,以适应多处理器环境并提高处理大规模数据的效率。在本章中,我们将深入了解分治法与并行化结合的细节,详细探讨并行快速排序的算法流程,以及并行环境下数据交换与同步的策略。

## 3.1 分治法与并行化的结合

### 3.1.1 分治法在快速排序中的应用

分治法(Divide and Conquer)是一种在计算机科学中广泛使用的算法设计范式。它将问题分解为若干规模较小但类似于原问题的子问题,递归解决这些子问题,然后再合并这些子问题的解以得到原问题的解。

在快速排序算法中,分治法的具体应用体现在以下几个步骤:

1. **划分(Partition

0

0