随机化快速排序:如何提高算法的平均执行效率?

发布时间: 2024-09-13 14:33:23 阅读量: 100 订阅数: 40

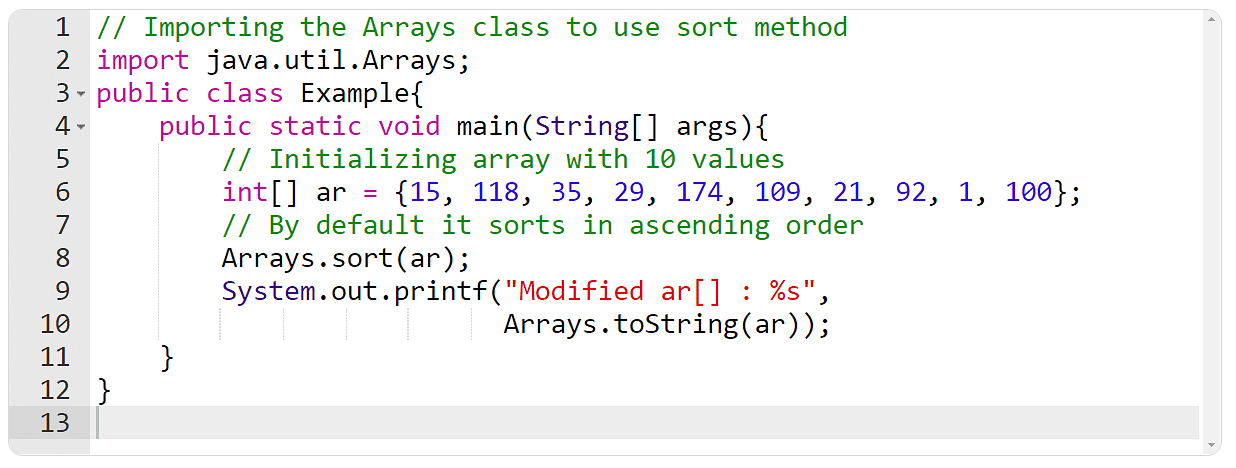

快速排序算法示例.rar

# 1. 随机化快速排序算法概述

快速排序是一种高效的排序算法,由C. A. R. Hoare在1960年提出。它的基本思想是分而治之,通过一个称为"枢轴"的元素将数据分为两部分,一部分比枢轴小,另一部分比枢轴大,然后递归地排序这两部分。

随机化快速排序是在传统快速排序的基础上的一种改进,它在选择枢轴元素时引入随机性,从而减少最坏情况的发生,提高排序效率。与传统快速排序相比,随机化快速排序通常能提供更为稳定的平均性能表现。

在介绍随机化快速排序之前,我们需要先了解其理论基础,包括算法原理、工作流程和性能优化等方面。这些内容将为理解随机化快速排序奠定坚实的基础,并帮助我们更好地分析其在各种场景下的实际应用。接下来,我们将深入探讨快速排序的理论基础,探究其核心工作原理和优化策略。

# 2. 快速排序的理论基础

快速排序作为一种高效且广泛应用的排序算法,其核心思想在于分治策略。理解这一策略,以及快速排序的理论基础,是掌握其实践应用的关键。本章将深入解析快速排序算法的基本原理、时间复杂度、以及其在工作流程中的具体应用。此外,还会探讨如何通过优化策略提高快速排序的性能。

### 2.1 快速排序算法介绍

#### 2.1.1 算法的基本原理

快速排序的基本原理是分而治之,通过一个“枢轴”元素将数据集划分为两部分,使得一侧的所有数据元素都比枢轴元素小,而另一侧的所有数据元素都比枢轴元素大。随后,这个过程在两部分数据集上递归进行,直到整个数据集有序。

- **枢轴的选取**:算法的效率在很大程度上依赖于枢轴元素的选择。理想情况下,枢轴应能均匀地划分数据集,避免出现最坏情况的性能下降。

- **分区过程**:一旦选定枢轴元素,数据集将围绕这个枢轴进行分区操作。这一过程通常使用双指针技术,从数据集的两端向中心扫描,直到找到应交换的元素。

#### 2.1.2 算法的时间复杂度分析

快速排序的平均时间复杂度为O(n log n),这使得它成为最快的排序算法之一。然而,其最坏情况的时间复杂度为O(n²),通常发生在数据已经有序或接近有序时。

- **最佳情况**:每次划分都能将数据集均匀分为两半,因此递归树的深度为log n,每一层的处理时间为O(n),所以总时间复杂度为O(n log n)。

- **最坏情况**:每次划分都不均匀,例如枢轴正好是最小或最大的元素,那么递归树的深度为n,每一层的处理时间仍为O(n),因此最坏情况的时间复杂度为O(n²)。

### 2.2 快速排序的工作流程

#### 2.2.1 划分过程详解

划分过程是快速排序的核心环节,它的效率直接影响整个算法的性能。以下是一个划分过程的示例代码:

```python

def partition(arr, low, high):

pivot = arr[high] # 选择最后一个元素作为枢轴

i = low - 1 # i指向比枢轴小的最后一个元素

for j in range(low, high):

if arr[j] < pivot:

i += 1

arr[i], arr[j] = arr[j], arr[i] # 交换元素

arr[i + 1], arr[high] = arr[high], arr[i + 1] # 将枢轴放到正确位置

return i + 1 # 返回枢轴的位置

```

该过程首先选取枢轴元素,然后将所有小于枢轴的元素移动到其左边,所有大于枢轴的元素移动到其右边。最后,返回枢轴元素的最终位置。

#### 2.2.2 分治策略的应用

快速排序的分治策略涉及将原问题分解为几个更小的子问题,递归地解决这些子问题,最终合并它们以求得原问题的解。在快速排序中,分治的应用体现在如下几个阶段:

1. **分解**:选择一个枢轴元素,并根据该元素对数据集进行划分。

2. **递归求解**:对枢轴划分后的两个子数据集分别进行快速排序。

3. **合并**:由于快速排序是原地排序算法,不需要合并步骤。

```mermaid

flowchart TD

A[开始排序] --> B[选取枢轴]

B --> C[划分数据集]

C --> D[对左侧数据集排序]

C --> E[对右侧数据集排序]

D --> F{左侧数据集是否已排序?}

E --> G{右侧数据集是否已排序?}

F --> |是| H[左侧递归完成]

G --> |是| I[右侧递归完成]

H --> J[左侧排序结束]

I --> K[右侧排序结束]

J --> L[整个数据集排序完成]

K --> L

```

#### 2.2.3 递归机制的实现

快速排序的递归实现直接关联到算法的效率。下面是一个快速排序的递归实现示例:

```python

def quicksort(arr, low, high):

if low < high:

pi = partition(arr, low, high)

quicksort(arr, low, pi - 1) # 对左侧子数组进行排序

quicksort(arr, pi + 1, high) # 对右侧子数组进行排序

```

递归机制保证了每次划分后,数据集的有序性逐渐增加,直到整个数据集排序完成。

### 2.3 快速排序的性能优化

#### 2.3.1 优化策略概述

为了提升快速排序的性能,尤其是在面对特定类型数据时,研究者和开发者提出了一系列优化策略。这些策略可以在不同情况下提升算法的效率,减小最坏情况发生的概率。

#### 2.3.2 常见的优化方法

一些常见的优化方法包括:

- **随机化枢轴选择**:通过随机选择枢轴元素,可以避免最坏情况的发生,从而提升算法的平均性能。

- **尾递归优化**:在某些情况下,通过尾递归技术可以减少递归调用的开销,优化内存使用。

- **三数取中法**:选取数据集中间的元素和首尾元素的中值作为枢轴,以此来获得更均匀的划分。

通过这些策略,快速排序在实际应用中的性能得到显著提升,使得它成为了多数编程语言标准库中排序函数的首选算法。

# 3. 随机化快速排序的实现

随机化快速排序是快速排序算法的改进版本,它通过引入随机元素来提高排序的效率和减少最坏情况下的性能退化。本章节将详细介绍随机化快速排序的实现方法,包括随机选择枢轴元素的过程、算法伪代码的解析以及代码实现的细节。同时,也会探讨随机化快速排序相比传统快速排序的优势,并通过实验数据进行对比分析。

## 3.1 随机化选择枢轴元素

### 3.1.1 枢轴选择的重要性

枢轴元素在快速排序算法中起着至关重要的作用,因为它决定了划分的效率。如果枢轴元素恰好是当前划分区间的中位数,那么每次划分都能将区间分成两个大小相等的部分,从而达到最优的排序效率。然而,在最坏的情况下,如果每次枢轴元素都是最小或最大的值,那么每次划分只会减少一个元素,导致算法的性能退化到O(n^2)。随机化选择枢轴元素可以有效地避免这种最坏情况的发生。

### 3.1.2 随机化方法的实现

随机化枢轴选择通常涉及以下步骤:

1. 在要排序的区间内随机选择一个元素作为枢轴。

2. 将该枢轴元素与区间末尾的元素交换位置,这样可以保证每次划分时枢轴元素的位置都是随机的。

3. 采用传统的快速排序划分方法进行排序。

实现随机化枢

0

0