Hadoop DataNode故障转移全攻略:服务连续性保障的关键步骤

发布时间: 2024-10-26 12:41:02 阅读量: 25 订阅数: 34

# 1. Hadoop DataNode故障转移概述

在现代的数据处理领域,Hadoop已经成为大数据存储和分析的基石之一。然而,任何大规模分布式系统都会面临节点故障的问题。DataNode作为Hadoop分布式文件系统(HDFS)中的工作节点,在数据存储和处理中扮演着至关重要的角色。故障转移是保证系统高可用性的重要机制,它在DataNode发生故障时能够保证数据的完整性和服务的连续性。

在这一章中,我们将介绍故障转移的概念及其在Hadoop生态中的重要性。我们会探讨故障转移在实际应用中的必要性以及它对Hadoop集群稳定性的影响。此外,本章将概括性地介绍故障转移操作的大致流程和关键点,为读者接下来深入了解Hadoop DataNode故障转移的内部机制和实践操作打下基础。通过这一章节,即便是对Hadoop刚刚入门的读者也能够对故障转移有一个初步的理解,并认识到其在整个数据存储解决方案中的重要性。

# 2. 理解Hadoop DataNode的作用与故障影响

在大数据处理和存储领域,Hadoop作为一个开源框架,为分布式环境下的数据存储和处理提供了可靠和可扩展的解决方案。Hadoop Distributed File System(HDFS)是Hadoop的核心组成部分之一,它允许用户在廉价的硬件上存储大量的数据。HDFS设计用于处理大文件,具有高吞吐量的特点,并能够提供高容错能力。在整个HDFS架构中,DataNode扮演着极其重要的角色,其正常运行直接影响到整个Hadoop集群的稳定性和性能。了解DataNode的工作原理以及当其发生故障时对整个集群的影响,对于优化和维护Hadoop环境至关重要。

## Hadoop DataNode在HDFS中的角色

### HDFS的工作原理简述

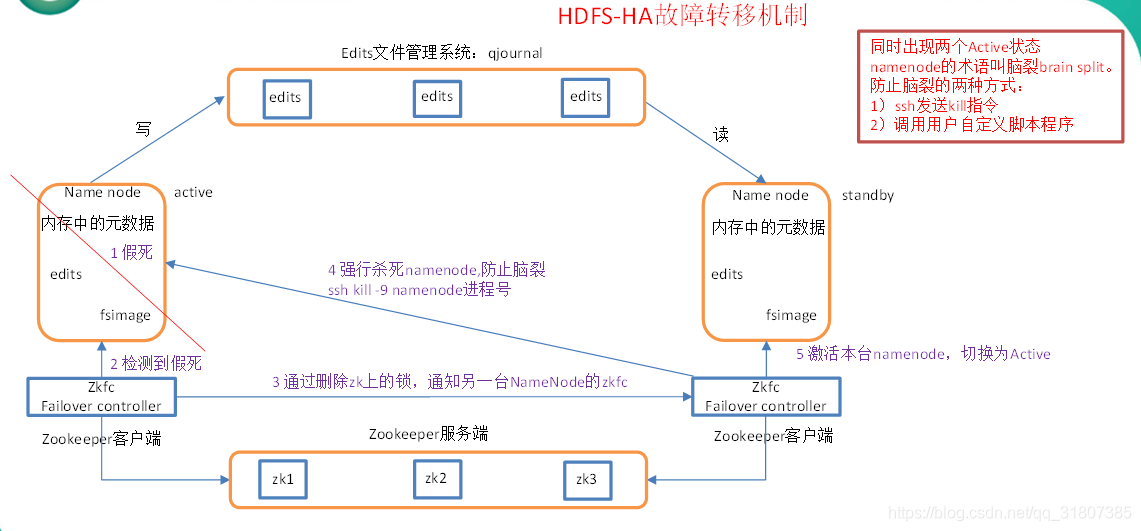

HDFS采用了主从(Master/Slave)结构来存储数据。它由一个NameNode(主节点)和多个DataNode(数据节点)组成。NameNode是中心服务器,用于管理文件系统的命名空间和客户端对文件的访问请求。它维护着文件系统树及整棵树内所有的文件和目录。这个信息以两种形式保存在内存中:一种是FsImage,它是文件系统元数据的永久性检查点;另一种是EditLog,它是对文件系统元数据所做的更改记录。DataNode则在NameNode的控制下,负责存储实际的数据块。

HDFS设计采用的是"一次写入,多次读取"的模型,文件一旦写入后就不允许修改。HDFS支持数据的追加操作,但不支持文件的随机写入。这种设计使得HDFS非常适合大规模数据集的存储与处理。

### DataNode的职责与数据存储

DataNode是HDFS中的工作节点,负责具体的数据存储和检索工作。每一个DataNode都会向NameNode注册,并周期性地报告自己的状态和已存储的数据块信息。当客户端需要读写数据时,它会与NameNode进行交互,NameNode接收到请求后,会指导客户端与相应的DataNode进行通信,完成数据的读取和写入。

DataNode将数据存储在本地文件系统中,一般情况下,这些数据块会被分割成默认大小为128MB的块(block)并进行存储。每个数据块都会被复制成多个副本(默认为3个),以保证数据的可靠性和容错性。这些副本会被分散存储在不同的DataNode上,以防止节点故障导致的数据丢失。DataNode之间的数据块复制过程是由NameNode协调完成的。

## DataNode故障对Hadoop集群的影响

### 单点故障的潜在风险

在Hadoop集群中,DataNode作为数据存储的节点,虽然不是单点故障的关键部件(NameNode才是),但其故障同样会导致数据的不可用和集群性能的下降。当一个DataNode失败,存放在该节点上的数据块副本就会丢失,如果数据块的副本数量不足,集群的可用性就会受到影响。这意味着对于依赖这些数据的应用来说,需要处理数据不可用的异常情况。

在极端情况下,如果大量的DataNode同时发生故障,甚至可能导致整个集群的失败。例如,当数据块副本丢失达到一定程度时,可能会超过NameNode设置的最小副本阈值,使得文件或目录变为不可用状态。因此,为了保持集群的高可用性,防止单点故障的风险,Hadoop提供了故障转移(failover)机制。

### 故障数据恢复过程和时效性问题

当DataNode发生故障后,Hadoop需要启动故障恢复过程以重新创建丢失的数据块副本。这个过程涉及到以下几个步骤:

1. 故障检测:当DataNode无法向NameNode发送心跳信号时,NameNode将其标记为不可用。

2. 数据恢复:NameNode会启动数据块的复制过程,从其他DataNode读取数据块的副本,并创建新的副本放在健康的DataNode上。

3. 故障恢复:当故障的DataNode恢复正常并重新加入集群时,它会首先向NameNode注册并报告其状态。之后,NameNode会根据集群当前的情况,可能指令该节点重新复制数据块或进行其他操作。

故障恢复过程的时效性问题涉及到几个关键因素,包括:

- NameNode响应故障的速度和复制数据块的调度效率。

- 剩余健康DataNode的资源和网络负载情况。

- 数据块的大小和副本数量,这决定了复制数据所需的时间。

整个恢复过程的时间长短将直接影响到集群的恢复速度和用户的应用体验。因此,对故障转移过程的优化是提高Hadoop集群可用性的关键。

通过理解DataNode的工作原理和其在HDFS中的角色,以及故障对集群的影响,IT从业者可以更好地维护和优化Hadoop环境,降低系统故障的风险,保证数据的稳定存储和高效处理。在下一章节中,我们将进一步深入探讨Hadoop的副本机制和数据冗余,这是故障转移理论基础的重要组成部分。

# 3. Hadoop DataNode故障转移的理论基础

## 3.1 Hadoop的副本机制和数据冗余

### 3.1.1 副本策略的原理

Hadoop通过其核心组件之一的HDFS(Hadoop Distributed File System)来保证数据的可靠性和高可用性。其中,副本机制是HDFS中最为关键的部分,确保了即使在硬件故障时,

0

0