Hadoop DataNode数据复制完全手册:构建高可用性的数据架构

发布时间: 2024-10-26 12:04:55 阅读量: 6 订阅数: 7

# 1. Hadoop DataNode基础概述

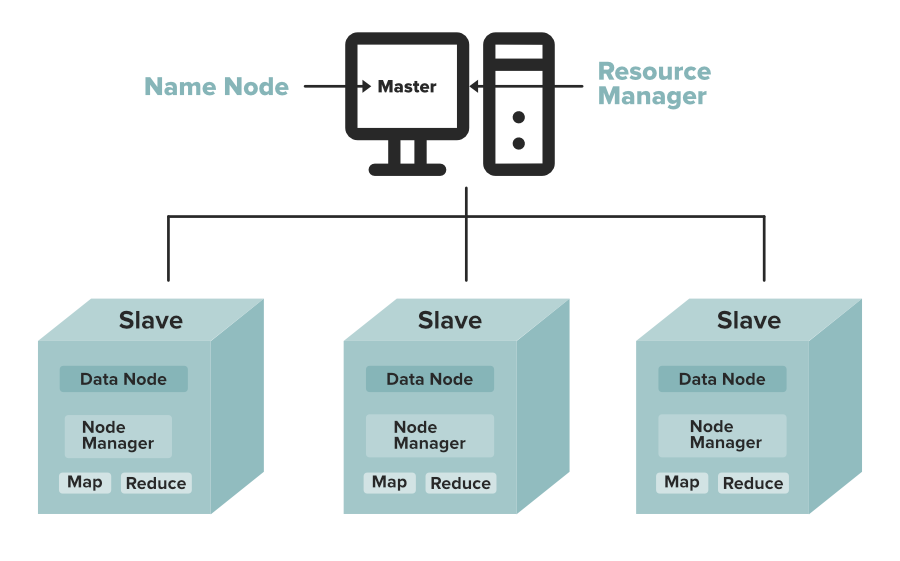

Hadoop DataNode作为Hadoop分布式文件系统(HDFS)的组成部分,是存储集群数据的节点。理解DataNode的工作原理对于维护和优化Hadoop集群至关重要。DataNode负责存储实际的数据块,并执行来自NameNode的命令,如创建、删除和复制数据块。本章将涵盖DataNode的基本概念、关键功能以及其在HDFS中的作用。

## 1.1 DataNode的角色与职责

DataNode在Hadoop集群中处理读写请求,将大型文件分割成固定大小的数据块,通常为128MB,并保存多个副本以确保数据的可靠性和容错性。副本存储的机制使得即使部分节点出现故障,数据也能够保持可用。每个DataNode定期向NameNode发送心跳信号以表明其存活状态,并报告其上的数据块信息。

## 1.2 DataNode与NameNode的交互

DataNode与NameNode的通信是HDFS稳定运行的关键。NameNode负责维护文件系统的元数据,包括文件和目录结构、每个文件的数据块映射以及数据块副本的位置信息。当客户端请求读取或写入文件时,NameNode将指定哪些DataNode参与该操作,DataNode之间会直接进行数据传输,而NameNode则监控数据传输的过程确保操作的正确完成。

# 2. DataNode数据复制机制

数据复制是分布式文件系统的核心机制之一,它确保了数据的可靠性、可用性和容错性。Hadoop的HDFS(Hadoop Distributed File System)通过DataNode的数据复制机制,提供了强大的数据冗余和恢复能力。本章将深入探讨数据复制的理论基础、实践操作以及故障排查。

## 2.1 数据复制的理论基础

### 2.1.1 HDFS中的数据复制策略

HDFS通过为每个数据块(Block)保存多个副本,实现了数据的高可靠性。Hadoop默认设置为每个Block保留三个副本,分布在不同的DataNode上,以防止硬件故障导致数据丢失。

副本的放置策略考虑了数据的本地性和机架的可靠性。首先,一个副本会被放置在写入数据的DataNode上,这是为了提高读取效率。第二个副本通常放置在与第一个副本不同的机架上,以增加容错能力。第三个副本和随后的副本则尽量分散在不同的机架上。

Hadoop还支持机架感知功能,该功能可以识别集群中节点所在的机架,以此来优化数据副本的放置,确保在机架级别的故障发生时,数据依然安全。

### 2.1.2 机架感知与数据本地性

机架感知是HDFS的一个高级特性,它允许Hadoop知道每个DataNode所在的物理位置。这一信息对于提高整体系统的性能和容错性至关重要。

当客户端请求读取数据时,HDFS会尽可能地返回最近的副本,从而减少了网络带宽的使用和响应时间。机架感知使得Hadoop能够根据数据副本的位置来优化读取操作,提升数据访问速度。

此外,通过了解数据副本的位置,HDFS可以在进行数据写入操作时,将副本均匀地分布在不同的机架中。这样即使某个机架发生故障,也不会影响到数据的完整性。

## 2.2 数据复制的实践操作

### 2.2.1 配置DataNode的数据复制参数

DataNode的数据复制参数可以在`hdfs-site.xml`配置文件中设置。核心参数包括`dfs.replication`,用于定义每个数据块的副本数量。以下是一个配置示例:

```xml

<configuration>

<property>

<name>dfs.replication</name>

<value>3</value> <!-- 默认值,根据需要可以修改 -->

</property>

<!-- 其他配置 -->

</configuration>

```

`dfs.replication`参数可以根据实际的存储需求和容错要求进行调整。对于重要性极高的数据,可以设置更高的副本数以保证更高的可靠性。

### 2.2.2 监控数据复制状态

监控DataNode的数据复制状态是确保集群健康的重要环节。可以通过Hadoop提供的Web界面或者命令行工具来查看副本分布情况。

使用`hdfs dfsadmin -report`命令可以得到集群状态报告,包括数据副本的统计信息。此命令的输出可以帮助管理员理解数据的分布和潜在的不均衡问题。

## 2.3 数据复制的故障排查

### 2.3.1 常见复制问题分析

数据复制过程中可能会出现多种问题,常见的包括网络中断导致的副本不一致、副本数量不足或过多、以及数据块损坏等。

当数据副本数量不足时,通常是因为某些DataNode节点宕机或者网络故障导致的。在这种情况下,NameNode会调度重新复制缺失的副本。

副本数量过多可能是由于NameNode的故障或者不正确的配置导致的。处理这种问题需要检查配置文件,并重启NameNode。

### 2.3.2 复制过程中的性能优化

在复制过程中进行性能优化,可以显著提高数据处理效率。一个关键的优化点是合理分配带宽资源,避免网络拥塞。

可以通过修改`dfs.namenode.replication-bandwidth`参数来限制复制过程中的带宽使用。例如,设置为100MB/s可以限制复制操作占用不超过100MB的带宽:

```xml

<property>

<name>dfs.namenode.replication-bandwidth</name>

<value>100MB/s</value>

</property>

```

此外,还可以通过调整副本放置策略,如设置`dfs.slow副本放置策略`,来优化整体的复制性能。

以上为第二章的内容,详细介绍了DataNode数据复制的理论基础、实践操作以及故障排查的策略和方法。在下一章节,我们将探讨构建高可用性数据架构的策略,包括设计原则、实现技术和案例分析。

# 3. 构建高可用性数据架构的策略

## 3.1 高可用性架构设计原则

### 3.1.1 系统的容错性与可扩展性

在构建高可用性数据架构时,系统的容错性(Fault Tolerance)和可扩展性(Scalability)是设计原则的核心要素。容错性是指系统能够在部分组件发生故障时继续正常工作,确保数据服务的连续性。为了实现这一点,架构需要内置冗余,即系统中的关键组件都应有备份,如多个NameNode和DataNode,以支持在单点故障时无缝切换。

可扩展性是指系统能够按照需求增加资源来应对数据量和服务请求的增长。在Hadoop中,水平扩展是通过增加更多的DataNode来实现的,这样不仅可以提高存储容量,还能通过分布式计算提升整体性能。

### 3.1.2 节点故障自动恢复机制

为了提升Hadoop集群的高可用性,节点故障自动恢复机制是不可或缺的。这包括故障检测、自动重启服务以及数据副本的重新同步等。故障检测通常利用心跳机制(Heartbeats)来实现,服务端节点周期性地向所有工作节点发送心跳信号,如果在指定

0

0