【数据一致性】:确保multiprocessing应用的数据安全性

发布时间: 2024-10-02 08:42:55 阅读量: 27 订阅数: 36

# 1. multiprocessing与数据一致性的基础

Python的`multiprocessing`模块为多进程编程提供了强大的支持。在多进程环境下,每个进程都有自己独立的内存空间,因此保证数据一致性成为一个核心问题。本章将为读者提供一个理解multiprocessing中数据一致性的基础框架,并阐述其在多核处理器编程中的重要性。

## 1.1 为什么需要数据一致性?

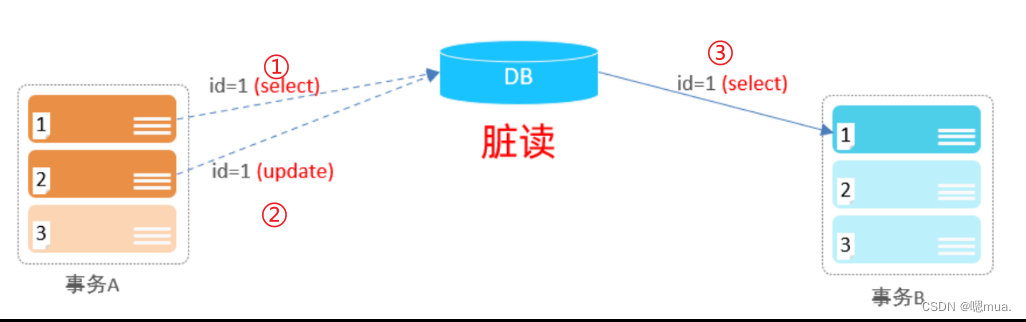

在多进程应用中,多个进程可能需要访问或修改同一份数据。数据一致性是指数据在多个进程之间共享时能够保持正确的状态和逻辑一致性的能力。数据一致性问题需要被妥善处理,否则可能导致数据竞争、数据损坏,甚至程序逻辑错误。

## 1.2 多进程环境下的数据竞争

数据竞争发生在没有适当控制的情况下,两个或多个进程同时读写同一数据项,导致数据状态不一致。在设计多进程程序时,确保数据一致性是维护程序正确性的基础。为了避免这种情况,我们可以采用同步机制,如锁(Locks),以确保任何时候只有一个进程能够操作共享数据。

## 1.3 基本同步工具的介绍

Python提供了多种同步原语来解决多进程数据竞争问题,包括但不限于锁(Locks)、信号量(Semaphores)、事件(Events)、条件变量(Conditions)等。这些工具在提供同步的同时也有可能引入死锁或降低程序的并发性能。下一章,我们将深入探讨进程间通信机制以及如何使用这些工具来保证数据一致性。

# 2. multiprocessing的进程间通信机制

## 2.1 进程间通信的基本概念

### 2.1.1 进程间通信的重要性

进程间通信(IPC, Inter-Process Communication)是指多个进程之间相互交换信息或数据的机制。在多进程程序设计中,进程间通信是至关重要的,因为它能够帮助实现进程间的同步和数据共享。同步确保进程协调执行,避免资源冲突和数据不一致;数据共享则允许进程利用彼此的工作成果,提高工作效率和系统性能。

### 2.1.2 不同进程间通信的策略

进程间通信有多种策略,主要包括以下几种:

- **管道(Pipes)**:一种单向数据流,常用于父子进程间或兄弟进程间的数据传输。

- **命名管道(Named Pipes)**:一种可以在不相关的进程间进行通信的管道。

- **消息队列(Message Queues)**:允许一个或多个进程向它写入和读取消息,适用于进程间异步通信。

- **信号量(Semaphores)**:主要用于控制多个进程对共享资源的访问。

- **共享内存(Shared Memory)**:多个进程可以同时读写内存区的数据,这是最快的一种 IPC 机制,但需要额外的同步机制来控制访问。

- **套接字(Sockets)**:允许不相关的进程或网络上的机器之间进行通信。

## 2.2 使用队列和管道进行数据交换

### 2.2.1 队列的创建与使用

在 Python 中,`multiprocessing` 模块提供了 `Queue` 类来实现进程间的数据交换。队列是一种先进先出的数据结构,允许在多进程环境中安全地交换数据。

```python

from multiprocessing import Process, Queue

def worker(queue, msg):

queue.put(f"Message: {msg}")

print(f"Process {queue} received: {msg}")

if __name__ == "__main__":

queue = Queue()

# 创建多个进程

processes = [Process(target=worker, args=(queue, f"Hello {i}")) for i in range(3)]

for process in processes:

process.start()

# 等待所有进程完成

for process in processes:

process.join()

# 读取队列中的所有数据

while not queue.empty():

print(queue.get())

```

在这个例子中,我们创建了一个队列和三个进程。每个进程向队列中添加一条消息,然后读取并打印消息。队列确保了数据在进程间的有序和安全交换。

### 2.2.2 管道的创建与使用

管道是一种更为简单的 IPC 机制,它允许两个进程间进行双向通信。

```python

from multiprocessing import Process, Pipe

def worker(conn):

while True:

try:

# 接收数据

message = conn.recv()

print(f"Received {message}")

break

except EOFError:

break

# 发送回复

conn.send("Message received")

conn.close()

if __name__ == "__main__":

parent_conn, child_conn = Pipe()

process = Process(target=worker, args=(child_conn,))

process.start()

# 向子进程发送消息

parent_conn.send("Hello, Child!")

# 接收回复

print(parent_conn.recv())

process.join()

```

在这个例子中,我们创建了一个管道,并启动了一个子进程。父进程向管道发送了一条消息,子进程接收消息并打印,然后发送回复。

## 2.3 锁和同步机制的应用

### 2.3.1 互斥锁的使用

为了防止多进程同时操作同一资源导致数据不一致,我们可以使用互斥锁(Mutex)。

```python

from multiprocessing import Process, Lock

def worker(lock, counter):

with lock:

counter.value += 1

print(f"Counter is {counter.value}")

if __name__ == "__main__":

counter = multiprocessing.Value('i', 0)

lock = Lock()

processes = [Process(target=worker, args=(lock, counter)) for _ in range(10)]

for process in processes:

process.start()

for process in processes:

process.join()

print(f"Final counter value is {counter.value}")

```

在这个例子中,我们使用了 `Lock` 来确保在任何时刻只有一个进程能够修改共享的 `Value` 对象。这避免了多个进程同时修改导致的数据不一致问题。

### 2.3.2 事件和条件变量的使用

事件(Event)和条件变量(Condition)是用于进程间同步的另一种机制。

事件允许一个进程向其他进程发出某个事件已发生的信号,而条件变量允许进程在某个条件未成立时挂起,直到其他进程改变条件并发出通知。

这里,我们将使用 `Event` 来演示如何在进程间进行协调。

```python

from multiprocessing import Process, Event

def worker(

```

0

0