PycURL在大数据处理中的应用:数据抓取与分析的创新方法

发布时间: 2024-10-15 22:10:45 阅读量: 18 订阅数: 22

# 1. PycURL简介与安装配置

## PycURL简介

PycURL是一个强大的Python库,它是libcurl的Python封装,允许开发者使用Python执行各种HTTP相关的操作,包括数据的上传、下载以及与服务器的交互。与Python标准库中的`urllib`相比,PycURL更加高效,因为它直接使用了libcurl的核心功能,后者是一个用C语言编写的、广泛使用的URL传输库。

## PycURL安装

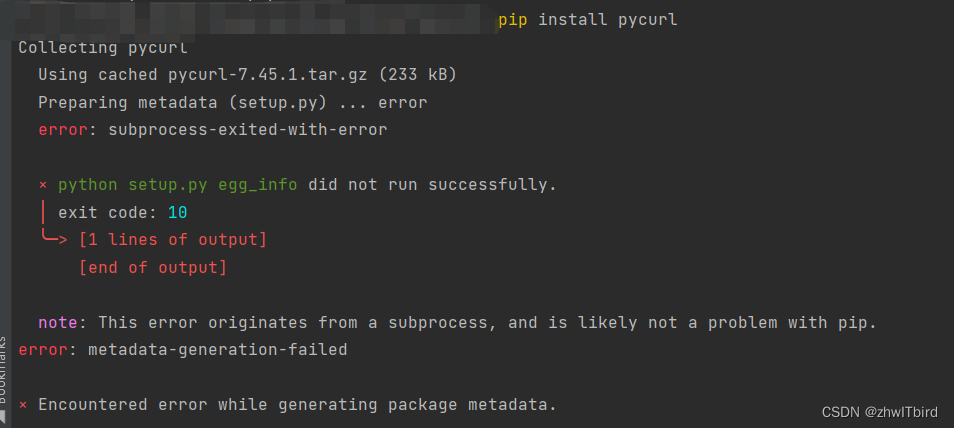

安装PycURL库可以通过Python的包管理工具pip进行,只需简单一行命令:

```bash

pip install pycurl

```

在大多数Linux发行版中,PycURL也可以通过包管理器直接安装。

## PycURL的配置

配置PycURL主要涉及设置合适的HTTP头部和处理编码问题。例如,设置HTTP头部可以通过创建`Curl`对象,并使用`setopt`方法:

```python

import pycurl

from io import BytesIO

buffer = BytesIO()

c = pycurl.Curl()

c.setopt(c.URL, '***')

c.setopt(c.WRITEDATA, buffer)

c.perform()

data = buffer.getvalue()

print(data.decode('utf-8'))

c.close()

```

在上述代码中,我们使用`setopt`方法设置了请求的URL,并且指定了将数据写入的缓冲区。执行请求后,我们从缓冲区中读取数据,并将其解码为UTF-8格式的字符串。

以上内容为第一章的概述,接下来的章节将深入探讨PycURL的使用方法和在大数据抓取中的实践应用。

# 2. PycURL的基本使用方法

## 2.1 PycURL的基本语法和参数

### 2.1.1 PycURL的安装

在本章节中,我们将详细介绍PycURL的基本语法和参数。首先,我们需要了解如何安装PycURL。PycURL是一个Python模块,它提供了libcurl的接口,允许你用Python代码发送HTTP请求。安装PycURL相对简单,可以使用pip命令进行安装:

```bash

pip install pycurl

```

安装完成后,你可以通过以下Python代码检查PycURL是否正确安装:

```python

import pycurl

from io import BytesIO

buffer = BytesIO()

c = pycurl.Curl()

c.setopt(c.URL, '***')

c.setopt(c.WRITEDATA, buffer)

c.perform()

c.close()

# 获取HTTP响应的状态码

print("Status Code:", c.getinfo(c.RESPONSE_CODE))

# 打印获取的内容

print(buffer.getvalue().decode('utf-8'))

```

这段代码尝试从 "***" 抓取内容,并将其打印出来。如果一切正常,你应该能看到 "Status Code: 200" 和网站的HTML内容。

### 2.1.2 PycURL的基本语法

PycURL的基本语法非常直接,它通过一系列的选项和设置来配置HTTP请求。以下是一些常用的选项:

- `CURL option`: `pycurl.OPTION_NAME` - 用于设置libcurl选项。

- `CURLOPT option`: `pycurl.OPT_NAME` - 用于获取libcurl选项的值。

例如,设置请求方法为POST的代码如下:

```python

c = pycurl.Curl()

c.setopt(pycurl.POST, 1)

```

### 2.1.3 PycURL的参数详解

PycURL提供了丰富的参数来配置HTTP请求。以下是一些常见的参数及其用途:

- `URL`: 设置请求的URL地址。

- `POST`: 设置是否使用POST方法。

- `POSTFIELDS`: 设置POST请求的数据体。

- `WRITEDATA`: 设置写入数据的对象。

- `HEADERDATA`: 设置HTTP请求头。

- `HTTPHEADER`: 设置额外的HTTP请求头。

例如,如何设置HTTP请求头的代码如下:

```python

c = pycurl.Curl()

headers = {'User-Agent': 'Custom User Agent', 'Accept': '*/*'}

c.setopt(c.HTTPHEADER, headers)

```

以上代码设置了自定义的 `User-Agent` 和 `Accept` 头部。

## 2.2 PycURL的数据抓取基础

### 2.2.1 单一URL的数据抓取

在本章节中,我们将介绍如何使用PycURL进行单一URL的数据抓取。这是一个基本的操作,通常用于获取网页内容。

```python

import pycurl

from io import BytesIO

url = '***'

buffer = BytesIO()

c = pycurl.Curl()

c.setopt(c.URL, url)

c.setopt(c.WRITEDATA, buffer)

c.perform()

c.close()

# 打印获取的内容

print(buffer.getvalue().decode('utf-8'))

```

### 2.2.2 多URL的数据抓取

PycURL也可以用于多URL的数据抓取,这对于需要并行处理多个请求的情况非常有用。

```python

import pycurl

from io import BytesIO

from threading import Thread

def fetch_url(url, index):

buffer = BytesIO()

c = pycurl.Curl()

c.setopt(c.URL, url)

c.setopt(c.WRITEDATA, buffer)

c.perform()

c.close()

# 将结果存储在字典中

result[index] = buffer.getvalue().decode('utf-8')

urls = ['***', '***']

result = {}

threads = []

for index, url in enumerate(urls):

thread = Thread(target=fetch_url, args=(url, index))

threads.append(thread)

thread.start()

for thread in threads:

thread.join()

# 打印结果

for index, content in result.items():

print(f"URL {index}: {content[:100]}") # 打印前100个字符

```

### 2.2.3 抓取数据的存储和处理

抓取数据后,你可能需要将其存储到文件或数据库中,或者进行进一步的处理。

```python

import pycurl

import json

import sqlite3

url = '***'

conn = sqlite3.connect('data.db')

cur = conn.cursor()

# 创建表格

cur.execute('''CREATE TABLE IF NOT EXISTS data

(url TEXT PRIMARY KEY, content TEXT)''')

# 准备插入数据的SQL语句

insert_stmt = 'INSERT INTO data (url, content) VALUES (?, ?)'

# 使用PycURL抓取数据

c = pycurl.Curl()

buffer = BytesIO()

c.setopt(c.URL, url)

c.setopt(c.WRITEDATA, buffer)

c.perform()

c.close()

# 解析JSON数据并存储

data = json.loads(buffer.getvalue())

cur.execute(insert_stmt, (data['url'], json.dumps(data)))

# 提交到数据库

***mit()

conn.close()

print("Data inserted successfully.")

```

以上代码展示了如何将抓取的JSON数据存储到SQLite数据库中。

## 2.3 PycURL的异常处理和调试

### 2.3.1 常见异常及处理方法

在使用PycURL时,可能会遇到一些异常,例如连接错误、超时等。PycURL提供了错误代码,可以帮助我们识别问题。

```python

import pycurl

from io import BytesIO

try:

c = pycurl.Curl()

c.setopt(c.URL, '***')

buffer = BytesIO()

c.setopt(c.WRITEDATA, buffer)

c.perform()

c.close()

except pycurl.error as e:

print(f"PycURL Error: {e}")

```

### 2.3.2 PycURL的调试技巧

PycURL提供了一些调试选项,可以帮助开发者了解请求的细节。

```python

import pycurl

from io import BytesIO

url = '***'

buffer = BytesIO()

# 设置调试标志

c = pycurl.Curl()

c.setopt(c.VERBOSE, 1)

c.setopt(c.URL, url)

c.setopt(c.WRITEDATA, buffer)

c.perform()

c.close()

# 打印调试信息

print(buffer.getvalue().decode('utf-8'))

```

以上代码开启了调试模式,PycURL会将请求和响应的详细信息输出到控制台。

# 3. PycURL在大数据抓取中的实践应用

## 3.1 大规模数据抓取的策略与实现

### 3.1.1 分布式抓取的原理

在大数据抓取的场景下,单机处理能力往往受限于网络I/O和CPU资源,因此分布式抓取成为了解决大规模数据抓取需求的有效策略。分布式抓取的原理是将抓取任务分散到多个节点上并行处理,从而提高整体的抓取效率和数据吞吐量。每个节点可以独立处理一部分URL的数据抓取任务,也可以协作完成更复杂的抓取策略,如分布式爬虫。

### 3.1.2 分布式抓取的实践技巧

在实际应用中,分布式抓取通常涉及到以下几个关键点:

1. **任务分配**:如何高效地将URL列表分配给各个抓取节点,确保负载均衡。

2. **数据去重**:避免重复抓取相同的数据,提高数据的有效性。

3. **结果汇总**:将各个节点抓取的结果汇总并进行合并处理。

为了实现这些关键点,我们可以使用消息队列(如RabbitMQ或Kafka)来分发抓取任务,并使用数据库(如Redis)来记录已经抓取的URL,确保数据的唯一性。

### 3.1.3 代理和IP池的管理

为了避免被目标网站封禁,大规模数据抓取通常需要使用代理IP池进行IP地址的轮换。PycURL可以配置不同的代理服务器进行数据抓取,这样即使某个IP被封禁,系统也可以自动切换到下一个可用的IP进行抓取。

在管理IP池时,可以使用专门的代理管理服务或者自建IP池,并通过API进行动态的IP分配和回收。此外,还需要考虑代理IP的地理位置分布,以提高抓取的稳定性和访问速度。

以下是一个简单的代理IP池管理的代码示例:

```python

import pycurl

from io import BytesIO

import json

import random

# 假设我们有一个代理服务器列表

proxies = [

{"ip": "***.***.*.*", "port": 8080},

{"ip": "***.***.*.*", "port": 8080},

# ...

]

# 代理池管理类

class ProxyPool:

def __init__(self, proxies):

self.proxies = proxies

self.random.shuffle(self.proxies) # 随机化代理列表

def get_proxy(self):

if not self.proxies:

return None

return random.choice(self.proxies) # 获取一个随机代理

# 使用代理池进行抓取

proxy_pool = ProxyPool(proxies)

proxy = proxy_pool.get_proxy()

if proxy:

c = pycurl.Curl()

buffer = BytesIO()

c.setopt(c.URL, '***')

```

0

0