CNN全连接层解析:将特征图映射到输出,实现分类预测

发布时间: 2024-07-20 05:32:17 阅读量: 78 订阅数: 35

# 1. CNN全连接层概述**

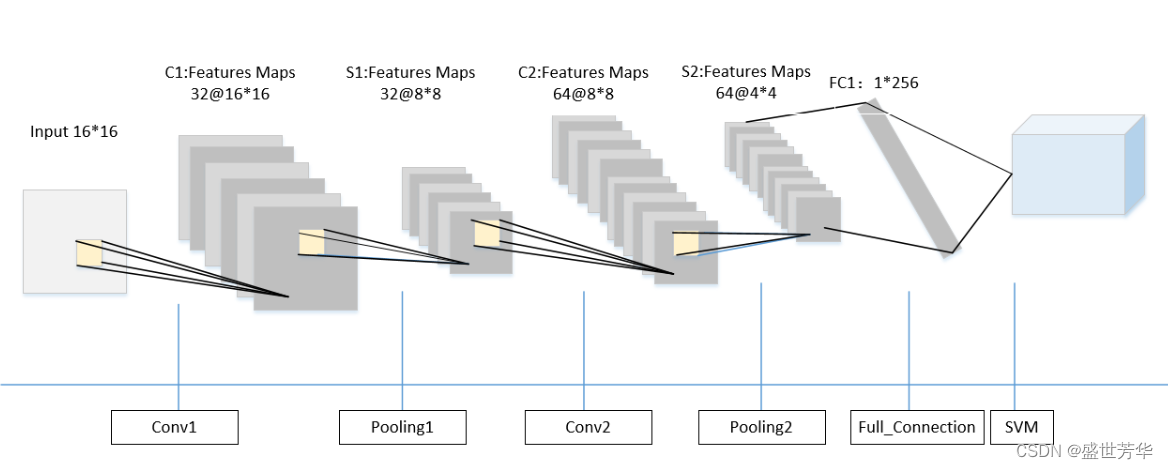

卷积神经网络(CNN)中的全连接层是一种神经网络层,它将上一层的特征图展平为一维向量,然后将其与一个权重矩阵相乘,再经过激活函数得到输出。全连接层通常用于CNN的最后阶段,用于将提取的特征映射到目标类别或回归值。

全连接层在CNN中起着至关重要的作用,它将卷积层和池化层提取的局部特征整合为全局特征,并通过权重矩阵对这些特征进行加权和,从而得到最终的预测结果。

# 2.1 特征图与全连接层

### 特征图简介

在卷积神经网络(CNN)中,特征图是卷积层输出的一组激活值。每个特征图对应于一个特定的滤波器,它捕获输入图像中的特定特征或模式。特征图的尺寸通常比输入图像小,因为卷积操作会降低图像的分辨率。

### 全连接层与特征图

全连接层是CNN中的一种特殊层,它将特征图展平为一维向量。这个向量然后被输入到一个线性分类器中,例如softmax函数,以预测图像的类别。

### 全连接层的优点

全连接层有以下优点:

* **全局信息整合:**全连接层将特征图中的信息整合到一个向量中,这使得它能够捕获图像的全局模式。

* **分类能力:**线性分类器可以将特征向量映射到不同的类别,从而实现图像分类。

* **可解释性:**全连接层的权重可以被可视化,这有助于理解模型对不同特征的依赖性。

### 全连接层的缺点

全连接层也有一些缺点:

* **计算成本高:**全连接层需要大量的参数,这会增加训练和推理的计算成本。

* **过拟合风险:**全连接层有较多的参数,这可能会导致过拟合,尤其是当训练数据量较小的时候。

* **空间信息丢失:**全连接层将特征图展平为一维向量,这会丢失图像的空间信息。

# 3. 全连接层实践实现

### 3.1 TensorFlow中全连接层的实现

TensorFlow提供了`tf.keras.layers.Dense`类来实现全连接层。该类具有以下参数:

- `units`:输出特征图的数量。

- `activation`:激活函数(默认为`None`)。

- `use_bias`:是否使用偏置项(默认为`True`)。

- `kernel_initializer`:权重初始化器(默认为`glorot_uniform`)。

- `bias_initializer`:偏置项初始化器(默认为`zeros`)。

**代码块:**

```python

import tensorflow as tf

# 创建一个具有10个输出特征图的全连接层

layer = tf.keras.layers.Dense(units=10, activation='relu')

# 创建一个输入形状为(None, 784)的模型

model = tf.keras.Sequential([

layer,

tf.keras.layers.Dense(units=10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

```

**逻辑分析:**

- 第一行导入TensorFlow库。

- 第二行创建了一个具有10个输出特征图的全连接层,并使用ReLU激活函数。

- 第三行创建了一个输入形状为(None, 784)的模型,其中None表示批次大小。

- 第四行编译模型,指定优化器、损失函数和评估指标。

### 3.2 Keras中全连接层的实现

Keras提供了`keras.layers.Dense`类来实现全连接层。该类具有与TensorFlow中`tf.keras.layers.Dense`类类似的参数。

**代码块:**

```python

import keras

# 创建一个具有10个输出特征图的全连接层

layer = keras.layers.Dense(units=10, activation='relu')

# 创建一个输入形状为(None, 784)的模型

model = keras.Sequential([

layer,

keras.layers.Dense(units=10, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical

```

0

0