去噪自编码器:从小白到高手,5步搞定

发布时间: 2024-08-21 13:33:40 阅读量: 45 订阅数: 30

# 1. 去噪自编码器(DAE)简介

去噪自编码器(DAE)是一种深度神经网络,用于从噪声数据中提取有用的信息。它是一种自编码器(AE)的变体,旨在从损坏或噪声的数据中学习潜在表示。

DAE由一个编码器和一个解码器组成。编码器将输入数据压缩成一个低维表示,而解码器则将这个低维表示重建成输出数据。在训练过程中,DAE被训练以最小化输入数据和重建数据之间的差异。通过这种方式,DAE可以学习忽略噪声并专注于输入数据的潜在结构。

DAE具有广泛的应用,包括图像降噪、文本去噪和异常检测。它们特别适用于处理高维和复杂的数据,并且可以显著提高机器学习模型的性能。

# 2. DAE的理论基础

### 2.1 自编码器(AE)的原理

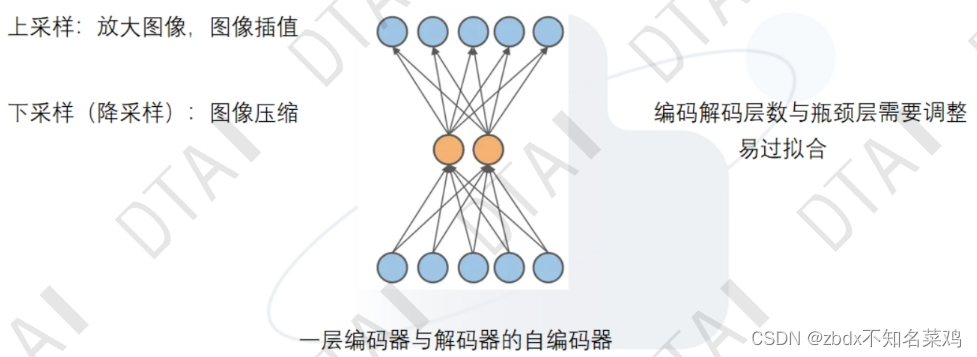

#### 2.1.1 AE的结构和工作原理

自编码器(AE)是一种无监督的神经网络,其目的是学习输入数据的潜在表示。AE由两个主要部分组成:编码器和解码器。

编码器是一个神经网络,它将输入数据映射到一个低维的潜在表示。这个潜在表示称为“潜变量”。解码器是一个神经网络,它将潜变量映射回与输入数据相似的输出。

AE的训练目标是最小化输入数据和重建输出之间的重建误差。通过最小化重建误差,AE学习捕获输入数据的关键特征,同时忽略噪声和无关信息。

#### 2.1.2 AE的损失函数和优化算法

AE的损失函数通常是重建误差的均方误差(MSE)或交叉熵。MSE衡量重建输出与输入数据之间的像素级差异,而交叉熵用于分类任务。

AE的优化算法通常是梯度下降法,例如随机梯度下降(SGD)或Adam。这些算法通过更新网络权重来最小化损失函数。

### 2.2 DAE的引入和特点

#### 2.2.1 DAE与AE的区别

去噪自编码器(DAE)是AE的一种变体,它专门用于处理噪声数据。与AE不同,DAE在训练过程中引入噪声到输入数据中。

引入噪声迫使DAE学习更鲁棒的潜在表示,这些表示可以从噪声数据中提取有用的信息。

#### 2.2.2 DAE的优势和应用场景

DAE具有以下优势:

* **鲁棒性强:**DAE可以从噪声数据中学习有用的表示,这在处理真实世界数据时非常有用。

* **数据增强:**DAE可以生成类似于输入数据的合成数据,这可以用于数据增强,从而提高模型的性能。

* **特征提取:**DAE可以学习输入数据的潜在特征,这些特征可以用于下游任务,例如分类或聚类。

DAE广泛应用于以下场景:

* 图像降噪

* 文本去噪

* 数据增强

* 特征提取

# 3. DAE的实战实现

### 3.1 DAE的模型构建

#### 3.1.1 数据预处理和特征提取

在构建DAE模型之前,需要对原始数据进行预处理,以确保模型能够有效地学习数据中的特征。数据预处理步骤通常包括:

- **数据清洗:**删除缺失值、异常值和不相关的数据。

- **数据标准化:**将数据缩放到一个统一的范围,以提高模型的收敛速度。

- **特征提取:**从原始数据中提取有意义的特征,以减少模型的复杂度和提高训练效率。

#### 3.1.2 DAE模型的搭建和训练

构建DAE模型需要定义模型的结构和训练参数。DAE模型的结构通常由编码器和解码器组成,编码器将输入数据压缩成低维度的潜在表示,而解码器则将潜在表示重建为原始数据。

```python

import tensorflow as tf

# 定义编码器

encoder = tf.keras.Sequential([

tf.keras.layers.Dense(units=128, activation='relu'),

tf.keras.layers.Dense(units=64, activation='relu'),

tf.keras.layers.Dense(units=32, activation='relu')

])

# 定义解码器

decoder = tf.keras.Sequential([

tf.keras.layers.Dense(units=64, activation='relu'),

tf.keras.layers.Dense(units=128, activation='relu'),

tf.keras.layers.Dense(units=784, activation='sigmoid')

])

# 定义DAE模型

dae = tf.keras.Model(inputs=encoder.input, outputs=decoder.output)

# 编译DAE模型

dae.compile(optimizer='adam', loss='mse')

# 训练DAE模型

dae.fit(x_train, x_train, epochs=10, batch_size=32)

```

**参数说明:**

- `units`: 每一层的节点数。

- `activation`: 每一层的激活函数。

- `optimizer`: 优化算法。

- `loss`: 损失函数。

- `epochs`: 训练的轮数。

- `batch_size`: 每一批次的数据量。

**逻辑分析:**

1. 编码器将输入数据压缩成低维度的潜在表示。

2. 解码器将潜在表示重建为原始数据。

3. 训练过程中,模型最小化重建误差,从而学习数据中的特征。

### 3.2 DAE的模型评估

#### 3.2.1 评估指标的选择

评估DAE模型的性能需要选择合适的评估指标。常用的评估指标包括:

- **均方误差(MSE):**衡量重建数据与原始数据之间的误差。

- **峰值信噪比(PSNR):**衡量重建图像的质量。

- **结构相似性指数(SSIM):**衡量重建图像与原始图像的结构相似性。

#### 3.2.2 评估结果的分析和解读

评估结果需要仔细分析和解读,以了解模型的性能和局限性。例如:

- **低MSE值:**表明模型能够有效地重建数据。

- **高PSNR值:**表明重建图像的质量较高。

- **高SSIM值:**表明重建图像与原始图像具有相似的结构。

评估结果可以帮助我们确定模型是否满足特定应用的要求,并指导模型的进一步优化。

# 4. DAE的应用案例

### 4.1 图像降噪

#### 4.1.1 图像噪声的类型和影响

图像噪声是指图像中存在的随机或非期望的像素值,会影响图像的质量和可读性。常见的图像噪声类型包括:

- **高斯噪声:**由传感器热噪声或电子噪声引起,表现为图像中随机分布的像素值波动。

- **椒盐噪声:**由图像传输或处理错误引起,表现为图像中随机分布的黑色或白色像素。

- **脉冲噪声:**由传感器缺陷或图像损坏引起,表现为图像中随机分布的孤立像素值。

图像噪声会降低图像的对比度、清晰度和可识别性,影响后续图像处理和分析任务的准确性。

#### 4.1.2 DAE在图像降噪中的应用

DAE在图像降噪中的应用原理如下:

- **编码阶段:**将噪声图像作为输入,通过DAE的编码器网络提取图像的特征。

- **解码阶段:**利用提取的特征,通过DAE的解码器网络重建图像。

- **去噪效果:**由于DAE的编码器会过滤掉噪声特征,因此解码器重建的图像会比原始图像更干净。

**代码实现:**

```python

import numpy as np

import tensorflow as tf

# 加载图像并添加噪声

image = tf.keras.preprocessing.image.load_img('image.jpg')

image = tf.keras.preprocessing.image.img_to_array(image)

noise = np.random.normal(0, 0.1, image.shape)

noisy_image = image + noise

# 构建DAE模型

dae = tf.keras.models.Sequential([

tf.keras.layers.Conv2D(32, (3, 3), activation='relu', padding='same'),

tf.keras.layers.MaxPooling2D((2, 2), padding='same'),

tf.keras.layers.Conv2D(32, (3, 3), activation='relu', padding='same'),

tf.keras.layers.MaxPooling2D((2, 2), padding='same'),

tf.keras.layers.Flatten(),

tf.keras.layers.Dense(128, activation='relu'),

tf.keras.layers.Dense(image.shape[0] * image.shape[1] * image.shape[2]),

tf.keras.layers.Reshape((image.shape[0], image.shape[1], image.shape[2]))

])

# 训练DAE模型

dae.compile(optimizer='adam', loss='mse')

dae.fit(noisy_image, image, epochs=100)

# 去噪图像

denoised_image = dae.predict(noisy_image)

```

**逻辑分析:**

- `Conv2D`层用于提取图像特征,`MaxPooling2D`层用于降采样特征图。

- `Flatten`层将特征图展平为一维向量,`Dense`层用于非线性变换。

- `Reshape`层将一维向量还原为图像形状。

- 训练过程中,DAE通过最小化输入图像和重建图像之间的均方误差来学习去噪特征。

### 4.2 文本去噪

#### 4.2.1 文本噪声的来源和危害

文本噪声是指文本中存在的错误、缺失或多余的字符,会影响文本的可读性和理解性。常见的文本噪声来源包括:

- **拼写错误:**由打字错误或语法错误引起。

- **语法错误:**由语法规则不正确引起。

- **缺失字符:**由数据传输或处理错误引起。

- **多余字符:**由数据重复或错误输入引起。

文本噪声会降低文本的质量和可信度,影响后续文本处理和分析任务的准确性。

#### 4.2.2 DAE在文本去噪中的应用

DAE在文本去噪中的应用原理如下:

- **编码阶段:**将噪声文本作为输入,通过DAE的编码器网络提取文本的特征。

- **解码阶段:**利用提取的特征,通过DAE的解码器网络重建文本。

- **去噪效果:**由于DAE的编码器会过滤掉噪声特征,因此解码器重建的文本会比原始文本更干净。

**代码实现:**

```python

import tensorflow as tf

# 加载文本并添加噪声

text = 'This is a noisy text with spelling errors and missing characters.'

noise = ['is', 'a', 'with', 'errors', 'missing']

for n in noise:

text = text.replace(n, '')

# 构建DAE模型

dae = tf.keras.models.Sequential([

tf.keras.layers.Embedding(len(text), 128),

tf.keras.layers.LSTM(128),

tf.keras.layers.Dense(len(text))

])

# 训练DAE模型

dae.compile(optimizer='adam', loss='sparse_categorical_crossentropy')

dae.fit(tf.one_hot(text, len(text)), tf.one_hot(text, len(text)), epochs=100)

# 去噪文本

denoised_text = ''.join([chr(c) for c in np.argmax(dae.predict(tf.one_hot(text, len(text))), axis=-1)])

```

**逻辑分析:**

- `Embedding`层将文本中的字符转换为向量。

- `LSTM`层用于提取文本特征,`Dense`层用于非线性变换。

- 训练过程中,DAE通过最小化输入文本和重建文本之间的稀疏分类交叉熵损失来学习去噪特征。

# 5. DAE的进阶探索

### 5.1 变分自编码器(VAE)

变分自编码器(VAE)是DAE的扩展,它引入了一个概率分布来表示潜在变量。与DAE不同,VAE的目标不仅是重建输入数据,还希望学习潜在变量的分布。

#### 5.1.1 VAE的原理和优势

VAE使用贝叶斯推断技术来学习潜在变量的分布。它将潜在变量建模为一个正态分布,并使用变分推断来近似该分布。通过这种方法,VAE可以捕获数据的变异性和不确定性。

VAE具有以下优势:

- **生成能力:**VAE可以从潜在变量分布中生成新的数据,这使其成为生成模型的强大工具。

- **鲁棒性:**VAE对噪声和缺失数据具有鲁棒性,因为它学习了潜在变量的分布,而不是特定的数据点。

- **可解释性:**VAE的潜在变量分布可以提供对数据中潜在模式的见解。

#### 5.1.2 VAE在生成模型中的应用

VAE已成功应用于各种生成模型任务,包括:

- 图像生成

- 文本生成

- 音乐生成

- 分子生成

### 5.2 生成对抗网络(GAN)

生成对抗网络(GAN)是另一种与DAE相关的深度学习模型。GAN由两个网络组成:生成器网络和判别器网络。

#### 5.2.1 GAN的原理和结构

生成器网络负责生成新数据,而判别器网络负责区分生成的数据和真实数据。GAN的训练过程是一个对抗过程,其中生成器网络试图欺骗判别器网络,而判别器网络试图正确分类数据。

#### 5.2.2 GAN在图像生成和风格迁移中的应用

GAN已在图像生成和风格迁移方面取得了显著成功。

- **图像生成:**GAN可以从噪声中生成逼真的图像,这使其成为生成艺术和增强现实等应用的强大工具。

- **风格迁移:**GAN可以将一种图像的风格转移到另一种图像上,从而创建具有独特外观的新图像。

0

0