去噪自编码器与深度学习强强联合:共创佳绩,拓展应用

发布时间: 2024-08-21 14:09:37 阅读量: 23 订阅数: 30

# 1. 去噪自编码器简介**

去噪自编码器(DAE)是一种神经网络模型,专门用于从损坏或有噪声的数据中提取有用的信息。它通过引入噪声并迫使模型在训练过程中从噪声数据中恢复原始数据,从而实现数据去噪。

与传统的自编码器不同,DAE在编码器和解码器之间引入了一个噪声层。这个噪声层将原始数据扰乱,迫使模型学习原始数据的潜在表示,而不是仅仅记忆原始数据。通过这种方式,DAE可以有效地去除数据中的噪声,同时保留其重要特征。

DAE在图像处理、文本分析和信号处理等领域有着广泛的应用。它可以有效地去除图像中的噪声,提高文本的可读性,并增强信号的清晰度。

# 2. 去噪自编码器的理论基础

### 2.1 自编码器的基本原理

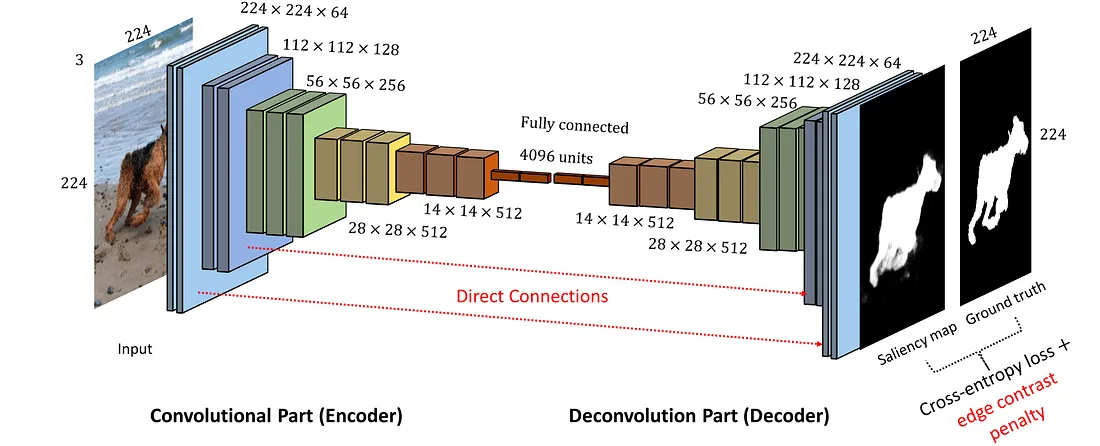

自编码器是一种无监督学习算法,其目的是学习输入数据的低维表示。它由两个神经网络组成:编码器和解码器。编码器将输入数据映射到低维潜在空间,而解码器将潜在空间中的表示映射回输入空间。

自编码器的训练目标是重建输入数据,即最小化重建误差。通过强制自编码器学习输入数据的低维表示,它可以捕获数据中的重要特征,同时丢弃噪声和冗余。

### 2.2 去噪自编码器的引入和优势

去噪自编码器 (DAE) 是自编码器的变体,专门用于处理噪声数据。它通过在输入数据中引入噪声来增强自编码器的鲁棒性。

DAE 的优势在于:

- **鲁棒性增强:** DAE 能够从噪声数据中学习有意义的表示,从而提高其在实际应用中的鲁棒性。

- **特征提取能力:** DAE 可以有效地提取噪声数据中的重要特征,使其成为特征提取任务的有力工具。

- **降维表示:** DAE 可以将噪声数据映射到低维潜在空间,从而实现降维表示,便于进一步分析和处理。

### 2.3 去噪自编码器的数学模型

DAE 的数学模型与自编码器类似,但引入了一个噪声项。

**编码器:**

```python

h = encoder(x + noise)

```

**解码器:**

```python

x_reconstructed = decoder(h)

```

**重建误差:**

```python

loss = ||x - x_reconstructed||^2

```

其中:

- `x` 是输入数据

- `noise` 是引入的噪声

- `h` 是潜在空间中的表示

- `x_reconstructed` 是重建后的数据

- `loss` 是重建误差

DAE 的训练过程包括以下步骤:

1. 向输入数据添加噪声

2. 使用编码器将噪声数据映射到潜在空间

3. 使用解码器将潜在空间中的表示映射回输入空间

4. 计算重建误差

5. 反向传播更新网络权重

通过重复这些步骤,DAE 可以学习从噪声数据中提取有意义的特征,同时丢弃噪声和冗余。

# 3. 去噪自编码器的实践应用

### 3.1 图像降噪

图像降噪是去噪自编码器最常见的应用之一。图像降噪的目标是去除图像中的噪声,例如高斯噪声、椒盐噪声和运动模糊。去噪自编码器通过学习图像的潜在表示来实现图像降噪,该表示包含图像的干净版本。

#### 3.1.1 去噪自编码器的图像降噪流程

去噪自编码器的图像降噪流程如下:

1. **输入:**将噪声图像作为输入。

2. **编码:**使用编码器将噪声图像编码成潜在表示。

3. **解码:**使用解码器将潜在表示解码成干净的图像。

#### 3.1.2 去噪自编码器的优势

去噪自编码器在图像降噪方面具有以下优势:

* **非监督学习:**不需要标记的数据,可以应用于各种图像类型。

* **鲁棒性:**对不同的噪声类型具有鲁棒性。

* **保留细节:**在去除噪声的同时,可以保留图像的细节。

#### 3.1.3 代码示例

以下代码示例展示了如何使用去噪自编码器进行图像降噪:

```python

import tensorflow as tf

# 定义输入图像

input_image = tf.keras.Input(shape=(28, 28, 1))

# 定义编码器

encoder = tf.keras.Sequential([

tf.keras.layers.Conv2D(32, (3, 3), activation='relu', padding='same'),

tf.keras.layers.MaxPooling2D((2, 2), padding='same'),

tf.keras.layers.Conv2D(64, (3, 3), activation='relu', padding='same'),

tf.keras.layers.MaxPooling2D((2, 2), padding='same'),

tf.keras.layers.Flatten()

])

# 定义解码器

decoder = tf.keras.Sequential([

tf.keras.layers.Dense(7 * 7 * 64, activation='relu'),

tf.keras.layers.Reshape((7, 7, 64)),

tf.keras.layers.Conv2DTranspose(64, (3, 3), activation='relu', padding='same'),

tf.keras.layers.UpSampling2D((2, 2)),

tf.keras.layers.Conv2DTranspose(32, (3, 3), activation='relu', padding='same'),

tf.keras.layers.UpSampling2D((2, 2)),

tf.keras.layers.Conv2D(1, (3, 3),

```

0

0