MATLAB求解方程组:GPU加速,高性能计算的新天地,大幅提升速度

发布时间: 2024-05-25 03:51:09 阅读量: 168 订阅数: 50

GPU加速matlab

# 1. MATLAB求解方程组的基础理论

MATLAB是一种强大的数学和科学计算软件,广泛应用于求解方程组。本节将介绍MATLAB求解方程组的基础理论,包括:

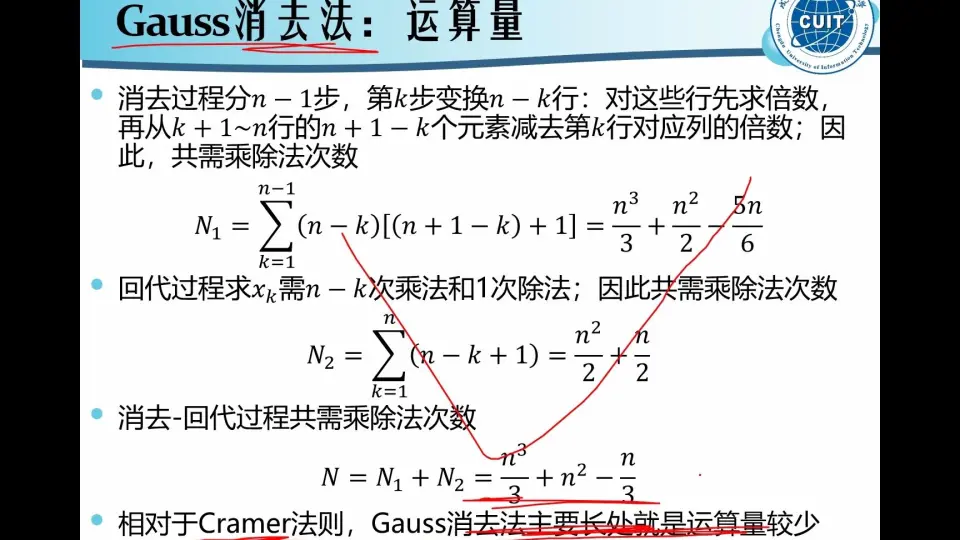

- 线性方程组的数学表示和求解方法,如高斯消去法和LU分解。

- 非线性方程组的求解方法,如牛顿法和拟牛顿法。

- MATLAB中求解方程组的内置函数,如`solve`和`fsolve`。

# 2. MATLAB求解方程组的并行计算技术

### 2.1 GPU加速原理和优势

图形处理器(GPU)是一种专门设计用于处理图形数据的并行计算设备。与中央处理器(CPU)相比,GPU具有以下优势:

- **大规模并行架构:** GPU包含数千个计算核心,可同时执行大量计算任务。

- **高内存带宽:** GPU具有宽广的内存带宽,可快速访问大量数据。

- **低延迟:** GPU的延迟较低,可快速处理数据。

### 2.2 GPU并行编程基础

#### 2.2.1 CUDA编程模型

CUDA(Compute Unified Device Architecture)是一种由NVIDIA开发的并行编程模型,用于在GPU上编写代码。CUDA模型将GPU视为一个协处理器,与CPU并行工作。

CUDA编程涉及以下关键概念:

- **内核:** 并行执行的代码块,在GPU上运行。

- **线程:** 内核中执行的单个计算单元。

- **线程块:** 线程的组,在GPU上并行执行。

- **网格:** 线程块的集合,在GPU上并行执行。

#### 2.2.2 OpenCL编程模型

OpenCL(Open Computing Language)是一种跨平台的并行编程模型,可用于在各种设备(包括GPU)上编写代码。OpenCL模型类似于CUDA,但具有更广泛的设备支持。

OpenCL编程涉及以下关键概念:

- **内核:** 并行执行的代码块,在设备上运行。

- **工作组:** 线程的组,在设备上并行执行。

- **工作项:** 工作组中的单个计算单元。

- **队列:** 命令的集合,指定设备执行的任务。

### 2.3 GPU加速求解方程组的实现

#### 2.3.1 矩阵和向量的GPU化

在GPU上求解方程组的第一步是将矩阵和向量从CPU内存传输到GPU内存。MATLAB提供了`gpuArray`函数来执行此操作。

```matlab

% 将矩阵A和向量b传输到GPU

A_gpu = gpuArray(A);

b_gpu = gpuArray(b);

```

#### 2.3.2 求解算法的GPU并行化

一旦矩阵和向量在GPU内存中,就可以使用GPU并行化求解算法。MATLAB提供了`spsolve`函数来求解稀疏线性方程组。

```matlab

% 使用GPU并行化求解稀疏线性方程组

x_gpu = spsolve(A_gpu, b_gpu);

```

**代码逻辑逐行解读:**

- `spsolve(A_gpu, b_gpu)`:使用GPU并行化求解稀疏线性方程组`A_gpu * x_gpu = b_gpu`。

- `x_gpu`:存储解向量的GPU数组。

**参数说明:**

- `A_gpu`:稀疏系数矩阵的GPU数组。

- `b_gpu`:右端向量的GPU数组。

- `x_gpu`:解向量的GPU数组。

# 3. MATLAB求解方程组的优化策略

### 3.1 算法优化

#### 3.1.1 选择合适的求解算法

MATLAB提供了多种求解方程组的算法,包括直接法、迭代法和分解法。选择合适的算法对于提高求解效率至关重要。

* **直接法**(如LU分解、QR分解)适用于规模较小、系数矩阵稀疏的方程组,其计算复杂度为O(n^3)。

* **迭代法**(如Jacobi迭代、Gauss-Seidel迭代)适用于规模较大、系数矩阵稠密的方程组,其计算复杂度通常为O(n^2)。

* **分解法**(如Cholesk

0

0