可信赖AI:提升算法透明度与可解释性的关键策略

发布时间: 2024-09-01 22:51:45 阅读量: 111 订阅数: 60

可解释AI发展报告2022-打开算法黑暗的理念与实践.pdf

# 1. 可信赖AI的概念与重要性

在数字化转型的浪潮中,可信赖AI已成为当前技术发展的关键领域之一。它不仅关乎技术的完善,更是企业获取用户信任,确保社会责任的重要基础。

## 1.1 可信赖AI的定义

可信赖AI是指在设计和使用过程中,能够保证透明度、可解释性、公平性、隐私保护和安全性的AI系统。其核心在于解决AI可能引发的伦理和法律问题,确保技术的应用不会损害社会的公平和正义。

## 1.2 为什么可信赖AI如此重要

随着AI应用的普及,越来越多的决策被交给了算法。因此,确保这些决策过程的可信赖性,对保障个人权益、维护社会稳定及促进公平正义显得尤为重要。此外,可信赖AI亦能提升企业的市场竞争力,增强用户对技术的信任。

# 2. 算法透明度的基础

## 2.1 透明度的定义及其对AI的影响

### 2.1.1 透明度在AI中的含义

算法透明度是一个多维度的概念,它不仅指算法设计和决策过程的清晰度,还包括了算法对输入数据的响应、数据如何被处理以及最终输出决策的可理解性。在AI领域,透明度尤其重要,因为它涉及到机器学习模型的内在工作机制,这些模型通常被认为是“黑箱”,即其内部过程难以直观理解。透明度的缺失会导致“黑箱效应”,用户无法清楚地知道AI系统是如何得出其结论的,这在医疗、金融和司法等对透明度要求极高的领域,尤其成问题。

### 2.1.2 透明度对用户信任的影响

用户信任是可信赖AI的关键。透明度可以增加用户对AI系统决策的理解,从而提高信任度。当用户能够理解AI如何工作,并且能够看到AI决策背后的数据和逻辑时,他们更有可能相信并依赖这个系统。反之,如果算法的决策过程是不透明的,那么即使AI系统做出了准确的预测,用户也可能会怀疑其结果的公正性和可靠性。

## 2.2 提升算法透明度的技术方法

### 2.2.1 模型解释性与透明度的关系

模型解释性是指模型对自身如何做出决策提供洞察的能力。高解释性的模型可以清晰地展示决策过程,这直接提高了算法的透明度。在AI中,我们通常将模型分为“白箱”模型和“黑箱”模型。“白箱”模型如线性回归,其工作原理直观、易于解释;而“黑箱”模型如深度神经网络,其内部复杂的结构使得解释变得困难。

### 2.2.2 可解释模型与黑箱模型的比较

可解释模型,如线性模型和决策树,由于其结构简单,通常能够提供直观的解释,从而提高透明度。相较之下,黑箱模型如深度学习模型,虽然能够处理复杂的任务并取得优秀的性能,但其决策过程却难以被理解和解释。因此,研究者们在努力开发新的方法来提升这些模型的可解释性,例如使用特征重要性评分、可视化技术或局部可解释模型逼近等。

### 2.2.3 算法审计工具的使用

算法审计工具是检查和评估AI算法透明度的重要技术手段。这些工具可以帮助开发者和审查者理解算法的决策过程,发现潜在的偏差和不公正现象。例如,FairLearn是一个由微软开发的开源Python包,用于评估和改善机器学习模型的公平性。此类工具使得算法的透明度和可解释性成为可能,有助于构建更加可信的AI系统。

## 2.3 算法透明度的案例研究

### 2.3.1 公共部门中的透明度实践

在公共部门,算法透明度尤其重要,因为这关乎公共利益和政策决策。例如,在公共福利分配和资源分配中,透明度可以帮助确保算法决策的公正性和合理性。当AI系统用于分配学生到不同学校或分配急救资源时,透明的算法能够使公众了解并信任这些决策过程。

### 2.3.2 私营企业中的透明度实施

私营企业同样开始注重算法透明度,特别是在它们的算法对消费者产生重大影响时。例如,金融行业的贷款审批系统会使用AI来评估客户的信用风险。如果这些决策过程是透明的,那么即使客户被拒绝贷款,他们也能够了解原因,这有助于提升客户对银行决策过程的信任。

在本章中,我们从算法透明度的定义出发,探讨了它如何影响用户信任,并且深入了解了提升算法透明度的技术方法。我们通过模型解释性、可解释模型和黑箱模型的比较,以及算法审计工具的应用,展示了提升透明度的实际措施。最后,通过公共部门和私营企业的案例研究,我们理解了透明度在实际应用中的重要性及其在不同领域中的实施情况。在接下来的章节中,我们将进一步探讨算法可解释性的原则与方法,以及如何通过这些原则和技术手段来提升AI系统的透明度和信任度。

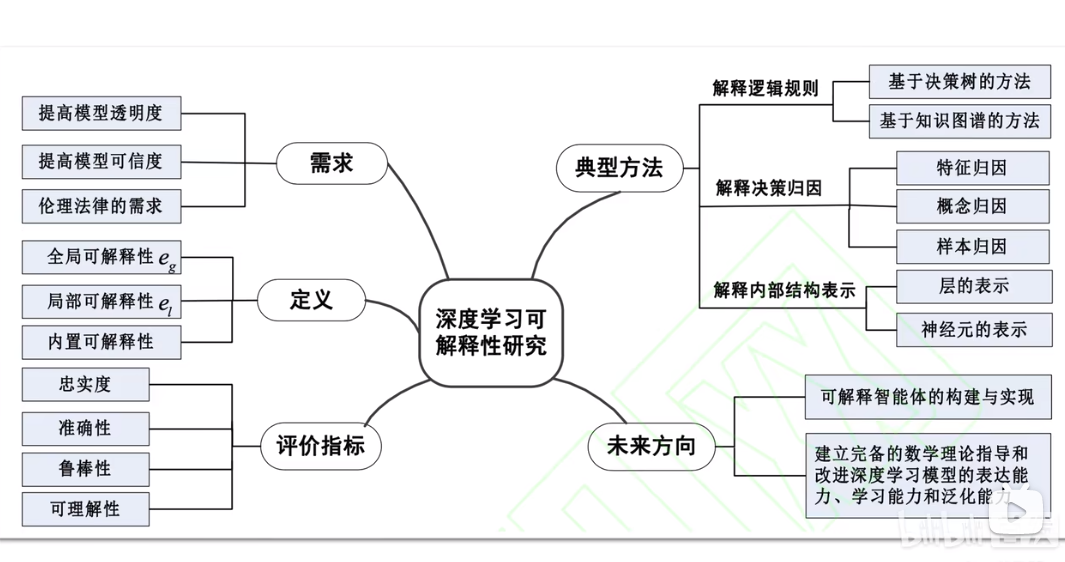

# 3. 算法可解释性原则与方法

## 3.1 可解释性原则

### 3.1.1 可解释性的定义及其重要性

可解释性,简单来说,是指一个模型或系统能否提供对它的决策过程和结果的清晰和易于理解的解释。在AI的上下文中,可解释性尤为重要,因为这些算法通常影响着关键的决策,例如金融贷款批准、医疗诊断甚至司法判决。缺乏可解释性不仅会引发道德和法律问题,还会降低人们对AI系统的信任。

### 3.1.2 可解释性的主要原则与框架

可解释性的核心原则是透明和理解。这意味着AI系统的设计者和开发者应该能够解释系统是如何工作的,以及为什么会做出特定的决策。为了实现这一目标,设计了一系列框架,如SHAP(SHapley Additive exPlanations)、LIME(Local Interpretable Model-agnostic Exp

0

0