自动化决策伦理视角:影响与对策全解析

发布时间: 2024-09-01 23:08:37 阅读量: 48 订阅数: 24

# 1. 自动化决策概述

自动化决策是利用算法和计算模型,在没有或有限人工干预的情况下做出决策的过程。在当今数字化转型的大背景下,自动化决策在企业运营效率、成本控制和用户体验改善等方面发挥着越来越重要的作用。然而,随着自动化决策应用的广泛,随之而来的伦理问题也日益凸显,如算法偏见、数据隐私、决策透明度等,这要求我们在技术进步的同时,更要关注其社会伦理层面的深刻影响。

## 1.1 自动化决策的定义与特点

自动化决策通常基于大数据分析、机器学习和人工智能技术,使计算机系统能够从数据中学习并形成决策模型。它能够处理复杂的数据集,并且在很多情况下比人类决策更快、更准确。

## 1.2 自动化决策的应用领域

自动化决策广泛应用于金融、医疗、零售、交通和公共管理等多个领域,其在个性化推荐、风险控制、运营优化等方面的效果显著。以金融领域为例,自动化信贷审批能够实现快速放贷并控制风险。

## 1.3 自动化决策面临的挑战

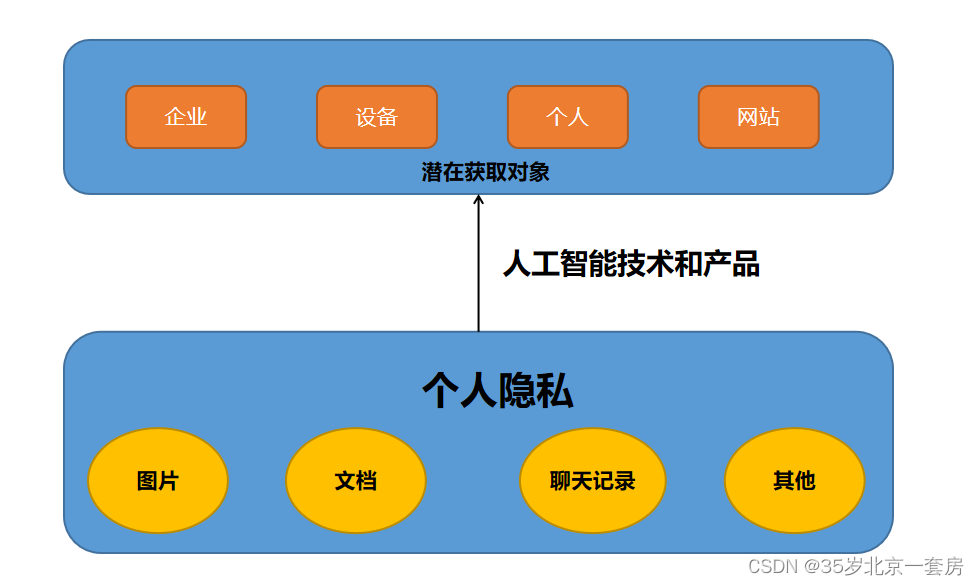

尽管自动化决策带来了诸多益处,但也引发了包括数据滥用、隐私泄露、算法歧视和决策透明度低等问题。为了实现可持续发展,需要在技术创新的同时,构建完善的伦理框架和法律规范来指导和约束自动化决策的实践。

# 2. 自动化决策伦理问题解析

### 2.1 伦理问题的理论基础

#### 伦理问题定义及分类

在自动化决策领域,伦理问题涉及的是技术在做出决策时可能引发的道德争议。这些问题通常可以分为三类:隐私问题、偏见与歧视问题、以及透明度和可解释性问题。

- **隐私问题**:涉及到在自动化决策过程中个人数据的收集、存储、使用和共享。在没有得到用户明确同意的情况下,个人信息被泄露或滥用,可能导致隐私权被侵犯。

- **偏见与歧视问题**:自动化决策系统可能在没有意识到的情况下,复制或放大现有的偏见,例如基于性别、种族或社会经济地位等特征的歧视。

- **透明度和可解释性问题**:自动化决策系统需要对其决策过程和结果提供足够的透明度,以便用户理解和信任。缺乏可解释性可能导致用户对系统决策的不信任和抵制。

```mermaid

graph TD

A[自动化决策伦理问题] --> B[隐私问题]

A --> C[偏见与歧视问题]

A --> D[透明度和可解释性问题]

```

#### 自动化决策与人类伦理的关系

自动化决策的伦理挑战不仅仅是一个技术问题,更是对人类伦理原则的挑战。系统做出的决策,尤其是那些对人们生活产生重大影响的决策,应当符合普遍接受的伦理标准。

- **责任归属**:当自动化系统做出错误决策时,确定责任归属变得复杂。这涉及到技术设计者、使用者和监管者的责任边界。

- **道德代理人**:自动化系统是否能够成为道德代理人,以及如何让其在缺乏人类道德判断的情况下遵循伦理标准。

- **伦理多样性**:不同的文化和社会对伦理的理解存在差异,自动化决策系统需要考虑到这种多样性并进行适应。

### 2.2 自动化决策中的伦理冲突

#### 隐私权与数据使用

隐私权是个人基本权利之一,保护个人信息不被未授权使用是自动化决策中的一大挑战。随着大数据技术的发展,个人数据的收集和分析变得更加广泛,增加了侵犯隐私的风险。

- **最小化数据收集**:应严格限定自动化决策系统收集的数据类型和数量,只收集对决策必要的信息。

- **用户同意**:在收集和使用个人数据之前,必须获得用户的明确同意,并向用户提供透明的使用说明。

- **数据保护法规遵循**:遵守相关的数据保护法律法规,如欧盟的通用数据保护条例(GDPR)。

```plaintext

// 示例伪代码:获取用户同意进行数据收集

user_consent = ask_user_for_consent(permissions_needed)

if user_consent:

collect_data(permissions_needed)

else:

inform_user_of_consent_implications()

```

#### 自动化偏见与歧视问题

自动化决策系统可能由于训练数据的偏差,导致系统输出偏见的决策。例如,如果一个信用评分系统的训练数据对某些人群存在歧视,那么系统就会在评分时复制这种歧视。

- **偏见识别**:需要分析数据集和算法以识别潜在的偏见。

- **数据去偏**:采用技术和统计方法减少训练数据中的偏见。

- **算法公平性**:开发和应用旨在提高算法公平性的算法和工具。

#### 人工智能决策的透明度与可解释性

人工智能的决策过程往往被视为“黑箱”,外界难以理解其内部运作机制,这使得用户难以信任和接受其决策结果。

- **模型解释性**:开发易于解释的模型,或对复杂模型提供解释框架。

- **决策透明度**:向用户提供关于决策过程的信息,包括使用的数据、模型类型以及决策依据。

- **可审计性**:确保决策过程可审计,以便在出现问题时可以追溯和纠正。

### 2.3 国际视角下的伦理标准

#### 不同国家的伦理法规对比

不同国家根据其文化背景和法律体系,对自动化决策中的伦理问题有不同的法律规定和解释。

- **欧盟GDPR**:对于个人数据的保护尤为严格,对自动化决策提出了明确的透明度和可解释性要求。

- **美国**:虽然没有统一的数据保护法律,但某些州(如加州)的消费者隐私法案(CCPA)提供了与欧盟GDPR类似的保护。

- **中国**:正在逐步建立自己的数据保护法规,例如个人信息保护法(PIPL)。

#### 国际组织的伦理指导原则

国际组织如联合国教科文组织(UNESCO)和经济合作与发展组织(OECD)发布了自动化决策和人工智能伦理指导原则。

- **OECD人工智能原则**:涉及公平性、透明度、责任性等问题,并为政策制定者提供行动框架。

- **UNESCO人工智能伦理指导原则**:提供更全面的伦理框架,包括人本原则、教育和文化原则等。

在探索自动化决策伦理问题的过程中,我们必须承认一个核心观点:技术的发展必须要与社会的伦理价值观相协调。本章深入探讨了自动化决策伦理的理论基础、实际的伦理冲突以及国际间在伦理标准上的差异,接下来,我们将分析不同行业如何面对这些伦理挑战,并提供相应的解决方案和实践案例。

# 3. 自动化决策伦理影响案例分析

### 3.1 金融行业的自动化决策伦理问题

自动化在金融行业的应用极大地提高了决策效率和精准度,但同时也引发了诸多伦理问题。金融行业中的自动化决策,尤其是信贷和投资的自动化

0

0