【Transformer模型解密】: 探秘原理与应用

发布时间: 2024-04-20 10:46:52 阅读量: 85 订阅数: 105

3.Transformer模型原理详解.pdf

# 1. Transformer模型简介

Transformer模型是一种基于注意力机制的深度学习模型,由Vaswani等人在2017年提出,被广泛应用于自然语言处理和计算机视觉领域。相比于传统的循环神经网络,Transformer模型通过自注意力机制实现了更好的并行性,使其在处理长距离依赖关系时表现更加出色。Transformer模型的核心思想是利用注意力机制来计算输入序列中各个元素之间的重要性,进而实现信息传递和提取。在接下来的章节中,我们将深入探讨Transformer模型的技术原理、应用领域、优缺点分析以及未来发展趋势。

# 2. Transformer模型技术原理

### 2.1 什么是Transformer模型

Transformer模型是一种基于注意力机制的深度学习模型,由Vaswani等人在2017年提出,被广泛应用于自然语言处理、计算机视觉等领域。

#### 2.1.1 自注意力机制

自注意力机制是Transformer模型的核心组成部分之一,通过计算输入序列中各个位置之间的注意力权重,实现对序列的语义理解。

```python

# 自注意力机制代码示例

def self_attention(q, k, v):

attention_scores = softmax(q * k.T / sqrt(d_k))

output = attention_scores * v

return output

```

在上述代码中,q、k、v分别表示查询、键、值的向量,通过计算注意力分数并乘以值向量,即可得到自注意力输出。

#### 2.1.2 多头注意力机制

为了增强模型的表征能力,Transformer引入了多头注意力机制,允许模型在不同信息子空间中进行学习。

#### 2.1.3 位置编码

位置编码用于为输入序列中的每个位置赋予一个特定的位置信息,以帮助模型区分不同位置的词语。

### 2.2 模型结构详解

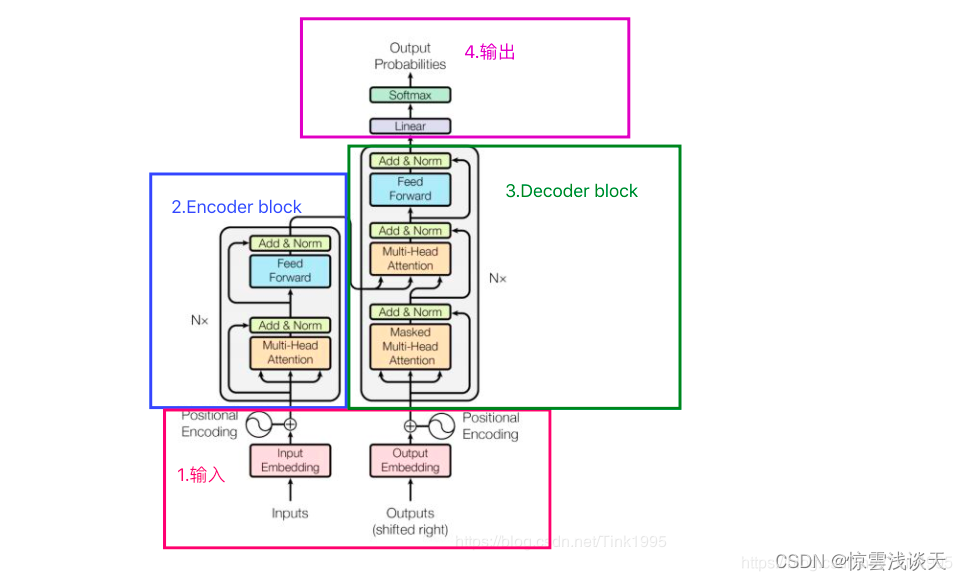

Transformer模型由编码器和解码器组成,下面将对其结构进行详细解析。

#### 2.2.1 编码器结构

编码器由多个相同的层堆叠而成,每层包含两个子层:多头自注意力机制和前馈神经网络。

```mermaid

graph TD;

A[输入] --> B[多头自注意力];

B --> C[前馈神经网络];

C --> D[输出];

```

#### 2.2.2 解码器结构

解码器也由多个相同的层堆叠而成,每层包含三个子层:多头自注意力机制、编码器-解码器注意力机制和前馈神经网络。

```mermaid

graph LR;

A[输入] --> B[多头自注意力];

B --> C[编码器-解码器注意力];

C --> D[前馈神经网络];

D --> E[输出];

```

#### 2.2.3 位置编码的作用

位置编码的引入使模型可以利用序列中元素的位置信息,更好地捕捉长距离依赖关系。

#### 2.2.4 残差连接与层归一化

Transformer模型中引入了残差连接和层归一化,有利于减缓梯度消失问题,加快模型收敛速度。

至此,我们对Transformer模型的技术原理进行了详细阐述,下一步我们将探讨Transformer模型在不同领域的应用。

# 3. Transformer模型应用领域

Transformer 模型作为一种革命性的深度学习模型,在自然语言处理和计算机视觉领域都有着广泛的应用。下面将详细探讨 Transformer 模型在这两个领域中的具体应用。

### 3.1 自然语言处理领域

在自然语言处理领域,Transformer 模型展现出了强大的特性,特别是在处理文本数据时更是得心应手。以下是 Transformer 模型在自然语言处理领域的几个典型应用:

#### 3.1.1 机器翻译

Transformer 模型在机器翻译任务中有着非常成功的应用,取代了传统的循环神经网络和卷积神经网络模型。其自注意力机制可以帮助模型更好地捕捉句子中的长距离依赖关系,从而提高翻译的准确性和流畅度。

```python

# 代码示例

def translate_sentence(input_sentence):

# 使用 Transformer 模型进行机器翻译

...

return translated_sentence

```

#### 3.1.2 文本生成

在文本生成任务中,Transformer 模型可以生成更加准确和连贯的文本内容,如生成新闻报道、故事情节等。其多头注意力机制使得模型能够同时关注不同位置的信息,进而提高生成文本的质量。

```python

# 代码示例

def generate_text(prompt):

# 使用 Transformer 模型生成文本

...

return generated_text

```

#### 3.1.3 问答系统

Transformer 模型在问答系统中也有着广泛的应用,可以帮助实现智能问答、信息检索等功能。模型通过对问题和文本信息进行编码,然后利用自注意力机制来生成答案。

```python

# 代码示例

def answer_question(question, context):

# 使用 Transformer 模型回答问题

...

return answer

```

### 3.2 计算机视觉领域

除了自然语言处理领域,Transformer 模型在计算机视觉领域也展现出了强大的潜力,下面是一些 Transformer 模型在计算机视觉领域的典型应用:

#### 3.2.1 图像标注

Transformer 模型可用于图像标注任务,通过将图像和文本结合,实现对图像内容的描述。模型可以学习到图像中不同区域的特征,进而生成与图像相关的自然语言描述。

```python

# 代码示例

def generate_image_caption(image):

# 使用 Transformer 模型生成图像描述

...

return image_caption

```

#### 3.2.2 图像生成

在图像生成领域,Transformer 模型也有着广泛的应用。通过将文本信息编码为隐层向量,再利用解码器生成图像内容,实现对特定主题的图像生成。

```python

# 代码示例

def generate_image_from_description(description):

# 使用 Transformer 模型生成图像

...

return generated_image

```

#### 3.2.3 目标检测

Transformer 模型不仅可以生成图像描述,还可以用于目标检测任务。模型可以通过自注意力机制聚焦于图像中不同区域的重要特征,从而实现准确的目标检测。

```python

# 代码示例

def detect_objects(image):

# 使用 Transformer 模型进行目标检测

...

return detected_objects

```

通过以上对 Transformer 模型在自然语言处理和计算机视觉领域的应用介绍,可以看出其在各种任务中都展现出了强大的潜力。随着不断的改进和优化,Transformer 模型将在更多领域得到广泛应用。

# 4. Transformer模型优缺点分析

### 4.1 优点总结

#### 4.1.1 并行性好

Transformer 模型在处理数据时具有良好的并行性,这得益于其注意力机制的设计。传统的循环神经网络(RNN)在处理序列数据时存在着串行计算的缺点,而 Transformer 模型通过自注意力机制,能够同时计算输入序列中各个位置的注意力权重,从而实现了更好的并行性。这种设计极大地减少了模型的训练时间,提高了训练效率。

具体来说,Transformer 中的自注意力机制允许每个词与其他所有词进行交互,从而能够同时处理整个输入序列,而不像 RNN 需要依次处理每个词。这种并行计算的优势在处理长序列数据时尤为明显,使得 Transformer 在处理大规模数据集时表现出色。

下面是一个简化的自注意力机制示意代码:

```python

# 自注意力机制实现

def self_attention(query, key, value):

attention_scores = softmax(query @ key.T / sqrt(d_k))

output = attention_scores @ value

return output

```

#### 4.1.2 可扩展性强

Transformer 模型具有很强的可扩展性,能够轻松地应用到不同规模的数据集和任务中。其模块化设计使得各个组件(如注意力机制、前馈神经网络等)之间相互独立,可以根据实际需要进行灵活组合。这种设计使得 Transformer 模型在应对不同任务时更加灵活,同时也便于对模型进行调优和改进。

在实际应用中,研究人员可以根据任务的特点调整 Transformer 模型的层数、隐藏单元数等超参数,以便更好地适应当前任务的需求。这种可扩展性让 Transformer 成为一种通用的深度学习模型,被广泛用于自然语言处理、计算机视觉等领域。

下面是一个简单的 Transformer 模型结构示例:

```python

# Transformer 编码器结构

class EncoderLayer(nn.Module):

def __init__(self, d_model, heads, d_ff, dropout):

super(EncoderLayer, self).__init__()

self.self_attn = MultiHeadedAttention(heads, d_model)

self.feed_forward = PositionwiseFeedForward(d_model, d_ff, dropout)

self.sublayer = clones(SublayerConnection(d_model, dropout), 2)

```

#### 4.1.3 模型效果出色

Transformer 模型在各种自然语言处理任务中展现出色的性能,如语言建模、机器翻译、文本生成等。其强大的表征学习能力和良好的泛化能力,使得 Transformer 在处理自然语言文本时能够捕捉到丰富的语义信息,有效提升了模型在复杂任务上的表现。

通过将长序列输入转换为固定长度的上下文编码,Transformer 能够更好地理解句子之间的依赖关系,从而更好地预测句子的下一个词。相比传统的 RNN 模型,Transformer 在捕捉长距离依赖关系方面效果更好。

综上所述,Transformer 模型在并行性、可扩展性和模型效果等方面表现出色,成为当今自然语言处理领域的热门模型之一。

### 4.2 缺点分析

#### 4.2.1 计算资源消耗大

尽管 Transformer 模型在处理数据时展现出色的表现,但其计算资源消耗却较大。在训练大规模的 Transformer 模型时,需要庞大的计算资源来支撑模型的训练,这对于普通的硬件设备来说是一种挑战。

特别是在处理大型语料库时,由于 Transformer 模型的自注意力机制使得模型需要计算所有位置之间的交互关系,因此计算量较大。这也导致了在应用 Transformer 模型时需要考虑到计算资源的消耗,尤其是对于一些中小型企业或个人研究者来说,构建和训练大规模的 Transformer 模型是一项挑战。

#### 4.2.2 对序列长度敏感

另一个 Transformer 模型的缺点是对序列长度敏感。虽然 Transformer 在处理长距离依赖关系时效果较好,但是随着序列长度的增加,模型的计算复杂度也会呈现出二次增长的趋势。这就导致了在处理超长序列时,模型的训练和推理时间会显著增加。

为了解决这个问题,研究人员提出了一些针对长序列输入的改进方法,如使用局部注意力机制、限制注意力范围等。然而,这些方法往往会引入新的超参数和训练技巧,增加了模型的调优难度。

#### 4.2.3 学习长距离依赖关系困难

Transformer 模型在处理一些需要考虑长距离依赖关系的任务时存在一定困难。由于自注意力机制使得每个位置的词都可以与其他位置的词进行交互,使得 Transformer 可以捕捉到全局信息,但在学习长距离依赖关系时,模型可能会受到梯度消失或爆炸的影响。

特别是在处理长序列任务时,模型需要较长的训练时间才能学习到远距离的依赖关系,这可能会导致模型在实际应用中出现性能下降的情况。因此,如何有效地训练 Transformer 模型以捕捉长距离的依赖关系是目前研究中的一个重要挑战。

通过对 Transformer 模型的优缺点分析,我们可以更好地了解该模型的特点,为后续的模型选择和应用提供参考。

# 5. Transformer模型未来发展趋势

Transformer 模型作为深度学习领域的瑰宝,在自然语言处理和计算机视觉等领域有着广泛的应用和巨大的影响力。未来,随着人工智能技术的不断发展,Transformer 模型也将持续演进,展望未来的发展趋势有以下几个方面:

### 5.1 模型规模的进一步扩大

随着硬件计算能力的不断提升,未来 Transformer 模型的规模将会进一步扩大。更大规模的模型可以带来更强大的表征能力和更好的性能,但同时也需要解决训练和推理的效率问题。

### 5.2 模型的轻量化

为了在移动设备和边缘设备上部署 Transformer 模型,未来的方向之一是模型的轻量化。研究人员将会探索如何在保持模型性能的前提下减小模型的参数量和计算复杂度,以适应移动端场景的需求。

### 5.3 模型的通用性和泛化能力

当前的 Transformer 模型在特定领域表现出色,但在泛化能力和通用性方面仍有提升的空间。未来的研究方向将会更加注重模型在不同任务和领域的迁移能力,以实现更广泛的应用。

### 5.4 结合其他技术的创新

未来 Transformer 模型的发展也会与其他技术进行更深入的结合和创新。例如,结合强化学习、迁移学习、元学习等技术,进一步提升模型的智能化水平和适应能力。

### 5.5 模型的可解释性

随着对模型可解释性要求的日益增加,未来 Transformer 模型的研究也将更加关注模型决策的可解释性。如何让模型的预测结果更具可解释性和可信度将是未来的研究重点之一。

未来,Transformer 模型的发展将不断迭代和创新,预计会在各个领域持续取得突破性进展,为人工智能技术的发展带来新的机遇和挑战。

0

0