【数据预处理】:高质量数据,监督学习和无监督学习的基础

发布时间: 2024-09-01 19:09:39 阅读量: 125 订阅数: 57

# 1. 数据预处理的重要性

在数据科学和机器学习中,数据预处理是至关重要的一步,它直接影响到模型的性能和准确性。数据预处理包括数据清洗、数据转换、特征工程和数据标准化等步骤,为数据的分析和挖掘打下了坚实的基础。

数据预处理的目的是提高数据质量,使数据更加适合于后续的分析工作。在这个过程中,原始数据经过净化,确保数据的完整性和一致性。此外,数据预处理有助于消除异常值、填补缺失值,以及将数据规范化,这将使模型训练更为有效。

一个良好的数据预处理过程应当遵循以下原则:保持数据的真实性,避免引入偏见;保证数据的代表性,确保从数据中获得的结论具有普适性;并确保数据的充分性,使分析结果具有统计意义。通过正确实施数据预处理,可以显著提高数据驱动决策的有效性,为数据科学提供可靠的输入。

# 2. 数据清洗的方法

数据清洗是数据预处理过程中至关重要的一步,旨在提高数据质量,从而确保数据模型的准确性和可靠性。本章节将详细介绍数据清洗中的几个关键方法,包括缺失值的处理、异常值的检测与处理,以及数据规范化和归一化的相关技术和应用。

## 2.1 缺失值的处理

### 2.1.1 缺失值的识别

在进行数据清洗时,首先要识别出数据集中的缺失值。在大多数情况下,缺失值可以用空值、空格、问号(?)、None等标识表示。我们可以使用数据处理工具或编程语言进行识别。例如,在Python中,使用Pandas库可以方便地识别出数据集中的缺失值:

```python

import pandas as pd

# 加载数据集

df = pd.read_csv('data.csv')

# 识别缺失值

missing_values = df.isnull().sum()

```

上述代码中,`isnull()` 函数会返回一个同样大小的布尔型数据框,其中True表示缺失值。然后使用 `sum()` 函数汇总每一列的缺失值数量。

### 2.1.2 缺失值的填充策略

处理缺失值的常见方法是填充或删除。填充策略包括用平均值、中位数、众数或其他统计量填充,或者使用预测模型估计缺失值。

```python

# 使用列的平均值填充

df['column_name'].fillna(df['column_name'].mean(), inplace=True)

# 使用预估模型填充

# 首先,使用不包含目标变量的完整数据建立模型

from sklearn.ensemble import RandomForestRegressor

model = RandomForestRegressor()

# 训练模型并预测缺失值

df['column_name'].fillna(model.fit_predict(df.drop('target', axis=1)), inplace=True)

```

在上述代码中,首先使用 `fillna()` 函数直接用某列的平均值进行填充。而在使用预估模型填充的情况下,我们利用 `RandomForestRegressor` 来预测缺失值,并用这些值填充原数据框。

### 2.1.3 缺失值删除的应用场景

如果数据集中缺失值的比例非常高,或者缺失值集中出现在某几个关键变量上,那么删除含有缺失值的行或列可能是更合适的选择。

```python

# 删除含有缺失值的行

df.dropna(inplace=True)

# 仅删除特定列中含有缺失值的行

df.dropna(subset=['column_name'], inplace=True)

# 仅删除含有超过阈值的缺失值的行

df.dropna(thresh=3, inplace=True)

```

在上面的代码块中,`dropna()` 函数用于删除含有缺失值的行或列。`subset` 参数允许指定需要检查缺失值的列,而 `thresh` 参数指定保留至少包含多少非缺失值的行。

## 2.2 异常值的检测与处理

### 2.2.1 异常值的定义和识别方法

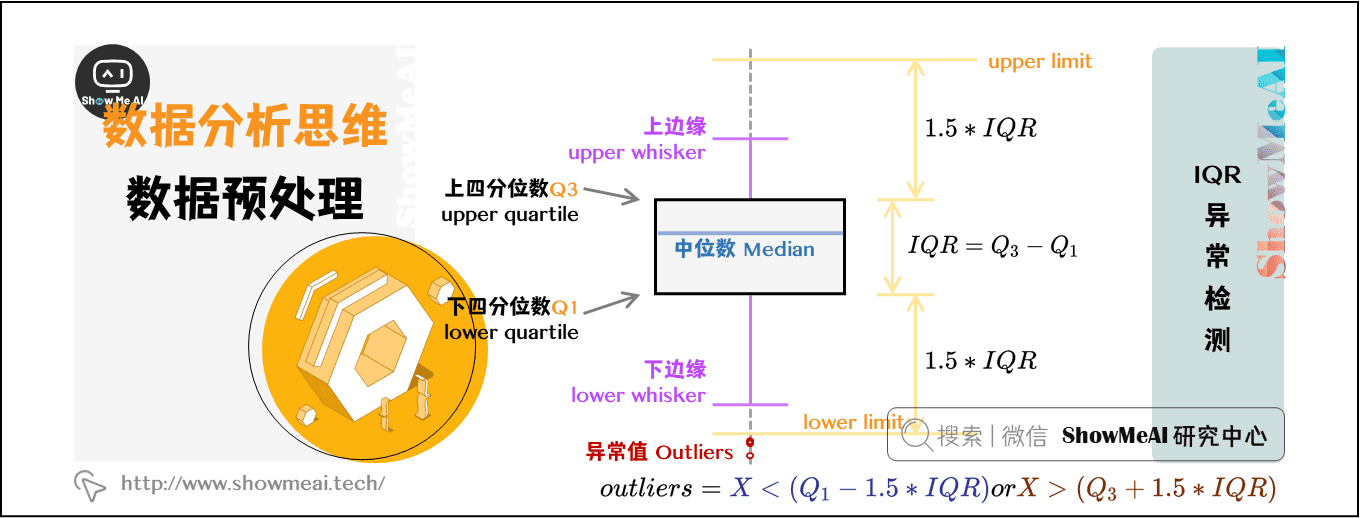

异常值是指与其它观测数据显著不同的数据点。异常值可能来自测量或录入错误,也可能指示潜在的有价值信息。常见的异常值识别方法包括标准差法、箱型图法、基于聚类的方法和基于模型的方法。

```python

import numpy as np

# 使用标准差法识别异常值

mean = df['column_name'].mean()

std = df['column_name'].std()

outliers = df[(np.abs(df['column_name'] - mean) > 3 * std)].index

# 使用箱型图法识别异常值

Q1 = df['column_name'].quantile(0.25)

Q3 = df['column_name'].quantile(0.75)

IQR = Q3 - Q1

lower_bound = Q1 - 1.5 * IQR

upper_bound = Q3 + 1.5 * IQR

outliers = df[(df['column_name'] < lower_bound) | (df['column_name'] > upper_bound)].index

```

在上述代码中,首先计算了均值和标准差,然后标识了超出均值正负三个标准差范围的点作为异常值。而使用箱型图法时,首先计算了四分位数和四分位距,然后识别出位于上下界之外的数据点。

### 2.2.2 常用的异常值处理技术

处理异常值的技术包括删除、修改或使用特殊值替换。在实际操作中,需要根据具体问题和数据集特性来选择合适的处理方式。

```python

# 删除异常值

df.drop(outliers, inplace=True)

# 将异常值替换为列的中位数

df.loc[outliers, 'column_name'] = df['column_name'].median()

```

在上述代码示例中,我们使用 `drop()` 函数删除了异常值,也可以选择用列的中位数替换它们。

### 2.2.3 异常值处理对模型的影响

异常值可能会对数据建模产生重大影响,尤其是对于依赖均值的统计方法和模型。处理异常值时应该谨慎,需要评估其对模型性能的潜在影响。

## 2.3 数据规范化和归一化

### 2.3.1 规范化和归一化的概念

规范化和归一化是数据预处理中将数据缩放到特定范围的过程,常用于算法优化,如距离计算、梯度下降等。规范化一般指的是线性缩放,而归一化通常指的是将数据缩放到[0,1]区间。

### 2.3.2 常用的规范化方法

常用的规范化方法包括最小-最大规范化、z-score规范化等。

```python

# 最小-最大规范化

from sklearn.preprocessing import MinMaxScaler

scaler = MinMaxScaler()

df_scaled = scaler.fit_transform(df[['column_name']])

# z-score规范化

from sklearn.preprocessing import StandardScaler

scaler = StandardScaler()

df_scaled = scaler.fit_transform(df[['column_name']])

```

上述代码中,`MinMaxScaler` 和 `StandardScaler` 分别执行了最小-最大规范化和z-score规范化。通过应用这些方法,我们可以获得规范化后的数据集。

### 2.3.3 归一化的应用实例

以一个简单的线性回归为例,展示规范化后的数据如何提高模型的准确性和训练速度。

```python

from sklearn.linear_model import LinearRegression

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error

# 假设df_scaled是已规范化的数据集

X_train, X_test, y_train, y_test = train_test_split(df_scaled, y, test_size=0.2, random_state=42)

model = LinearRegression()

model.fit(X_train, y_train)

# 评估模型性能

predictions = model.predict(X_test)

mse = mean_squared_error(y_test, predictions)

print(f"模型的均方误差为:{mse}")

```

在上述代码示例中,我们首先对数据集进行分割,并使用线性回归模型进行训练和预测。规范化后的数据提高了模型性能,减小了均方误差。

# 3. ```

# 第三章:特征工程的技术

## 3.1 特征选择的方法

### 3.1.1 过滤法

过滤法是一种直接对特征本身进行评估的方法,用于选取与目标变量相关性较高的特征。这种方法的核心是根据一定的统计学指标来筛选特征,如相关系数、卡方检验、互信息等。

```python

import pandas as pd

from sklearn.feature_selection import SelectKBest, chi2

# 示例数据集

data = pd.re

0

0