MATLAB矩阵乘法在人工智能中的应用:构建智能系统,探索人工智能奥秘

发布时间: 2024-06-05 06:38:15 阅读量: 30 订阅数: 19

# 1. MATLAB矩阵乘法概述**

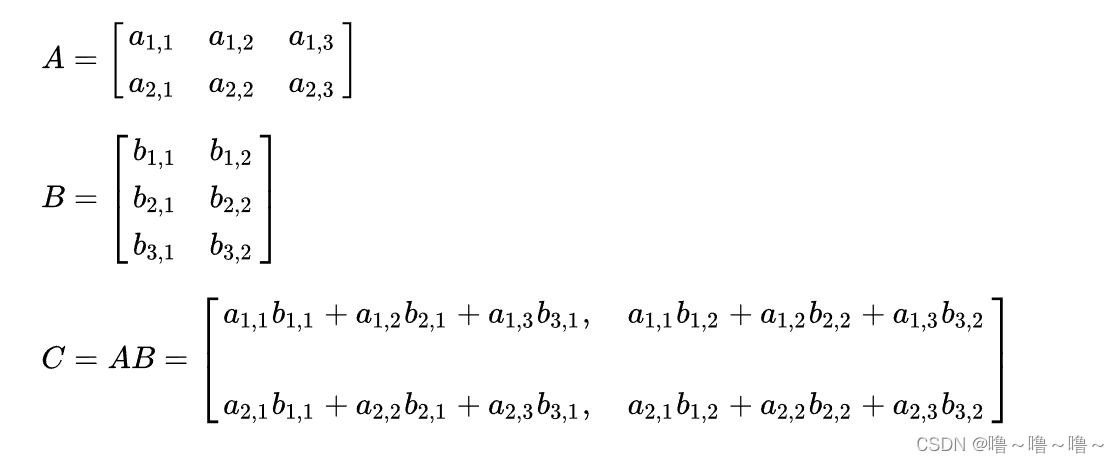

MATLAB中的矩阵乘法是通过使用“*”运算符完成的,它执行两个矩阵的逐元素乘法,然后将结果相加。矩阵乘法在人工智能中至关重要,因为它用于计算神经网络中的权重和激活值。

矩阵乘法遵循特定的规则:矩阵A的行数必须等于矩阵B的列数,结果矩阵的维度为A的行数乘以B的列数。例如,如果A是一个3x4矩阵,B是一个4x5矩阵,那么它们的乘积将是一个3x5矩阵。

# 2. 矩阵乘法在人工智能中的理论基础

### 2.1 线性代数与人工智能

人工智能 (AI) 是一门涉及开发智能计算机系统和算法的学科,这些系统和算法能够执行通常需要人类智能的任务,例如学习、推理和解决问题。线性代数在 AI 中扮演着至关重要的角色,因为它提供了描述和操作多维数据结构的数学框架。

线性代数的基本概念,如向量、矩阵和线性变换,为 AI 的许多基本操作提供了基础。例如,向量可以表示数据点,而矩阵可以表示数据之间的关系。线性变换可以用来转换数据,这对于特征提取和降维等任务至关重要。

### 2.2 矩阵乘法在神经网络中的应用

神经网络是 AI 中最流行的机器学习模型之一。神经网络本质上是复杂的函数,可以从数据中学习模式和关系。矩阵乘法在神经网络中广泛用于计算神经元之间的权重和激活。

在神经网络中,矩阵乘法用于执行以下操作:

- **前向传播:**计算神经网络每一层的输出。

- **反向传播:**计算神经网络中权重的梯度,用于更新权重以最小化损失函数。

#### 代码示例:

```matlab

% 创建一个神经网络层

layer = struct('weights', randn(10, 20), 'bias', randn(1, 20));

% 前向传播

input = randn(100, 10);

output = input * layer.weights + layer.bias;

% 反向传播

delta = randn(100, 20);

d_weights = input' * delta;

d_bias = sum(delta, 1);

```

#### 代码逻辑分析:

- `layer` 结构体表示神经网络层,其中 `weights` 是权重矩阵,`bias` 是偏置向量。

- `input` 是输入数据,`output` 是神经网络层的输出。

- `delta` 是误差信号,`d_weights` 和 `d_bias` 是权重和偏置的梯度。

- 前向传播通过矩阵乘法计算输出,而反向传播通过矩阵乘法计算梯度。

# 3.1 神经网络模型的构建

**神经网络概述**

神经网络是一种受生物神经系统启发的机器学习模型,它由相互连接的神经元组成。每个神经元接收输入数据,对其进行加权和,并通过激活函数产生输出。神经网络通过训练过程调整权重,以最小化损失函数并学习复杂模式。

**神经网络中的矩阵乘法**

矩阵乘法在神经网络中扮演着至关重要的角色。它用于计算神经元之间的加权和,从而确定神经元的输出。具体来说,矩阵乘法用于:

* **前向传播:**计算神经网络从输入层到输出层的输出。

* **反向传播:**计算损失函数对权重的梯度,用于更新权重。

**神经网络模型的构建**

构建神经网络模型涉及以下步骤:

1. **定义网络结构:**确定网络的层数、神经元数量和连接方式。

2. **初始化权重:**为神经元之间的连接分配初始权重。

3. **前向传播:**计算网络的输出。

4. **计算损失:**计算网络输出与预期输出之间的差异。

5. **反向传播:**计算损失函数对权重的梯度。

6. **更新权重:**使用梯度下降或其他优化算法更新权重。

7. **重复步骤 3-6:**直到网络达到所需的精度或达到最大训练迭代次数。

**代码示例:**

```matlab

% 定义神经网络结构

layers = [

imageInputLayer([28 28 1])

convolution2dLayer(3, 16, 'Stride', 2)

reluLayer

maxPooling2dLayer(2, 'Stride', 2)

fullyConnectedLayer(10)

softmaxLayer

classificationLayer

];

% 初始化网络

net = network(layers);

% 训练网络

options = trainingOptions('sgdm', 'MaxEpochs', 10);

net = trainNetwork(trainData, trainLabels, net, options);

```

0

0