RNN的行业应用:科技巨头与初创公司的实践,洞悉行业趋势

发布时间: 2024-08-22 12:15:09 阅读量: 14 订阅数: 32

# 1. RNN概述

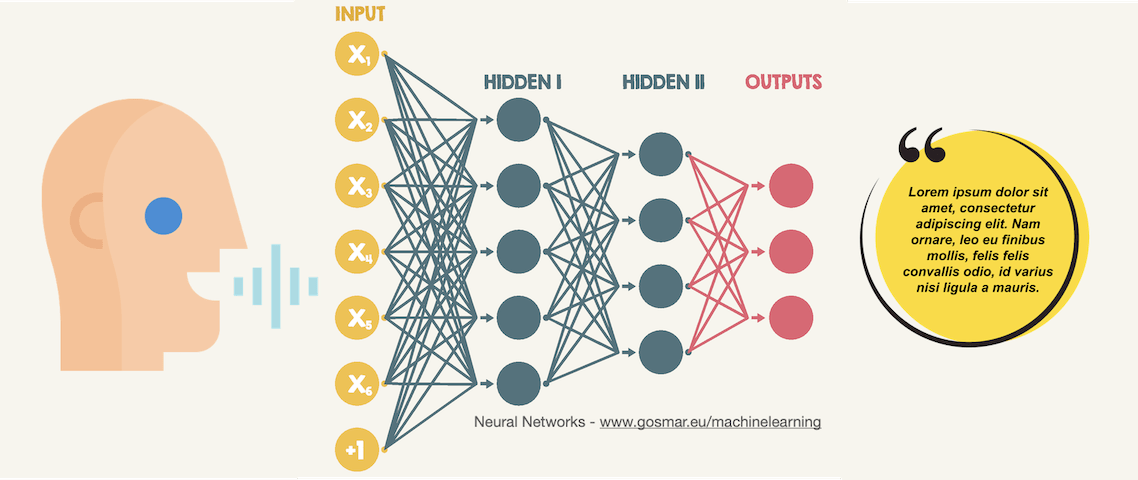

循环神经网络(RNN)是一种强大的神经网络模型,专门用于处理序列数据。RNN通过将先前时间步的信息传递到当前时间步,从而能够学习长期依赖关系。

RNN的基本结构包括一个循环单元,它在每个时间步接收输入和前一时间步的隐藏状态。循环单元更新其隐藏状态,该隐藏状态包含了序列中到目前为止的信息摘要。通过这种方式,RNN可以捕获序列中的模式和上下文。

RNN已被广泛应用于各种任务,包括自然语言处理、计算机视觉和语音处理。在这些领域,RNN已经取得了令人印象深刻的结果,并且继续推动着这些领域的进步。

# 2. RNN在自然语言处理中的应用

RNN在自然语言处理(NLP)领域有着广泛的应用,其强大的序列处理能力使其能够有效处理文本数据。在NLP中,RNN主要用于以下三个方面:

### 2.1 文本分类

文本分类是NLP中一项基本任务,其目的是将文本文档分配到预定义的类别中。基于RNN的文本分类模型通常采用以下步骤:

- **文本预处理:**将文本转换为数字表示,例如词嵌入或one-hot编码。

- **RNN编码:**使用RNN(如LSTM或GRU)对文本序列进行编码,提取文本特征。

- **分类:**使用全连接层或softmax函数将编码后的特征映射到类别标签。

**代码块:基于LSTM的文本分类模型**

```python

import tensorflow as tf

# 定义超参数

vocab_size = 10000

embedding_dim = 128

lstm_units = 128

num_classes = 2

# 创建文本分类模型

model = tf.keras.Sequential([

tf.keras.layers.Embedding(vocab_size, embedding_dim),

tf.keras.layers.LSTM(lstm_units),

tf.keras.layers.Dense(num_classes, activation='softmax')

])

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(X_train, y_train, epochs=10)

```

**逻辑分析:**

- `Embedding`层将单词转换为词嵌入,提取单词的语义信息。

- `LSTM`层对文本序列进行编码,捕捉文本中的长期依赖关系。

- `Dense`层将编码后的特征映射到类别标签。

**优化文本分类性能的技巧:**

- **数据增强:**使用数据增强技术(如同义词替换、随机删除)增加训练数据集。

- **正则化:**使用dropout或L2正则化防止模型过拟合。

- **超参数调整:**优化RNN单元类型、隐藏单元数量和学习率等超参数。

### 2.2 机器翻译

机器翻译是将一种语言的文本翻译成另一种语言的过程。RNN在机器翻译中发挥着至关重要的作用,其能够捕捉源语言和目标语言之间的复杂关系。

**RNN在机器翻译中的应用:**

- **编码器-解码器架构:**RNN通常用于构建编码器-解码器架构,其中编码器将源语言文本编码为固定长度的向量,解码器使用该向量生成目标语言文本。

- **注意力机制:**注意力机制允许解码器在生成目标语言时关注源语言文本的不同部分。

- **双向RNN:**双向RNN可以同时处理源语言文本的过去和未来信息,提高翻译质量。

**代码块:基于Transformer的机器翻译模型**

```python

import tensorflow as tf

# 定义超参数

src_vocab_size = 10000

tgt_vocab_size = 10000

embedding_dim = 128

num_layers = 6

num_heads = 8

# 创建机器翻译模型

model = tf.keras.Model(

inputs=[src_input, tgt_input],

outputs=tgt_output

)

# 编译模型

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

mod

```

0

0