【10大RNN训练技巧】:优化性能,避免过拟合

发布时间: 2024-08-22 11:22:20 阅读量: 32 订阅数: 32

# 1. RNN的基本原理和训练流程**

循环神经网络(RNN)是一种特殊的神经网络,它能够处理序列数据,例如文本、语音和时间序列。RNN通过使用循环连接来记住先前的输入,使其能够学习序列中的模式和依赖关系。

RNN的训练流程通常涉及以下步骤:

1. **正向传播:**将输入序列逐个输入RNN,并计算每个时间步长的隐藏状态。

2. **反向传播:**计算损失函数相对于权重的梯度,并使用反向传播算法更新权重。

3. **梯度下降:**使用梯度下降算法更新权重,以最小化损失函数。

通过重复这些步骤,RNN可以学习序列中的模式并执行各种任务,例如语言建模、机器翻译和时间序列预测。

# 2. 理论与实践

### 2.1 优化损失函数

损失函数是衡量模型预测值与真实值之间差异的函数。在RNN训练中,常用的损失函数包括:

#### 2.1.1 交叉熵损失函数

交叉熵损失函数用于分类问题,衡量模型预测的概率分布与真实分布之间的差异。公式如下:

```python

loss = -Σy_true * log(y_pred)

```

其中:

* `y_true`:真实标签

* `y_pred`:模型预测的概率分布

#### 2.1.2 平方误差损失函数

平方误差损失函数用于回归问题,衡量模型预测值与真实值之间的平方误差。公式如下:

```python

loss = Σ(y_true - y_pred)^2

```

其中:

* `y_true`:真实值

* `y_pred`:模型预测值

### 2.2 正则化技术

正则化技术通过惩罚模型的复杂性来防止过拟合。常用的正则化技术包括:

#### 2.2.1 L1正则化

L1正则化在损失函数中添加权重系数的绝对值之和。公式如下:

```python

loss = Σ|w|

```

其中:

* `w`:权重系数

#### 2.2.2 L2正则化

L2正则化在损失函数中添加权重系数的平方和。公式如下:

```python

loss = Σw^2

```

其中:

* `w`:权重系数

#### 2.2.3 Dropout正则化

Dropout正则化在训练过程中随机丢弃神经元,防止模型过度依赖特定特征。

### 2.3 超参数优化

超参数是模型训练过程中的可调参数,包括:

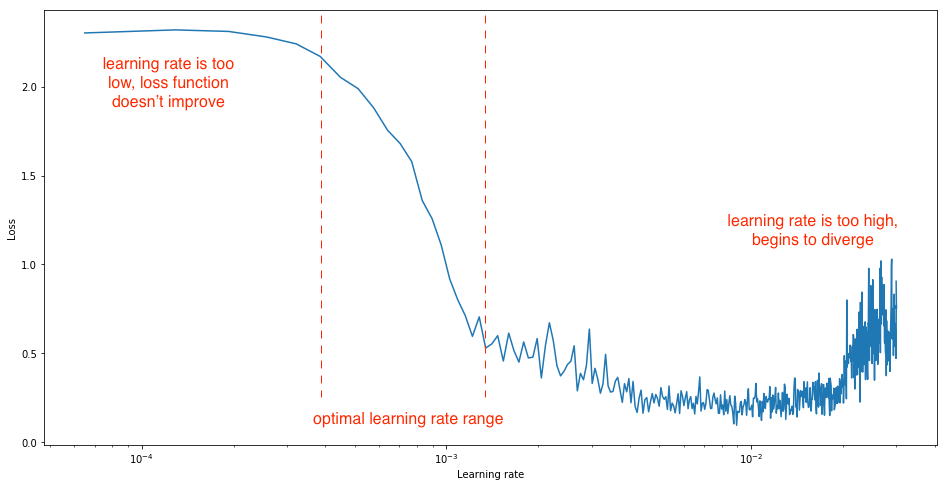

#### 2.3.1 学习率

学习率控制模型更新权重的大小。较高的学习率可能导致模型不稳定,而较低的学习率可能导致训练速度慢。

#### 2.3.2 批大小

批大小是每个训练步骤中使用的样本数量。较大的批大小可以提高训练效率,但可能导致模型过拟合。

#### 2.3.3 隐藏层数量和神经元数量

隐藏层数量和神经元数量决定了模型的复杂性。更多的隐藏层和神经元可以提高模型的表达能力,但可能导致过拟合。

# 3. RNN训练技巧:实践应用

### 3.1 梯度裁剪

#### 3.1.1 梯度爆炸

梯度爆炸是指在反向传播过程中,梯度值变得非常大,导致模型权重更新过大,从而使模型不稳定。这通常发生在网络较深或学习率较高的情况下。

#### 3.1.2 梯度消失

梯度消失是指在反向传播过程中,梯度值变得非常小,导致模型权重更新过小,从而使模型难以学习。这通常发生在网络较深或激活函数的导数较小的情况下。

#### 3.1.3 梯度裁剪

梯度裁剪是一种技术,用于解决梯度爆炸和梯度消失问题。它通过限制梯度的最大值来防止梯度值变得过大或过小。

```python

import torch

def gradient_clipping(parameters, max_norm):

"""

对模型参数进行梯度裁剪。

参数:

parameters:模型参数。

max_norm:梯度的最大范数。

"""

for param in parameters:

if param.grad is not None:

param.grad.data.clamp_(-max_norm, max_norm)

```

### 3.2 激活函数选择

#### 3.2.1 sigmoid函数

sigmoid函数是一个非线性激活函数,其输出值介于0和1之间。它通常用于二分类问题。

```python

import torch

def sigmoid(x):

"""

sigmoid激活函数。

参数:

x:输入值。

"""

return 1 / (1 + torch.exp(-x))

```

#### 3.2.2 tanh函数

tanh函数是一个非线性激活函数,其输出值介于-1和1之间。它通常用于回归问题。

```python

import torch

def tanh(x):

"""

tanh激活函数。

参数:

x:输入值。

"""

return (torch.exp(x) - torch.exp(-x)) / (torch.exp(x) + torch.exp(-x))

```

#### 3.2.3 ReLU函数

ReLU函数(修正线性单元)是一个非线性激活函数,其输出值大于0时为输入值,否则为0。它通常用于图像识别和自然语言处理等任务。

```python

import torch

def relu(x):

"""

ReLU激活函数。

参数:

x:输入值。

"""

return torch.clamp(x, min=0)

```

### 3.3 数据预处理

#### 3.3.1 数据归一化

数据归一化是指将数据值缩放至特定范围(通常为0到1或-1到1),以消除不同特征之间的量纲差异。这有助于提高模型的训练速度和性能。

```python

import torch

def normalize(data, mean, std):

"""

对数据进行归一化。

参数:

data:数据。

mean:数据的均值。

std:数据的标准差。

"""

return (data - mean) / std

```

#### 3.3.2 数据增强

数据增强是指通过对原始数据进行随机变换(如旋转、翻转、裁剪)来生成新数据,以增加训练数据集的大小和多样性。这有助于防止模型过拟合。

```python

import torchvision.transforms as transforms

transform = transforms.Compose([

transforms.RandomRotation(15),

transforms.RandomHorizontalFlip(),

transforms.RandomCrop(32)

])

```

# 4. 进阶应用

### 4.1 循环神经网络的变体

循环神经网络(RNN)的基本结构虽然强大,但仍存在一些局限性,例如梯度消失和爆炸问题。为了克服这些限制,研究人员提出了RNN的变体,包括长短期记忆(LSTM)和门控循环单元(GRU)。

#### 4.1.1 LSTM

LSTM(Long Short-Term Memory)是一种特殊的RNN,它引入了一个称为“记忆单元”的机制。记忆单元由三个门组成:输入门、遗忘门和输出门。

- **输入门:**控制新信息的流入。

- **遗忘门:**控制旧信息的遗忘。

- **输出门:**控制记忆单元中信息的输出。

LSTM的记忆单元可以有效地存储长期依赖关系,从而缓解梯度消失问题。

```python

import tensorflow as tf

# 定义LSTM单元

lstm_cell = tf.keras.layers.LSTMCell(units=128)

# 创建LSTM层

lstm_layer = tf.keras.layers.RNN(lstm_cell, return_sequences=True)

# 输入数据

input_data = tf.keras.Input(shape=(None, 10))

# 通过LSTM层

output = lstm_layer(input_data)

```

#### 4.1.2 GRU

GRU(Gated Recurrent Unit)也是一种RNN变体,它将LSTM的三个门简化为两个门:更新门和重置门。

- **更新门:**控制新信息的更新。

- **重置门:**控制旧信息的重置。

GRU与LSTM相比,结构更简单,计算效率更高。

```python

import tensorflow as tf

# 定义GRU单元

gru_cell = tf.keras.layers.GRUCell(units=128)

# 创建GRU层

gru_layer = tf.keras.layers.RNN(gru_cell, return_sequences=True)

# 输入数据

input_data = tf.keras.Input(shape=(None, 10))

# 通过GRU层

output = gru_layer(input_data)

```

### 4.2 注意力机制

注意力机制是一种神经网络技术,它允许模型专注于输入序列中最重要的部分。在RNN中,注意力机制可以帮助模型学习长期依赖关系,并解决梯度消失问题。

#### 4.2.1 自注意力

自注意力机制允许模型关注自身序列中的不同部分。它计算每个时间步与其他所有时间步之间的相似度,并使用这些相似度对输出进行加权。

```python

import tensorflow as tf

# 定义自注意力层

attention_layer = tf.keras.layers.Attention()

# 输入数据

input_data = tf.keras.Input(shape=(None, 10))

# 通过自注意力层

output, attention_weights = attention_layer(input_data)

```

#### 4.2.2 外部注意力

外部注意力机制允许模型关注外部信息,例如另一个序列或图像。它计算输入序列与外部信息的相似度,并使用这些相似度对输出进行加权。

```python

import tensorflow as tf

# 定义外部注意力层

external_attention_layer = tf.keras.layers.ExternalAttention()

# 输入数据

input_data = tf.keras.Input(shape=(None, 10))

external_data = tf.keras.Input(shape=(None, 20))

# 通过外部注意力层

output, attention_weights = external_attention_layer([input_data, external_data])

```

### 4.3 迁移学习

迁移学习是一种机器学习技术,它利用预训练模型在新的任务上进行学习。在RNN训练中,迁移学习可以帮助模型更快地收敛,并提高性能。

#### 4.3.1 预训练模型

预训练模型是已经在大型数据集上训练过的模型。这些模型可以被用作新任务的起点,并通过微调来适应新任务。

#### 4.3.2 模型微调

模型微调是一种迁移学习技术,它涉及调整预训练模型的参数以适应新任务。微调通常涉及冻结预训练模型的部分层,并仅训练新添加的层。

```python

import tensorflow as tf

# 加载预训练模型

pre_trained_model = tf.keras.models.load_model('pre_trained_model.h5')

# 冻结预训练模型的部分层

for layer in pre_trained_model.layers[:10]:

layer.trainable = False

# 添加新层

new_layer = tf.keras.layers.Dense(units=10, activation='softmax')

# 编译模型

model = tf.keras.Sequential([pre_trained_model, new_layer])

model.compile(optimizer='adam', loss='sparse_categorical_crossentropy', metrics=['accuracy'])

# 训练模型

model.fit(x_train, y_train, epochs=10)

```

# 5. RNN训练技巧:总结与展望**

**5.1 训练技巧的总结**

通过前面的章节,我们深入探讨了各种RNN训练技巧,包括优化损失函数、正则化技术、超参数优化、梯度裁剪、激活函数选择和数据预处理。这些技巧对于提高RNN模型的性能至关重要,有助于解决梯度爆炸、梯度消失、过拟合和欠拟合等常见问题。

**5.2 循环神经网络的未来发展**

RNN训练技巧仍在不断发展,随着新技术的出现,我们有望看到该领域进一步的进步。以下是一些值得关注的未来发展方向:

- **可解释性:**提高RNN模型的可解释性,使我们能够更好地理解模型的行为和预测。

- **高效训练:**探索新的训练算法和优化技术,以提高RNN模型的训练速度和效率。

- **多模态学习:**将RNN与其他机器学习技术相结合,以处理多模态数据,例如文本、图像和音频。

- **量子计算:**利用量子计算的潜力,加速RNN训练和提高模型性能。

**5.3 结论**

RNN训练技巧是构建高效、鲁棒的RNN模型的关键。通过充分利用这些技巧,我们可以解决RNN训练中的常见挑战,并释放RNN的全部潜力,用于各种自然语言处理、时间序列分析和语音识别任务。随着该领域持续发展,我们期待着RNN训练技巧的进一步创新,这将推动RNN模型在未来取得更大的成功。

0

0