LSTM、GRU、Bi-LSTM:RNN模型变种详解,提升模型性能的利器

发布时间: 2024-08-20 09:31:24 阅读量: 15 订阅数: 14

# 1. 循环神经网络(RNN)基础

循环神经网络(RNN)是一种特殊类型的神经网络,专门设计用于处理序列数据。与传统的神经网络不同,RNN具有记忆能力,可以记住过去的信息,并将其用于当前的预测。这种特性使RNN非常适合处理时序数据,例如文本、语音和时间序列。

RNN的基本结构包括一个循环单元,该单元在每个时间步上处理输入序列中的一个元素。循环单元接收来自前一个时间步的隐藏状态和当前时间步的输入,并输出一个新的隐藏状态和一个输出。隐藏状态包含了序列中到目前为止的所有信息的摘要,并用于对当前时间步进行预测。

# 2. RNN模型变种

循环神经网络(RNN)是一种强大的神经网络类型,能够处理序列数据。然而,传统的RNN模型在处理长期依赖关系方面存在局限性。为了解决这个问题,研究人员开发了RNN模型的几种变种,包括长短期记忆网络(LSTM)、门控循环单元(GRU)和双向LSTM(Bi-LSTM)。

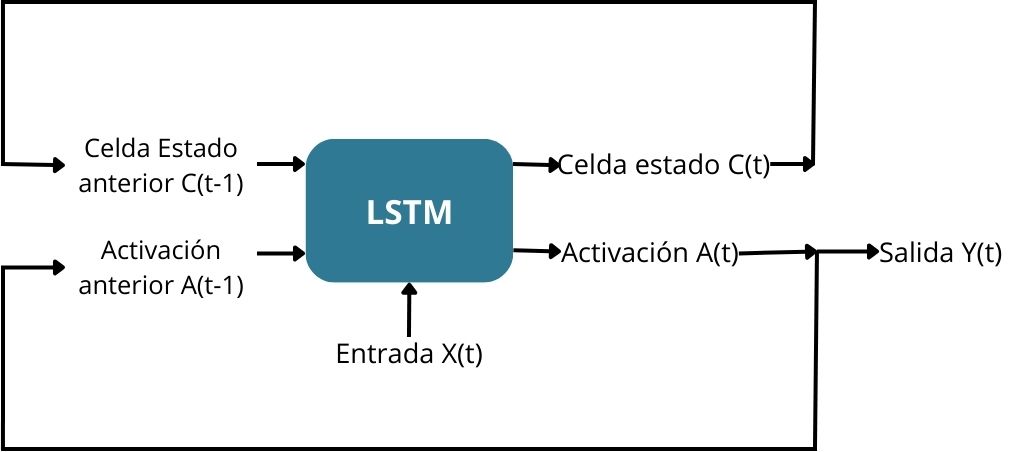

### 2.1 长短期记忆网络(LSTM)

LSTM是一种RNN模型变种,它专门设计用于处理长期依赖关系。LSTM单元具有三个门:输入门、遗忘门和输出门。这些门控制着信息在LSTM单元中的流动。

#### 2.1.1 LSTM的结构和工作原理

LSTM单元的结构如下:

```

LSTM单元 = [输入门, 遗忘门, 输出门, 记忆单元]

```

* **输入门:**控制着新信息的输入。

* **遗忘门:**控制着旧信息的遗忘。

* **输出门:**控制着输出信息的生成。

* **记忆单元:**存储着LSTM单元中的长期信息。

LSTM单元的工作原理如下:

1. **输入门:**计算新信息的权重,并将其添加到记忆单元中。

2. **遗忘门:**计算旧信息的权重,并将其从记忆单元中删除。

3. **记忆单元:**更新记忆单元中的信息,即新信息的权重减去旧信息的权重。

4. **输出门:**计算输出信息的权重,并将其作为LSTM单元的输出。

#### 2.1.2 LSTM的优势和局限性

LSTM具有以下优势:

* 能够处理长期依赖关系。

* 在处理序列数据时具有强大的性能。

LSTM也存在以下局限性:

* 训练时间较长。

* 模型复杂度较高。

### 2.2 门控循环单元(GRU)

GRU是一种RNN模型变种,它与LSTM类似,但结构更简单。GRU单元只有两个门:更新门和重置门。

#### 2.2.1 GRU的结构和工作原理

GRU单元的结构如下:

```

GRU单元 = [更新门, 重置门, 候选隐藏状态]

```

* **更新门:**控制着新信息的输入和旧信息的更新。

* **重置门:**控制着旧信息的重置。

* **候选隐藏状态:**存储着GRU单元中的新信息。

GRU单元的工作原理如下:

1. **更新门:**计算新信息的权重,并将其添加到候选隐藏状态中。

2. **重置门:**计算旧信息的权重,并将其从候选隐藏状态中删除。

3. **候选隐藏状态:**更新GRU单元中的信息,即新信息的权重乘以候选隐藏状态,加上旧信息的权重乘以重置门。

#### 2.2.2 GRU的优势和局限性

GRU具有以下优势:

* 比LSTM训练时间更短。

* 模型复杂度较低。

GRU也存在以下局限性:

* 处理长期依赖关系的能力不如LSTM。

### 2.3 双向LSTM(Bi-LSTM)

Bi-LSTM是一种RNN模型变种,它使用两个LSTM层,一个处理正向序列,另一个处理反向序列。Bi-LSTM的输出是两个LSTM层的输出的拼接。

#### 2.3.1 Bi-LSTM的结构和工作原理

Bi-LSTM的结构如下:

```

Bi-LSTM = [正向LSTM层, 反向LSTM层]

```

* **正向LSTM层:**处理正向序列。

* **反向LSTM层:**处理反向序列。

Bi-LSTM的工作原理如下:

1. **正向LSTM层:**将正向序列输入到LSTM层中,并获得正向LSTM层的输出。

2. **反向LSTM层:**将反向序列输入到LSTM层中,并获得反向LSTM层的输出。

3. **输出:**将正向LSTM层的输出和反向LSTM层的输出拼接在一起,作为Bi-LSTM的输出。

#### 2.3.2 Bi-LSTM的优势和局限性

Bi-LSTM具有以下优势:

* 能够利用序列的正向和反向信息。

* 在处理序列数据时具有强大的性能。

Bi-LSTM也存在以下局限性:

* 训练时间较长。

* 模型复杂度较高。

# 3.1 自然语言处理(NLP)

RNN模型变种在自然语言处理(NLP)领域有着广泛的应用,其中包括:

#### 3.1.1 文本分类和情感分析

文本分类是指将文本数据分配到预定义类别中的任务。RNN模型变种通过学习文本序列中的模式和关系,可以有效地执行此任务。例如,在情感分析中,RNN模型可以识别文本中的情感极性(正面或负面)。

```python

import tensorflow as tf

# 加载预训练的词嵌入

embedding_layer = tf.keras.layers.Embedding(vocab_size, embedding_dim)

# 创建LSTM层

lstm_layer = tf.keras.layers.LSTM(units=128)

# 构建文本分类模型

model = tf.keras.Sequential([

embedding_layer,

lstm_layer,

tf.keras.layers.Dense(units=2, activation='softmax')

])

```

**代码逻辑分析:**

* `embedding_layer`将单词转换为稠密向量表示。

* `lstm_layer`学习文本序列中的长期依赖关系。

* `Dense`层将LSTM输出映射到类别概率分布。

#### 3.1.2 机器翻译和文本摘要

机器翻译是指将一种语言的文本翻译成另一种语言。RNN模型变种通过编码源语言文本并解码目标语言文本,可以有效地执行此任务。文本摘要是指将长文本缩减为更短、更具信息性的摘要。RNN模型变种可以学习文本序列中的重要信息,并生成简洁的摘要。

```python

import tensorflow as tf

# 创建编码器LSTM层

encoder_lstm = tf.keras.layers.LSTM(units=256, return_sequences=True)

# 创建解码器LSTM层

decoder_lstm = tf.keras.layers.LSTM(units=256)

# 构建机器翻译模型

model = tf.keras.Sequential([

encoder_lstm,

decoder_lstm,

tf.keras.layers.Dense(units=target_vocab_size)

])

```

**代码逻辑分析:**

* `encoder_lstm`编码源语言文本,产生一个表示。

* `decoder_lstm`解码表示,生成目标语言文本。

* `Dense`层将解码器输出映射到目标语言词汇表。

# 4. RNN模型变种的优化和调优

### 4.1 超参数调优

超参数调优是优化RNN模型变种性能的关键步骤。它涉及调整模型的超参数,如学习率、批大小和隐藏层大小,以获得最佳结果。

#### 4.1.1 学习率、批大小和隐藏层大小

* **学习率:**控制模型更新权重的速度。较高的学习率可能导致不稳定训练,而较低的学习率可能导致训练缓慢。

* **批大小:**一次训练模型时使用的样本数量。较大的批大小可以提高训练效率,但可能导致过拟合。

* **隐藏层大小:**隐藏层中神经元的数量。较大的隐藏层大小可以提高模型的表示能力,但可能导致过拟合。

#### 4.1.2 正则化和梯度裁剪

正则化技术可以防止模型过拟合,包括:

* **L1正则化:**将权重绝对值之和添加到损失函数中。

* **L2正则化:**将权重平方和添加到损失函数中。

梯度裁剪可以防止梯度爆炸,这是RNN模型中常见的训练问题。它涉及限制梯度范数,防止其变得过大。

### 4.2 模型选择和集成

#### 4.2.1 模型选择策略

模型选择涉及在不同RNN模型变种之间进行选择。常用的策略包括:

* **交叉验证:**将数据集分成训练集和验证集,并在验证集上评估不同模型的性能。

* **超参数搜索:**使用网格搜索或贝叶斯优化等技术在超参数空间中搜索最佳超参数组合。

#### 4.2.2 模型集成方法

模型集成可以提高RNN模型变种的性能,包括:

* **模型平均:**对多个模型的预测进行平均,以获得更鲁棒的结果。

* **加权平均:**根据每个模型的性能为其分配权重,然后对预测进行加权平均。

* **堆叠泛化:**将多个模型的输出作为输入馈送到另一个模型,以获得更高级别的表示。

# 5. RNN模型变种的最新进展

### 5.1 注意力机制

#### 5.1.1 注意力机制的原理和类型

注意力机制是一种神经网络技术,它允许模型关注输入序列中的特定部分。这在处理长序列数据时非常有用,因为模型可以学习哪些部分更重要,哪些部分可以忽略。

注意力机制有两种主要类型:

- **软注意力:**使用可微分函数(如softmax)来计算每个输入元素的权重。这些权重然后用于对输入序列进行加权求和,从而生成一个上下文向量。

- **硬注意力:**使用非可微分函数(如max pooling)来选择输入序列中的一个元素。该元素然后被用作上下文向量。

#### 5.1.2 注意力机制在RNN模型中的应用

注意力机制已被成功应用于各种RNN模型中,包括LSTM和GRU。在这些模型中,注意力机制通常用于:

- **识别重要信息:**注意力机制可以帮助模型识别输入序列中最相关的部分,这对于文本分类和情感分析等任务非常有用。

- **处理长序列:**注意力机制可以帮助模型处理长序列数据,因为它允许模型专注于序列中最重要的部分。

- **生成更准确的预测:**注意力机制可以提高RNN模型的预测准确性,因为它允许模型考虑输入序列中更相关的信息。

### 5.2 Transformer架构

#### 5.2.1 Transformer的结构和工作原理

Transformer是一种神经网络架构,它使用注意力机制来处理序列数据。Transformer与传统的RNN模型不同,因为它不使用循环连接。相反,它使用自注意力机制来计算输入序列中每个元素与其他所有元素之间的关系。

Transformer由以下组件组成:

- **编码器:**编码器将输入序列转换为一组向量。

- **解码器:**解码器使用编码器生成的向量来生成输出序列。

- **自注意力层:**自注意力层计算输入序列中每个元素与其他所有元素之间的关系。

- **前馈层:**前馈层是一个完全连接的神经网络层,它对自注意力层的输出进行处理。

#### 5.2.2 Transformer在NLP领域的应用

Transformer在自然语言处理领域取得了巨大的成功。它已被用于各种任务,包括:

- **机器翻译:**Transformer已被证明比传统的RNN模型在机器翻译任务上更有效。

- **文本摘要:**Transformer可以用来生成文本摘要,它可以捕捉文本的主要思想。

- **问答:**Transformer可以用来回答问题,它可以从文本中提取相关信息。

# 6. RNN模型变种的未来展望

### 6.1 持续的优化和改进

随着计算能力的不断提升和机器学习算法的持续发展,RNN模型变种仍有广阔的优化和改进空间。

**6.1.1 新型激活函数和优化算法**

激活函数和优化算法是神经网络模型的关键组成部分。目前,常用的激活函数包括ReLU、sigmoid和tanh,而优化算法则包括梯度下降、动量法和RMSprop。未来,研究人员将探索新的激活函数和优化算法,以提高RNN模型变种的性能和训练效率。

**6.1.2 可解释性和可视化技术**

RNN模型变种的复杂性给其可解释性和可视化带来了挑战。未来,研究人员将致力于开发新的技术,以帮助理解和解释RNN模型变种的行为。这将有助于提高模型的透明度和可靠性。

### 6.2 跨领域应用

RNN模型变种的强大时序建模能力使其在自然语言处理和时序预测领域取得了巨大的成功。未来,RNN模型变种有望在其他领域得到广泛应用。

**6.2.1 计算机视觉**

计算机视觉领域涉及图像和视频的处理和分析。RNN模型变种可以用于时序图像序列的分析,例如视频理解、动作识别和目标跟踪。

**6.2.2 推荐系统和强化学习**

推荐系统和强化学习是人工智能的重要分支。RNN模型变种可以用于序列数据的建模和预测,从而提高推荐系统的准确性和强化学习算法的效率。

0

0