Python JSON数据处理之并行计算:提升速度的秘诀

发布时间: 2024-09-20 05:41:36 阅读量: 283 订阅数: 73

# 1. JSON数据处理概述

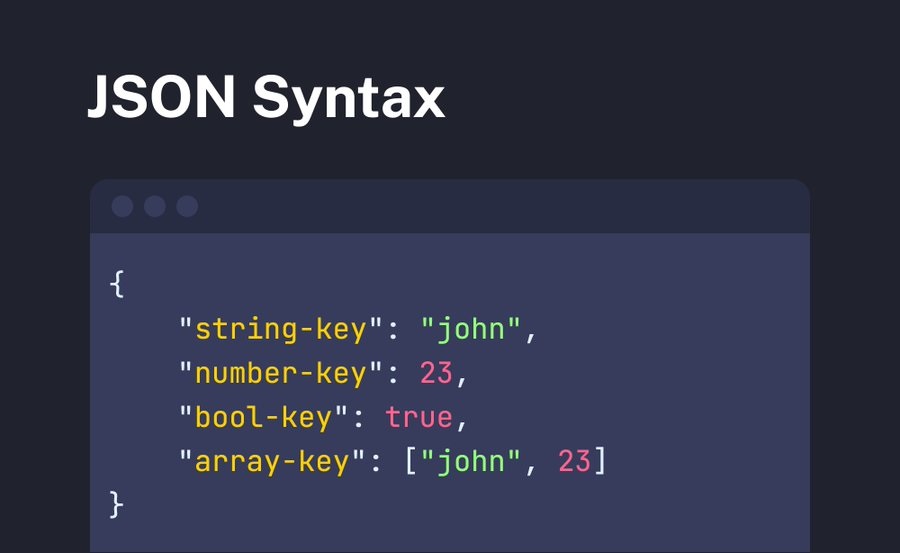

在数据交换的场景中,JSON(JavaScript Object Notation)格式以其轻量级、易于人阅读和编写的特点,成为了网络上最常用的文本数据交换格式之一。本章将介绍JSON数据格式的基本概念,以及在处理JSON数据时,开发者需要关注的关键点和技巧。

## 1.1 JSON数据的构成和作用

JSON数据主要由键值对组成,支持字符串、数字、数组、布尔值、null以及嵌套的数据结构。JSON在前端和后端的数据交换中,扮演着承上启下的角色,它使得数据从服务器到客户端的传输变得简洁明了。

## 1.2 JSON与XML的对比

相较于XML,JSON的数据结构更简单,代码更简洁,解析速度更快,因此它在Web开发中逐渐取代XML成为了主流的数据交换格式。

## 1.3 JSON数据处理的重要性

在大数据时代,掌握JSON数据处理技术对于IT从业者尤为重要。它不仅涉及到前后端的数据交互,还关乎到数据存储、处理与分析的效率和质量。通过对JSON数据的有效管理,开发者可以大大提升应用的性能,并优化用户体验。

在后续章节中,我们将深入探讨JSON数据处理的高级技巧以及如何利用并行计算技术来进一步提升数据处理的效率。

# 2. 并行计算基础与原理

### 2.1 并行计算概念解析

并行计算是利用多个计算资源同时解决计算问题的一种计算方式,与传统的串行计算相对。在当前大数据和人工智能时代,对于计算能力和速度的需求不断提升,单个处理器难以满足高效处理的需求。因此,通过并行计算来提升数据处理效率,缩短计算时间成为了必然趋势。

#### 2.1.1 并行与串行的对比

串行计算中,程序的指令按顺序一个接一个地执行,这意味着在任何时刻,只有一个指令在被执行,其它指令等待。这种方式的局限在于它不能充分利用现代计算机的多核处理器资源,导致计算资源的浪费。

相比之下,并行计算允许多个计算过程同时进行,从而能够有效利用多核处理器的计算能力。它在执行计算任务时,可以将大任务分解为小任务,分别在不同的处理器上并行执行,从而大幅缩短整体执行时间。

#### 2.1.2 并行计算的分类

并行计算可以分为以下几种类型:

- 数据并行:将数据分配到不同的处理器上,每个处理器执行相同的操作,适用于大量重复性的数据处理。

- 任务并行:将独立的任务分配到不同的处理器上并行执行,适用于多个独立任务的处理。

- 流水线并行:类似于工厂中的流水线作业,将一个任务划分为多个阶段,每个阶段由不同的处理器处理,各阶段并行推进。

- 混合并行:结合数据并行和任务并行,可以更灵活高效地处理复杂问题。

### 2.2 并行计算在Python中的应用

Python作为一种高级编程语言,因其简洁的语法和强大的库支持,在并行计算领域也有广泛的应用。

#### 2.2.1 多进程和多线程基础

Python中的多进程是通过`multiprocessing`模块实现的,它能够创建多个进程,并且让它们在不同的CPU核心上运行。多进程特别适合于CPU密集型的任务,因为进程间相互独立,不会受到全局解释器锁(GIL)的限制。

```python

import multiprocessing

def worker(num):

"""线程工作函数"""

print('Worker:', num)

if __name__ == '__main__':

processes = []

for i in range(5):

p = multiprocessing.Process(target=worker, args=(i,))

processes.append(p)

p.start()

for p in processes:

p.join()

```

在上述代码中,创建了5个子进程,并且每个子进程执行`worker`函数。

而多线程则通过`threading`模块实现,它适用于I/O密集型任务。Python中的线程由于GIL的存在,并不能充分利用多核处理器进行并行计算,但是在进行网络请求、文件读写等I/O操作时,多线程可以提高程序效率。

```python

import threading

def thread_function(name):

"""线程函数"""

print(f'Thread {name}: starting')

# Do something here...

print(f'Thread {name}: finishing')

if __name__ == '__main__':

threads = []

for index in range(3):

x = threading.Thread(target=thread_function, args=(index,))

threads.append(x)

x.start()

for index, thread in enumerate(threads):

thread.join()

```

以上代码展示了如何创建和启动多个线程。

#### 2.2.2 并行库选择与介绍

除了Python标准库外,还有许多第三方库可以用来进行更高级的并行计算,如`concurrent.futures`模块,它提供了一个高层次的异步执行接口。`asyncio`库则是用于编写单线程并发代码的库,适合于涉及异步I/O,网络和Web服务的应用。

```python

import concurrent.futures

def divide(x, y):

try:

result = x / y

except ZeroDivisionError:

print("division by zero!")

else:

print("result is", result)

with concurrent.futures.ThreadPoolExecutor(max_workers=4) as executor:

executor.map(divide, [1, 2, 3, 4], [0, 5, 6, 7])

```

这个例子使用`ThreadPoolExecutor`来并行执行`divide`函数。

### 2.3 并行计算的性能优化

并行计算的性能优化是确保高效利用计算资源的关键。有效的方法包括负载均衡、任务分配、以及并行计算中的同步和通信机制。

#### 2.3.1 负载均衡与任务分配

负载均衡是指在并行计算中,合理分配任务到各个处理器,确保每个处理器的工作负载接近平均值。这是通过在启动任务前对任务进行预处理,将大任务分割为小任务,然后根据处理器的能力和任务特性来合理分配。

#### 2.3.2 并行计算中的同步和通信机制

同步和通信机制是确保并行程序正确运行的关键。在并行程序中,多个任务可能需要访问共享资源,这就需要通过锁、事件、条件变量、信号量等机制来确保数据的一致性和同步。

```python

import threading

class SharedCounter:

def __init__(self, initial_value=0):

self._value = initial_value

self._value_lock = threading.Lock()

def increment(self):

with self._value_lock:

self._value += 1

def value(self):

with self._value_lock:

return self._value

counter = SharedCounter()

def worker():

for _ in range(2000):

counter.increment()

threads = []

for _ in range(20):

t = threading.Thread(target=worker)

t.start()

threads.append(t)

for t in threads:

t.join()

print(counter.value())

```

以上代码展示了如何通过锁来保护共享资源,防止数据竞争。

以上,我们完成了并行计算基础与原理章节的内容,介绍了并行计算的基本概念、并行与串行的区别、并行计算的分类、在Python中的应用以及性能优化的相关知识。在下一章,我们将深入探讨如何将这些原理应用于JSON数据处理,以及如何通过并行计算提升JSON处理的效率。

# 3. Python中JSON数据处理技巧

## 3.1 Python对JSON数据的基本操作

### 3.1.1 解析JSON数据

JSON(JavaScript Object Notation)是一种轻量级的数据交换格式,易于人阅读和编写,同时也易于机器解析和生成。在Python中,处理JSON数据通常涉及到解析和生成这两个基础操作。解析JSON数据意味着将JSON格式的字符串转化为Python中的数据结构,例如列表或字典。Python的`json`模块提供了这一功能。

下面是一个简单的示例代码,用于解析JSON数据:

```python

import json

# JSON数据示例

json_data = '{"name": "John", "age": 30, "city": "New York"}'

# 解析JSON数据

data = json.loads(json_data)

# 打印解析后的数据

print(data)

```

执行上述代码后,`json.loads`函数会将JSON字符串`json_data`转化为Python字典对象,然后我们就可以使用Python的字典操作来访问这些数据。

解析JSON数据的过程涉及到字符编码,JSON模块默认按照UTF-8编码解析数据。如果遇到编码问题,可以通过`encoding`参数显式指定输入数据的编码格式。例如:

```python

data = json.loads(json_data, encoding='utf-16')

```

在解析包含嵌套数据结构的复杂JSON数据时,`json.loads`同样能很好地处理。处理大数据时,可能需要考虑性能优化,比如使用`iterparse`进行增量解析。

### 3.1.2 生成JSON数据

与解析JSON数据相对应的操作是生成JSON数据,即把Python的数据结构转换成JSON格式的字符串。Python的`json`模块同样提供了这样的功能,通过`json.dumps`方法来实现。

下面是一个示例代码,用于生成JSON数据:

```python

import json

# Python字典数据

data = {

"name": "John",

"age": 30,

"city": "New York"

}

# 将Python字典转换为JSON格式的字符串

json_data = json.dumps(data)

# 打印生成的JSON数据

print(json_data)

```

执行上述代码后,`json.dumps`函数将字典`data`转换成一个JSON格式的字符串,存储在`json_data`变量中。和解析JSON数据一样,`dumps`方法也支持各种参数来控制输出的格式,例如`indent`参数可以用来美化输出的JSON数据,使其易于阅读。

在生成JSON数据时,需要注意避免编

0

0