HDFS故障排查与副本修复实战:案例深度解析与解决方案

发布时间: 2024-10-28 06:50:50 阅读量: 63 订阅数: 45

# 1. HDFS基本原理与架构解析

## 1.1 HDFS的基本概念

HDFS(Hadoop Distributed File System)是一个高度容错性的系统,适合在廉价硬件上运行。HDFS提供了高吞吐量的数据访问,非常适合大规模数据集的应用。它被设计用来跨机器存储大量数据,并提供对这些数据的高吞吐量访问。

## 1.2 HDFS的架构设计

HDFS采用主从架构,主要包含两类节点:NameNode(主节点)和DataNode(数据节点)。NameNode负责管理文件系统的命名空间和客户端对文件的访问,而DataNode则负责处理文件系统客户端的读写请求。

```mermaid

graph LR

A[Client] -->|请求| B(NameNode)

B -->|元数据信息| A

B -->|指令| C[DataNode]

C -->|数据| A

```

## 1.3 HDFS的关键特性

HDFS具备高容错性、高吞吐量和适用于流式数据访问模式的特点。它通过数据复制来实现高容错性,保证在单点故障的情况下,数据仍然可用。同时,HDFS支持大文件存储,适合于处理大规模数据集。

# 2. HDFS常见故障类型与诊断技巧

## 2.1 HDFS故障排查的理论基础

### 2.1.1 HDFS的核心组件和工作流程

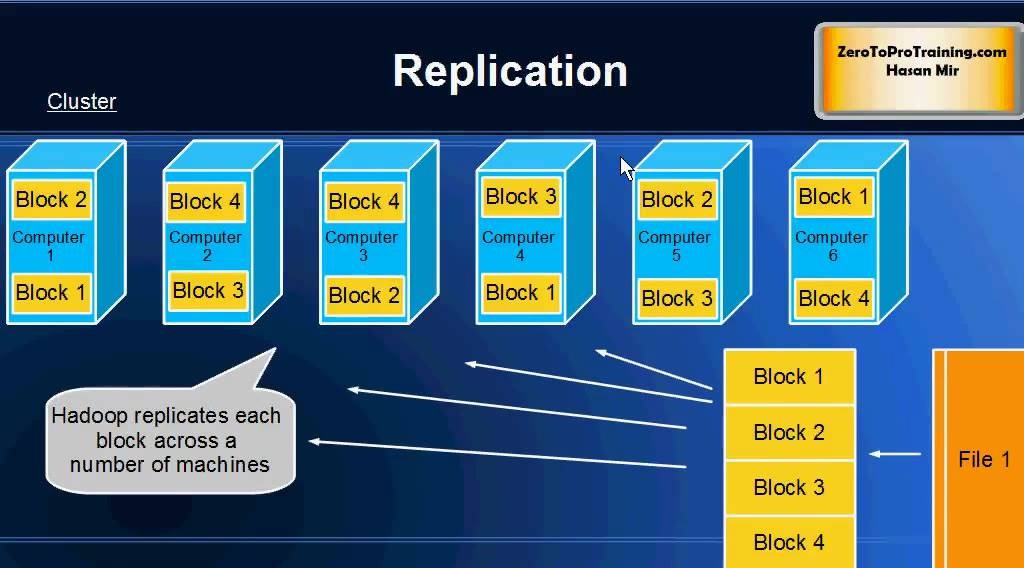

Hadoop Distributed File System (HDFS) 是一个高度容错的系统,用于存储大量数据。它通过将文件分割成块(block),然后将这些块分布存储在不同节点上以实现数据的高可靠性。HDFS的关键组件主要包括NameNode、DataNode,以及Secondary NameNode。

NameNode是HDFS的主节点,负责管理文件系统的命名空间,记录文件到块的映射信息,并控制客户端对文件的访问。DataNode是实际存储数据的节点,它响应来自客户端的读写请求,并在本地文件系统中管理数据块的存储。Secondary NameNode则辅助NameNode,定期合并文件系统的命名空间状态和文件块映射信息,以减少重启NameNode时的加载时间。

HDFS的工作流程从客户端发起写请求开始,客户端首先向NameNode询问文件存储的位置,然后将数据直接写入指定的DataNode节点。对于读操作,客户端查询NameNode获取数据块的位置,然后直接从DataNode读取数据。数据的复制、删除和命名空间的维护等操作都由NameNode负责。

### 2.1.2 故障类型分类与基本诊断方法

在HDFS操作过程中可能遇到的故障类型大致可分为几类:网络问题、硬件故障、软件Bug以及配置错误等。了解这些故障类型对于后续的故障排查至关重要。

- 网络问题:在HDFS集群中,节点间的通信依赖网络,因此网络故障可能导致节点间通信中断,进而影响数据读写。

- 硬件故障:包括但不限于磁盘故障、内存泄漏和电源问题。硬件故障会导致DataNode或NameNode节点宕机。

- 软件Bug:Hadoop组件自身的Bug也可能引起各种意外行为。

- 配置错误:不正确的配置会直接影响集群的稳定运行。

基本的诊断方法通常涉及检查日志文件、系统状态和网络连接。通过查看NameNode和DataNode的日志,可以获得关于错误的详细信息。使用Hadoop自带的命令行工具,比如`hdfs dfsadmin -report`,可以获取整个集群的健康状态。同时,使用网络诊断工具(如ping、traceroute)来检查网络连接也是必不可少的步骤。

## 2.2 实践中的故障排查案例分析

### 2.2.1 常见读写故障排查实例

当HDFS集群遇到读写故障时,排查的第一步通常是检查网络连接是否正常。例如,在客户端尝试读取数据时,如果没有响应,可能是网络分区导致节点间通信失败。此时,`hdfs dfsadmin -report`命令可以帮助我们快速检查集群状态。

```

hdfs dfsadmin -report

```

如果发现某一DataNode不在线或报告有错误,可以通过检查该节点的日志来诊断问题。日志通常位于`/var/log/hadoop-hdfs/`目录下。

```

tail -f /var/log/hadoop-hdfs/hadoop-hdfs-datanode-<host>.log

```

### 2.2.2 NameNode与DataNode异常处理

NameNode是整个HDFS集群的大脑,其异常通常会导致整个集群不可用。当NameNode宕机时,集群的任何写操作都无法完成。这时,我们可以通过`hdfs fsck`命令来检查文件系统的完整性。

```

hdfs fsck /

```

DataNode异常则通常表现为节点下线或者磁盘空间不足。DataNode宕机会导致它所管理的数据块不可用,此时需要检查DataNode的日志文件,并根据日志内容判断是重启节点还是进行磁盘维护。

```

service hadoop-hdfs-datanode start

```

### 2.2.3 网络分区与数据一致性问题

网络分区是分布式系统中的一个常见问题,HDFS中也会遇到。网络分区可能导致集群中的节点失去联系,从而影响数据的一致性。例如,一个节点可能无法及时从NameNode获取最新信息,导致数据操作延迟或失败。

处理网络分区问题,首先要确保网络配置正确,例如使用心跳机制来检测节点间的连接状态,并设置合理的超时时间。其次,当网络分区发生时,需要依据HDFS的高可用性设计来恢复服务,如进行故障转移和数据复制等操作。

## 2.3 HDFS日志分析与问题定位

### 2.3.1 日志文件的重要性及读取方法

HDFS的日志文件记录了系统的运行状态和各种事件信息,对于故障排查至关重要。NameNode和DataNode的日志分别记录了主节点和工作节点的状态,这些日志文件通常位于集群中每个节点的`/var/log/hadoop-hdfs/`目录下。

读取HDFS日志最直接的方法是使用`tail`命令查看日志文件的末尾部分,这通常包含最新的日志信息。

```

tail -f /var/log/hadoop-hdfs/hadoop-hdfs-namenode-<host>.log

```

### 2.3.2 典型错误日志的识别与解读

在故障排查过程中,识别和解读典型错误日志是关键步骤。例如,当NameNode启动失败时,它的日志文件中会包含错误信息,如:

```

2023-03-15 10:20:41,123 INFO org.apache.hadoop.hdfs.server.namenode.FSEditLog: Number of transactions: 1000 Total time for transactions(ms): 1000 Average time for transactions(ms): 1

2023-03-15 10:20:41,123 WARN org.apache.hadoop.hdfs.server.namenode.FSEditLog: Failed to create log segment ***

```

在这个例子中,错误信息表明`edits_inprogress_***`文件无法创建,可能是因为磁盘空间不足或权限问题。通过这样的错误提示,我们可以快速定位问题所在,并采取相应的修复措施,如清理空间或修改权限。

通过这一系列的理论基础和案例分析,我们对HDFS故障排查有了更深入的理解。接下来,我们将继续探讨HDFS副本管理与修复机制,以确保数据的高可靠性和完整性。

# 3. HDFS副本管理与修

0

0