θ

1

,

t1

θ

2

,

t2

N

3

D

(

I

,

J

,

i

)

N

2

D

(

I

,

J

,

i

)

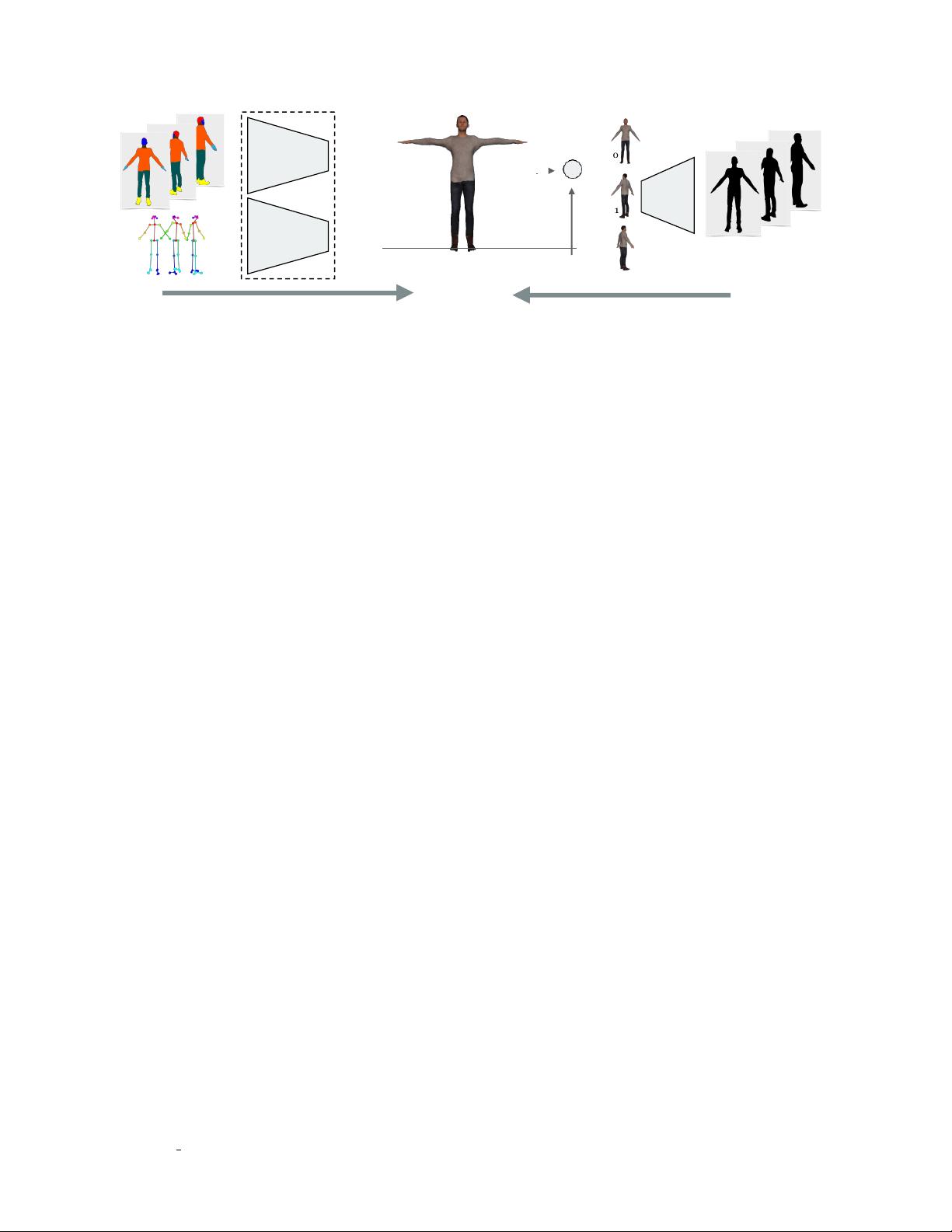

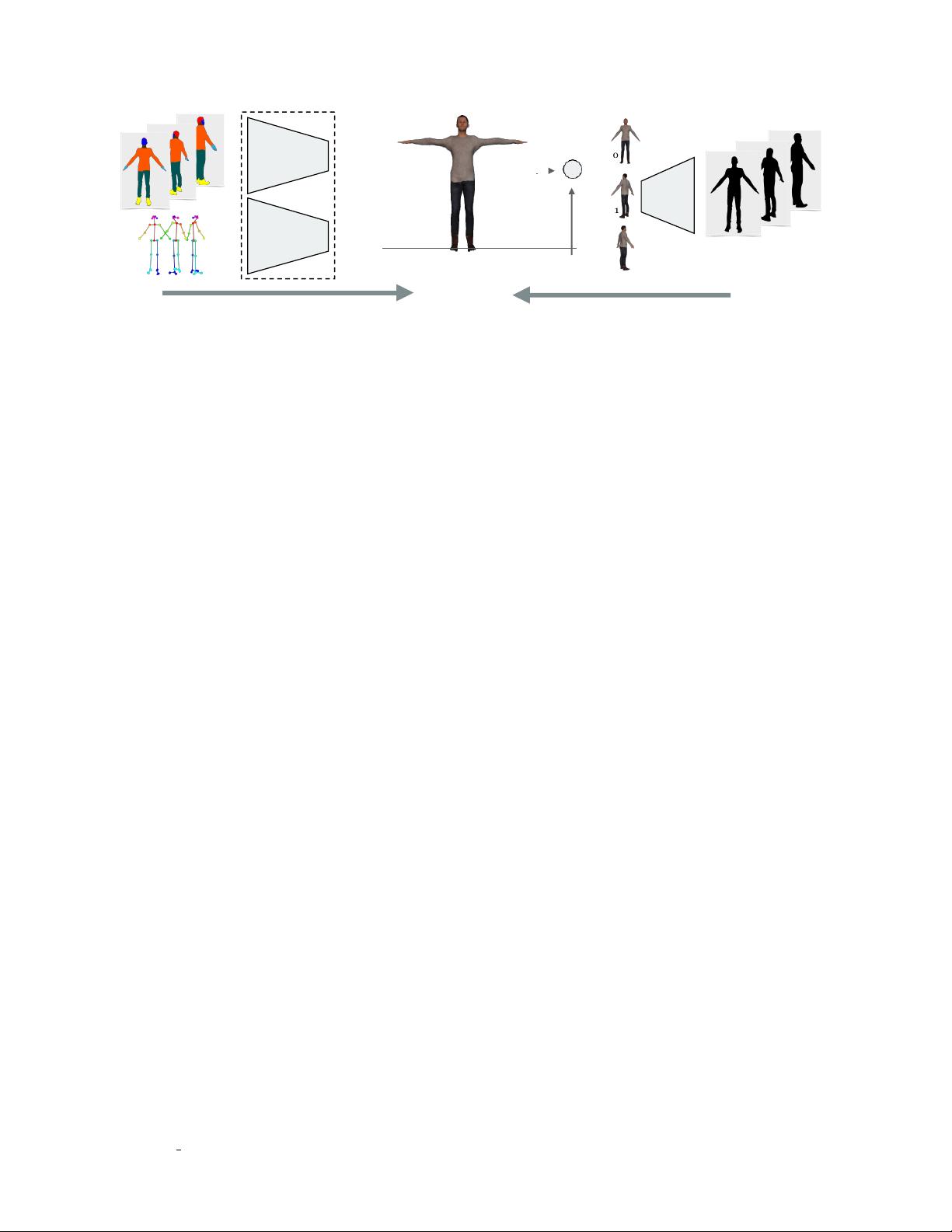

图2.我们的方法概述:我们的新CNN预测3D人体形状的语义图像在一个规范的姿势连同每图像的姿势信息计算从2D关节检测

(左到中心)。姿态信息可以用于经由使用相同预测器(右到中心)的

“

渲染和比较

”

优化来细化形状

:

(

I

,

J

)

›→

(

β

,

D

,

P

,

T

)是一个

CNN

参数

化,

网络参数

w

.

输入方式。人类的图像在外观上高度多样化,在深

度学习的背景下需要大量的注释图像数据集。因此,

为了提取尽可能多的信息,同时仍然保留形状和姿态

信号,我 们在以前的 工 作[29,13]的基础 上将每个

RGB图像简化为语义分割和2D关键点检测。这使我们

能够只使用合成数据来训练网络,并推广到真实数

据。

模型参数化。通过整合

SMPL+D

模型(第

3.1

)到

我们的网络公式中,我们可以在训练中使用它的网格

输 出 。 具 体 地 说 , 我 们 以 三 种 方 式 监 督 预 测 的

SMPL+D

参数:直接在网 格顶点

M

(

β

,

θ

,

D

)

上,在预测的关节位置

J

(

β

)及其在图像上的投影

上,以及密集地在使用

差分渲染器[35]。

公式(

1

)中的

T

形(

T

+

Bs

(

β

)

+

D

)现在用以

下函数从语义图像

I

的集合预测

2

S

(

I

)

=T+

B

(

f

β

(

I

))

+

f

D

(

I

)

,

(

3

)

平面透视投影

π

:

N

J

2

D

(

I

,

J

,

i

)

=

π

c

(

N

J

3

D

(

I

,

J

,

i

))

(

8

)

所有这些操作都是可微的,我们可以方便地使用它来

制定合适的损失函数。

3.3.

损失函数

我们的架构允许两种监督来源:(i)3D监督(在

我们的实验中,来自通过将SMPL+D拟合到静态扫描

而得到的合成数据),以及(ii)仅来自视频帧的2D

监督。在本节中,我们将讨论

不同的损失函数用于训练预测因子

f

。

对于数据集

{

(

I

,

J

)

,

(

β

,

D

,

P

,

T

)

}

中的

配对样本,我们在估计模型

N

3D

和地面实况模型

M

(

·

)扫描之间使用

•

正则T姿态0

θ

中的每顶点损失。这种损失提供了一

个有用的3D监督形状独立的姿态:

L

S

=

||

S

(

I

)

−

M

(

β

,

0

θ

,

D

)

||

二

(九)

其中

f

是

要学习的回归量。类似地,通过以下函数从

图像

I i

和

2D

关节

J i

预测网格姿态

N3D

(

I

,

J

,

i

):

D

(

I

,

J

,

i

)

=

W

(

P

(

I

,

i

)

,

J

(

f

β

(

I

))

,

f

θ

i

(

I

,

J

)

,

W)

(

4

)

•

定态空间中的逐点损失。这种损失监督欧几里得

空间上的姿势和形状:

F

Σ

−

1

L = ||

N

3

D

(

I

,

J

,

i)

−

M(

β

,

θ

,

D

)

||

(十)

P

(

I

,

J

,

i

)=

S

(

I

)+

Bp

(

f

θ

i

(

I

,

J

))

,

(

5

)

根据该模型,使用线性回归预测3D关节

i

=0

时

其中b(I

i

)是二进制分割掩码,并且

Rc

是

J

B25

已被训练为输出与BODY 25 [1]关键点排序一致的25

个关节位置。所估计的已设定姿势的网格N

3D

可以用由相机c参数化的