"本专题主要探讨了无约束优化的方法,包括一维线性搜索、多元函数的最速下降法和牛顿法,以及针对牛顿法的改进策略——共轭方向法和拟牛顿法。文档重点在于数学公式的推导,帮助深入理解无约束优化问题。"

在无约束优化领域,寻找函数的最小值或最大值是关键任务。这篇文档首先介绍了最简单的一维线性搜索方法,包括黄金分割法、斐波那契数列法、牛顿法和割线法。这些方法主要用于单变量函数的优化,通过迭代逐步逼近极小点。

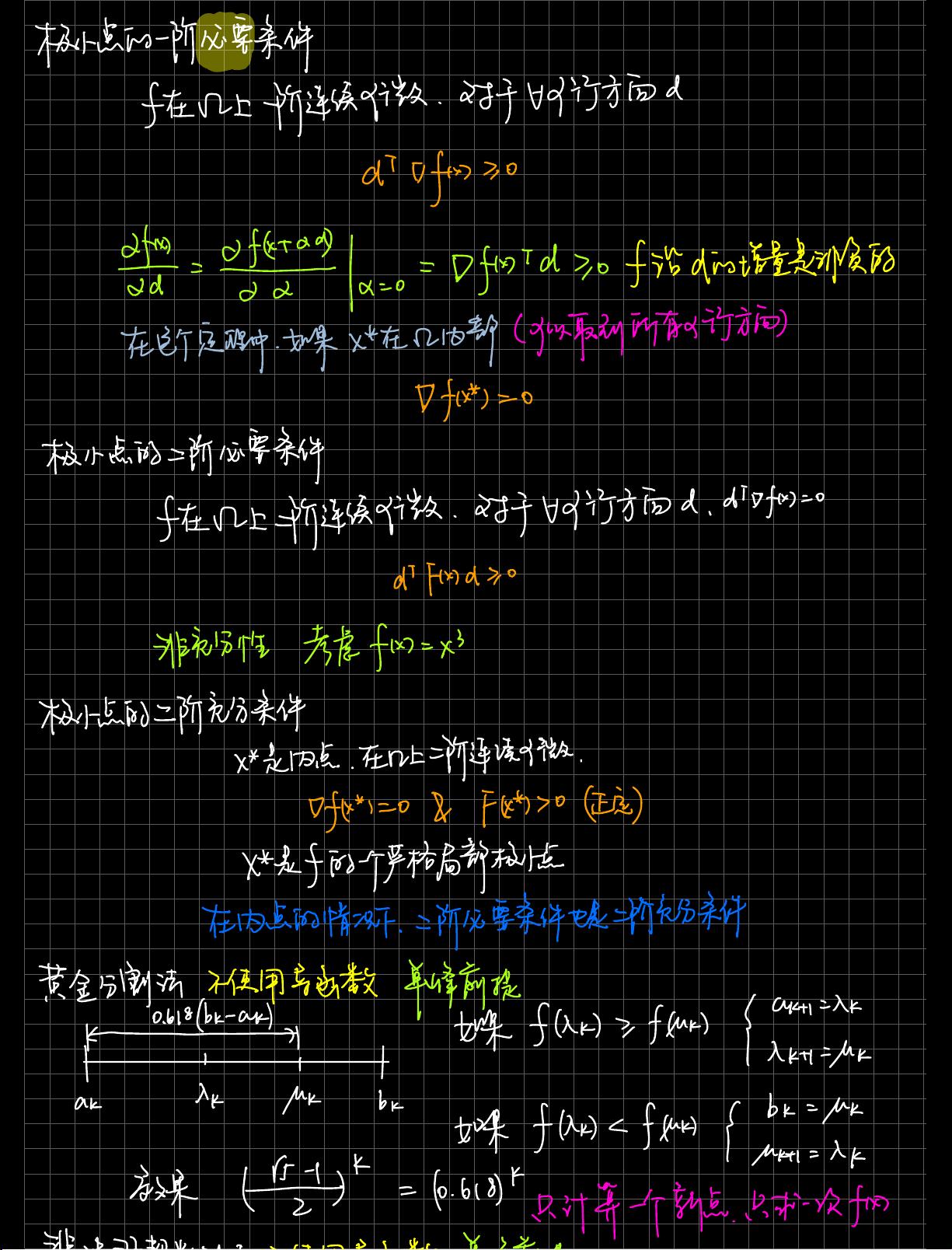

黄金分割法是一种基于黄金分割比例的搜索方法,它不需要函数的导数信息,但通常比其他一维搜索方法需要更多的迭代次数。斐波那契数列法与黄金分割法类似,不过它利用斐波那契数列的性质来确定搜索间隔,同样不依赖导数信息。

接着,文档转向多元函数的优化,讨论了最速下降法和牛顿法。最速下降法是基于梯度信息的优化算法,每次迭代沿着梯度的反方向移动,以期望最快地下降到局部极小值。而牛顿法则进一步考虑了Hessian矩阵(二阶导数矩阵),通过迭代更新来更快速地接近极小点,但计算Hessian矩阵可能带来较高的计算复杂度。

为了改善牛顿法的效率,文档提到了共轭方向法和拟牛顿法。共轭方向法不需要直接计算Hessian矩阵,而是通过一系列相互正交的搜索方向进行迭代。拟牛顿法则是对牛顿法的一种近似,它利用迭代过程中得到的信息构造一个近似的Hessian矩阵逆,从而降低了计算成本。

文档特别强调了优化方法的数学推导,这对于深入理解这些方法的工作原理至关重要。一阶必要条件指出,函数在极小点处的梯度为零,而二阶充分条件涉及Hessian矩阵的性质,例如,如果在极小点处Hessian矩阵是正定的,那么该点是函数的一个严格局部极小点。

此外,文档还对比了黄金分割法、斐波那契数列法和二分法的收敛速度,以及牛顿法与它们之间的差异。二分法和牛顿法均依赖于一阶和二阶导数,但牛顿法的收敛速度通常更快,因为它利用了二阶信息。然而,牛顿法的实施需要计算Hessian矩阵,这在高维度问题中可能是昂贵的。

这篇文档提供了一个全面的概述,涵盖了无约束优化中的基本概念和高级策略,是学习和复习最优化方法的良好资源。