在计算机视觉Lecture 4中,主要讨论了神经网络和反向传播的基础概念,特别是围绕L03部分,即损失函数和优化。这一章节的核心知识点包括:

1. **损失函数**:

损失函数(Loss Function)是评估模型预测结果与实际标签之间差距的关键指标,如均方误差(MSE)或交叉熵(Cross-Entropy)。在公式 \(LL(W) = \frac{1}{N}\sum_{i=1}^{N}l(f(W,x_i), y_i) + \lambda\|\omega\|_p\) 中,\(l\) 表示单个样本的损失,\(N\) 是样本总数,\(f(W,x)\) 是模型预测,\(y_i\) 是真实标签,\(\lambda\) 是正则化项,用于防止过拟合,\(\|\omega\|_p\) 是权重的某种范数。

2. **正则化**:

正则化通过添加一个对模型复杂度的惩罚项,如L1或L2范数,帮助提高模型的泛化能力,使得模型在训练数据上表现良好时,也能适应新的、未见过的数据。

3. **数值梯度与解析梯度**:

数值梯度是通过微小变化计算损失函数对参数的敏感度,而解析梯度则是直接求导得到,后者通常更高效。了解这两种方法对于优化过程至关重要。

4. **随机梯度下降(SGD)**:

一种常用的优化算法,每次迭代只使用一个样本来更新模型参数,适合大规模数据集,但可能会导致不稳定性。

5. **线性分类器的局限**:

线性分类器(如逻辑回归)只能处理线性可分的问题,无法处理非线性关系,这提示我们需要引入非线性函数或更复杂的模型结构。

6. **神经网络的参数数量**:

对于输入变量为n的线性模型,参数数量为\(O(n^1) + O(n^2) + O(n^3) + ... + O(n^n)\),而神经网络可以通过增加多层和高阶多项式项来扩展模型容量,处理非线性问题。

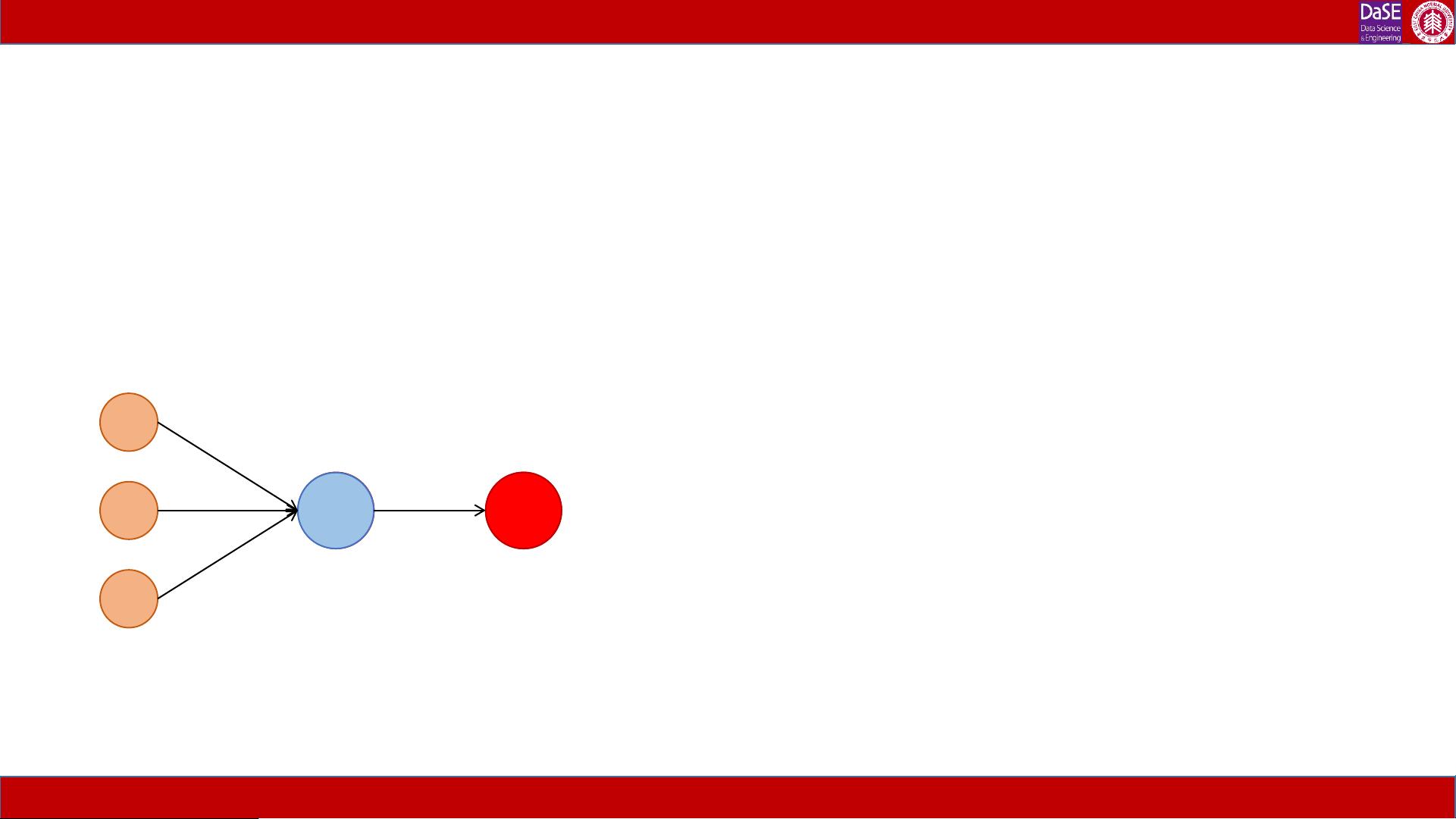

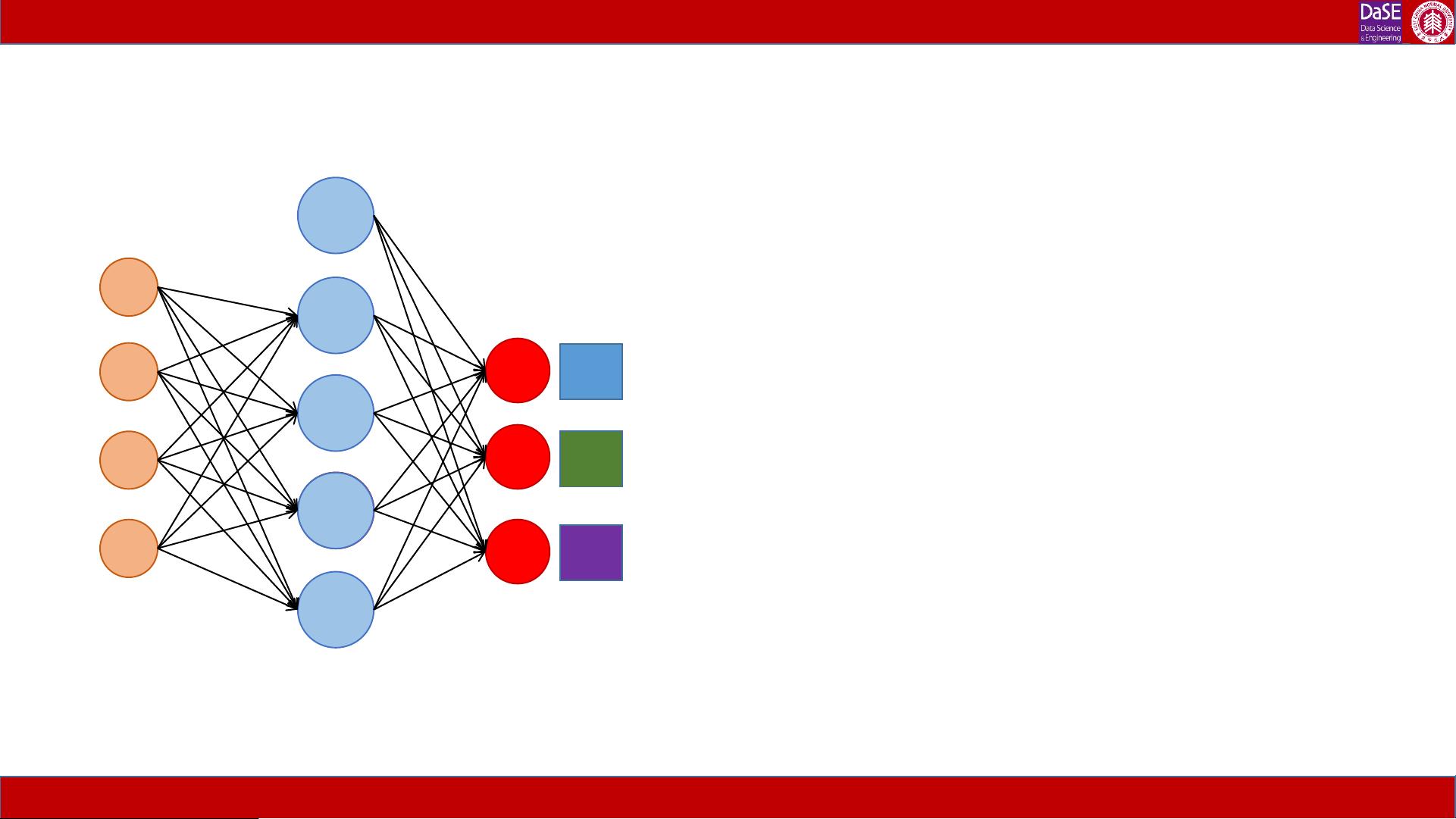

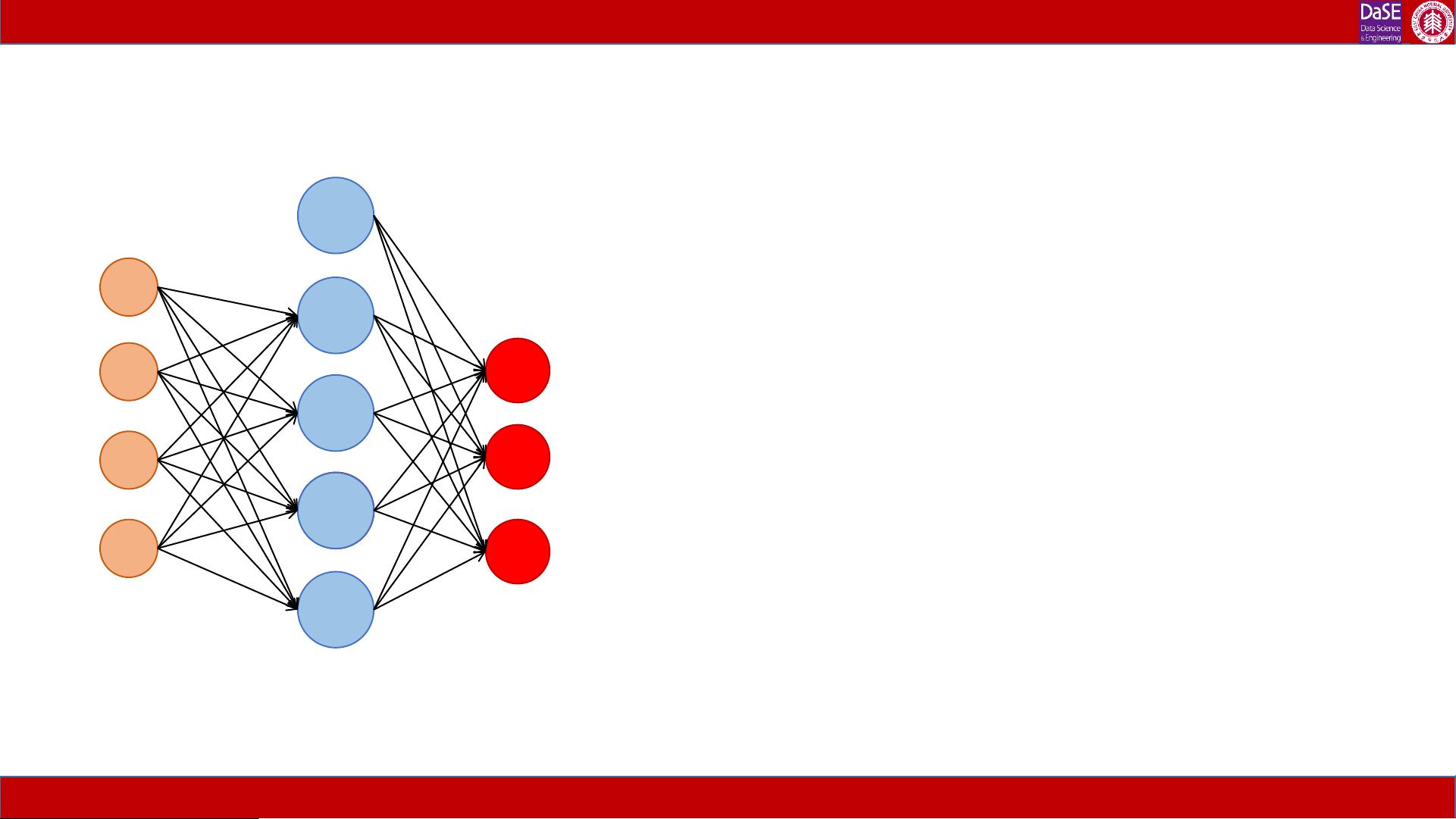

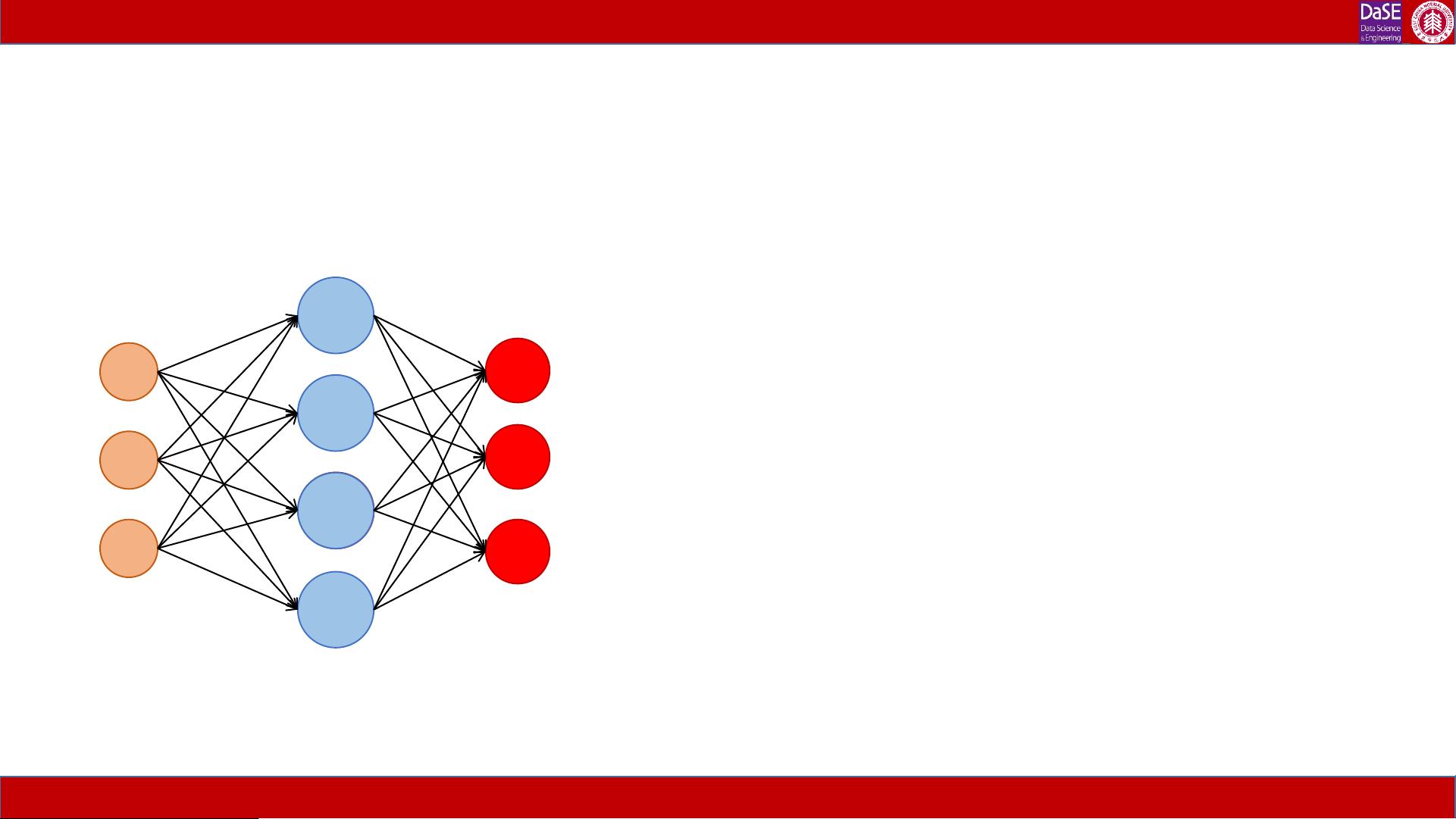

7. **神经网络架构**:

神经网络由多个神经元组成,每个神经元接受输入并经过激活函数处理,形成非线性映射。激活函数如Sigmoid(\(\sigma(x) = \frac{1}{1+e^{-x}}\))是关键组件,它们增加了模型的表达能力。

8. **激活函数**:

除了线性函数外,非线性激活函数如Sigmoid、ReLU等广泛应用于神经网络,它们为模型引入了非线性特性,使其能够处理更复杂的模式。

9. **特定示例**:

提供了一个简单的逻辑门问题,其中输入变量为二进制(0或1),表明通过组合可以实现AND逻辑,这展示了神经网络如何通过非线性组合处理更复杂的逻辑关系。

这一章节深入探讨了神经网络的结构、优化方法以及它们在解决线性不可分问题中的优势,强调了正则化和激活函数在提升模型性能中的作用。通过理解这些概念,学习者可以更好地设计和优化深度学习模型。