.

3.2.

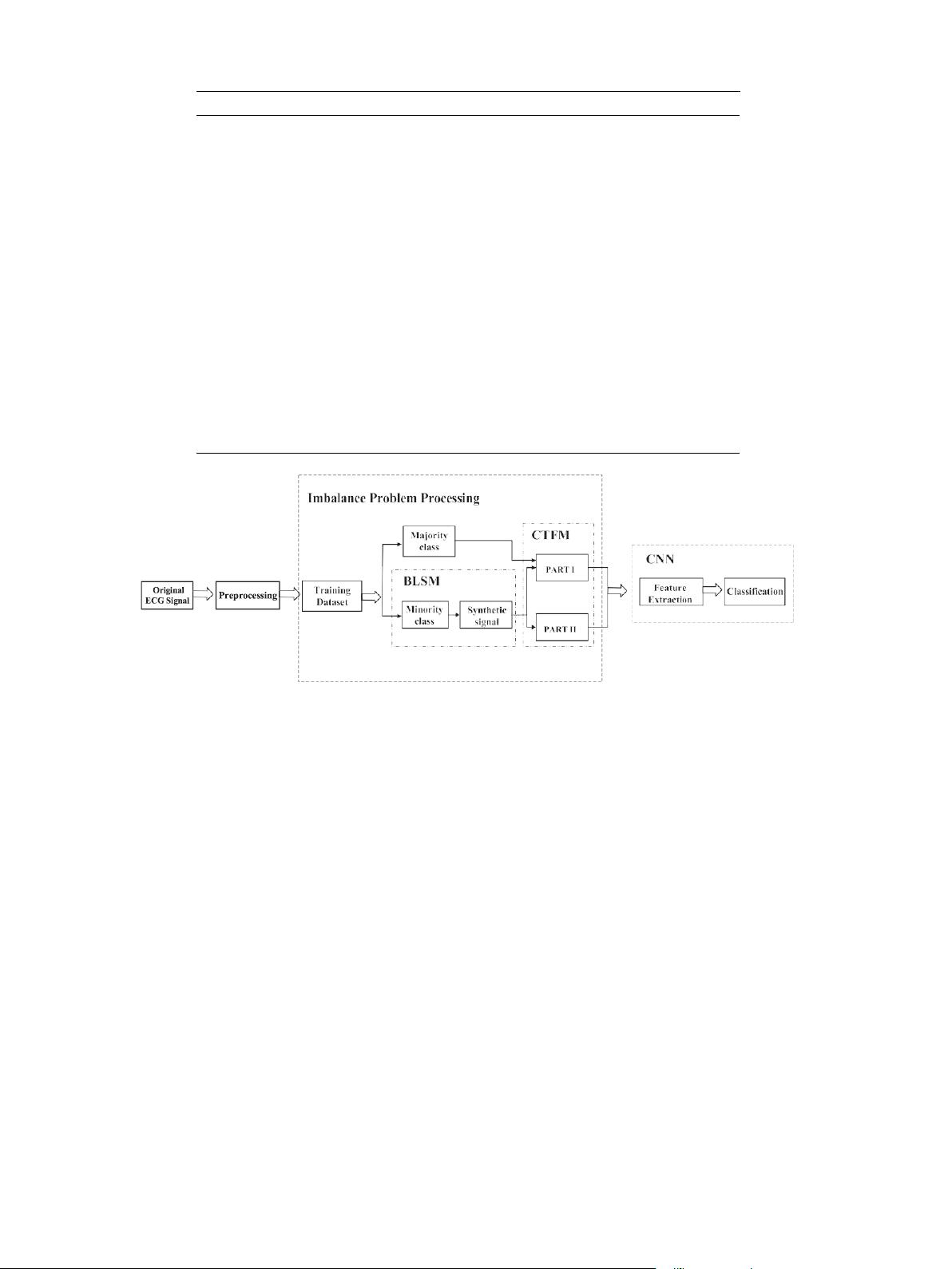

不平衡问题处理

数据不平衡是指训练集中某个类的数量相对于其他类过多

的现象。数字太多的类称为多数类,而其他类称为少数类。

大多数真实世界的数据集是不平衡的。例如,MIT-BIH心律

失常数据库中N型心跳的数量是Q型的8000多倍,是F型的

100倍在医疗诊断中,错误地将少数人(即异常样本),这

将延迟最佳 治 疗 时 间 , 远远 高 于 大 多数类别( 即 正 常 样

本)。此外,大多数机器学习算法都是在假设基础训练集是

平衡的情况下设计的。训练数据的这种高度偏斜的分布将倾

向于迫使学习算法偏向多数类。这不仅限制了 训练阶段的

收敛性,也影响模型的泛化能力和测试集的准确性。因此,

少数民族阶层的重要性不容忽视,它是解决本研究失衡问题

的关键。

解 决 阶 级 不 平衡 的 方 法 可 以 分 为 三 大 类 (

Buda

,

Maki

,

&Mazurowski

,

2017;Guo

,

Li

,

Shang

,

Gu

,

Huang

,

&Gong

,

2017

)。

数据级方法主要通过过采样或欠采样来改变训练数据的分

布。过采样的基本方法是从少数类中随机抽取样本进行简单的

重复,称为随机过采样。

然而,随机过采样容易导致过拟合。作为 因 此 ,提出了更先

进的技术,如

SMOTE

,基于过采样的过采样,

DataBoost-IM

,

类感知采样和其他调整的

SMOTE

策略(

Chawla

,

Bowyer

,

Hall

,

&Kegelmeyer

,

2002; Guo& Viktor

,

2004; Jo&

Japkowicz

,

2004;Maldonado

,

López

,

&Vairetti

,

2019; Shen

,

Lin

,

&Huang

,

2016

)。欠采样与过采样不同,欠采样从多数

中随机删除样本,直到分布达到平衡。使用欠采样时,必须注

意避免在数据选择中丢失有用信息。

算法级方法通过在训练数据分布不变的情况下调整算法来克

服类不平衡,包括保留算法、代价敏感学习、增强方法和单类

分类(

Elkan

,

2001; Lee &Cho

,

2006; Sun

,

Kamel

,

Wong

,

&Wang

,

2007; Zhou& Liu

,

2006

)。虽然成本敏感学习可以显

著提高分类性能,但它们仅适用于错误分类成本已知的情况。

不幸的是,确定某些特定领域的错误分类成本是相当具有挑战

性的,甚至是不可能的(

Wang

等人,

2016

年)。至于集成方

法,需要相当长的时间来训练多个分类器,当我们使用深度神

经网络作为基础分类器时,这是不切实际的。因此,已经提出

了诸如二阶锥编程

SVM

(

Maldonado& López

,

2014

)的新 方

法。

混合方法结合了数据层和算法层的方法,如

EasyEntrance

、

BalanceCasecade

、

SMOTEBoost

、

Two-Phase Training

等

.

(

Chawla

,

Lazarevic

,

Hall

,

Bowyer

,

2003

年

;