"该文档是关于如何在Ubuntu/CentOS操作系统中使用Eclipse开发和运行MapReduce程序的实验指导书,特别针对Hadoop2.6.0版本。实验旨在教授如何配置Eclipse环境,安装Hadoop-Eclipse Plugin,以及创建和运行MapReduce项目。文档还提到了在不同Linux发行版上的安装差异,并提供了WordCount MapReduce程序的示例代码。"

在Hadoop生态系统中,MapReduce是用于大规模数据处理的核心组件,它将大型任务分解为小的并行任务,分别在集群节点上执行,最后再将结果汇总。Eclipse是一种广泛使用的集成开发环境(IDE),通过安装特定的插件,如Hadoop-Eclipse Plugin,可以支持MapReduce程序的开发和调试。

1.1 实验目的

实验的主要目标是让学生或开发者熟悉在Eclipse中开发MapReduce程序的过程,以便于在Hadoop2.6.0环境下编写、编译和运行这些程序。这涵盖了从环境搭建到实际编程的整个流程。

1.2 实验环境

实验在Hadoop2.6.0的伪分布式模式下进行,适应于Ubuntu/CentOS系统。尽管教程主要基于CentOS6.6和Eclipse Mars (1) x86,但在Ubuntu 14.04上同样适用。实验所需软件包括:CentOS或Ubuntu,Hadoop2.6.0,以及Eclipse IDE for Java Developers。

1.3 实验步骤

1.3.1 安装Eclipse

在Ubuntu中,Eclipse可以通过软件中心安装;而在CentOS中,需手动下载Eclipse的安装包并使用tar命令解压到指定目录。

1.3.2 安装Hadoop-Eclipse Plugin

此插件允许Eclipse直接与Hadoop集群交互,方便创建和部署MapReduce项目。Hadoop2x-eclipse-plugin-master.zip文件应存放在/usr/local目录下。

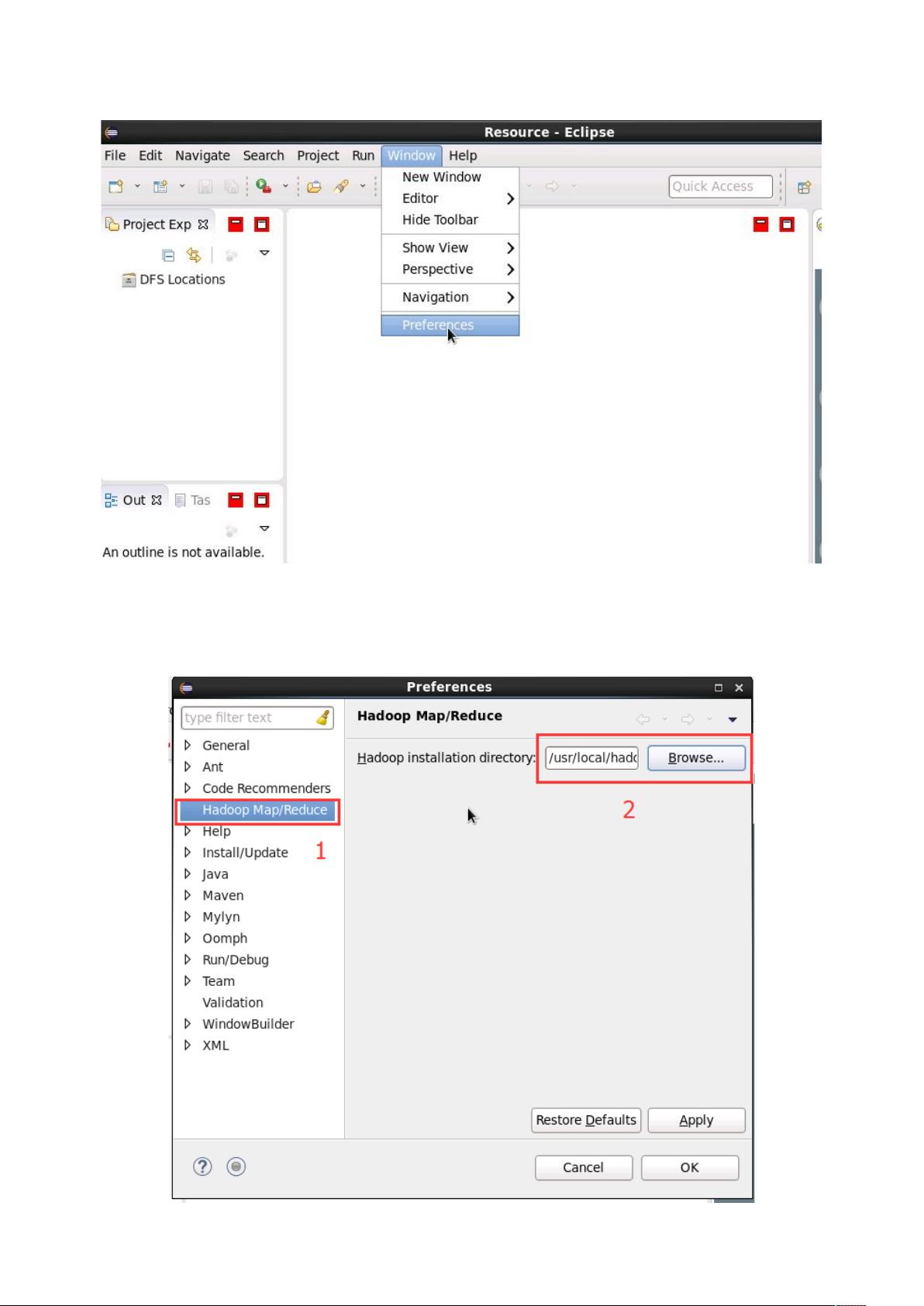

1.3.3 配置Hadoop-Eclipse Plugin

配置插件涉及设置Hadoop的安装路径和相关环境变量,使得Eclipse能够识别并连接到Hadoop集群。

1.3.4 在Eclipse中操作HDFS中的文件

通过插件,用户可以在Eclipse内部查看和管理HDFS文件,这极大地简化了开发过程。

1.3.5 在Eclipse中创建MapReduce项目

使用Eclipse创建新项目,选择Map/Reduce Project类型,然后编写MapReduce程序,如经典的WordCount示例。完成后,可以直接在Eclipse中提交任务到Hadoop集群运行。

附: 查看HDFS文件系统数据的三种方法

除了Eclipse插件外,还有Hadoop自带的命令行工具(hadoop fs -ls, hadoop fs -cat等),Web浏览器访问Hadoop的NameNode UI,以及使用Hadoop提供的Java API等方式查看HDFS数据。

通过这个实验,学习者不仅可以掌握MapReduce编程的基本技巧,还能了解如何在Eclipse中高效地进行Hadoop开发,为后续的大数据处理工作打下坚实的基础。