DIRECT NATIVE-COT EN-COT TRANSLATE-EN

NATIVE-EXEMPLARS X X X X

ENGLISH-EXEMPLARS X N/A X N/A

MULTILINGUAL-EXEMPLARS X X X N/A

Table 2: Possible combinations between few-shot exemplar selection and solution strategies.

Model output

Model output

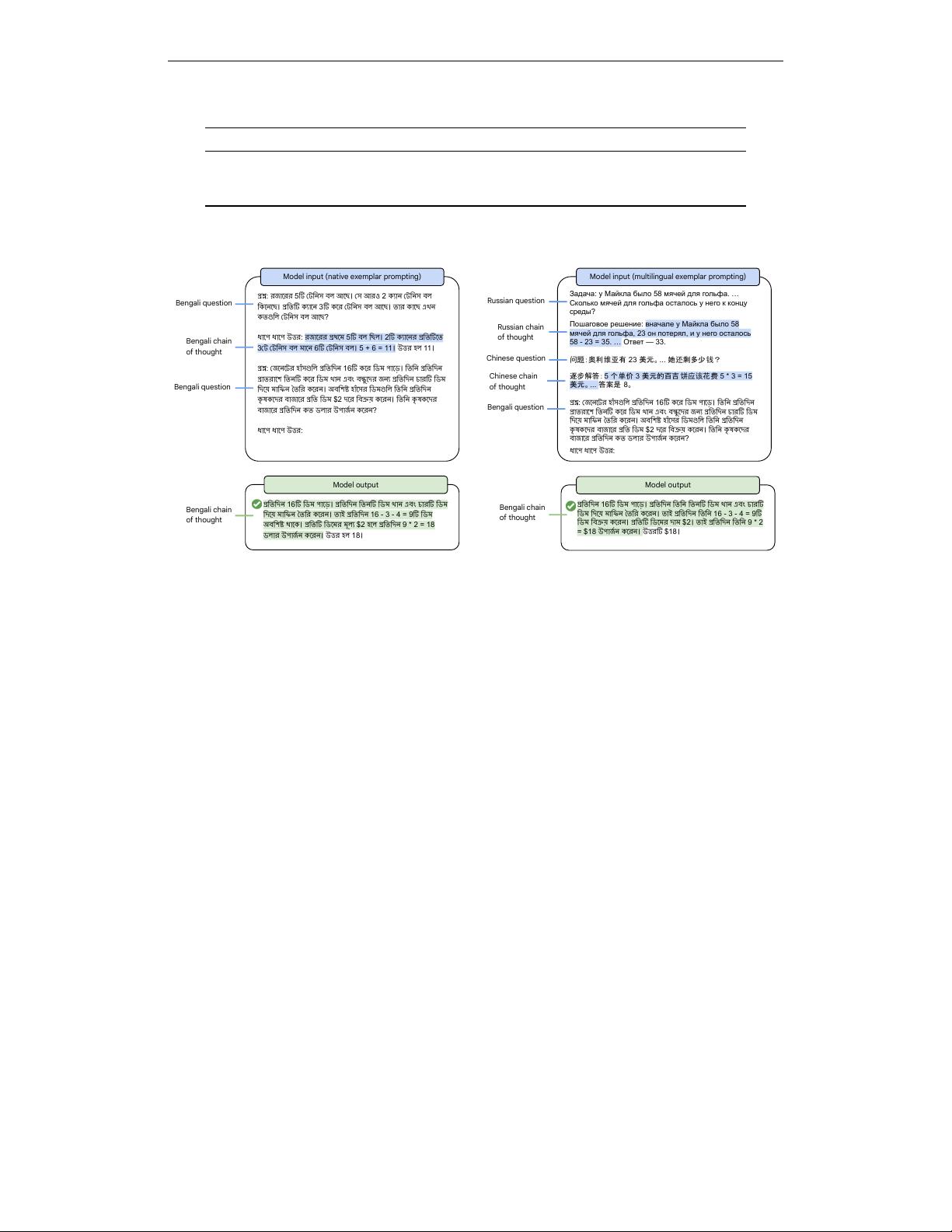

Model input (native exemplar prompting)

: রজােরর 5 টিনস বল আেছ স আরও 2 কান টিনস বল

িকেনেছ িত কােন 3 কের টিনস বল আেছ তার কােছ এখন

কতিল টিনস বল আেছ?

ধােপ ধােপ উর: রজােরর থেম 5 বল িছল 2 কােনর িতেত

3ট টিনস বল মােন 6 টিনস বল 5 + 6 = 11 উর হল 11

: জেনেটর হাঁসিল িতিদন 16 কের িডম পােড় িতিন িতিদন

াতরােশ িতন কের িডম খান এবং বুেদর জন িতিদন চার িডম

িদেয় মািফন তির কেরন অবিশ হাঁেসর িডমিল িতিন িতিদন

কৃ ষকেদর বাজাের িত িডম $2 দের িবয় কেরন িতিন কৃ ষকেদর

বাজাের িতিদন কত ডলার উপাজ ন কেরন?

ধােপ ধােপ উর:

িতিদন 16 িডম পােড় িতিদন িতন িডম খান এবং চার িডম

িদেয় মািফন তির কেরন তাই িতিদন 16 - 3 - 4 = 9 িডম

অবিশ থােক িত িডেমর মূল $2 হেল িতিদন 9 * 2 = 18

ডলার উপাজ ন কেরন উর হল 18

িতিদন 16 িডম পােড় িতিদন িতিন িতন িডম খান এবং চার

িডম িদেয় মািফন তির কেরন তাই িতিদন িতিন 16 - 3 - 4 = 9

িডম িবয় কেরন িত িডেমর দাম $2 তাই িতিদন িতিন 9 * 2

= $18 উপাজ ন কেরন উর $18

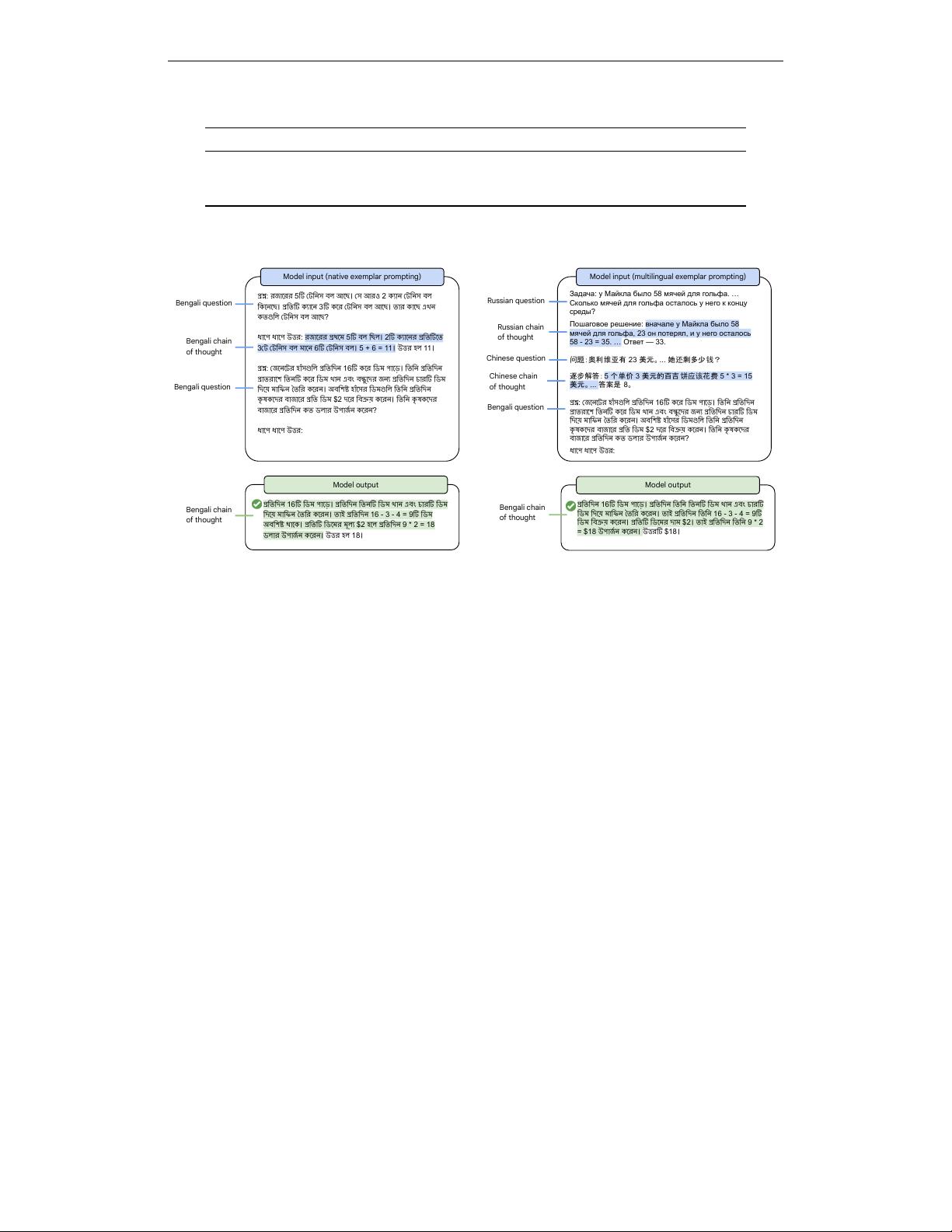

Задача: у Майкла было 58 мячей для гольфа. …

Сколько мячей для гольфа осталось у него к концу

среды?

Пошаговое решение: вначале у Майкла было 58

мячей для гольфа, 23 он потерял, и у него осталось

58 - 23 = 35. … Ответ — 33.

问题:奥利维亚有 23 美元。 ... 她还剩多少 钱?

逐步解答: 5 个单价 3 美元的百吉 饼应该花费 5 * 3 = 15

美元。... 答案是 8。

: জেনেটর হাঁসিল িতিদন 16 কের িডম পােড় িতিন িতিদন

াতরােশ িতন কের িডম খান এবং বুেদর জন িতিদন চার িডম

িদেয় মািফন তির কেরন অবিশ হাঁেসর িডমিল িতিন িতিদন

কৃ ষকেদর বাজাের িত িডম $2 দের িবয় কেরন িতিন কৃ ষকেদর

বাজাের িতিদন কত ডলার উপাজ ন কেরন?

ধােপ ধােপ উর:

Model input (multilingual exemplar prompting)

Bengali question

Russian question

Bengali question

Bengali chain

of thought

Bengali chain

of thought

Russian chain

of thought

Chinese question

Chinese chain

of thought

Bengali question

Bengali chain

of thought

Figure 3: The chain-of-thought prompts and example model outputs in the MGSM experiments. The

solutions are written in the same language as the questions of interest (NATIVE-COT).

Beyond the prompting methods, there are different ways to provide few-shot examples in context for

multilingual prompting:

• All native question exemplars (NATIVE-EXEMPLARS).

We use a few in-language questions

together with their solutions as the few-shot prompt exemplars. This is the most natural setting

when we have a few examples in each investigated language.

• All English question exemplars (ENGLISH-EXEMPLARS).

When we are unable to access any

existing questions or solution examples in some languages, an intuitive way is to use English

questions and solutions as exemplars to perform zero-shot cross-lingual transfer. Note that it is

unrealistic to combine this exemplar selection setting with NATIVE-COT, since we assume no

access to the native language for prompting.

• Generic multilingual question exemplars (MULTILINGUAL-EXEMPLARS).

Similar to

ENGLISH-EXEMPLARS, we assume access to questions and solutions in a few languages, and test

if multilingual exemplars better elicit the multilingual reasoning ability of models.

For TRANSLATE-EN, as all exemplar questions and solutions are in English, we only experiment

with the translated native question exemplars and English CoT. We summarize the combinations

of prompting and exemplar methods in Table 2, and present an illustration in Figure 3. Detailed

prompting input for each investigated combination can be found in Appendix A.2.

4 EXPERIMENTS ON MGSM

In this section, we evaluate the multilingual reasoning abilities of two representative state-of-the-art

pretrained large language models—GPT-3 (Brown et al., 2020) and PaLM (Chowdhery et al., 2022)

—on our MGSM benchmark in various prompting settings using exemplars in the source language

4

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

信息提交成功

信息提交成功