Python并发与分布式系统设计:架构优化与实战技巧

发布时间: 2024-09-01 02:56:46 阅读量: 307 订阅数: 78

# 1. 并发编程基础与Python多线程

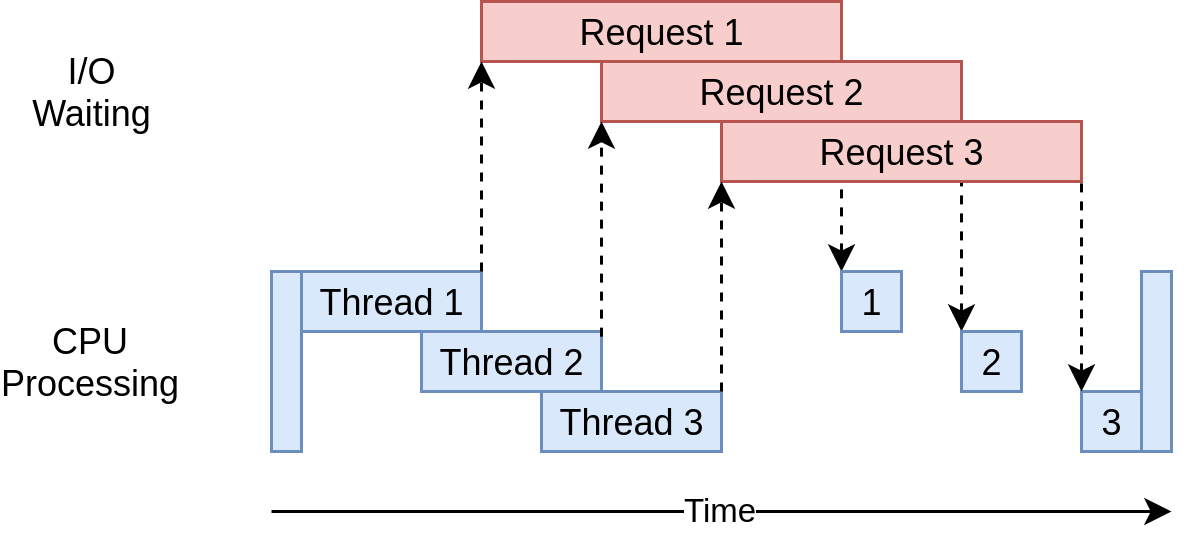

并发编程是计算机科学中的一个核心概念,它允许同时或几乎同时执行多个任务,以提高应用程序的响应性和吞吐量。在Python中,由于全局解释器锁(GIL)的存在,多线程并不是执行多任务的最佳选择,但它们在执行I/O密集型任务时依然非常有用。

## 线程与进程的区别

在讨论Python的多线程之前,先区分线程(Thread)和进程(Process)这两个概念是很重要的。进程是操作系统分配资源的基本单位,拥有自己的内存空间,而线程则是进程中的执行路径,共享进程的资源。

## Python中的多线程基础

Python的标准库提供了`threading`模块,用于创建和管理线程。多线程在Python中的实现非常简单直观。下面是一个简单的多线程示例:

```python

import threading

import time

def thread_function(name):

print(f'Thread {name}: starting')

time.sleep(2)

print(f'Thread {name}: finishing')

if __name__ == "__main__":

threads = list()

for index in range(3):

x = threading.Thread(target=thread_function, args=(index,))

threads.append(x)

x.start()

for index, thread in enumerate(threads):

thread.join()

print("Done!")

```

在这个例子中,我们定义了一个函数`thread_function`,它将被多个线程调用。每个线程启动后会休眠两秒然后结束。`threading.Thread`类被用来创建线程对象,通过调用`start()`方法来启动线程,并使用`join()`方法等待所有线程完成。

## Python多线程的局限性

尽管Python的多线程编程相对简单,但受到GIL的限制,在执行CPU密集型任务时可能不会看到预期的性能提升。这是因为GIL防止了多个线程同时执行Python字节码。然而,对于I/O密集型任务,如网络请求和文件操作,多线程可以显著提升程序的效率,因为I/O操作通常涉及等待,而这段时间内其他线程可以继续执行。

在下一章中,我们将深入了解多进程编程以及如何应对Python中的GIL限制。

# 2. 多进程编程与GIL的应对策略

## 多进程编程的优势与局限

在Python中,由于全局解释器锁(GIL)的存在,多线程编程在CPU密集型任务上往往不能充分利用多核CPU的优势。因此,在这些情况下,多进程编程提供了一种替代方案。Python的`multiprocessing`模块允许我们创建多个进程,每个进程都有自己的Python解释器和内存空间,从而绕过GIL的限制。

### 多进程编程的优势

1. **并行性**:多进程允许真正的并行处理,特别是在多核处理器上,可以同时运行多个进程,提高程序的执行效率。

2. **内存隔离**:每个进程都有自己的地址空间,互不干扰,这在进行复杂数据处理时提供了安全保障。

3. **资源利用**:对于IO密集型任务,多进程同样有效,因为它可以同时处理多个网络请求或磁盘操作。

### 多进程编程的局限

1. **资源消耗**:进程的创建和销毁比线程更加耗费系统资源,因为每个进程都需要分配独立的内存空间。

2. **通信成本**:进程间通信(IPC)比线程间通信复杂,尤其是在传递大量数据时。

3. **开发难度**:由于进程间的独立性,进行数据共享和同步变得更加困难。

### 使用 `multiprocessing` 模块

Python的`multiprocessing`模块提供了丰富的接口,方便我们创建和管理进程。下面是一个简单的多进程示例:

```python

import multiprocessing

def worker(number):

"""线程工作函数"""

print(f'Worker: {number}')

if __name__ == '__main__':

processes = []

for i in range(5):

p = multiprocessing.Process(target=worker, args=(i,))

processes.append(p)

p.start()

for p in processes:

p.join()

```

在这个例子中,我们创建了5个进程,每个进程都执行了`worker`函数。`if __name__ == '__main__':`这一行非常重要,它确保了在Windows操作系统上,不会尝试导入主模块导致的无限递归问题。

### 进程间通信(IPC)

进程间通信是多进程编程中一个不可忽视的部分。`multiprocessing`模块提供了多种IPC机制:

- `multiprocessing.Queue`:一个先进先出的数据结构,多个进程可以通过队列进行通信。

- `multiprocessing.Pipe`:提供一个管道来进行双向通信。

- `multiprocessing.Value`和`multiprocessing.Array`:允许在多个进程间共享数据。

### 示例:使用 `multiprocessing.Queue` 进行进程间通信

```python

import multiprocessing

def producer(queue, n):

"""生产者函数"""

for i in range(n):

queue.put(i)

print(f'Put {i} to the queue')

def consumer(queue):

"""消费者函数"""

while True:

item = queue.get()

if item is None:

break

print(f'Got item: {item}')

if __name__ == '__main__':

q = multiprocessing.Queue()

prod = multiprocessing.Process(target=producer, args=(q, 10))

cons = multiprocessing.Process(target=consumer, args=(q,))

prod.start()

cons.start()

prod.join()

q.put(None)

cons.join()

```

在这个例子中,我们定义了一个生产者和一个消费者。生产者将数据放入队列,而消费者从队列中取出数据。注意我们是如何使用`multiprocessing.Queue`来进行进程间通信的。

## GIL的应对策略

### 使用 `multiprocessing` 模块绕过GIL

在CPU密集型任务中,可以使用`multiprocessing`模块来绕过GIL的限制。因为每个进程都有自己的Python解释器和GIL,所以它们可以独立地运行,实现真正的并行。

### 使用线程和锁的谨慎方式

在某些情况下,我们可能仍需要使用线程,特别是当任务主要是IO密集型时。我们可以使用锁(例如`threading.Lock`)来同步线程,减少GIL带来的负面影响。

### 使用其他解释器

对于需要高度并发的场景,可以考虑使用Jython或者IronPython。这些解释器没有GIL的限制,或者使用了不同的并发机制。

### 使用协程

协程是一种轻量级的线程,它不使用操作系统的线程,因此不存在GIL的问题。Python 3.5及以上版本中引入的`asyncio`库提供了对异步编程的支持。

### 示例:使用线程和锁来规避GIL

```python

import threading

lock = threading.Lock()

def counter():

with lock:

count = 0

while count < 1000000:

count += 1

print(count)

threads = []

for i in range(10):

t = threading.Thread(target=counter)

t.start()

threads.append(t)

for t in threads:

t.join()

```

在这个例子中,我们使用线程和锁来确保即使在GIL存在的条件下,计数操作也是线程安全的。

## 总结

多进程编程提供了一种绕过GIL限制的方法,允许Python程序利用多核处理器的并行处理能力。通过使用`multiprocessing`模块,我们可以创建多个独立的进程,从而提升程序的执行效率。但是,进程间通信和数据共享的复杂性使得多进程编程比多线程编程难度更大。合理利用线程和锁、考虑其他解释器、或者转向异步编程模型,都是应对GIL的可行策略。每种方法都有其适用场景,选择合适的方法取决于具体的应用需求和性能考量。

# 3. 异步编程模型与asyncio框架深入解析

## 异步编程的发展与必要性

在面对需要高并发、高性能、低延迟的场景时,传统的同步编程模型常常显得力不从心。传统的线程模型依赖于操作系统的线程调度,当有成千上万个网络I/O操作时,每个操作都使用一个线程是不现实的。因此,异步编程应运而生,它允许程序在等待一个I/O操作完成时继续执行其他任务,而不是阻塞等待。这大大提高了程序的执行效率和系统的吞吐量。

异步编程模型在实现上通常依赖于事件循环(event loop)机制,这种方式特别适合于处理I/O密集型任务。事件循环维护了一个任务队列,程序可以在一个或多个线程中运行这些任务,每个任务在执行过程中遇到I/O操作时,就将控制权返回给事件循环,事件循环则继续处理其他任务。

Python 3.4引入的`asyncio`库提供了支持单线程并发编程的基础设施。它是构建单线程异步IO程序的库和运行时,旨在简化编写可扩展网络应用和并发代码库的工作。

### 代码块分析:Python异步编程的基石

```python

import asyncio

async def main():

await asyncio.sleep(2)

print('hello world')

# Python 3.7+ 的语法

asyncio.run(main())

```

在上面的代码块中,我们使用了`asyncio.run()`来运行一个异步的`main()`函数。函数中使用了`await asyncio.sleep(2)`,这是异步编程的核心特性。`await`关键字用于等待一个异步操作的完成,`asyncio.sleep(2)`是异步版本的`time.sleep(2)`,它不会阻塞线程而是让出事件循环的控制权,等待两秒后继续执行。

## asyncio框架的工作原理

`asyncio`框架的核心是事件循环,负责管理工作任务的执行。当遇到异步操作时,事件循环会挂起当前任务,转而处理其他任务,直到异步操作完成并准备好继续执行时,事件循环再回来继续该任务。

### 代码块分析:事件循环的工作方式

```python

import asyncio

async def say_after(delay, what):

await asyncio.sleep(delay)

print(what)

async def main():

print(f"started at {time.str

```

0

0