神经网络回归:非线性回归的深度学习方案

发布时间: 2024-07-13 22:45:24 阅读量: 98 订阅数: 40

精通数据科学:从线性回归到深度学习

# 1. 神经网络回归概述**

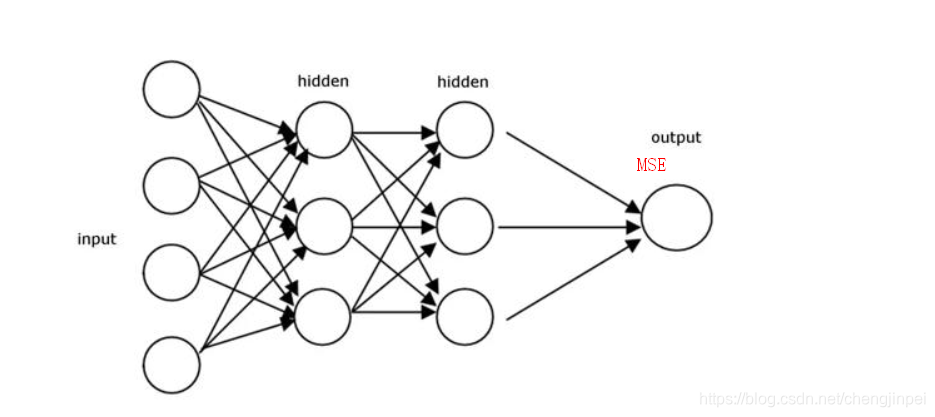

神经网络回归是一种机器学习技术,它利用神经网络来预测连续值的目标变量。与传统线性回归模型不同,神经网络回归可以捕捉非线性关系和复杂模式,从而提高预测精度。

神经网络回归模型通常由多个隐藏层组成,每个隐藏层包含多个神经元。神经元通过加权连接相互连接,并使用激活函数来引入非线性。通过训练神经网络,可以调整权重和偏置,以最小化预测误差。

神经网络回归在各种应用中表现出卓越的性能,包括时间序列预测、图像识别和自然语言处理。它为解决复杂回归问题提供了强大的工具,并不断推动机器学习领域的进步。

# 2. 神经网络回归模型

### 2.1 人工神经网络基础

#### 2.1.1 神经元的结构和功能

神经元是神经网络的基本组成单元,其结构类似于生物神经元。它接收输入信号,经过内部处理后产生输出信号。神经元的结构主要包括:

- **输入端:**接收来自其他神经元或外部数据的信号。

- **权重:**与输入信号相乘,调整信号的重要性。

- **偏置:**一个常数,添加到加权和中,以调整神经元的激活阈值。

- **激活函数:**非线性函数,将加权和转换为输出信号。

#### 2.1.2 神经网络的架构和类型

神经网络由多个神经元相互连接而成,形成不同的架构。常见的神经网络类型包括:

- **前馈神经网络:**信号单向从输入层流向输出层,没有反馈回路。

- **反馈神经网络:**信号可以在网络中循环流动,具有记忆和学习能力。

- **卷积神经网络(CNN):**专门用于处理图像数据,利用卷积操作提取特征。

- **循环神经网络(RNN):**处理时序数据,能够记忆过去的信息。

### 2.2 回归神经网络

#### 2.2.1 线性回归与非线性回归

回归分析是一种预测连续变量(因变量)与一个或多个自变量(自变量)之间关系的方法。线性回归假设因变量与自变量之间存在线性关系,而非线性回归则允许更复杂的非线性关系。

#### 2.2.2 神经网络回归模型的构建

神经网络回归模型是基于神经网络构建的回归模型,它可以学习复杂的数据关系,实现非线性回归。其构建步骤如下:

1. **定义网络结构:**确定输入层、隐藏层和输出层的神经元数量和连接方式。

2. **初始化权重和偏置:**随机初始化神经网络中的权重和偏置。

3. **前向传播:**将输入数据通过神经网络,计算输出预测。

4. **计算损失:**比较输出预测与真实值之间的误差,计算损失函数的值。

5. **反向传播:**根据损失函数计算梯度,调整权重和偏置以最小化损失。

6. **重复训练:**重复前向传播和反向传播过程,直到损失函数达到最小值或达到预定的训练次数。

**代码示例:**

```python

import numpy as np

import tensorflow as tf

# 定义神经网络结构

model = tf.keras.models.Sequential([

tf.keras.layers.Dense(10, activation='relu', input_shape=(784,)),

tf.keras.layers.Dense(10, activation='relu'),

tf.keras.layers.Dense(1)

])

# 编译模型

model.compile(optimizer='adam', loss='

```

0

0