Word2Vec词嵌入在文本分类器中的应用:构建高效文本分类器,提升分类准确率

发布时间: 2024-08-20 13:56:49 阅读量: 15 订阅数: 13

# 1. 文本分类简介**

文本分类是自然语言处理(NLP)中一项基本任务,旨在将文本文档分配到预定义的类别中。文本分类在许多实际应用中至关重要,例如垃圾邮件过滤、情感分析和主题建模。

文本分类器通常使用机器学习算法,这些算法从带标签的文本数据中学习模式。带标签的文本数据是指已知类别的文本文档。机器学习算法分析带标签的文本数据,识别文本和类别之间的关系,并根据这些关系建立分类模型。

文本分类器的性能取决于多种因素,包括文本表示方法、分类算法和模型训练数据。在接下来的章节中,我们将探讨文本分类的不同方面,包括Word2Vec词嵌入技术在文本分类中的应用。

# 2. Word2Vec词嵌入技术

### 2.1 Word2Vec模型的原理和实现

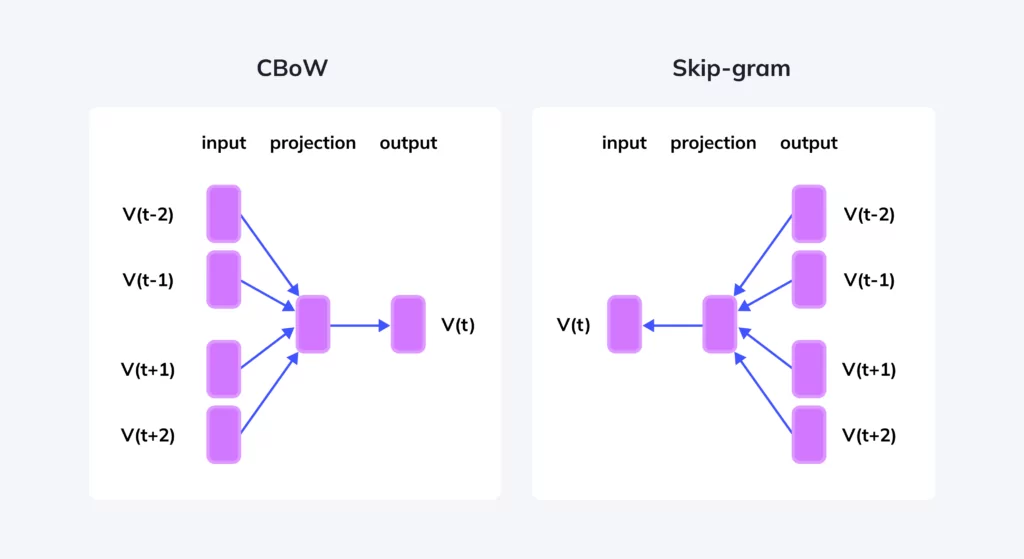

Word2Vec是一种神经网络模型,它可以将单词映射到一个连续的向量空间中,从而捕获单词之间的语义和语法关系。Word2Vec有两种主要的模型:CBOW(连续词袋)和Skip-gram。

#### 2.1.1 CBOW模型

CBOW模型预测给定上下文单词集合下的中心单词。具体来说,给定一个单词序列`w1, w2, ..., wn`,CBOW模型的目标是预测中心单词`wi`,其中`i`介于1和n之间。CBOW模型的架构如下:

```mermaid

graph LR

subgraph CBOW

A[Input Layer] --> B[Hidden Layer] --> C[Output Layer]

end

```

**代码块:**

```python

import gensim

# 训练CBOW模型

model = gensim.models.Word2Vec(sentences, min_count=1, window=5, sg=0)

```

**逻辑分析:**

* `sentences`是输入的单词序列。

* `min_count`是单词出现的最小次数阈值。

* `window`是上下文窗口的大小。

* `sg=0`表示使用CBOW模型。

#### 2.1.2 Skip-gram模型

Skip-gram模型预测给定中心单词的上下文单词。与CBOW模型不同,Skip-gram模型预测中心单词`wi`周围的上下文单词`wj`,其中`j`介于1和n之间且`j != i`。Skip-gram模型的架构如下:

```mermaid

graph LR

subgraph Skip-gram

A[Input Layer] --> B[Hidden Layer] --> C[Output Layer]

end

```

**代码块:**

```python

import gensim

# 训练Skip-gram模型

model = gensim.models.Word2Vec(sentences, min_count=1, window=5, sg=1)

```

**逻辑分析:**

* `sentences`是输入的单词序列。

* `min_count`是单词出现的最小次数阈值。

* `window`是上下文窗口的大小。

* `sg=1`表示使用Skip-gram模型。

### 2.2 Word2Vec词嵌入的优势和应用场景

Word2Vec词嵌入具有以下优势:

* **语义相似性:**Word2Vec词嵌入可以捕获单词之间的语义相似性。

* **维度低:**Word2Vec词嵌入通常是低维的,这使得它们易

0

0