【Word2Vec词嵌入揭秘】:从零基础到精通,解锁文本数据的宝藏

发布时间: 2024-08-20 13:07:46 阅读量: 9 订阅数: 12

# 1. Word2Vec词嵌入概述

Word2Vec是一种神经网络语言模型,用于学习单词的词嵌入。词嵌入是单词的向量表示,它捕获了单词的语义和语法信息。Word2Vec算法通过预测单词周围的上下文单词来学习词嵌入。

Word2Vec词嵌入在自然语言处理(NLP)任务中得到了广泛的应用,包括文本分类、文本聚类和文本生成。词嵌入能够有效地表示单词的含义,并为NLP模型提供有用的特征。

# 2. Word2Vec词嵌入算法**

**2.1 Skip-gram模型**

**2.1.1 模型原理**

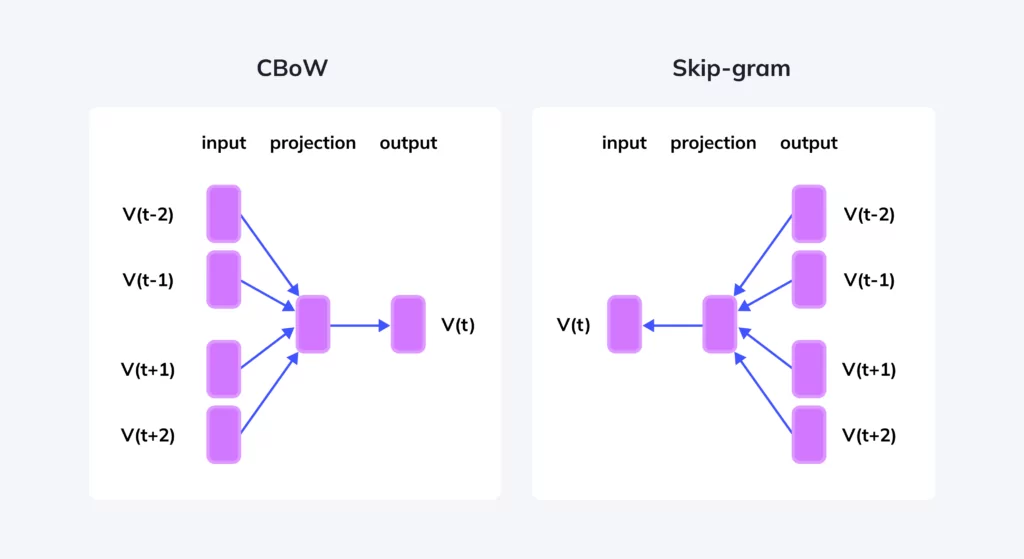

Skip-gram模型是一种神经网络模型,它旨在通过预测一个单词的上下文单词来学习单词的分布式表示。模型的输入是一个单词,输出是一个由上下文单词组成的集合。

模型的结构如下图所示:

```mermaid

graph LR

subgraph Skip-gram模型

A[输入单词] --> B[隐层] --> C[输出上下文单词]

end

```

模型的训练目标是最大化输入单词和上下文单词之间的共现概率。

**2.1.2 模型训练过程**

Skip-gram模型的训练过程如下:

1. **初始化:**随机初始化输入层和输出层的权重矩阵。

2. **正向传播:**将输入单词表示为一个one-hot向量,并将其输入到输入层。然后,通过隐层,计算输出层中每个上下文单词的概率分布。

3. **反向传播:**计算模型的损失函数,即输入单词和上下文单词之间的负对数似然。然后,使用反向传播算法更新权重矩阵。

4. **重复:**重复步骤2和3,直到损失函数收敛。

**2.2 CBOW模型**

**2.2.1 模型原理**

CBOW模型是Skip-gram模型的反向模型,它旨在通过预测一个单词来学习上下文单词的分布式表示。模型的输入是一个上下文单词集合,输出是一个单词。

模型的结构如下图所示:

```mermaid

graph LR

subgraph CBOW模型

A[输入上下文单词] --> B[隐层] --> C[输出单词]

end

```

模型的训练目标是最大化上下文单词和输入单词之间的共现概率。

**2.2.2 模型训练过程**

CBOW模型的训练过程如下:

1. **初始化:**随机初始化输入层和输出层的权重矩阵。

2. **正向传播:**将上下文单词表示为one-hot向量,并将其输入到输入层。然后,通过隐层,计算输出层中每个单词的概率分布。

3. **反向传播:**计算模型的损失函数,即上下文单词和输入单词之间的负对数似然。然后,使用反向传播算法更新权重矩阵。

4. **重复:**重复步骤2和3,直到损失函数收敛。

**2.3 负采样和层次softmax**

负采样和层次softmax是两种用于加速Word2Vec模型训练的技术。

**负采样**

负采样是一种通过对负样本进行采样来减少模型训练时间的方法。在负采样中,对于每个正样本(输入单词和上下文单词),我们随机采样几个负样本(输入单词和非上下文单词)。然后,我们只更新与正样本和负样本相关的权重。

**层次softmax**

层次softmax是一种通过构建一个层次树来加速模型训练的方法。在层次softmax中,我们为每个单词分配一个路径,该路径从根节点到叶节点。然后,我们通过遍历路径来计算单词的概率分布。这种方法可以大大减少计算复杂度。

# 3. Word2Vec词嵌入实践

### 3.1 Word2Vec词嵌入的生成

#### 3.1.1 数据预处理

在生成Word2Vec词嵌入之前,需要对文本数据进行预处理,以提高模型的训练效率和效果。数据预处理通常包括以下步骤:

- **分词:**将文本分割成一个个词语,常用的分词工具有jieba、NLTK等。

- **去停用词:**去除一些常见的无意义词语,如“的”、“是”、“了”等。

- **词频统计:**统计每个词语在文本中的出现频率,生成词频表。

#### 3.1.2 模型训练

Word2Vec模型的训练过程是一个迭代的过程,通常采用以下步骤:

1. **初始化:**随机初始化词嵌入矩阵,每个词语对应一个向量。

2. **正向传播:**对于每个训练样本(一个句子或一段文本),根据Skip-gram或CBOW模型计算目标函数。

3. **反向传播:**计算词嵌入矩阵的梯度,并更新词嵌入向量。

4. **重复步骤2和3:**直到达到预定的训练轮数或目标函数收敛。

**代码示例:**

```python

import gensim

# 导入分词后的文本数据

sentences = gensim.models.word2vec.LineSentence('text.txt')

# 训练Word2Vec模型

model = gensim.models.Word2Vec(sentences, min_count=1, size=100, window=5)

```

**参数说明:**

- `min_count`:设置词语的最小出现频率,低于该频率的词语将被忽略。

- `size`:设置词嵌入向量的维度。

- `window`:设置上下文窗口的大小,即每个词语考虑的上下文词语数量。

### 3.2 Word2Vec词嵌入的评估

#### 3.2.1 词相似度计算

词相似度计算是评估Word2Vec词嵌入质量的重要指标。常用的词相似度计算方法有余弦相似度、欧氏距离等。

**代码示例:**

```python

# 计算两个词语的余弦相似度

similarity = model.similarity('apple', 'banana')

```

#### 3.2.2 聚类分析

聚类分析可以将相似的词语聚类在一起,从而验证Word2Vec词嵌入的有效性。常用的聚类算法有K-Means、层次聚类等。

**代码示例:**

```python

# 使用K-Means算法对词语进行聚类

clusters = model.wv.most_similar_cosmul(positive=['apple', 'banana', 'orange'], topn=10)

```

**参数说明:**

- `positive`:指定要聚类的词语列表。

- `topn`:设置聚类结果中每个簇包含的词语数量。

# 4. Word2Vec词嵌入在NLP中的应用

### 4.1 文本分类

#### 4.1.1 基于词嵌入的特征提取

在文本分类任务中,传统的方法通常采用词袋模型或TF-IDF模型来提取文本特征。然而,这些模型忽略了词语之间的语义关系。Word2Vec词嵌入可以有效地解决这一问题,它将每个词语映射到一个低维稠密的向量空间中,向量中的每个维度代表词语的语义信息。

通过使用Word2Vec词嵌入,我们可以将文本转换为一个词嵌入矩阵,其中每一行表示一个词语的词嵌入向量。然后,我们可以使用机器学习算法,如支持向量机(SVM)或逻辑回归,对词嵌入矩阵进行分类。

#### 4.1.2 分类模型的训练和评估

基于词嵌入的文本分类模型的训练过程与传统文本分类模型类似。首先,我们需要将训练数据转换为词嵌入矩阵。然后,我们可以使用机器学习算法对词嵌入矩阵进行训练。

在训练过程中,我们可以使用交叉验证来调整模型超参数,如正则化参数和内核函数。训练完成后,我们可以使用测试数据对模型进行评估。

### 4.2 文本聚类

#### 4.2.1 基于词嵌入的文本表示

在文本聚类任务中,我们需要将文本文档聚类到不同的组中。传统的方法通常采用基于关键词或主题模型的聚类算法。然而,这些算法忽略了词语之间的语义关系。

Word2Vec词嵌入可以有效地解决这一问题,它将每个文本文档表示为一个词嵌入向量。词嵌入向量包含了文本文档中所有词语的语义信息。

通过使用Word2Vec词嵌入,我们可以将文本文档转换为一个词嵌入矩阵,其中每一行表示一个文本文档的词嵌入向量。然后,我们可以使用聚类算法,如k均值聚类或层次聚类,对词嵌入矩阵进行聚类。

#### 4.2.2 聚类算法的选择和应用

在文本聚类任务中,我们可以使用各种聚类算法。最常用的聚类算法包括k均值聚类和层次聚类。

k均值聚类是一种基于划分的聚类算法,它将数据点划分为k个簇。层次聚类是一种基于层次的聚类算法,它将数据点逐步聚类成一个层次结构。

在选择聚类算法时,我们需要考虑聚类任务的具体要求。例如,如果我们知道文本文档的类别数,我们可以使用k均值聚类。如果我们不知道文本文档的类别数,我们可以使用层次聚类。

### 4.3 文本生成

#### 4.3.1 基于词嵌入的语言模型

在文本生成任务中,我们需要生成新的文本,使其与给定的文本语义一致。传统的方法通常采用基于规则的语言模型或统计语言模型。然而,这些模型难以生成连贯且语义丰富的文本。

Word2Vec词嵌入可以有效地解决这一问题,它提供了一个词语之间的语义关系的分布式表示。通过使用Word2Vec词嵌入,我们可以构建一个基于词嵌入的语言模型。

基于词嵌入的语言模型可以预测下一个词语的概率分布,给定前面一个或多个词语。通过使用这个概率分布,我们可以生成新的文本。

#### 4.3.2 文本生成算法

在文本生成任务中,我们可以使用各种文本生成算法。最常用的文本生成算法包括贪婪算法和束搜索算法。

贪婪算法是一种简单的文本生成算法,它每次选择概率最大的词语作为下一个词语。束搜索算法是一种更复杂的文本生成算法,它考虑了多个候选词语的组合。

在选择文本生成算法时,我们需要考虑文本生成任务的具体要求。例如,如果我们希望生成连贯且语义丰富的文本,我们可以使用束搜索算法。

# 5. Word2Vec词嵌入的拓展与优化**

**5.1 词嵌入的拓展**

**5.1.1 上下文窗口的优化**

默认情况下,Word2Vec使用固定大小的上下文窗口来提取词语的上下文信息。然而,在实际应用中,不同词语的上下文长度可能存在差异。因此,可以考虑使用可变大小的上下文窗口,根据词语的长度和句法结构动态调整窗口大小。

**5.1.2 负采样的改进**

负采样是Word2Vec训练过程中的一种负采样方法,用于提高模型训练效率。传统的负采样方法随机采样负样本,但这种方法可能会导致一些高频词被过度采样。为了解决这个问题,可以采用改进的负采样方法,例如加权负采样或分层负采样,以降低高频词被采样的概率。

**5.2 词嵌入的优化**

**5.2.1 超参数的调优**

Word2Vec模型的性能受多种超参数的影响,包括学习率、窗口大小、负采样率等。通过对这些超参数进行调优,可以找到最优的模型参数,从而提高词嵌入的质量。

**5.2.2 训练数据的增强**

训练数据质量对Word2Vec词嵌入的性能至关重要。除了使用高质量的语料库外,还可以通过数据增强技术来提高训练数据的质量。例如,可以对训练数据进行随机采样、添加噪声或进行同义词替换,以增加数据的多样性和鲁棒性。

**代码示例:**

```python

# 导入Word2Vec模块

from gensim.models import Word2Vec

# 创建Word2Vec模型,并指定可变大小的上下文窗口

model = Word2Vec(sentences, window=5, min_count=1, sg=1, workers=4)

# 训练Word2Vec模型

model.train(sentences, total_examples=model.corpus_count, epochs=10)

# 使用加权负采样进行负采样

model.negative = 5

model.sample = 0.001

```

0

0