Word2Vec词嵌入在文本相似度度量中的应用:文本相似度计算的新方法,提升文本匹配效率

发布时间: 2024-08-20 13:59:23 阅读量: 82 订阅数: 24

# 1. 文本相似度度量概述**

**1.1 文本相似度的概念和重要性**

文本相似度度量是指量化两个文本之间相似程度的过程。它在自然语言处理(NLP)中至关重要,用于文本分类、文本匹配、信息检索等任务。

**1.2 文本相似度计算方法的分类**

文本相似度计算方法可分为基于字符串的方法、基于语义的方法和基于学习的方法。基于字符串的方法直接比较文本的字符或单词序列,而基于语义的方法考虑文本的含义。基于学习的方法利用机器学习算法从数据中学习文本相似度的表示。

# 2. Word2Vec词嵌入理论**

## Word2Vec模型简介

Word2Vec是一种词嵌入模型,它将单词映射到向量空间中,每个单词向量都包含该单词的语义信息。Word2Vec模型的目的是学习单词之间的关系,并将其编码到向量表示中。

### Word2Vec模型的类型

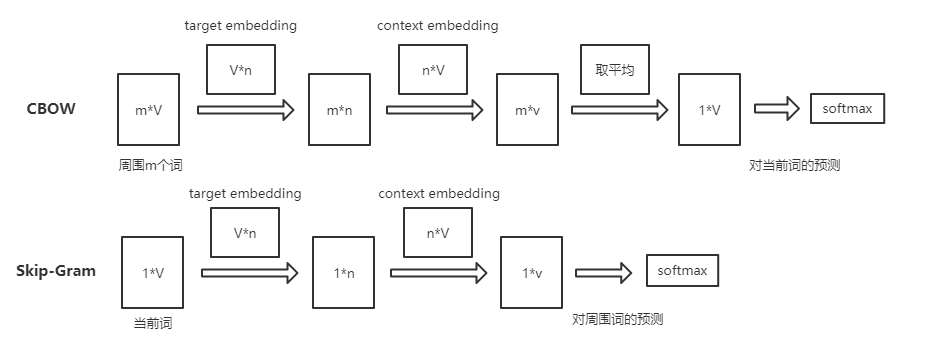

Word2Vec有两种主要的模型类型:

* **CBOW(连续词袋):**给定一个单词,预测其上下文中的单词。

* **Skip-gram:**给定一个单词,预测其上下文之外的单词。

## Word2Vec模型的训练方法

Word2Vec模型的训练过程涉及以下步骤:

1. **预处理:**将文本数据转换为单词序列,并进行分词和去停用词处理。

2. **构建词表:**创建包含所有单词的词表,并为每个单词分配一个唯一的索引。

3. **训练模型:**使用CBOW或Skip-gram模型训练Word2Vec模型,以学习单词向量。

4. **保存模型:**将训练好的模型保存为文件,以便以后使用。

### Word2Vec模型的训练参数

Word2Vec模型的训练参数包括:

* **窗口大小:**上下文单词的数量。

* **负采样:**用于训练负样本的单词数量。

* **学习率:**模型更新的步长。

* **迭代次数:**训练模型的迭代次数。

## Word2Vec词嵌入的特性

Word2Vec词嵌入具有以下特性:

* **语义相似性:**语义相似的单词具有相似的向量表示。

* **线性关系:**单词之间的向量表示可以用于表示单词之间的关系。

* **维度可调:**词嵌入向量的维度可以根据需要进行调整。

* **高效计算:**Word2Vec模型可以高效地计算单词向量。

### Word2Vec词嵌入的应用

Word2Vec词嵌入广泛应用于自然语言处理任务中,包括:

* **文本相似度计算**

* **文本分类**

* **信息检索**

* **机器翻译**

# 3. Word2Vec词嵌入在文本相似度计算中的应用

Word2Vec词嵌入在文本相似度计算中发挥着至关重要的作用,为文本相似度计算提供了强大的语义表示。

#### 基于Word2Vec词嵌入的文本相似度计算方法

基于Word2Vec词嵌入的文本相似度计算方法主要包括以下几种:

- **余弦相似度:**计算两个文本词嵌入向量的余弦值,余弦值越大,相似度越高。

```python

import numpy as np

from sklearn.metrics.pairwise import cosine_similarity

def cosine_similarity(text1, text2):

# 将文本转换为词嵌入向量

text1_embedding = model.wv[text1]

text2_embedding = model.wv[text2]

# 计算余弦相似度

similarity = cosine_similarity([text1_embedding], [text2_embedding])

return similarity

```

- **欧氏距离:**计算两个文本词嵌入向量之间的欧氏距离,欧氏距离越小,相似度越高。

```python

import numpy as np

from sklearn.metrics.pairwise import euclidean_distances

def euclidean_distance(text1, tex

```

0

0