【复杂数据结构下的策略】:选择适合的损失函数提高模型性能

发布时间: 2024-09-06 00:10:37 阅读量: 96 订阅数: 28

# 1. 损失函数在模型训练中的重要性

在机器学习模型的训练过程中,损失函数充当了衡量模型性能的核心角色。它不仅提供了模型预测与实际数据之间差异性的量化,还指导了模型参数的更新方向。简而言之,损失函数是一个将模型预测值与真实值之间的差异转化为一个可以优化的数值的数学函数。这个数值越低,表明模型的预测越接近真实数据,性能越好。因此,选择合适的损失函数,对于模型的训练和后续的优化工作至关重要。本章将从损失函数的基本概念入手,逐步深入探讨其在机器学习中的关键作用和影响。

# 2. 理解复杂数据结构下的损失函数

在深度学习和机器学习项目中,我们经常面临各种各样的数据结构。为了有效地训练模型并使其在不同问题上表现出色,选择和设计适合于特定数据结构的损失函数至关重要。本章将深入探讨复杂数据结构下的损失函数,揭示其背后的工作原理,并提供有关如何正确选择和使用它们的见解。

## 2.1 损失函数的理论基础

### 2.1.1 损失函数的定义和作用

在机器学习中,损失函数(也称为代价函数或目标函数)是模型训练的核心。它量化了模型输出与实际目标值之间的差异,代表了模型性能的坏的一面。通过最小化损失函数,模型能够学习到如何对输入数据做出正确的预测或分类。

```python

# 示例:均方误差损失函数的简单实现

import numpy as np

def mean_squared_error(y_true, y_pred):

return np.mean((y_true - y_pred) ** 2)

```

在上述代码中,`y_true` 表示真实的标签,`y_pred` 是模型预测的值。损失函数计算两者差值的平方,然后取平均值,得到一个代表模型预测误差大小的标量值。模型训练的目标是减小这个损失值。

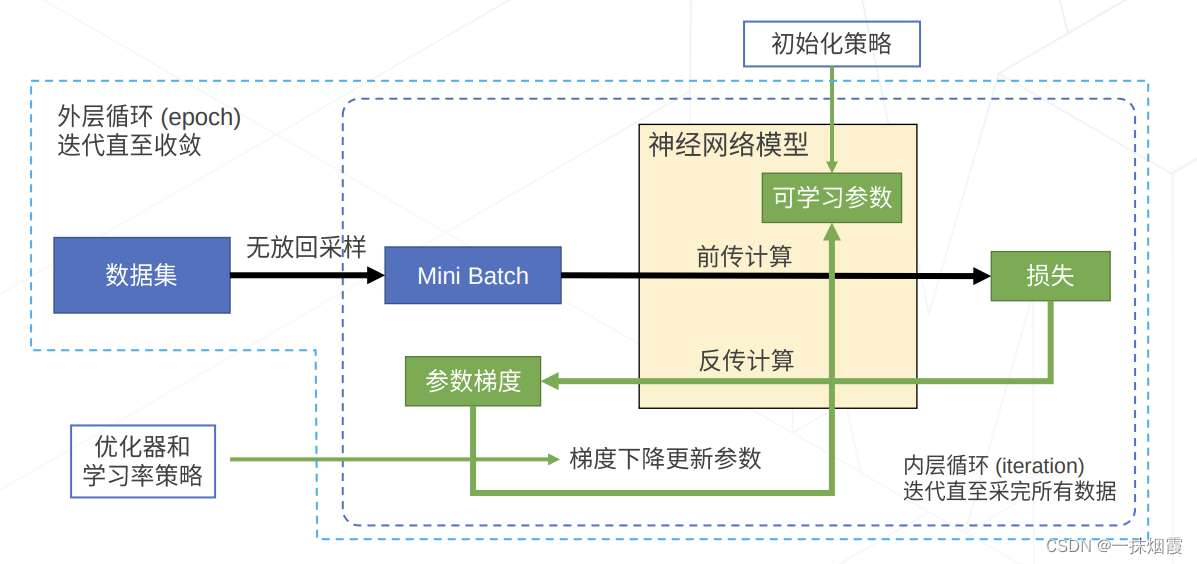

### 2.1.2 损失函数与优化算法的关系

损失函数的目的是为优化算法提供一个可衡量的目标,优化算法则利用该目标来更新模型的权重。在模型训练过程中,梯度下降是最常用的优化算法之一。它通过计算损失函数相对于模型权重的梯度来实现权重的更新。

```python

# 示例:使用梯度下降更新权重

def gradient_descent(weights, X, y_true, loss_func, learning_rate):

y_pred = X.dot(weights)

loss = loss_func(y_true, y_pred)

grad = (X.T).dot(y_true - y_pred) / len(y_true)

weights -= learning_rate * grad

return weights, loss

```

在上面的伪代码中,`X` 表示输入特征,`weights` 是模型的权重,`learning_rate` 是学习率。梯度下降算法首先计算损失值,然后求损失函数相对于权重的梯度,最后根据学习率和梯度更新权重。

## 2.2 常见复杂数据结构的特征

### 2.2.1 时间序列数据的特点

时间序列数据通常具有时间顺序依赖性,即当前的观测值与之前的观测值相关。处理这种类型的数据需要损失函数能够捕捉这种时间依赖性,以确保模型学习到正确的时间动态。

### 2.2.2 图形和网络数据的复杂性

图数据结构包含节点和边,且节点间关系复杂。图形数据上的学习任务,如节点分类和图分类,要求损失函数能够理解图结构的复杂性并进行有效的优化。

### 2.2.3 多维数组和高维空间数据

多维数据通常出现在计算机视觉和自然语言处理等领域。在这些情况下,损失函数需要能够处理高维空间中的数据分布,以确保模型能够泛化到未知的数据上。

## 2.3 损失函数与数据结构的匹配

### 2.3.1 不同数据结构下的损失函数选择

选择与特定数据结构相匹配的损失函数是至关重要的。例如,在时间序列预测中,可以使用均方误差损失函数,而对于分类问题,交叉熵损失函数可能更加合适。

```python

# 示例:交叉熵损失函数

def cross_entropy(y_true, y_pred):

return -np.sum(y_true * np.log(y_pred) + (1 - y_true) * np.log(1 - y_pred))

```

在分类问题中,交叉熵损失函数通过计算预测概率分布和实际标签的概率分布之间的差异,来推动模型进行更好的分类。

### 2.3.2 损失函数对模型性能的影响评估

评估损失函数对模型性能的影响,需要计算测试集上的损失值,并对比不同损失函数在验证集上的性能指标,例如准确率、召回率等。

```python

# 示例:在测试集上评估损失

def evaluate_loss(y_true, y_pred):

loss = mean_squared_error(y_true, y_pred) # 或其他损失函数

return loss

# 假设 y_true_test 是测试集的实际标签,y_pred_test 是模型的预测结果

test_loss = evaluate_loss(y_true_test, y_pred_test)

print(f"Test set loss: {test_loss}")

```

通过这种方式,我们可以观察模型在不同损失函数下的行为,并选择表现最佳的损失函数来训练最终模型。

在下一章节中,我们将继续探讨损失函数的优化策略与实践,以及如何对损失函数进行实验调整以进一步提升模型性能。

# 3. 损失函数的优化策略与实践

在理解了损失函数的基础理论以及如何与复杂数据结构相匹配之后,接下来我们要探讨的焦点是损失函数的优化策略以及这些策略在实际应用中的具体操作。本章旨在提供一系列技术手段和方法论,以帮助从业者在面对特定问题时能够有效地选择和优化损失函数。

## 3.1 损失函数的优化方法

损失函数的优化是机器学习和深度学习训练中的关键环节。优化损失函数不仅仅是为了减少模型的预测误差,更是为了提升模型的泛化能力,使之在未见数据上有更好的表现。

### 3.1.1 正则化技术在损失函数中的应用

正则化是一种避免过拟合的通用技术,它通过在损失函数中引入一个附加项来限制模型复杂度。L1和L2正则化是最常见的两种类型,它们分别通过加入权重的绝对值之和和平方和来工作。

```python

import numpy as np

from sklearn.linear_model import Ridge # L2正则化模型

# 假设有特征矩阵X和目标向量y

# X, y = ...

# 创建Ridge回归模型实例,alpha参数控制正则化强度

ridge_model = Ridge(alpha=1.0)

# 拟合模型

ridge_model.fit(X, y)

# 预测结果

predictions = ridge_model.predict(X)

```

在上述代码中,`alpha`参数就是正则化项的系数,它决定了正则化强度。较小的值可能导致过拟合,而较大的值可能会导致欠拟合。调整这个参数需要通过交叉验证来寻找最佳值。

### 3.1.2 自定义损失函数的策略与技巧

在某些特定情况下,标准的损失函数可能不完全符合需求。例如,当数据存在异常值或我们需要考虑特定的业务需求时,可能需要自定义损失函数。在构建自定义损失函数时,需要深入理解现有损失函数的原理,并结合实际问题进行调整。

```python

def custom_loss_function(y_true, y_pred):

"""

自定义损失函数示例,计算预测值与真实值之间的绝对误差。

"""

return np.mean(np.abs(y_true - y_pred))

# 假设真实值和预测值如下

# y_true = np.array([...])

# y_pred = np.array([...])

# 计算损失值

loss = custom_loss_function(y_true, y_pred)

```

在自定义损失函数时,重要的是要考虑到梯度的计算和优化算法的选择。复杂的自定义损失函数可能会使得梯度计算变得困难,这反过来会影响模型的训练效率。

## 3.2 损失函数的实

0

0