数据规模与AI性能的权衡:如何做出明智选择

发布时间: 2024-09-01 19:56:55 阅读量: 103 订阅数: 93

生成式人工智能测试方法(AI)与应用案例汇总:适用于大模型推理和性能验证

# 1. 数据规模对AI性能的影响

随着信息技术的飞速发展,我们正处在一个数据爆炸的时代。大数据不仅为人工智能(AI)带来了前所未有的机遇,同时也带来了性能挑战。在本章中,我们将探讨数据规模如何影响AI系统的性能,从数据规模增大的好处和问题开始,逐步深入分析数据量与模型准确性、训练效率和系统可扩展性之间的关系。

## 数据规模的双刃剑效应

数据是AI模型的“燃料”,更大的数据规模通常意味着更高的模型准确性和更强的泛化能力。但是,数据量的增加也带来了诸多挑战,如存储和计算资源的消耗增加、模型训练时间的延长等。这就要求我们合理权衡数据规模和系统性能的关系。

## 数据规模与AI性能的关联

为了深入理解数据规模如何影响AI性能,我们需要从多个角度进行分析,包括但不限于模型训练、预测效率、以及系统的可扩展性。接下来的章节将详细探讨这些方面,并提供实用的策略来优化AI性能。

# 2. AI性能的理论基础

AI性能的理论基础是理解数据规模如何影响AI系统的核心起点。本章节将详细探讨AI性能评估的指标、算法复杂度以及硬件资源对性能的影响。

### 2.1 AI性能评估指标

在AI领域,衡量模型性能的指标多种多样,但核心可归纳为准确性、效率和可扩展性。

#### 2.1.1 准确性、效率和可扩展性的衡量

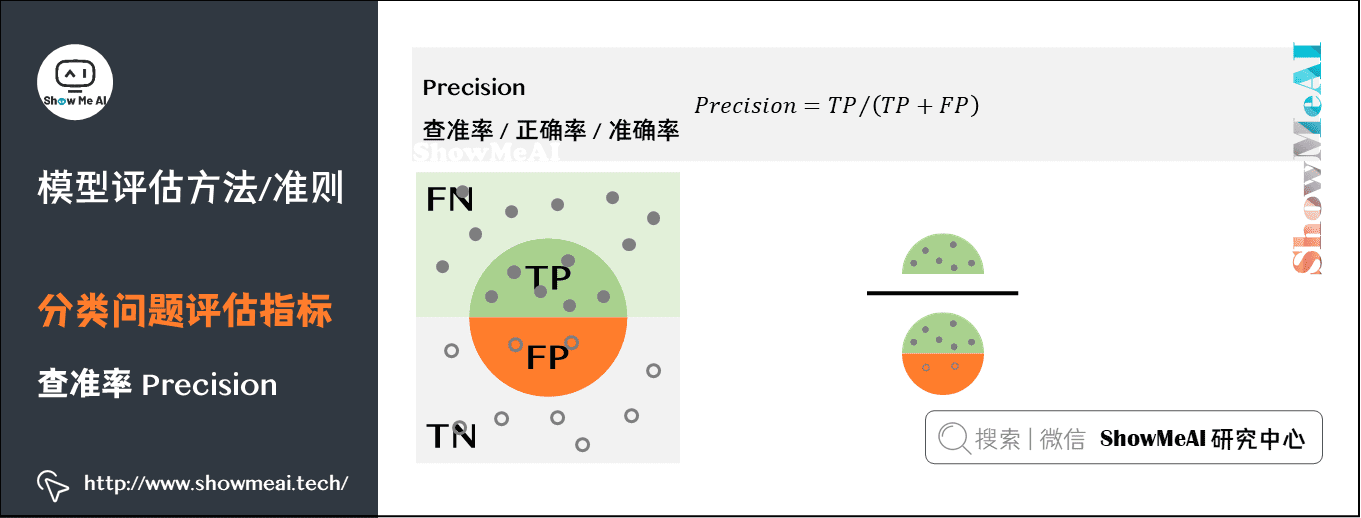

准确性是指模型对于未知数据的预测能力,它是最直接的性能指标。评估准确性常用的方法包括准确率、精确率、召回率和F1分数等。效率通常体现在模型的响应时间和处理速度上,这直接关系到模型在实际应用中的可用性。可扩展性指的是系统随着数据量增加,仍能保持性能不下降的能力。

#### 2.1.2 性能指标与实际应用场景的关联

不同应用场景对性能指标的要求各不相同。例如,金融领域可能更看重模型的准确性,而实时推荐系统则需要高效率和良好的可扩展性。因此,必须根据实际应用场景来选择和优化模型。

```python

# 示例代码:评估模型准确性的Python代码

from sklearn.metrics import accuracy_score

# 假设y_true是真实标签,y_pred是预测标签

y_true = [0, 1, 1, 0, 1]

y_pred = [0, 0, 1, 0, 1]

# 计算准确率

accuracy = accuracy_score(y_true, y_pred)

print(f"Accuracy: {accuracy}")

# 参数说明:

# y_true - 真实标签列表

# y_pred - 预测标签列表

```

### 2.2 AI算法的复杂度分析

算法的复杂度是AI性能理论基础的另一个关键点,涉及时间复杂度和空间复杂度。

#### 2.2.1 时间复杂度和空间复杂度的定义

时间复杂度衡量算法执行所需的时间随输入数据规模增长的变化趋势。空间复杂度则衡量算法在执行过程中占用的内存空间随数据规模的变化趋势。这两者是衡量算法性能的重要标准。

#### 2.2.2 算法复杂度对性能的影响案例分析

例如,深度学习中,卷积神经网络(CNN)的时间复杂度和空间复杂度通常较高,但在图像处理上表现出色。而在自然语言处理(NLP)中,循环神经网络(RNN)由于其序列处理能力,尽管复杂度较高,但同样表现出色。

### 2.3 硬件资源与AI性能

硬件资源是AI模型运行的基础,对性能有着直接影响。

#### 2.3.1 CPU、GPU和TPU在AI中的作用

CPU具有强大的通用计算能力,适合处理逻辑复杂的任务。GPU拥有成百上千的核心,适合处理并行计算任务,如深度学习模型的训练。TPU是Google开发的专用于机器学习任务的处理器,拥有更高的性能和能效比。

#### 2.3.2 内存和存储对AI性能的影响

内存大小直接影响到数据处理的速度和模型的规模,存储则决定了数据的读取速度和存储容量。随着数据规模的增加,对内存和存储的要求也越来越高。

```mermaid

graph TD

A[AI模型] -->|数据输入| B[CPU/GPU/TPU]

B -->|处理结果| C[输出结果]

D[内存] -.-> B

E[存储] -.-> A

```

本章节通过理论和案例分析了AI性能评估指标、算法复杂度以及硬件资源对AI性能的影响。下章将继续探讨数据规模与AI模型训练之间的权衡策略。

# 3. 数据规模与AI模型训练的权衡策略

在AI模型的开发和训练过程中,数据规模与模型性能之间的权衡策略是关键。本章将深入探讨数据预处理与特征工程的重要性,模型选择与训练技巧以及处理过拟合与欠拟合的方法。

## 3.1 数据预处理与特征工程

数据预处理和特征工程是AI项目成功的基础。为了保证模型的性能,原始数据必须经过一系列的处理步骤。

### 3.1.1 数据清洗和特征选择的影响

数据清洗的目的是确保数据的质量,去除噪声和异常值。在机器学习中,数据质量直接影响模型的准确性。例如,在医疗诊断模型中,正确标注的样本对于提高模型的诊断准确性至关重要。

```python

# 示例:数据清洗和异常值处理

import pandas as pd

# 加载数据集

df = pd.read_csv('dataset.csv')

# 检查和处理缺失值

df.fillna(df.mean(), inplace=True) # 使用均值填充缺失值

# 去除重复数据

df.drop_duplicates(inplace=True)

# 异常值处理

Q1 = df.quantile(0.25)

Q3 = df.quantile(0.75)

IQR = Q3 - Q1

df = df[~((df < (Q1 - 1.5 * IQR)) | (df > (Q3 + 1.5 * IQR))).any(axis=1)]

```

在上述Python代码中,我们首先使用`fillna`函数将缺失值用该列的均值填充,使用`drop_duplicates`删除重复数据,然后通过计算四分位数和IQR(四分位距)来检测并去除异常值。这些步骤确保了数据的质量,为后续的特征选择和模型训练打下了良好的基础。

### 3.1.2 数据增强和维度缩减技术

数据增强是指通过变换原始数据生成新的训练样本,以提高模型对新数据的泛化能力。常见的方法包括旋转、缩放、裁剪等。

```python

from imgaug import augmenters as iaa

# 图像数据增强示例

seq = iaa.Sequential([

iaa.Fliplr(0.5), # 水平翻转图片

iaa.CropAndPad(percent=(-0.2, 0.2)), # 随机调整图片大小

iaa.Affine(

scale={"x": (0.8, 1.2), "y": (0.8, 1.2)}, #

```

0

0