分布式AI系统的性能挑战:优化策略与实践案例

发布时间: 2024-09-01 19:35:21 阅读量: 194 订阅数: 73

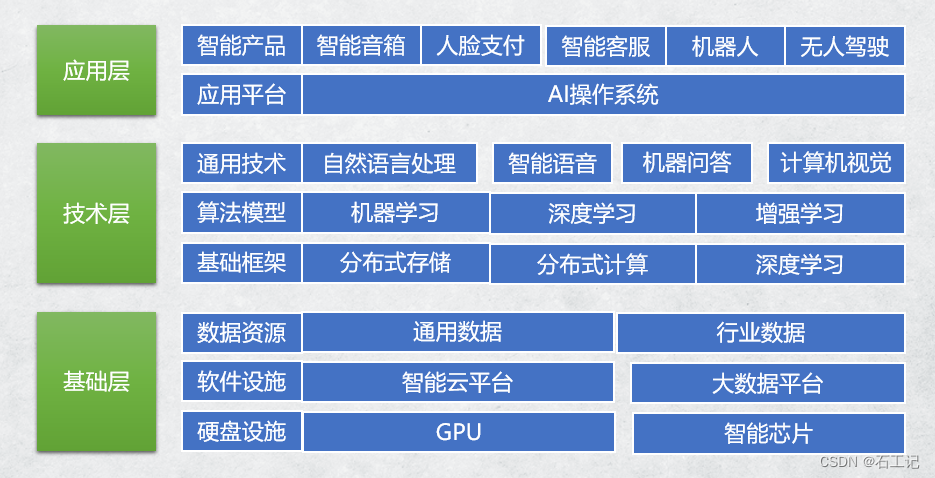

# 1. 分布式AI系统概述

在信息技术高速发展的当下,分布式AI系统以其优异的可扩展性和强大的计算能力逐渐成为AI领域的核心技术之一。分布式AI系统通过将复杂的人工智能算法在多个计算节点上并行执行,实现了大规模数据处理和高性能计算任务的加速。

## 1.1 分布式AI系统的定义与特点

分布式AI系统是基于分布式计算技术构建的人工智能系统。这些系统通常由多台计算机或设备组成,它们通过网络连接,协同工作以完成特定的AI任务。与传统集中式AI系统相比,分布式AI系统的主要特点包括高可扩展性、容错能力和数据处理效率。

## 1.2 分布式AI的应用场景

分布式AI广泛应用于大规模机器学习、深度学习、自然语言处理等领域。在搜索引擎、推荐系统、语音识别和图像处理中,分布式AI系统能够处理海量数据,提供实时、准确的智能服务。这些系统正在快速改变我们与技术交互的方式,并在自动驾驶、医疗分析、金融预测等多个行业产生深远的影响。

# 2. 分布式AI系统的性能挑战

## 2.1 理论基础:分布式计算原理

### 2.1.1 分布式系统的基本概念

在探讨分布式AI系统的性能挑战之前,必须先建立对分布式系统的理解。分布式系统是由多个计算节点组成的网络,这些节点通过通信网络互联,共同完成特定的任务。每个节点都具有自主的处理能力,能够进行数据的处理和存储。在分布式AI系统中,节点间需要高效的协作以完成数据处理和机器学习模型的训练与推理任务。

分布式系统的核心特性包括并发性、资源共享、异构性和可扩展性。并发性体现在多个节点可以同时进行计算任务,资源共享则是指不同节点间可以共享计算和存储资源,异构性强调系统中可能包含不同类型的硬件和软件组件,而可扩展性则意味着系统可以根据需要增加或减少节点数量。

分布式计算的一个关键挑战是节点之间的通信和同步,因为节点彼此独立,必须通过消息传递来协调状态和数据。这种协调机制会引入额外的开销,尤其是在网络延迟较高的情况下,对系统的整体性能影响尤为明显。

### 2.1.2 分布式AI的关键技术要素

分布式AI系统在构建时需要考虑的关键技术要素包括数据的划分与管理、计算任务的调度与负载均衡、以及故障恢复与系统容错机制。数据的划分与管理直接关联到系统的性能,好的数据管理策略可以最大限度地减少数据在节点间的传输,提高计算效率。计算任务的调度和负载均衡则关系到如何高效地利用整个系统的资源,避免计算瓶颈的出现。故障恢复和系统容错机制保证了系统的高可用性和稳定性,即便在个别节点失效的情况下,系统也能继续正常运行。

### 2.1.3 分布式AI系统的关键性能指标

分布式AI系统的关键性能指标包括但不限于吞吐量、响应时间、资源利用率和系统的可伸缩性。吞吐量衡量的是系统在单位时间内完成的任务数量,响应时间是指系统完成特定请求所需的时间,资源利用率反映了系统计算资源的有效使用程度,而可伸缩性则描述了系统在增加或减少工作负载时性能的适应能力。

## 2.2 实践挑战:性能瓶颈分析

### 2.2.1 网络通信延迟

网络通信延迟是分布式AI系统中遇到的最直接的性能瓶颈之一。由于AI任务通常需要大量的数据交换和协同计算,节点间的数据传输延迟会直接影响到整个系统的响应速度和吞吐量。为了减少通信延迟的影响,开发者需要设计高效的数据传输协议和优化消息传递的模式。

### 2.2.2 数据一致性与同步问题

数据一致性与同步问题是分布式AI系统中的另一个重要挑战。在分布式环境下保持数据一致性往往需要额外的通信开销和同步机制,这不仅增加了系统的复杂性,也会在一定程度上降低系统的性能。解决这一问题的关键在于权衡一致性要求和系统性能之间的关系,采用合适的数据复制和同步策略,如采用版本向量或一致性哈希技术等。

### 2.2.3 资源调度和负载均衡

资源调度和负载均衡是确保分布式AI系统高效运行的核心技术之一。通过有效的资源调度,可以使得系统的计算资源得到充分的利用,避免因资源空闲或过载而导致的性能损失。负载均衡需要考虑的因素很多,包括任务的类型、节点的处理能力、以及当前的系统负载状态等。在此方面,可以采用各种启发式算法,如遗传算法、蚁群算法等,以实现更为智能和适应性强的资源调度策略。

```mermaid

graph TD

A[开始负载均衡] --> B[收集节点资源信息]

B --> C[评估任务负载]

C --> D[执行调度策略]

D -->|基于启发式算法| E[分配任务到节点]

D -->|基于规则系统| F[分配任务到节点]

E --> G[监控任务执行]

F --> G

G -->|负载变化| B

```

以上流程图展示了负载均衡的一个典型处理流程。这包括收集节点资源信息、评估任务负载、执行调度策略,并根据任务执行情况不断地反馈调整,以实现负载均衡。

### 2.2.4 容错机制与系统鲁棒性

分布式AI系统中的另一个挑战是容错机制和系统的鲁棒性。在分布式环境中,由于硬件故障、网络问题以及软件缺陷等因素,节点的失效成为常态。为了保障系统的可靠性,需要设计有效的容错机制,如数据备份、冗余计算和故障检测与恢复等。

本章节从分布式AI系统的基础理论和实践挑战两个层面,详细探讨了分布式计算原理和性能瓶颈。下节内容将针对分布式AI系统的优化策略进行深入分析。

# 3. 分布式AI系统的优化策略

## 3.1 算法层面的优化

### 3.1.1 算法并行化设计

在分布式AI系统中,算法的并行化设计是提高效率和处理速度的关键。算法并行化涉及将算法分解为可以独立运行的部分,以便在多个处理器或计算节点上同时执行。这样可以显著缩短执行时间,特别是在处理大规模数据集时。

以深度学习中的前向传播为例,一个神经网络模型可以被分解为多层,每一层的计算可以并行处理。在实际的算法并行化设计中,通常会将数据并行和模型并行结合起来使用:

- **数据并行**:在多个计算节点间分配不同的数据子集,每个节点对各自的数据执行相同的模型计算过程。

- **模型并行**:将模型的不同部分分配到不同的计算节点上,每个节点负责模型的一部分计算。

下面是一个简化的代码示例,展示如何使用Python和多线程进行数据并行化处理:

```python

import threading

import queue

def worker(input_queue, output_queue):

while not input_queue.empty():

# 假设模型处理的函数是model_process

result = model_process(input_queue.get())

output_queue.put(result)

def model_process(data):

# 这里是模型的前向传播或其他操作

pass

# 创建输入和输出队列

input_queue = queue.Queue()

output_queue = queue.Queue()

# 假设有一个大型数据集,并将其分割为多个子集

data_chunks = split_large_dataset(large_dataset)

# 将数据子集放入输入队列

for data in data_chunks:

input_queue.put(data)

# 启动多个工作线程

threads = []

for _ in range(num_threads):

t = threading.Thread(target=worker, args=(input_queue, output_queue))

t.start()

threads.append(t)

# 等待所有线程完成

for t in threads:

t.join()

# 处理输出队列中的结果

while not output_queue.empty():

result = output_queue.get()

# 进行后续处理

```

在上述代码中,我们创建了输入和输出队列来管理数据流动,并启动了多个线程来并行处理这些数据。每个线程执行`worker`函数,该函数从输入队列中取出数据进行处理,并将结果放入输出队列。

并行化设计的挑战在于如何有效分割任务以及如何高效地管理数据和任务的同步。对于复杂的模型,还需要考虑到不同节点间计算结果的合并与同步问题。这就涉及到分布式系统的通信开销和同步机制的设计,这对于系统性能优化至关重要。

### 3.1.2 模型压缩和剪枝技术

随着深度学习模型的规模不断增长,模型的存储和计算开销也随之增加。模型压缩和剪枝技术成为了解决这一问题的重要手段。模型压缩通过减少模型参数的数量或精度来减小模型的大小,而剪枝则是一种去除冗余或不重要的参数的技术。这些方法不仅减少了模型的存储需求,还有助于提升推理时的性能。

模型剪枝通常包含以下步骤:

1. **训练**:首先训练一个完整的模型以获得一个基准。

2. **评估**:评估模型中的参数重要性。

3. **剪枝**:移除那些重要性较低的参数。

4. **微调**:对剪枝后的模型进行微调,以恢复性能损失。

以下是一个剪枝的伪代码示例:

```python

# 假设model是一个训练好的神经网络模型

def evaluate_param_importance(model):

# 对模型参数的重要度进行评分

pass

def prune_model(model, importance_scores):

# 根据重要度分数移除参数

pass

def fine_tune_model(model):

# 微调模型以恢复性能

pass

# 训练一个完整的模型

model = train_model()

# 评估模型参数重要性

importance_scores = evaluate_param_importance(model)

# 根据重要性分数剪枝

pruned_model = prune_model(model, importance_scores)

# 微调模型

fine_tune_model(pruned_model)

```

在实际应用中,模型压缩和剪枝技术的选择依赖于具体应用场景和性能要求。剪枝可能会影响模型的准确性,因此通常需要在减少模型大小和维持模型性能之间进行权衡。此外,还需要考虑剪枝技术对硬件的依赖性和兼容性问题,以及如何在不同的硬件

0

0