可解释人工智能:在监管和合规中的作用:满足合规要求,促进人工智能的负责任发展

发布时间: 2024-08-22 23:46:50 阅读量: 36 订阅数: 27

# 1. 可解释人工智能的基础**

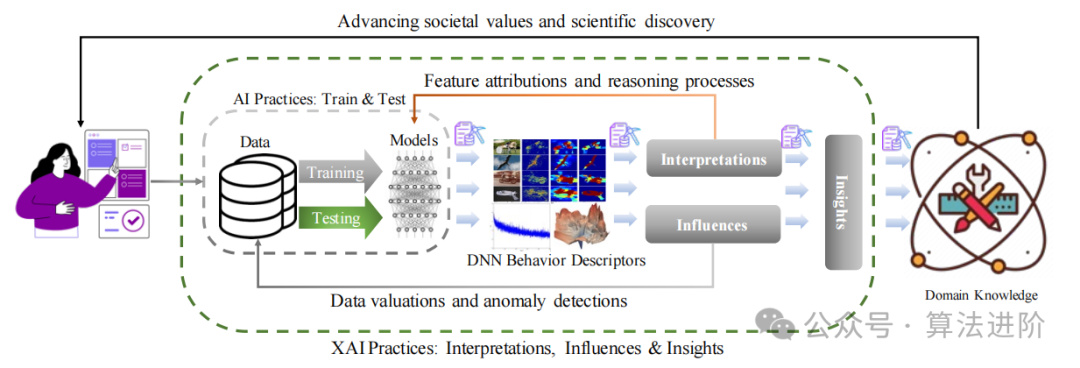

可解释人工智能 (XAI) 是人工智能 (AI) 的一个子领域,它专注于使 AI 系统的可解释性、透明度和可审计性。XAI 旨在通过提供对 AI 模型决策过程的见解来增强人们对 AI 系统的信任和理解。

XAI 对于监管和合规至关重要,因为它有助于确保 AI 系统符合道德和法律标准。通过使 AI 系统可解释,监管机构和合规人员可以评估 AI 系统的公平性、准确性和可靠性。这对于确保 AI 系统负责任地使用并不会对个人或社会造成伤害至关重要。

此外,XAI 还有助于促进 AI 的负责任发展。通过识别和减轻 AI 系统中的偏见和歧视,XAI 可以帮助确保 AI 系统不会对特定群体造成不公平的影响。这对于建立信任和确保 AI 系统被社会广泛接受至关重要。

# 2. 可解释人工智能在监管和合规中的应用

可解释人工智能(XAI)在监管和合规领域发挥着至关重要的作用,因为它有助于确保人工智能系统的透明度、可审计性和负责任性。本章将探讨 XAI 在满足监管要求和促进人工智能负责任发展方面的应用。

### 2.1 满足监管要求

**2.1.1 确保人工智能系统的透明度和可审计性**

监管机构要求人工智能系统具有透明度和可审计性,以便评估其决策过程和结果。XAI 技术可以通过提供有关人工智能模型如何做出决策的可解释信息来满足这些要求。

例如,可解释机器学习(ML)算法可以生成解释,说明模型预测的特征重要性。这些解释可以帮助监管机构了解人工智能系统的行为并评估其是否符合监管标准。

**2.1.2 遵守数据保护和隐私法规**

数据保护和隐私法规要求组织对个人数据的使用负责。XAI 可以帮助组织遵守这些法规,因为它可以提供有关人工智能系统如何使用和处理个人数据的可解释信息。

通过使用 XAI 技术,组织可以识别和减轻数据处理中的潜在偏差或歧视。这有助于确保人工智能系统符合数据保护和隐私法规,并保护个人免受数据滥用。

### 2.2 促进人工智能的负责任发展

**2.2.1 识别和减轻偏见和歧视**

人工智能系统可能存在偏见和歧视,这可能会对个人和社会产生负面影响。XAI 技术可以通过提供有关人工智能模型决策过程的可解

0

0