可解释人工智能:分析过程和解决方案:深入解读常见技术问题和应对策略

发布时间: 2024-08-22 23:38:47 阅读量: 15 订阅数: 11

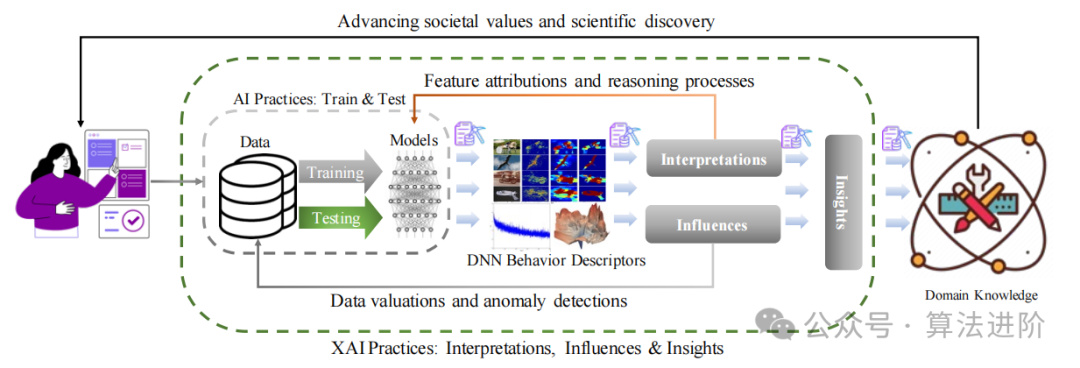

# 1. 可解释人工智能概述

可解释人工智能 (XAI) 是一种人工智能 (AI) 技术,它能够向人类用户解释其决策过程和预测。与传统的黑盒 AI 模型不同,XAI 模型可以提供有关其内部工作原理的见解,从而提高透明度和可信度。

XAI 在许多领域具有广泛的应用,包括医疗保健、金融和制造业。通过提供对 AI 决策的解释,XAI 可以帮助利益相关者理解和信任模型的预测,从而促进更好的决策制定和更有效的 AI 部署。

XAI 模型通常采用局部或全局可解释性技术。局部可解释性方法解释单个预测,而全局可解释性方法解释整个模型的行为。这些技术可以帮助用户识别模型中最重要的特征,了解模型的决策边界,并检测潜在的偏差或错误。

# 2. 可解释人工智能的分析过程

可解释人工智能的分析过程是一个多阶段的过程,涉及数据收集、准备、模型训练和评估。

### 2.1 数据收集和准备

#### 2.1.1 数据源识别和获取

数据收集和准备是可解释人工智能分析过程中的第一步。这一步涉及识别和获取与分析目标相关的相关数据。数据源可以包括:

- **内部数据:**组织内部生成的数据,例如客户记录、交易数据和传感器数据。

- **外部数据:**从外部来源获取的数据,例如公共数据集、社交媒体数据和市场研究。

数据获取过程可能涉及以下步骤:

- **数据爬取:**从网站和其他在线资源提取数据。

- **API集成:**与其他系统集成以获取数据。

- **手动收集:**通过调查、访谈或观察收集数据。

#### 2.1.2 数据清洗和预处理

一旦数据收集完成,就需要对其进行清洗和预处理以使其适合建模。数据清洗涉及删除不完整、重复或不准确的数据。预处理包括:

- **数据转换:**将数据转换为建模所需的格式。

- **特征工程:**创建新的特征或转换现有特征以提高模型性能。

- **数据标准化:**将数据缩放或归一化到一个共同的范围。

### 2.2 模型训练和评估

#### 2.2.1 模型选择和参数优化

数据准备完成后,就可以选择和训练模型。模型选择取决于分析目标和数据类型。常用的模型类型包括:

- **线性回归:**用于预测连续变量。

- **逻辑回归:**用于预测二元分类变量。

- **决策树:**用于分类和回归任务。

- **支持向量机:**用于分类和回归任务。

- **神经网络:**用于各种任务,包括图像识别、自然语言处理和预测。

模型训练涉及使用训练数据调整模型参数以优化模型性能。参数优化技术包括:

- **网格搜索:**系统地搜索参数空间以找到最佳参数组合。

- **梯度下降:**迭代更新参数以最小化损失函数。

- **贝叶斯优化:**使用贝叶斯统计来指导参数搜索。

#### 2.2.2 模型评估指标和方法

训练完成后,需要评估模型的性能。模型评估指标取决于分析目标。常见的指标包括:

- **准确率:**预测正确的样本比例。

- **召回率:**预测正确的正样本比例。

- **F1分数:**准确率和召回率的调和平均值。

- **均方根误差:**对于回归任务,预测值与实际值之间的平均差异。

模型评估方法包括:

- **训练集评估:**使用训练数据评估模型。

- **验证集评估:**使用未用于训练的验证数据评估模型。

- **测试集评估:**使用未用于训练或验证的测试数据评估模型。

# 3. 可解释人工智能的解决方案

### 3.1 模型可解释性技术

可解释人工智能模型可分为局部可解释性方法和全局可解释性方法。

#### 3.1.1 局部可解释性方法

局部可解释性方法解释特定预测的因素。

* **LIME(局部可解释模型可解释性):**通过创建局部线性模型来解释预测,该模型使用邻近数据点的加权平均值。

* **SHAP(Shapley值分析):**计算每个特征对预测的影响,使

0

0