可解释人工智能:如何设计可解释的机器学习管道:从数据预处理到模型部署

发布时间: 2024-08-22 23:45:21 阅读量: 18 订阅数: 11

# 1. 可解释人工智能概述

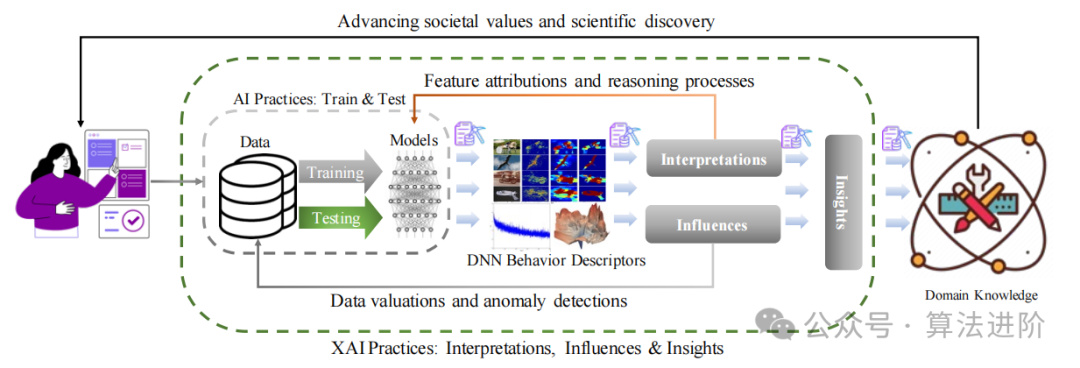

可解释人工智能(XAI)是人工智能(AI)的一个子领域,它旨在使机器学习模型和算法的可理解和解释。XAI 对于理解 AI 系统的决策过程至关重要,从而提高透明度、可信度和问责制。

XAI 涉及开发技术和方法,使 AI 模型能够以人类可以理解的方式解释其预测和决策。这包括提供有关模型输入、输出和内部工作原理的信息。通过可解释性,我们可以评估模型的可靠性、识别潜在的偏差并确保模型符合道德准则。

# 2. 可解释机器学习管道的理论基础

### 2.1 可解释性度量和方法

可解释性度量是衡量机器学习模型可解释程度的标准。常见的可解释性度量包括:

- **局部可解释性 (LIME)**:通过扰动输入数据并观察模型输出的变化来解释单个预测。

- **SHAP (SHapley Additive Explanations)**:使用博弈论中的 Shapley 值来衡量每个特征对模型预测的影响。

- **决策树和规则集**:使用决策树或规则集来表示模型,从而提供易于理解的解释。

可解释性方法是用于提高机器学习模型可解释性的技术。这些方法包括:

- **特征重要性**:识别对模型预测影响最大的特征。

- **局部可解释模型 (LIM)**:训练一个局部模型来解释单个预测。

- **对抗性示例**:生成欺骗模型的输入,以了解模型的弱点。

### 2.2 机器学习模型的可解释性技术

不同的机器学习模型具有不同的可解释性技术。以下是一些常见模型的可解释性技术:

| 模型类型 | 可解释性技术 |

|---|---|

| **线性模型** | 特征重要性、局部可解释模型 |

| **决策树** | 决策树、规则集 |

| **随机森林** | 特征重要性、局部可解释模型 |

| **支持向量机** | 局部可解释模型、对抗性示例 |

| **神经网络** | 局部可解释模型、对抗性示例、梯度解释 |

**代码块:**

```python

import shap

# 加载数据

data = pd.read_csv('data.csv')

# 训练模型

model = RandomForestClassifier()

model.fit(data[['feature1', 'feature2']], data['target'])

# 使用 SHAP 解释模型

explainer = shap.TreeExplainer(model)

shap_values = explainer.shap_values(data[['feature1', 'feature2']])

# 可视化 SHAP 值

shap.plots.waterfall(shap_values)

```

**逻辑分析:**

这段代码使用 SHAP (SHapley Additive Explanations) 来解释一个随机森林分类模型。SHAP 值表示每个特征对模型预测的影响。瀑布图可视化了这些影响,显示了特征如何共同影响模型输出。

**参数说明:**

- `shap.TreeExplainer(mod

0

0