【Java算法优化秘籍】:从菜鸟到高手,算法效率飙升

发布时间: 2024-08-28 02:53:57 阅读量: 14 订阅数: 31

# 1. Java算法基础与复杂度分析

**1.1 算法概念**

算法是解决特定问题的一系列步骤。它描述了将输入转换为输出的计算过程。算法的效率由其时间复杂度和空间复杂度决定。

**1.2 时间复杂度**

时间复杂度衡量算法执行所需的时间。它通常用大 O 符号表示,表示算法运行时间随输入规模增长的渐近行为。例如,O(n)表示算法的运行时间与输入规模n成正比。

# 2. 数据结构与算法设计

### 2.1 常见数据结构及其应用

#### 2.1.1 数组、链表、栈和队列

**数组**

* **定义:**线性数据结构,元素按顺序存储在连续的内存空间中。

* **特点:**

* 访问元素高效(O(1)),但插入和删除元素代价高(O(n))。

* 适用于存储大量数据,且数据访问频繁。

* **应用:**

* 存储固定大小的数据集(如成绩表)

* 作为其他数据结构(如栈、队列)的基础

**链表**

* **定义:**非线性数据结构,元素以节点形式存储,每个节点包含数据和指向下一个节点的指针。

* **特点:**

* 插入和删除元素高效(O(1)),但访问元素代价高(O(n))。

* 适用于存储动态大小的数据集,或需要频繁插入和删除元素。

* **应用:**

* 存储可变长度的字符串

* 实现栈、队列等数据结构

**栈**

* **定义:**后进先出(LIFO)数据结构,元素只能从栈顶添加或删除。

* **特点:**

* 添加和删除元素高效(O(1))。

* 适用于需要按顺序处理数据的场景(如函数调用)

* **应用:**

* 函数调用栈

* 表达式求值

**队列**

* **定义:**先进先出(FIFO)数据结构,元素只能从队列尾部添加,从队列头部删除。

* **特点:**

* 添加和删除元素高效(O(1))。

* **应用:**

* 任务队列

* 消息传递

#### 2.1.2 树、图和哈希表

**树**

* **定义:**层次结构的数据结构,由节点和边组成,其中一个节点为根节点,其他节点为子节点。

* **特点:**

* 具有层级关系,节点之间存在父子关系。

* 适用于存储具有层次结构的数据(如文件系统)

* **应用:**

* 文件系统

* 二叉搜索树

**图**

* **定义:**由节点和边组成的数据结构,节点代表实体,边代表实体之间的关系。

* **特点:**

* 节点之间存在任意连接关系,可能存在环。

* 适用于存储复杂的关系数据(如社交网络)

* **应用:**

* 社交网络

* 路径查找

**哈希表**

* **定义:**基于哈希函数将键值对存储在数组中的数据结构。

* **特点:**

* 根据键值快速查找和插入元素(O(1))。

* 适用于存储键值对数据,且需要快速查找。

* **应用:**

* 缓存

* 字典

# 3. 算法优化实践

### 3.1 算法时间复杂度优化

#### 3.1.1 减少循环次数

循环是算法中常见的操作,但过多的循环会显著降低算法的效率。优化循环次数的技巧包括:

- **合并循环:**将多个循环合并为一个循环,以减少循环次数。

- **使用哨兵变量:**使用哨兵变量来标记循环的结束条件,避免不必要的循环迭代。

- **提前退出循环:**如果满足某些条件,提前退出循环,避免不必要的迭代。

**代码示例:**

```java

// 原始循环

for (int i = 0; i < n; i++) {

for (int j = 0; j < m; j++) {

// ...

}

}

// 优化后的循环

for (int i = 0; i < n; i++) {

for (int j = 0; j < m && j < n; j++) {

// ...

}

}

```

**逻辑分析:**

优化后的循环利用了 `j < n` 的条件,避免了不必要的循环迭代。当 `j` 达到 `n` 时,内层循环将提前退出,从而减少了循环次数。

#### 3.1.2 使用更快的算法

有时,使用更快的算法可以显著提高算法的效率。常见的优化算法包括:

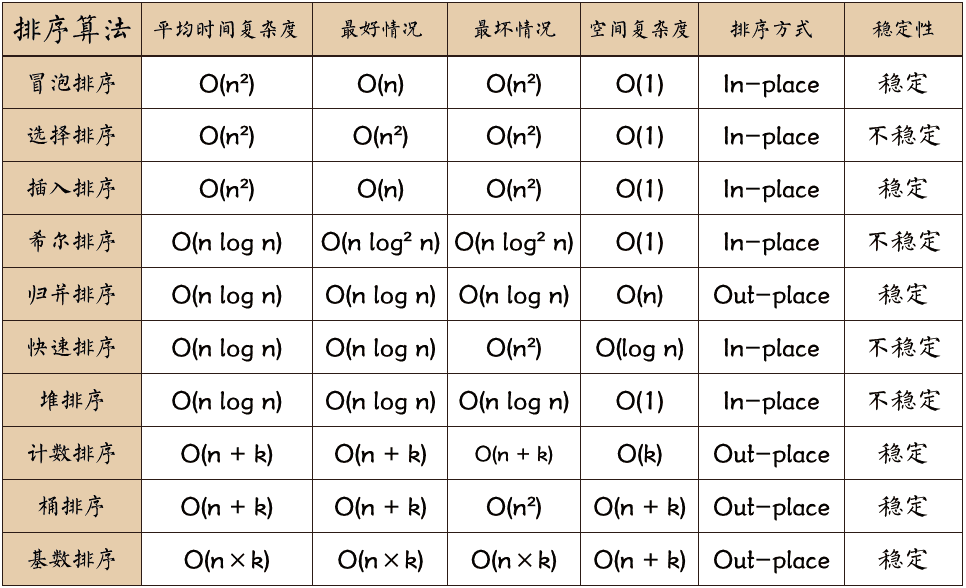

- **排序算法:**使用快速排序或归并排序等更快的排序算法。

- **搜索算法:**使用二分查找或哈希表等更快的搜索算法。

- **数据结构:**使用更快的数据结构,例如哈希表或平衡树。

**代码示例:**

```java

// 原始算法:线性搜索

for (int i = 0; i < n; i++) {

if (arr[i] == target) {

return i;

}

}

// 优化后的算法:二分查找

int low = 0;

int high = n - 1;

while (low <= high) {

int mid = (low + high) / 2;

if (arr[mid] == target) {

return mid;

} else if (arr[mid] < target) {

low = mid + 1;

} else {

high = mid - 1;

}

}

```

**逻辑分析:**

优化后的二分查找算法利用了数组的有序性,通过不断缩小搜索范围来提高效率。与线性搜索相比,二分查找的时间复杂度为 O(log n),而线性搜索的时间复杂度为 O(n)。

### 3.2 算法空间复杂度优化

#### 3.2.1 减少数据结构的大小

数据结构的大小会影响算法的空间复杂度。优化数据结构大小的技巧包括:

- **使用更紧凑的数据结构:**使用位图或稀疏数组等更紧凑的数据结构。

- **减少数据冗余:**消除数据中的冗余,例如使用哈希表存储唯一值。

- **使用内存池:**使用内存池来管理内存分配,避免频繁的内存分配和释放。

**代码示例:**

```java

// 原始数据结构:数组

int[] arr = new int[n];

// 优化后的数据结构:位图

BitSet bitset = new BitSet(n);

```

**逻辑分析:**

优化后的位图数据结构仅使用一个位来表示每个元素,从而显著减少了空间占用。

#### 3.2.2 优化内存分配

内存分配会影响算法的空间复杂度。优化内存分配的技巧包括:

- **使用对象池:**使用对象池来管理对象创建和销毁,避免频繁的内存分配和释放。

- **使用内存映射:**使用内存映射将文件直接映射到内存中,避免不必要的内存复制。

- **使用压缩算法:**使用压缩算法来减少数据的存储空间。

**代码示例:**

```java

// 原始内存分配

String[] strs = new String[n];

// 优化后的内存分配:对象池

ObjectPool<String> pool = new ObjectPool<>();

for (int i = 0; i < n; i++) {

strs[i] = pool.borrowObject();

}

```

**逻辑分析:**

优化后的对象池机制避免了频繁的字符串创建和销毁,从而优化了内存分配。

# 4. Java并行编程与算法加速

### 4.1 并行编程基础

#### 4.1.1 线程和并发

**线程**是操作系统中的一个轻量级进程,它与其他线程共享相同的内存空间,但拥有自己的执行栈。线程可以并发执行,从而提高程序的效率。

**并发**是指多个线程同时执行,但并不一定同时执行相同的代码。并发可以提高程序的吞吐量和响应时间。

#### 4.1.2 并发控制和同步

在并发编程中,需要考虑并发控制和同步问题。并发控制是指确保线程安全地访问共享资源,而同步是指协调线程之间的执行顺序。

Java中常用的并发控制机制包括:

* **锁**:锁是一种同步机制,它允许线程在访问共享资源之前获取锁,从而保证资源的独占访问。

* **原子变量**:原子变量是一种特殊的变量,它保证在多线程环境中对该变量的读写操作是原子性的,即不可分割的。

### 4.2 并行算法设计和实现

#### 4.2.1 并行归并排序

归并排序是一种经典的排序算法,它可以并行化。并行归并排序的算法流程如下:

```java

public static void parallelMergeSort(int[] arr) {

if (arr.length <= 1) {

return;

}

int mid = arr.length / 2;

int[] left = Arrays.copyOfRange(arr, 0, mid);

int[] right = Arrays.copyOfRange(arr, mid, arr.length);

// 并行排序两个子数组

ForkJoinPool pool = ForkJoinPool.commonPool();

pool.invoke(new ParallelMergeSortTask(left));

pool.invoke(new ParallelMergeSortTask(right));

// 合并两个有序子数组

merge(arr, left, right);

}

```

**代码逻辑分析:**

* 首先判断数组长度是否小于等于1,如果是,则直接返回。

* 计算数组的中点,并将其分成左右两个子数组。

* 使用ForkJoinPool并行执行对两个子数组的排序任务。

* 最后,合并两个有序子数组。

#### 4.2.2 并行快速排序

快速排序也是一种经典的排序算法,它也可以并行化。并行快速排序的算法流程如下:

```java

public static void parallelQuickSort(int[] arr) {

if (arr.length <= 1) {

return;

}

int pivot = arr[arr.length / 2];

// 创建两个子数组,一个存放小于pivot的元素,另一个存放大于pivot的元素

List<Integer> left = new ArrayList<>();

List<Integer> right = new ArrayList<>();

for (int i = 0; i < arr.length; i++) {

if (arr[i] < pivot) {

left.add(arr[i]);

} else if (arr[i] > pivot) {

right.add(arr[i]);

}

}

// 并行排序两个子数组

ForkJoinPool pool = ForkJoinPool.commonPool();

pool.invoke(new ParallelQuickSortTask(left));

pool.invoke(new ParallelQuickSortTask(right));

// 合并两个有序子数组

int[] result = new int[arr.length];

int index = 0;

for (int i : left) {

result[index++] = i;

}

result[index++] = pivot;

for (int i : right) {

result[index++] = i;

}

System.arraycopy(result, 0, arr, 0, arr.length);

}

```

**代码逻辑分析:**

* 首先判断数组长度是否小于等于1,如果是,则直接返回。

* 选择数组中点元素作为枢轴元素。

* 创建两个子数组,一个存放小于枢轴元素的元素,另一个存放大于枢轴元素的元素。

* 使用ForkJoinPool并行执行对两个子数组的排序任务。

* 最后,合并两个有序子数组。

# 5. 算法性能分析与调优

### 5.1 算法性能分析工具和方法

算法的性能分析对于识别和解决性能瓶颈至关重要。Java提供了多种工具和方法来帮助分析算法的性能。

#### 5.1.1 Java Profiler

Java Profiler是一个内置的工具,用于分析Java应用程序的性能。它可以收集有关CPU使用率、内存分配和线程活动等指标。Java Profiler可以以两种模式运行:

- **采样模式:**定期采样应用程序的堆栈跟踪,以识别热点方法。

- **仪器模式:**在应用程序中插入探测器,以收集更详细的性能数据。

#### 5.1.2 JMH基准测试框架

JMH(Java Microbenchmark Harness)是一个基准测试框架,用于测量Java代码的性能。它提供了精确的基准测试功能,可以消除环境噪声和测量误差。JMH允许开发人员创建可重复、可比较的基准测试,以评估算法的性能。

### 5.2 算法调优技巧和最佳实践

算法调优涉及应用技术来提高算法的性能。以下是常用的调优技巧和最佳实践:

#### 5.2.1 缓存优化

缓存优化通过将经常访问的数据存储在高速缓存中来提高算法的性能。Java提供了`ConcurrentHashMap`和`Caffeine`等并发缓存库,可以显著减少对底层数据结构的访问时间。

#### 5.2.2 数据结构选择

选择适当的数据结构对于算法的性能至关重要。例如,对于需要快速查找操作的应用程序,哈希表比链表更合适。Java提供了各种数据结构,包括数组、链表、栈、队列、树和哈希表,开发人员可以根据算法的需求选择最合适的数据结构。

#### 5.2.3 其他调优技巧

除了缓存优化和数据结构选择之外,还有其他调优技巧可以提高算法的性能,包括:

- **减少循环次数:**避免不必要的循环,并使用更有效的循环结构。

- **使用更快的算法:**考虑使用更快的算法,例如快速排序或归并排序,而不是较慢的算法,例如冒泡排序。

- **并行化算法:**如果算法可以并行化,则利用多核处理器可以显著提高性能。

- **使用并行库:**利用Java并发库,例如`ExecutorService`和`ConcurrentHashMap`,可以简化并行编程并提高性能。

# 6. 算法竞赛与实战应用

### 6.1 算法竞赛平台和常见算法题型

算法竞赛平台为算法爱好者提供了一个切磋交流的平台,同时也是提升算法技能的有效途径。其中,LeetCode 和 HackerRank 是两个最受欢迎的算法竞赛平台。

**LeetCode**

LeetCode 提供了大量的算法题库,涵盖了各种算法类型,包括数组、链表、栈、队列、树、图、动态规划等。LeetCode 的题型难度分级清晰,从简单到困难,适合不同水平的算法学习者。

**HackerRank**

HackerRank 也是一个知名的算法竞赛平台,提供各种算法挑战和竞赛。HackerRank 的题型更加注重实际应用,涉及数据结构、算法、人工智能、机器学习等多个领域。

### 6.2 算法在实际项目中的应用

算法在实际项目中有着广泛的应用,以下列举几个常见的应用场景:

**图像处理**

图像处理算法在图像编辑、图像识别、计算机视觉等领域有着广泛的应用。例如,图像压缩算法可以减少图像文件的大小,而图像增强算法可以改善图像的质量。

**机器学习**

机器学习算法是人工智能的基础,用于从数据中学习模式和知识。例如,分类算法可以识别图像中的物体,而回归算法可以预测未来的趋势。

**代码示例**

以下代码示例展示了如何使用 Java 实现一个简单的图像压缩算法:

```java

import java.awt.image.BufferedImage;

import javax.imageio.ImageIO;

public class ImageCompression {

public static void main(String[] args) throws Exception {

// 读取原始图像

BufferedImage originalImage = ImageIO.read(new File("original.jpg"));

// 创建压缩后的图像

BufferedImage compressedImage = new BufferedImage(originalImage.getWidth() / 2, originalImage.getHeight() / 2, BufferedImage.TYPE_INT_RGB);

// 缩小图像

for (int i = 0; i < compressedImage.getWidth(); i++) {

for (int j = 0; j < compressedImage.getHeight(); j++) {

compressedImage.setRGB(i, j, originalImage.getRGB(i * 2, j * 2));

}

}

// 保存压缩后的图像

ImageIO.write(compressedImage, "jpg", new File("compressed.jpg"));

}

}

```

在这个示例中,我们通过缩小图像的尺寸来实现图像压缩。通过将原始图像的每个像素缩小为四分之一,我们可以显著减少图像文件的大小,同时保持图像的基本特征。

0

0