模型过拟合与欠拟合的评估:如何诊断与解决

发布时间: 2024-09-02 10:36:17 阅读量: 17 订阅数: 23

# 1. 模型过拟合与欠拟合的概念

## 模型过拟合与欠拟合的定义

在机器学习中,模型过拟合(Overfitting)与欠拟合(Underfitting)是两种常见的训练问题。简单来说,欠拟合指的是模型过于简单,无法捕捉数据的真实关系,因而其在训练集和测试集上的表现都不佳。而过拟合则指模型过于复杂,以至于它不仅学习到了数据中的真实模式,还学习了数据中的噪声和异常值。这导致模型在训练集上表现很好,但在测试集上表现不佳,泛化能力差。

## 模型过拟合的影响

过拟合是模型训练中的一大挑战。它意味着模型在训练数据上表现完美,但是却无法适应新的、未见过的数据。这在实际应用中是不希望看到的,因为最终的目标是让模型能够在实际环境中准确预测。因此,理解过拟合和欠拟合的概念,以及如何诊断和解决这些问题,对于构建有效且健壮的机器学习模型至关重要。

# 2. 过拟合与欠拟合的理论基础

## 2.1 模型复杂度和拟合能力

### 2.1.1 模型复杂度的定义及其对拟合的影响

模型复杂度是指模型能描述的函数关系的复杂程度。在机器学习中,一个复杂的模型可能包含大量的参数,能够捕捉数据中的细微特征和规律。然而,过于复杂的模型也容易捕捉到数据中的噪声和异常值,从而导致过拟合。

复杂度高的模型如深度神经网络可能在训练数据上表现优异,但在未见过的数据上表现较差,这是因为他们可能学会了训练数据的特定属性而不是潜在的、普遍的规律。这种现象称为过拟合(Overfitting)。相反,简单模型如线性模型可能无法捕捉数据中的复杂关系,导致欠拟合(Underfitting)。

在实践中,选择合适复杂度的模型是一个挑战。模型选择过于复杂可能导致过拟合,而过于简单则可能欠拟合。通常情况下,更复杂的模型需要更多的数据来训练,以确保它们在训练集外的数据上也能泛化。

### 2.1.2 拟合能力与泛化能力的平衡

拟合能力(Fitting Ability)指的是模型对训练数据的匹配程度,而泛化能力(Generalization Ability)则指的是模型在新数据上的表现。理想情况下,模型需要在拟合能力和泛化能力之间找到一个平衡点。

提高模型的拟合能力通常意味着增加模型的复杂度,比如增加层的深度或者神经元的数量。然而,过度追求拟合能力可能会导致模型学习到训练数据的噪声,从而在新数据上性能下降,即过拟合。

泛化能力的增强需要通过减少模型复杂度、增加数据量、数据增强或者采用正则化技术。这些方法可以帮助模型更稳定地在未见过的数据上做出准确预测。

## 2.2 识别过拟合与欠拟合的理论方法

### 2.2.1 训练集和测试集的性能对比分析

在机器学习项目中,将数据集划分为训练集和测试集是识别过拟合与欠拟合的基本方法。通过对模型在训练集和测试集上的性能进行对比分析,可以评估模型的泛化能力。

过拟合的模型在训练集上表现良好,而在测试集上表现差,表明模型捕捉了训练数据中的噪声,而不是数据的底层分布。相反,如果一个模型在测试集上的表现和训练集相似或相差不大,则模型可能没有过拟合,但如果两者表现都差,则可能存在欠拟合的情况。

### 2.2.2 交叉验证的使用及其重要性

交叉验证是一种评估模型泛化能力的技术,特别适用于数据量较小的情况。在k-折交叉验证中,数据集被分成k个大小相似的互斥子集,每个子集轮流作为测试集,其余的作为训练集。模型在k个不同的训练集和测试集上分别进行训练和验证,最终的性能评估是所有k次训练的平均值。

交叉验证的重要性在于它能够提供更稳定的性能评估结果,并减少因数据划分方式不同而导致的评估结果差异。这对于防止过拟合并选择恰当的模型复杂度非常关键。

### 2.2.3 统计检验在诊断中的作用

统计检验是一种利用统计学方法来判断模型性能差异是否具有统计学意义的技术。通过假设检验(例如t检验或ANOVA),可以确定模型在不同配置或不同数据集上的性能差异是否显著。

在过拟合和欠拟合的诊断中,统计检验可以帮助我们了解模型在训练集和测试集上的表现差异是否在正常范围内,或者是否显著到足以表明存在过拟合或欠拟合的情况。此外,使用统计检验可以帮助我们在多个模型或多个数据集上进行比较,选出最佳模型。

至此,我们已经介绍了过拟合与欠拟合的理论基础,并讨论了识别这两种现象的方法。在下一章节中,我们将探讨使用可视化手段来识别模型问题的技术,以及如何通过数值指标来进行模型的诊断。

# 3. 过拟合与欠拟合的诊断技术

在机器学习模型的训练过程中,模型可能会因为数据、参数配置不当或其他原因,出现过拟合或欠拟合的现象。有效诊断过拟合与欠拟合是模型调优的重要步骤,它可以帮助我们理解模型的当前性能和潜在问题。本章将重点介绍多种诊断技术,包括可视化手段、数值诊断指标以及性能监控工具的使用。

## 3.1 利用可视化手段识别模型问题

### 3.1.1 残差图的分析技巧

残差图是分析回归模型是否出现过拟合或欠拟合的有效工具。残差是指模型预测值与实际值之间的差异,残差图是将残差按输入数据顺序绘制的散点图。

```python

import matplotlib.pyplot as plt

# 假设 y_actual 为实际值, y_pred 为模型预测值

y_actual = [实际数据]

y_pred = [模型预测数据]

residuals = y_actual - y_pred

plt.scatter(range(len(y_actual)), residuals)

plt.title('残差图')

plt.xlabel('样本索引')

plt.ylabel('残差值')

plt.axhline(y=0, color='r', linestyle='--')

plt.show()

```

分析残差图时,我们应关注残差是否呈现随机分布,残差的均值是否接近0,以及是否存在明显的模式或趋势。如果残差呈现出特定的模式或趋势,这可能表明模型未能捕捉到数据中的某些特征或存在过拟合现象。

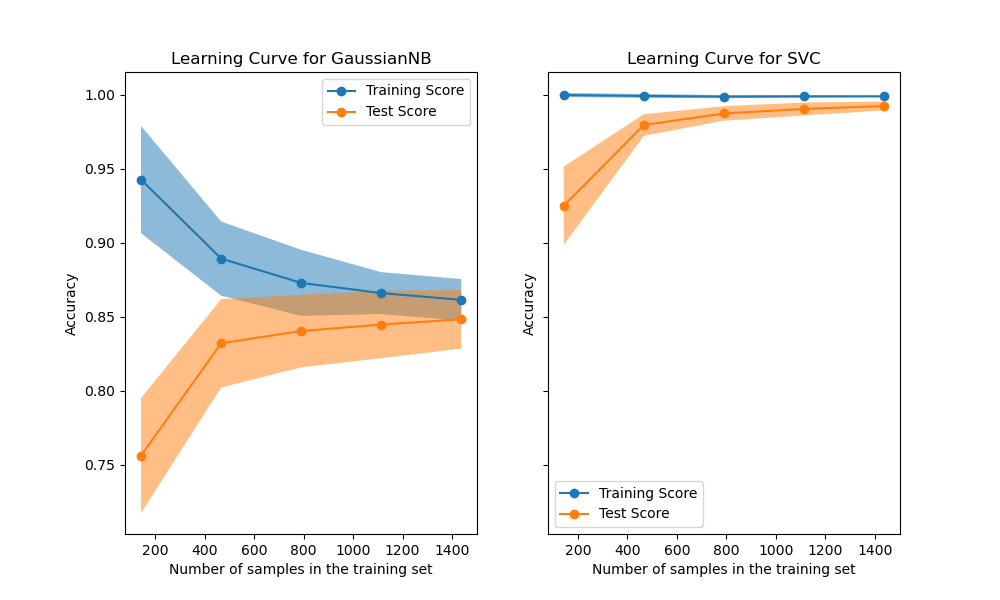

### 3.1.2 学习曲线的绘制和解读

学习曲线是通过将模型在训练集和验证集上的性能绘制为训练样本数量的函数而得到的图表。通过分析学习曲线,我们可以识别模型是处于过拟合还是欠拟合状态。

```python

# 假设 train_scores 和 valid_scores 为模型在不同训练样本数量上的性能指标

import numpy as np

import matplotlib.pyplot as plt

train_sizes = np.linspace(0.1, 1.0, 10)

train_scores_mean = [某个值] # 训练集均值

train_scores_std = [某个值] # 训练集标准差

valid_scores_mean = [某个值] # 验证集均值

valid_scores_std = [某个值] # 验证集标准差

# 绘制学习曲线

def plot_learning_curve(estimator, title, X, y, ylim=None, cv=None, n_jobs=None, train_sizes=train_sizes):

plt.figure()

plt.title(title)

if ylim is not None:

plt.ylim(*ylim)

plt.xlabel("Training examples")

plt.ylabel("Score")

train_sizes, train_scores, test_scores = learning_curve(estimator, X, y, cv=cv, n_jobs=n_jobs, train_sizes=train_sizes)

train_scores_mean = np.mean(train_scores, axis=1)

train_scores_std = np.std(train_scores, axis=1)

test_scores_mean = np.mean(test_scores, axis=1)

test_scores_std = np.std(test_scores, axis=1)

plt.grid()

plt.fill_be

```

0

0