过拟合与欠拟合的博弈:随机森林回归模型调优的终极指南

发布时间: 2024-07-21 17:55:42 阅读量: 392 订阅数: 53

随机森林回归模型项目实战资料.zip

# 1. 过拟合与欠拟合的博弈**

过拟合和欠拟合是机器学习模型训练中常见的两个极端问题。

* **过拟合**是指模型在训练集上表现良好,但在新数据上表现不佳。这是因为模型过于关注训练数据的具体细节,以至于无法泛化到新的数据。

* **欠拟合**是指模型在训练集和新数据上都表现不佳。这是因为模型没有从数据中学习到足够的信息,导致其无法做出准确的预测。

# 2. 随机森林回归模型调优理论基础

### 2.1 过拟合与欠拟合的概念和成因

#### 2.1.1 过拟合的特征和危害

**特征:**

- 模型在训练集上表现优异,但在新数据上表现不佳。

- 模型过于复杂,捕捉了训练集中一些不相关的噪声和异常值。

**危害:**

- 泛化能力差,无法对新数据进行准确预测。

- 模型对训练集的依赖性过强,容易出现过拟合现象。

- 预测结果不稳定,容易受到训练数据变化的影响。

#### 2.1.2 欠拟合的特征和危害

**特征:**

- 模型在训练集和新数据上的表现都很差。

- 模型过于简单,无法捕捉数据中的复杂模式。

**危害:**

- 预测精度低,无法准确反映数据中的关系。

- 模型对数据变化不敏感,无法适应新的数据分布。

- 预测结果过于平滑,缺乏细节和预测能力。

### 2.2 随机森林算法原理

#### 2.2.1 决策树的构建过程

- **特征选择:**从所有特征中随机选择一个子集。

- **分割准则:**使用信息增益或基尼不纯度等准则选择最佳分割点。

- **递归分割:**将数据集递归地分割成更小的子集,直到达到停止条件(例如,达到最大深度或最小样本数)。

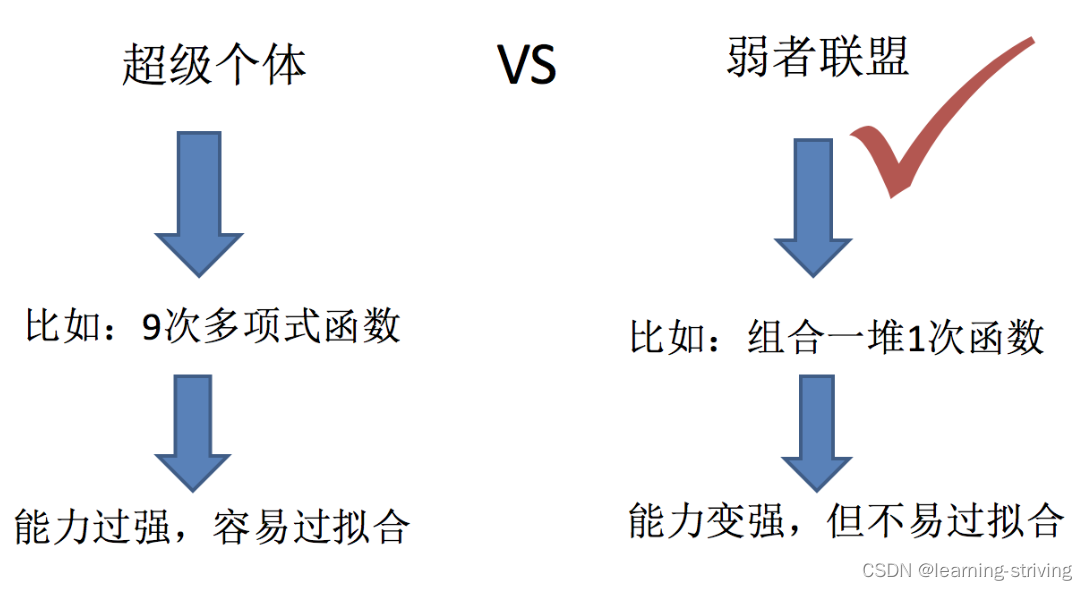

#### 2.2.2 随机森林的集成思想

- **多棵决策树:**构建多棵决策树,每棵树使用不同的训练数据子集和特征子集。

- **投票或平均:**将每棵树的预测结果进行投票或平均,得到最终预测。

- **集成效应:**通过集成多个决策树,可以减少过拟合,提高模型的泛化能力。

# 3.1 数据预处理和特征工程

#### 3.1.1 数据清洗和缺失值处理

数据预处理是机器学习模型调优的关键步骤,它可以提高模型的准确性和鲁棒性。数据清洗包括处理缺失值、异常值和数据类型转换等操作。

* **缺失值处理:**缺失值处理有以下几种常见方法:

* **删除法:**对于缺失值较多的样本或特征,可以将其删除。

* **插补法:**对于缺失值较少的样本或特征,可以使用插补法进行填充。常用的插补方法包括均值插补、中位数插补和众数插补等。

* **KNN插补:**使用K近邻算法寻找与缺失值样本相似的样本,并用相似样本的对应值进行填充。

```python

#

```

0

0