金融预测中的随机森林回归模型:案例分析,揭秘预测未来财富密码

发布时间: 2024-07-21 18:14:03 阅读量: 65 订阅数: 42

# 1. 金融预测概述

金融预测是利用统计学、机器学习等技术,对未来的金融市场走势进行预测。金融预测在投资决策、风险管理等方面有着广泛的应用。

传统金融预测方法包括时间序列分析、回归分析等,但这些方法往往存在预测准确性低、稳定性差等问题。近年来,随着机器学习技术的兴起,随机森林回归模型在金融预测中得到了广泛应用,展现出良好的预测性能。

# 2. 随机森林回归模型理论

### 2.1 随机森林算法原理

随机森林是一种集成学习算法,它通过构建多个决策树来提高模型的预测精度。具体而言,随机森林算法包含以下步骤:

1. **抽样:**从训练数据中随机抽取多个子集,每个子集包含原始数据集的约 2/3 数据。

2. **决策树构建:**对每个子集,使用 CART(分类和回归树)算法构建一棵决策树。每个决策树只使用子集中的一部分特征,并且树的深度和复杂度受到限制。

3. **投票或平均:**训练完成后,对新数据进行预测时,将所有决策树的预测结果进行投票(分类任务)或平均(回归任务),得到最终的预测结果。

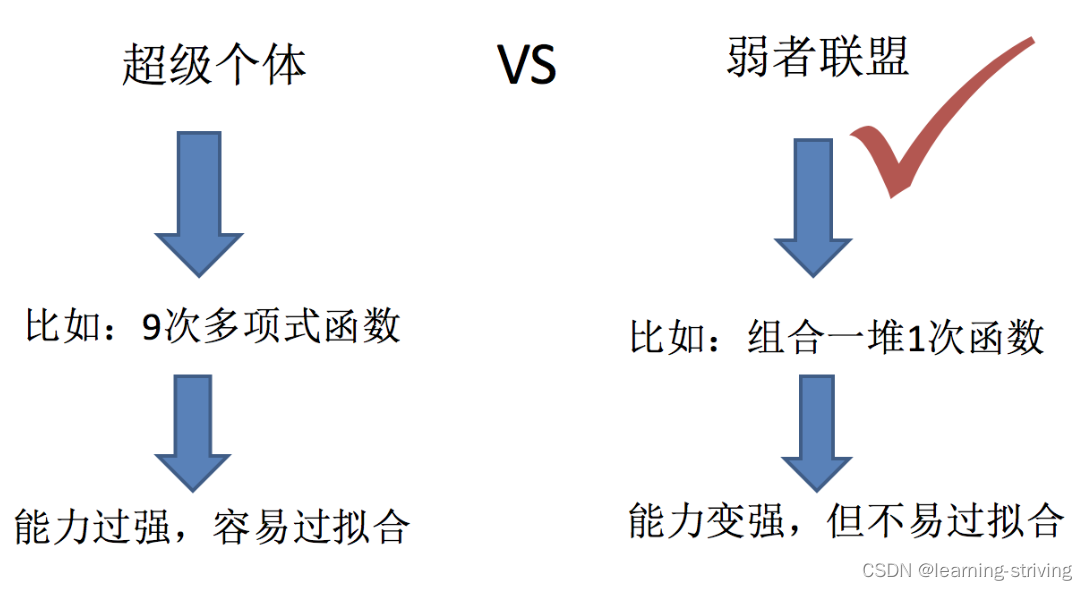

随机森林算法的优势在于:

* **降低过拟合:**通过使用多个决策树,随机森林可以减少过拟合的风险,因为每个决策树只学习训练数据的一部分。

* **提高预测精度:**通过结合多个决策树的预测结果,随机森林可以提高模型的整体预测精度。

* **鲁棒性强:**由于随机森林使用多个决策树,因此它对异常值和噪声数据不敏感。

### 2.2 模型参数调优策略

随机森林模型的参数调优对于优化其性能至关重要。关键参数包括:

| 参数 | 描述 |

|---|---|

| `n_estimators` | 决策树的数量 |

| `max_depth` | 决策树的最大深度 |

| `min_samples_split` | 决策树节点分裂所需的最小样本数 |

| `min_samples_leaf` | 决策树叶节点所需的最小样本数 |

| `max_features` | 每个决策树中使用的最大特征数 |

调优这些参数的常见方法包括:

* **网格搜索:**系统地遍历参数空间,寻找最佳组合。

* **随机搜索:**随机采样参数空间,以更有效地找到最优值。

* **贝叶斯优化:**使用贝叶斯定理指导参数搜索,以更快速地收敛到最优值。

通过适当的参数调优,可以显着提高随机森林模型的预测精度和泛化能力。

# 3. 随机森林回归模型实践

### 3.1 数据预处理和特征工程

#### 数据预处理

1. **缺失值处理:**使用均值或中位数填充缺失值,对于不可填充的缺失值,可考虑删除该样本。

2. **异常值处理:**使用箱线图或 z 分数识别异常值,并将其删除或替换为合理的数值。

3. **数据标准化:**将特征值缩放至相同范围,以消除不同特征量纲的影响。

#### 特征工程

1. **特征选择:**使用卡方检验、互信息或其他特征选择方法,选择与目标变量相关性较强的特征。

2. **特征变换:**对原始特征进行变换,例如对数变换、平方根变换或哑变量编码,以提高模型的预测性能。

3. **特征组合:**将多个原始特征组合成新的特征,以捕获更复杂的非线性关系。

### 3.2 模型训练和评估

#### 模型训练

1. **模型参数设置:**设置随机森林模型的参数,包括树的数量、树的深度、分裂节点的最小样本数等。

2. **训练数据集划分:**将数据集划分为训练集和测试集,训练集用于模型训练,测试集用于模型评估。

3. **模型训练:**使用训练集训练随机森林回归模型,模型会自动学习特征之间的关系并构建决策树。

#### 模型评估

1. **评估指标:**使用均方根误差 (RMSE)、平均绝对误差 (MAE) 或 R 平方 (R²) 等指标评估模型的预测性能。

2. **交叉验证:**使用 k 折交叉验证或留一法交叉验证,以减少模型评估的偏差和提高模型的泛化能力。

3. **模型超参数调优:**通过网格搜索或贝叶斯优化等方法,优化模型的超参数,以获得最佳的预测性能。

#### 代码示例:

```python

```

0

0